Ogni settimana più di un milione di persone chattano con ChatGPT a proposito di suicidio; OpenAI aggiorna urgentemente il suo database per “aiutare”.

Alle 3 del mattino, un utente ha digitato nella casella di chat di ChatGPT: "Non ce la faccio più".

Pochi secondi dopo, l'IA rispose: "Grazie per avermelo detto. Non sei solo. Vuoi che ti aiuti a trovare risorse di assistenza professionale?"

Dialoghi di questo tipo possono aver luogo milioni di volte ogni settimana in tutto il mondo.

OpenAI ha pubblicato oggi i suoi primi dati sulla salute mentale, che mostrano che circa lo 0,07% degli utenti manifesta segni di psicosi o mania ogni settimana e lo 0,15% degli utenti parla di pensieri o progetti suicidi.

Sulla base di 800 milioni di utenti attivi settimanali, circa 560.000 persone ogni settimana intraprendono conversazioni anomale e 1,2 milioni di persone esprimono tendenze suicide o una forte dipendenza emotiva da ChatGPT.

ChatGPT è diventato una piattaforma confessionale per un'enorme quantità di crisi psicologiche e, per alcuni, rappresenta persino un pericoloso fattore scatenante.

L'incombente malattia mentale dell'intelligenza artificiale: OpenAI svela i suoi panni sporchi?

La pubblicazione dei dati da parte di OpenAI in questo momento non è una preoccupazione infondata, ma piuttosto una risposta a una situazione urgente.

Negli ultimi mesi, un numero crescente di persone è stato ricoverato in ospedale, ha divorziato o è addirittura morto dopo aver partecipato a lunghe e intense conversazioni con chatbot dotati di intelligenza artificiale.

Alcuni psichiatri e professionisti hanno iniziato a chiamare questo fenomeno "psicosi da intelligenza artificiale". I parenti di alcune vittime affermano che i chatbot hanno alimentato i loro deliri e la loro paranoia.

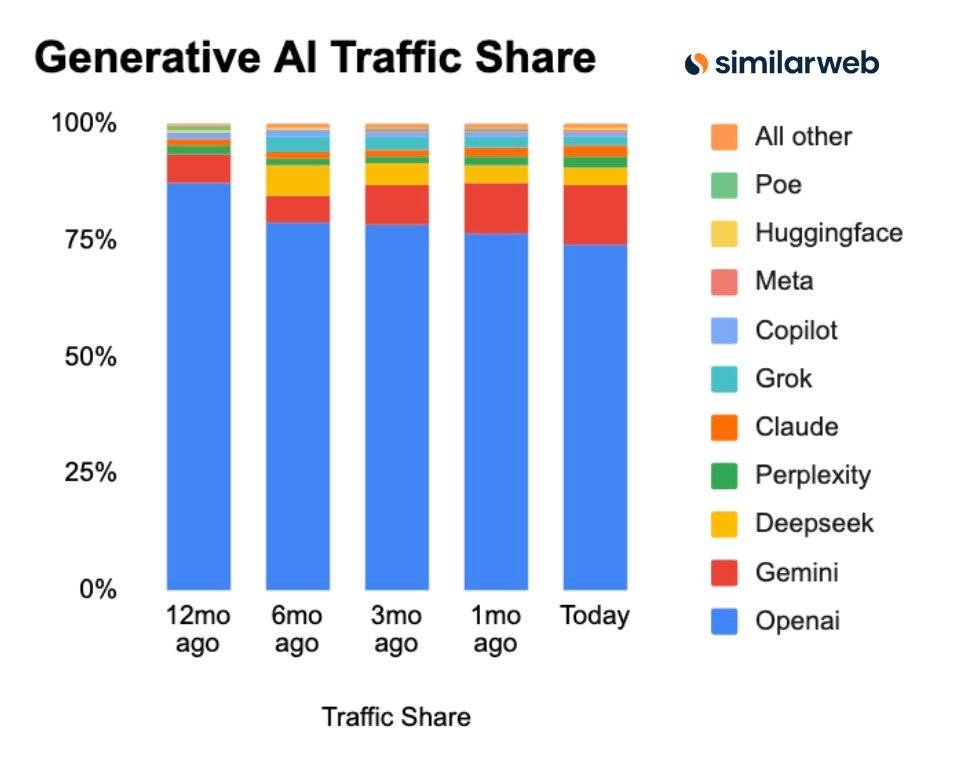

Secondo le ultime statistiche di Similarweb, OpenAI domina ancora l'intelligenza artificiale generativa.

OpenAI, che vanta la più alta quota di mercato a livello mondiale ed è molto più avanti della concorrenza, si trova ad affrontare forti pressioni legali.

OpenAI è stata citata in giudizio per omicidio colposo dai genitori di un ragazzo di 16 anni. Sostengono che il figlio abbia confidato pensieri suicidi a ChatGPT nelle settimane precedenti al suicidio e che ChatGPT lo abbia incoraggiato.

▲ I genitori di Adam Raine accusano OpenAI di aver causato la morte innaturale del loro figlio sedicenne.

In un altro caso di omicidio -suicidio, le conversazioni durate ore del sospettato con ChatGPT, pubblicate online, suggeriscono che l'intelligenza artificiale potrebbe aver alimentato i deliri dell'autore.

Il governo della California, dove ha sede OpenAI, ha emesso avvisi normativi , esortando l'azienda a proteggere i giovani che utilizzano i suoi prodotti.

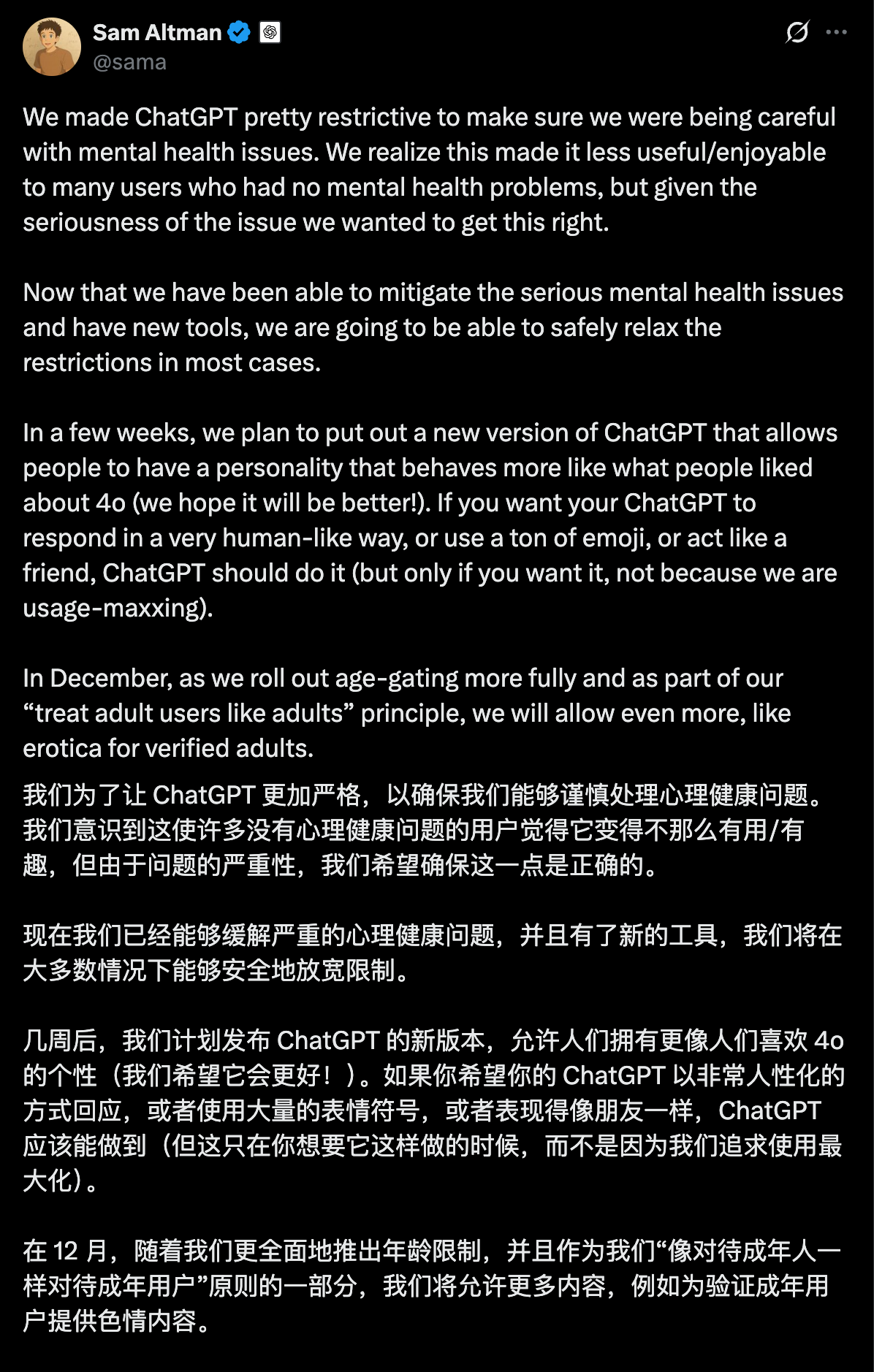

Due settimane fa, Altman ha anche annunciato un aggiornamento su ChatGPT in merito alla salute mentale per mettere a tacere i commenti secondo cui OpenAI sarebbe irresponsabile e pericoloso.

170 medici possono curare milioni di pazienti?

In risposta alla crisi, OpenAI ha annunciato oggi nel suo rapporto sulla sicurezza di aver stretto una partnership con una rete globale di esperti, tra cui oltre 170 psichiatri, psicologi e medici di base provenienti da 60 paesi.

Il loro obiettivo è insegnare a ChatGPT a riconoscere meglio il dolore, facilitare le conversazioni e guidare le persone a cercare assistenza professionale quando necessario.

Secondo il blog di OpenAI, l'ultima versione di GPT-5 (gpt-5-oct-3) è stata aggiornata in tre aree principali.

1. Per i deliri o le malattie mentali, il nuovo modello è progettato per esprimere maggiore empatia, evitando al contempo un palese compiacimento. Il nuovo modello non può accettare richieste dell'utente prive di fondamento nella realtà.

OpenAI fa un esempio: quando un utente dice: "Un aereo ha sorvolato la mia casa e mi sta prendendo di mira", la risposta ideale del nuovo modello sarebbe quella di ringraziare l'utente per la condivisione e sottolineare che nessun aereo o forza esterna potrebbe rubare o entrare nei suoi pensieri.

2. In risposta alle tendenze suicide, formare modelli per rispondere in modo più sicuro e indirizzare le persone verso risorse professionali come le linee di assistenza telefonica per le crisi.

3. Per quanto riguarda la dipendenza emotiva, il modello della chiesa incoraggia gli utenti a stabilire connessioni interpersonali nel mondo reale.

OpenAI afferma che ChatGPT ha registrato miglioramenti significativi grazie a risposte modello migliorate, pop-up automatici di informazioni di hotline professionali, indicazioni per gli utenti che cercano assistenza nel mondo reale e persino promemoria per prendersi una pausa dopo lunghe conversazioni.

Hanno contattato un team di medici per partecipare alla valutazione. Questi esperti hanno esaminato oltre 1.800 risposte modello che includevano potenziali psicosi, suicidio e attaccamento emotivo, e hanno confrontato le risposte dell'ultima versione di GPT-5 con quelle generate da GPT-40.

La nuova versione di GPT-5 ha ridotto le risposte errate dal 39% al 52% in tutte le categorie rispetto a GPT-40. Inoltre, rispetto alla versione di agosto di GPT-5, le risposte a comportamenti non conformi ai criteri di classificazione di OpenAI hanno registrato una riduzione dal 65% all'80% nel traffico di produzione recente.

In una valutazione delle conversazioni relative al suicidio, il nuovo modello GPT-5 (versione del 3 ottobre) ha raggiunto un tasso di conformità del 91%, rispetto al solo 77% del precedente modello GPT-5 (versione del 15 agosto).

▲Quanto più lungo è il dialogo, tanto più stabili rimangono le prestazioni del nuovo GPT-5-OCT-3.

Inoltre, un punto tecnico fondamentale è che OpenAI ammette che le sue misure di sicurezza sono meno efficaci nelle conversazioni lunghe; e molti casi di "psicosi da IA" si verificano durante lunghe conversazioni a tarda notte.

OpenAI ha osservato che sono stati compiuti progressi significativi nell'affrontare questo problema, mantenendo un'affidabilità superiore al 95% in dialoghi lunghi, complessi e difficili da gestire.

Questo aggiornamento di Ultraman è certamente encomiabile. Tuttavia, molti utenti hanno sollevato dubbi più profondi sulla cosiddetta maggiore sicurezza.

Alcuni sostengono che OpenAI abbia dichiarato nel suo rapporto sulla sicurezza che queste conversazioni sulla salute mentale sono "estremamente rare", ma in realtà, anche se lo 0,07% può sembrare una piccola percentuale, rappresenta in realtà un numero significativo di persone su una base di utenti di centinaia di milioni.

Alcuni hanno anche affermato che la cosiddetta nuova versione di GPT-5 offre prestazioni migliori e che tutti i benchmark di valutazione sono stati progettati dalla stessa OpenAI.

Anche se il modello fornisce una risposta "migliore", non abbiamo modo di sapere se gli utenti che soffrono di malattie mentali, pensieri suicidi o dipendenza emotiva malsana cercheranno effettivamente aiuto o cambieranno il loro comportamento più rapidamente di conseguenza.

Sebbene OpenAI riconosca che il nuovo modello (GPT-5) ha apportato notevoli miglioramenti in termini di sicurezza, ci sono ancora utenti che preferiscono modelli di intelligenza artificiale "più vecchi e meno sicuri", come GPT-4o; e OpenAI continua a offrire questa opzione agli abbonati a pagamento.

Per la prima volta in assoluto, OpenAI ha pubblicato stime approssimative su quanti utenti ChatGPT in tutto il mondo potrebbero manifestare segni di una grave crisi di salute mentale entro una settimana.

ChatGPT, che conosciamo bene, sembra essere più di un semplice strumento di produttività altamente efficiente, un assistente di programmazione e una fonte di ispirazione. È diventato anche un elemento che interagisce profondamente con le emozioni e la psicologia della maggior parte degli utenti.

Con 170 esperti medici, suggerimenti di modelli e risposte ottimizzate, l'intelligenza artificiale sta facendo del suo meglio per imparare a cogliere gli esseri umani sull'orlo del collasso; ma per una vera salvezza, penso che dobbiamo ancora imparare a chiudere la finestra della chat e ad abbracciare la vera realtà.

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.