Test pratici di Seedance 1.5 Pro: Nezha e Judy offrono performance eccezionali, ricreando scene iconiche; dialoghi ed effetti sonori basati sull’intelligenza artificiale notevolmente migliorati.

Ultimamente ci sono molti nuovi modi per utilizzare i video basati sull'intelligenza artificiale, proprio come le immagini raw generate dall'intelligenza artificiale che sono diventate popolari nella prima metà dell'anno.

▲ Fonte video: https://x.com/pabloprompt/status/2000706593579573301/

I video dietro le quinte generati dall'intelligenza artificiale, che in passato erano molto popolari, ora stanno tornando ad essere una tendenza sui social media, man mano che le capacità del modello migliorano.

Tuttavia, abbandona completamente il precedente flusso di lavoro complicato, ha un modello più intuitivo e può persino essere replicato con pochi semplici prompt, raggiungendo lo stesso livello di realismo del video.

L'ottimizzazione dei modelli di generazione video riduce costantemente la dipendenza dai nostri suggerimenti umani, garantendo al contempo una coerenza più stabile.

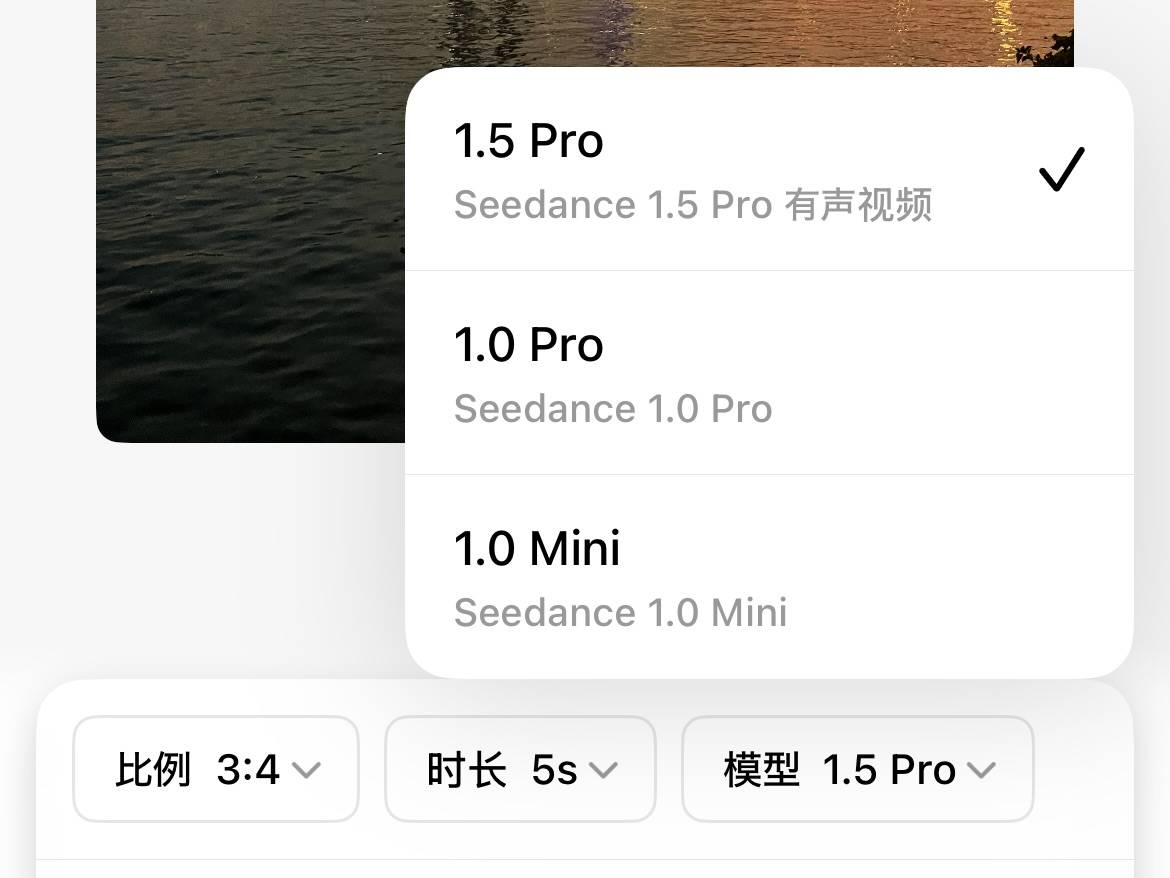

Doubao ha recentemente aggiornato il suo modello di generazione audio e video a una nuova generazione, Doubao Seedance 1.5 Pro, che ha notevolmente migliorato la generazione audio e video. I video generati ora supportano diversi suoni e rime in lingue come cinese, inglese, giapponese, coreano e spagnolo. Inoltre, per gli scenari cinesi, può anche generare dialetti come il sichuan e il cantonese.

Non solo può parlare, ma anche imitare gli accenti di diverse lingue. I video audiovisivi rappresentano una svolta importante per Seedance 1.5 Pro. In termini di generazione video, combina la sincronizzazione audiovisiva con i movimenti della telecamera cinematografica per rendere i video AI più realistici e dettagliati.

Il modello è ora disponibile sull'app Doubao. Basta aprire Doubao, cliccare su "Animate Photos", selezionare il modello 1.5 Pro e provare il piacere dei video generati dall'intelligenza artificiale. È possibile provarlo anche presso il Volcano Engine Experience Center e Jimeng AI.

Abbiamo anche effettuato alcuni test in anticipo e Seedance 1.5 Pro è sicuramente il miglior modello di generazione video che abbiamo a disposizione al momento, che può essere utilizzato direttamente e che può integrare simultaneamente l'audio.

Ascolta la versione originale di "I can't do it, Your Majesty".

Prima dell'uscita di *Zootropolis*, la scelta dei doppiatori era al centro di notevoli controversie tra gli utenti. Per comprendere appieno l'efficacia della generazione vocale di Seedance 1.5 Pro, possiamo dare un'occhiata al doppiaggio di due popolari video online: *Empresses in the Palace* e *Let the Bullets Fly*.

Abbiamo trovato online uno screenshot di un film o di una serie TV e lo abbiamo inviato a Doubao. Non abbiamo nemmeno dovuto inserire alcun comando, e il programma è stato in grado di riconoscere automaticamente il filmato e generare una scena di dialogo emozionante.

▲Nell'app Doubao, usa la funzione "Foto animate" per caricare il primo fotogramma e generare un video.

L'Imperatrice e Zhang Mazi sono stati ritratti in modo così convincente che siamo a un livello completamente diverso rispetto al modello di generazione video di qualche mese fa. Problemi come movimenti labiali non corrispondenti o voci meccaniche nei precedenti video di intelligenza artificiale sono stati ora risolti.

Ma il mandarino è solo una lingua di base; il vero segreto delle prestazioni superiori di Seedance 1.5 Pro nei dialetti risiede nella sua capacità di superare i modelli stranieri. Proprio come Sora 2 e Google Veo 3.1, pur essendo considerati leader del settore nella generazione di immagini, se mostraste loro le due immagini del primo fotogramma qui sopra, né Sora né Veo 3 riuscirebbero a comprendere i classici versi di "Imperatrici a Palazzo" o il fluente dialetto del Sichuan di Zhang Mazi.

I Giochi Nazionali si sono appena conclusi. Se siete stati a Guangzhou, ricorderete sicuramente l'accattivante slogan "Grande Bay Area vibrante, nuova Guangzhou affascinante". Abbiamo scattato una foto di qualcuno in piedi davanti alla Canton Tower e poi inserito un prompt nella funzione "Foto animate" di Doubao.

Il giovane nel video è rivolto verso la telecamera, mentre presenta la Canton Tower alle sue spalle. Dice in cantonese: "Vivace Greater Bay Area, affascinante nuova Guangzhou, ecco la Canton Tower alle mie spalle!"

Com'è questo livello di cucina cantonese? Rispetto al set di dim sum da quattro pezzi di Duolingo (ravioli di gamberi, involtini di riso, siu mai e costine di maiale con salsa di fagioli neri), non sembra un po' più gradevole?

Inoltre, Seedance 1.5 Pro ha il vantaggio della "coerenza audiovisiva", il che significa che è in grado di comprendere la storia che il video vuole raccontare in base al contenuto dell'immagine e di generare automaticamente la voce fuori campo corrispondente.

Ad esempio, quando carichiamo un'immagine che ritrae chiaramente uno straniero, senza inserire alcun prompt, verrà automaticamente utilizzata la lingua inglese per fornire la voce narrante e far dire al personaggio nell'immagine le battute appropriate.

Anche quando Will Smith mangiava noodles in un ristorante cinese, Seedance 1.5 Pro lo faceva parlare automaticamente in inglese e la sua postura mentre mangiava i noodles era assolutamente corretta.

Allo stesso modo, l'abbiamo usato per ricreare un video dietro le quinte generato dall'intelligenza artificiale. Abbiamo semplicemente caricato un'immagine su Doubao senza inserire alcun prompt, e il sistema ha generato automaticamente un video in cinese, completo di un dialogo del tipo: "Wow, ho una foto con un Avatar!"

Quando abbiamo rigenerato il video, Seedance 1.5 Pro ha anche identificato il ragazzo nella foto come coreano e ha generato un video in cui parlava coreano. A dire il vero, ha un po' l'aria di un coreano.

Un aspetto particolarmente positivo del generatore video Doubao è che possiamo scaricare direttamente il video generato come GIF animata e salvarlo sui nostri telefoni . Combinando le più potenti capacità di comprensione multimodale dei modelli attuali e la capacità di generare immagini più realistiche, le immagini statiche sui nostri telefoni possono essere trasformate in immagini in movimento "realisticamente" e poi pubblicate su WeChat Moments; alcune persone potrebbero non essere in grado di notare la differenza.

Foto giganti generate dall'intelligenza artificiale combinate con il movimento della telecamera del drone: davvero fantastico!

Narrativa è una parola chiave nell'aggiornamento Seedance 1.5 Pro. Ciò significa che questi video generati dall'intelligenza artificiale non sono solo generati, ma hanno anche un certo senso della storia e sono in grado di comprendere il contenuto da esprimere, rendendo i video generati dall'intelligenza artificiale più simili a opere in carne e ossa.

Una buona produzione video richiede un'eccellente illuminazione, colori ed effetti sonori. Anche il lavoro tecnico è essenziale: il movimento della telecamera, oltre agli elementi audio e video, è una parte indispensabile del linguaggio visivo.

In questo aggiornamento, Seedance 1.5 Pro ha apportato notevoli miglioramenti alle tecniche di ripresa cinematografica, come il tracking a inquadrature lunghe e lo zoom Hitchcock.

Come per l'effetto bullet time che abbiamo creato in precedenza, ora puoi caricare un'immagine su Doubao, modificare i prompt e anche l'effetto bullet time è liberamente personalizzabile.

▲Indizi: Effetto Bullet Time. Il tempo è completamente congelato. La ballerina è sospesa a mezz'aria, sfidando la gravità. [Fermo immagine]: La ballerina, i suoi capelli e il suo abito blu sono assolutamente immobili, come una statua 3D congelata nel tempo. La telecamera si muove su una traccia orizzontale attorno alla ballerina sospesa. Gli edifici sullo sfondo cambiano prospettiva (parallasse), mentre la ballerina rimane bloccata al centro. I capelli rimangono rigidi e puntano verso l'alto, senza svolazzare. Il tessuto dell'abito è solido e congelato. Illuminazione cinematografica, alta qualità.

Quando elaboriamo la stessa foto con Veo 3.1, il sistema fatica a mantenere il personaggio completamente immobile nella modalità bullet time che genera. Questo perché la maggior parte dei modelli di generazione video richiede il riconoscimento dei capelli per indicare il movimento e dell'orlo di una gonna per indicare l'ondeggiamento. Pertanto, il controllo preciso del movimento della telecamera e la programmazione sono funzionalità cruciali che differenziano i diversi modelli.

E poi c'è questa foto gigante scattata dall'intelligenza artificiale che è diventata virale un po' di tempo fa. Ora possiamo usare anche dei fantastici droni che si lanciano in picchiata e dei movimenti della telecamera per mettere in risalto il gigante nel video.

▲Parole chiave: Riprese cinematografiche con drone FPV, movimento della telecamera ultra-dinamico: partendo da una vista dall'alto ad alta quota, il drone si abbassa rapidamente verso un gigante seduto in mezzo a una strada cittadina, circondato da edifici in mattoni rossi. Il gigante rimane completamente immobile, con corpo, testa e arti immobili, congelati come una scultura. Il drone esegue manovre di volo acrobatiche attorno al corpo statico del gigante: gira intorno alle sue gambe, passa sotto le sue braccia, sale a spirale lungo il suo busto, quindi si allontana per mostrare il contrasto dimensionale tra il gigante e i piccoli veicoli (un autobus rosso a due piani, un taxi nero) e i pedoni. Composizione iperrealistica. Formato 16:9, durata 5 secondi, modello 1.5 Pro.

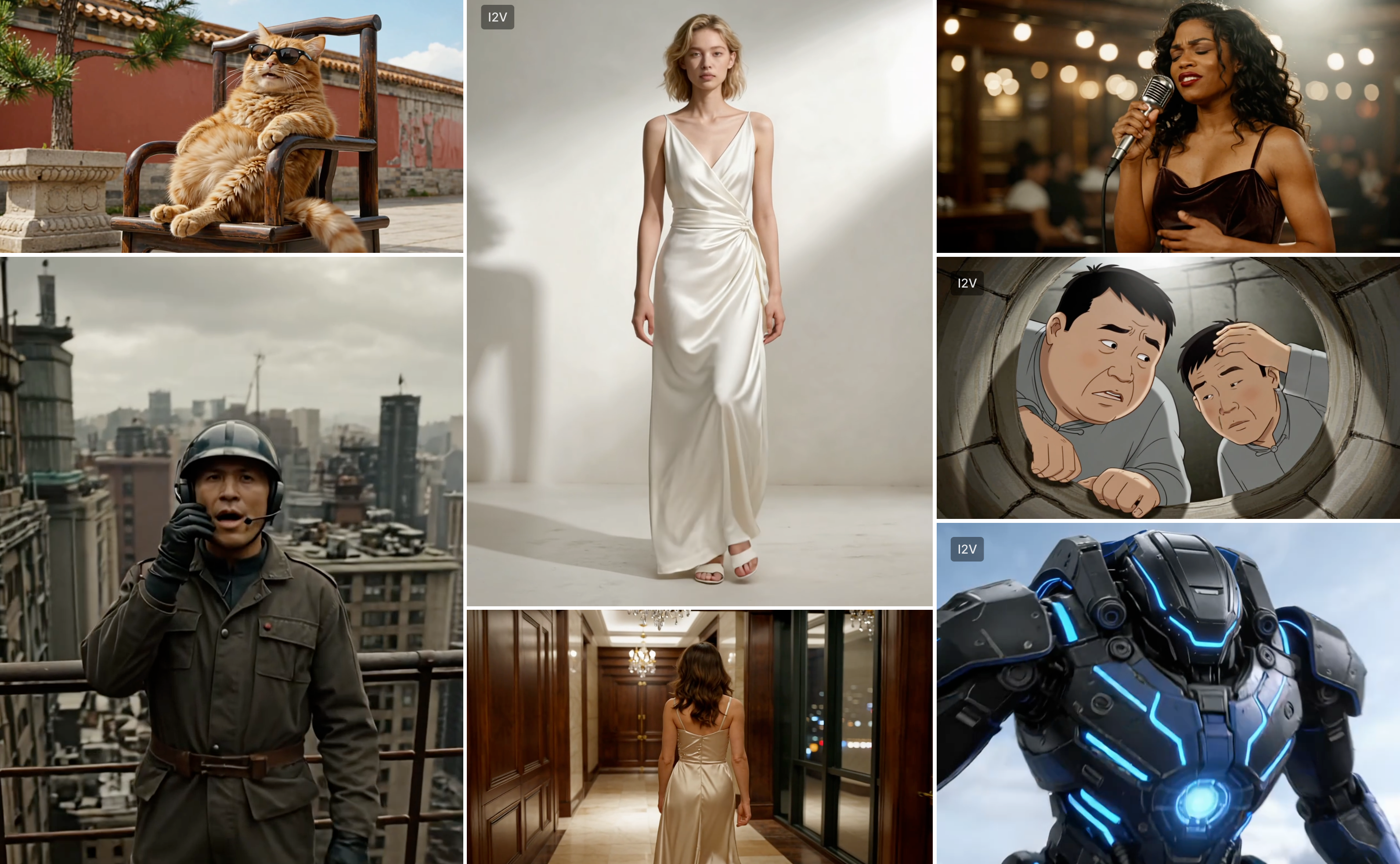

La conversione delle immagini di riferimento in video consente un migliore controllo sulla qualità dell'output. Tuttavia, le capacità di conversione da immagine a video di Seedance 1.5 Pro sono altrettanto impressionanti.

Secondo i risultati delle prestazioni del modello Seedance 1.5 Pro pubblicati da ByteDance nel test di benchmark interno SeedVideoBench-1.5, Seedance 1.5 Pro presenta alcuni vantaggi rispetto a modelli come Keling 2.6 e Google Veo 3.1, sia che si tratti di conversione da testo a video T2V o da primo fotogramma a video I2V.

Soprattutto nella generazione audio e nella sincronizzazione audio-visiva, Seedance 1.5 Pro è quasi nettamente superiore.

Abbiamo provato a far recitare insieme uno sketch di 10 secondi a Judy di Zootropolis e a Nezha, una parlando in mandarino e l'altra in dialetto del Sichuan.

▲ Parole suggerite: [0s-4s] Judy indica Nezha e dice (mandarino, veloce, serio): "Ehi ragazzo! Fermati! Mani dietro la testa! Secondo il codice della strada di Zootropolis, stavi andando a tutta velocità sulle tue Wind Fire Wheels!" • [5s-10s] Nezha (dialetto del Sichuan, occhi al cielo, lento, prolungato): "Ehi, non toccarmi! Stavo andando sulle mie Wind Fire Wheels, non ho bruciato il tuo carburante. Monello, fatti gli affari tuoi!"

Lo stile e il contenuto di questo video sono molto simili allo stile dei cartoni animati che guardiamo di solito. Quando la severa e risoluta agente Judy Hopps cattura Nezha, la sua espressione seria e il suo tono, e persino le battute di Nezha in dialetto del Sichuan, si sposano perfettamente con i movimenti delle labbra.

Quest'anno, APPSO ha testato più di dieci modelli di generazione video basati sull'intelligenza artificiale. Utilizzandoli, abbiamo scoperto che molti dei casi di test precedenti sono ormai obsoleti.

All'inizio, anche se Lu Xun fosse venuto, dovevamo fargli dire qualche parola in inglese; eravamo grati se riuscivamo a generare un video fluido di 5 secondi. Ora, il modello non solo supporta più lingue come cinese, inglese, giapponese e coreano, ma può anche generare simultaneamente dialetti distintivi come il cantonese e il sichuanese.

Improvvisamente, l'evoluzione dei video basati sull'intelligenza artificiale è passata da una misurazione in anni a una in mesi. La svolta di ieri è un voto di sufficienza per oggi.

▲ Screenshot del caso di studio Seedance 1.5 Pro | Fonte: sito web ufficiale di ByteDance Seed

Questo aggiornamento Seedance 1.5 Pro potrebbe rivelarsi il nuovo voto di sufficienza. Ma almeno ora vediamo video più coinvolgenti con audio e video sincronizzati; il supporto per più lingue e dialetti rende i video AI più "realistici"; e le riprese cinematografiche professionali e le capacità di comprensione intelligente consentono all'IA di generare anche scene altamente complesse.

Quando la tecnologia riuscirà a comprendere la storia dietro un'immagine e ad associare automaticamente il linguaggio e le emozioni appropriate, saremo un passo più vicini a un'era di immaginazione e libertà creativa.

Cosa serve per rendere tutto questo possibile? Un'immagine o un suggerimento.

Apri l'app Doubao, carica/inserisci, genera: è semplicissimo. Ogni foto racconta una storia che aspetta di essere raccontata e ogni caricamento segna l'inizio della creazione.

Minore è il numero di passaggi, minore sarà la barriera all'ingresso e più creatori ci saranno: ecco come i video basati sull'intelligenza artificiale dovrebbero essere utilizzati per realizzare idee creative.

Il video nell'articolo può essere visualizzato cliccando su questo link: https://mp.weixin.qq.com/s/em_E90Q7AdydHsNwVkAMTQ

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.