La modalità per adulti di ChatGPT sta arrivando, ma da adulto non sono affatto contento

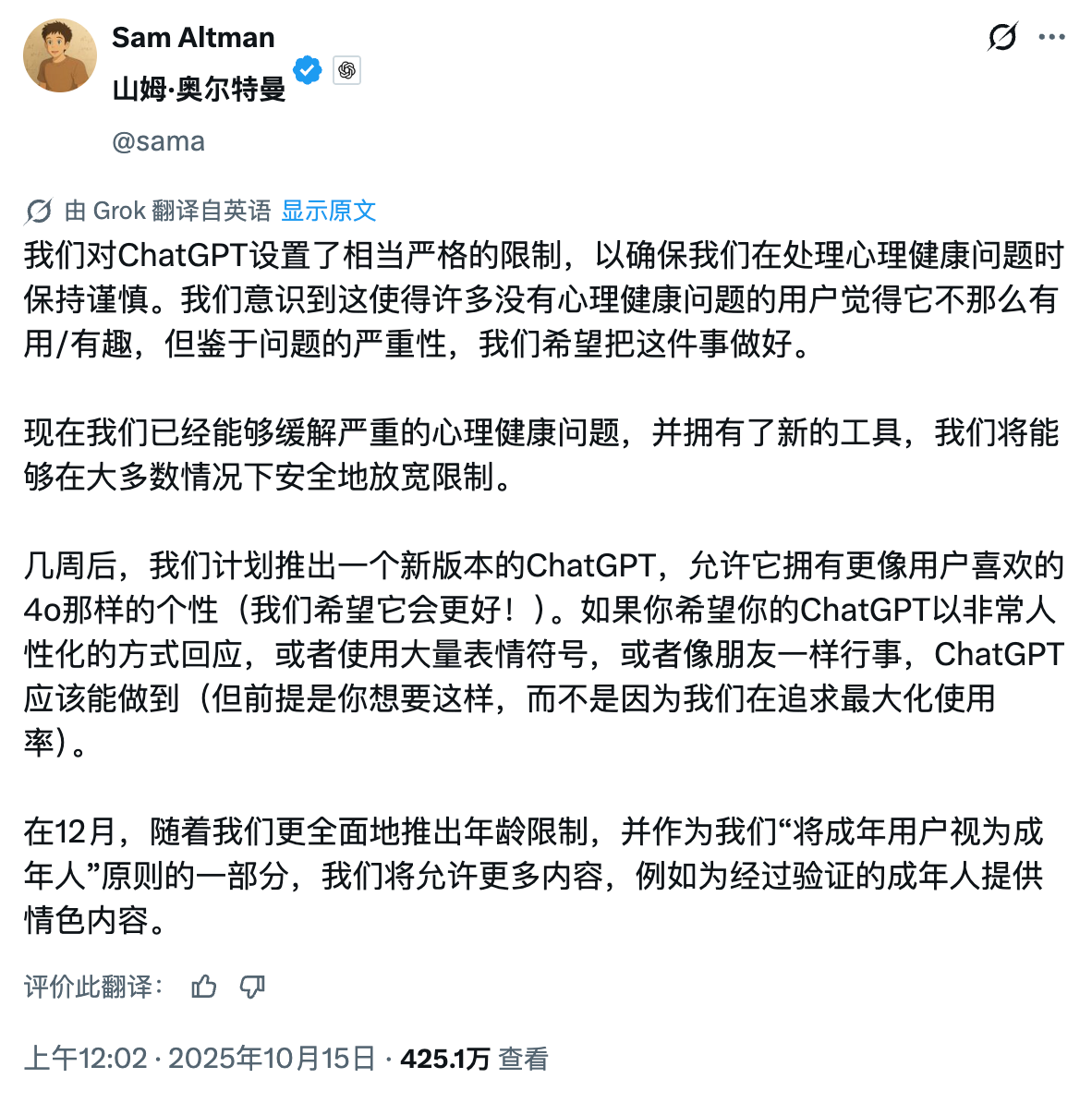

Questa mattina presto, il CEO di OpenAI Sam Altman ha annunciato che ChatGPT lancerà una "modalità per adulti" a dicembre.

Altman ha fornito una lunga spiegazione, la cui essenza era che ChatGPT inizialmente aveva imposto così tante restrizioni principalmente per motivi di salute mentale e per timore di incidenti, il che ha portato gli utenti comuni a ritenere l'esperienza poco interessante e poco appagante.

Ora che OpenAI afferma di aver sviluppato nuovi strumenti di sicurezza in grado di mitigare i principali rischi legati alla salute mentale, è pronta a scatenare la sua potenza. A dicembre, gli utenti adulti verificati potranno sbloccare più contenuti, inclusi quelli erotici.

Sì, è proprio quello che pensi.

In breve, OpenAI sostiene che sia giunto il momento di trattare gli adulti come adulti. Tuttavia, da adulto, non ne sono affatto contento.

Inoltre, secondo Altman, OpenAI lancerà nelle prossime settimane una nuova versione di ChatGPT più umana, simile alla sensazione di 4o che piaceva a tutti prima.

Vuoi che ti risponda con un po' più di calore? Nessun problema. Vuoi che ti mandi un sacco di emoji? E vuoi che chatti con te come un amico? È tutto tuo.

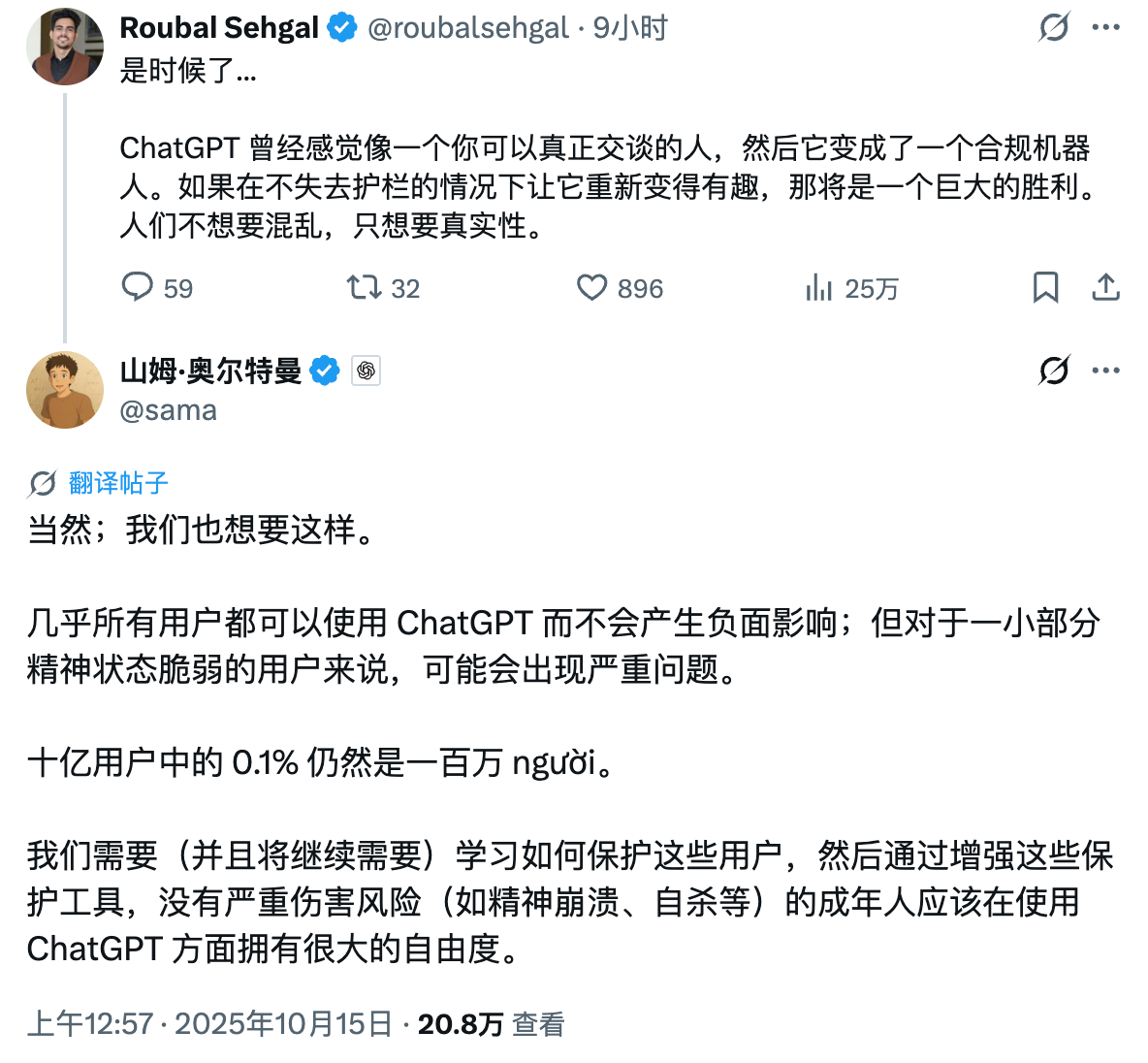

In una sessione di domande e risposte con gli internauti, Ultraman ha anche fornito maggiori dettagli.

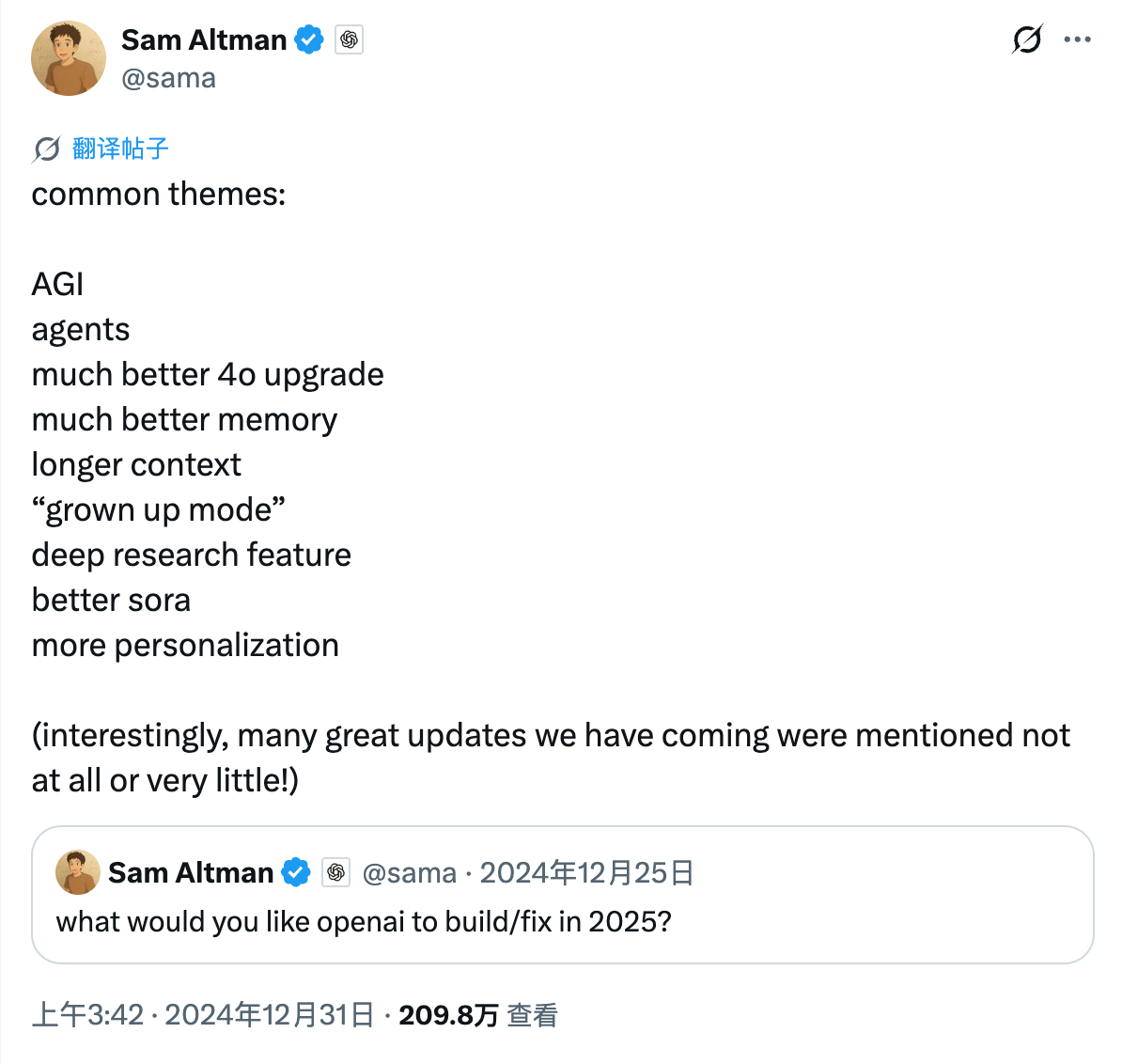

In effetti, i segnali di ChatGPT erano già noti da tempo.

Verso la fine dell'anno scorso, Ultraman ha rivelato l'intenzione di supportare una modalità per adulti. Quando i netizen hanno suggerito di rimuovere la maggior parte delle barriere di sicurezza del modello, Ultraman ha risposto: "Una sorta di 'modalità per adulti' è assolutamente necessaria".

Nella votazione per le nuove funzionalità che OpenAI aveva sollecitato dagli utenti all'epoca, questo problema era in cima alla lista ed era stato incluso nel piano di prodotto del 2025 insieme ad AGI, Agent e alla versione aggiornata di GPT-4 , il che dimostra quanta attenzione ha ricevuto.

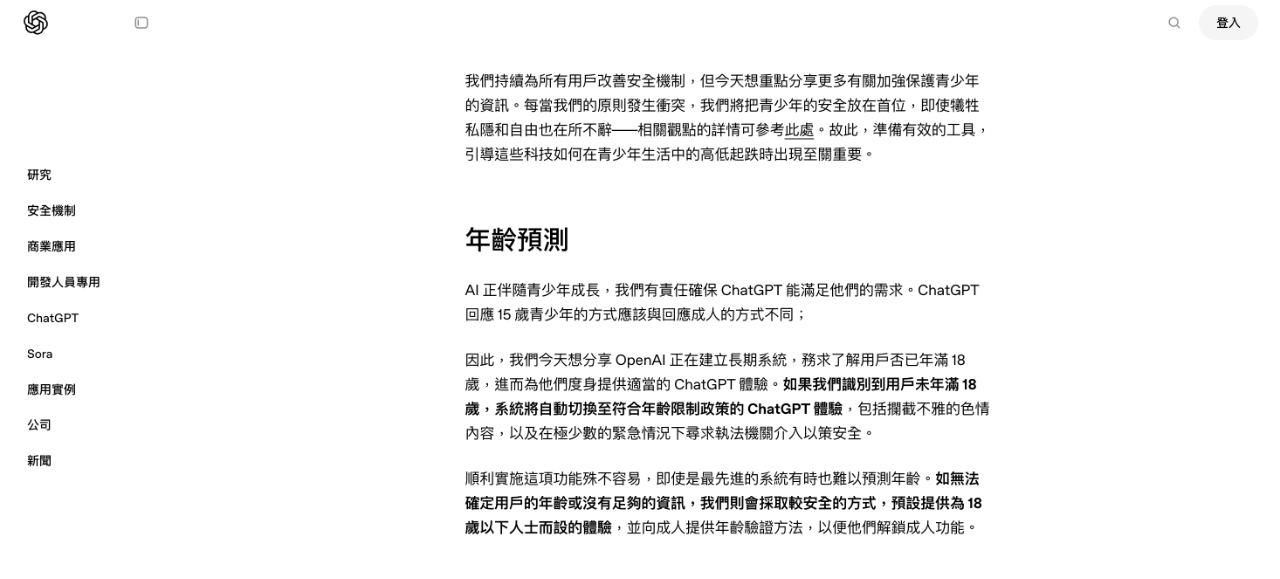

Secondo il blog ufficiale di OpenAI, l'attuale funzione di verifica dell'età può identificare automaticamente gli utenti minorenni e passare alla modalità di sicurezza per i minori per bloccare contenuti sessuali espliciti; se non è possibile determinare l'età, si presume che si tratti di un minore e le funzioni per adulti possono essere sbloccate solo dopo aver fornito una prova dell'età.

Sembra abbastanza esaustivo, vero? Ma uno sguardo più attento rivela che le cose non sono così semplici.

Sembra abbastanza esaustivo, vero? Ma uno sguardo più attento rivela che le cose non sono così semplici.

Anche se OpenAI adottasse in futuro la verifica dell'identità o dei pagamenti, continuerebbero a emergere metodi di elusione. L'uso dei documenti d'identità dei genitori da parte dei minori per la verifica o la registrazione di account da parte di adulti per loro conto sono già pratiche comuni nei prodotti internet.

Ancora più importante, OpenAI afferma di aver sviluppato nuovi strumenti per rilevare gli stati mentali degli utenti, ma l'intelligenza artificiale può davvero giudicare con precisione la salute mentale di una persona?

Sapete, negli ultimi anni si sono verificati frequentemente incidenti tragici che hanno coinvolto ChatGPT, e se la "valvola di sicurezza" rivendicata da OpenAI possa davvero svolgere il ruolo di dovuta protezione è ancora discutibile.

Onestamente, OpenAI non è nemmeno il primo prodotto di intelligenza artificiale influente ad annunciare il supporto per una "modalità per adulti" e, in una certa misura, è considerato conservatore. Il chatbot di intelligenza artificiale di Elon Musk, Grok , è quello davvero disinibito.

A luglio di quest'anno, Musk ha aggiunto a Grok la funzione di personaggio virtuale di accompagnamento in 3D.

Gli utenti che si abbonano a "SuperGrok" (con una quota mensile di 30 $) possono attivare due compagni 3D: uno è una ragazza bionda con due code in stile anime "Ani" e l'altro è un panda rosso dei cartoni animati "Bad Rudy".

Ani, un sofisticato personaggio 2D, ricorda il personaggio anime Misa Amane . Ani supporta l'interazione multimodale tramite testo, voce e telecamera e può rispondere alle conversazioni con una varietà di espressioni e movimenti, persino ballando a comando.

Inoltre, Ani ha anche un meccanismo di preferenza integrato e una modalità memoria. Gli utenti possono migliorare la propria preferenza virtuale interagendo con essa e, raggiungendo un certo livello, si può sbloccare la modalità NSFW (per adulti).

All'epoca, un utente della rete commentò: "È semplicemente un Galgame (gioco d'amore) di alto livello". Ciò portò Ani a generare una grande quantità di contenuti creati spontaneamente nel giro di un giorno dal suo lancio, diventando rapidamente popolare sui social media.

Tuttavia, che si tratti di Grok o ChatGPT, queste funzioni sono apparentemente sotto l'egida del "rispetto della libertà degli utenti adulti", ma il problema è che una volta che c'è una scappatoia nel meccanismo di verifica dell'età, l'apertura di contenuti per adulti in realtà abbassa la soglia per l'accesso dei minori a contenuti inappropriati.

Se i cosiddetti diritti degli adulti sono in realtà una scommessa sulla salute mentale e sull'ambiente di crescita dei minori, e una scommessa sul fatto che gli adolescenti non approfitteranno di scappatoie, allora restrizioni più severe potrebbero essere più sicure.

Per dirla senza mezzi termini, la logica aziendale di queste funzioni è ancora quella di competere per il traffico degli utenti e aumentare i tassi di conversione dei pagamenti.

Per dirla senza mezzi termini, l'appeal dei prodotti basati sull'intelligenza artificiale in genere non è elevato.

La maggior parte degli utenti si attiene al principio di usare ciò che funziona meglio, e il numero di utenti professionisti (nella ricerca scientifica, nella programmazione, ecc.) disposti a pagare è limitato, quindi cosa dovrebbero fare? Scelgono di usare metodi più orientati all'uomo per tenerti impegnato (o diventarne dipendenti).

Si tende a parlare di "desiderio". L'apertura di funzionalità per adulti può, da un lato, attrarre un gran numero di nuovi utenti a provarle, soddisfacendo le esigenze di coloro che sono stati esclusi; dall'altro, aumenterà significativamente la loro disponibilità a pagare.

Contenuti pornografici e bizzarri sono sempre stati un catalizzatore per il traffico internet. L'apertura di funzionalità per adulti può, da un lato, attrarre un gran numero di nuovi utenti, soddisfacendo le esigenze di coloro che sono stati esclusi; dall'altro, può aumentare significativamente la loro disponibilità a pagare.

Ciò che va oltre è in realtà la grande torta della compagnia emotiva.

Attualmente, gli utenti principali dei prodotti di accompagnamento basati sull'intelligenza artificiale sono per lo più giovani utenti della rete e specifiche fasce demografiche (come gli appassionati di anime e manga e coloro che soffrono di ansia sociale), ma questo segmento è in espansione. I giovani sono i più ricettivi ai dispositivi di accompagnamento digitali e molti hanno adottato l'intelligenza artificiale come parte integrante della loro vita digitale quotidiana, utilizzandola non solo per la ricerca e le domande e risposte, ma anche per la condivisione di contenuti emozionali.

La società di investimenti ARK Invest prevede addirittura che le dimensioni del mercato globale di "intelligenza artificiale + compagnia emotiva" saliranno da 30 milioni di dollari all'anno a 70 miliardi di dollari e fino a 150 miliardi di dollari, con un tasso di crescita medio annuo superiore al 200%.

Il problema è che la ricerca psicologica ha da tempo confermato che gli esseri umani tendono a sviluppare attaccamento verso coloro con cui provano empatia, anche quando sanno che si tratta di programmi. Questo significa anche che l'intelligenza artificiale rischia di essere manipolata dalle emozioni.

Attualmente, le autorità di regolamentazione di vari Paesi stanno prendendo provvedimenti.

Il disegno di legge dell'UE sull'intelligenza artificiale afferma che bisogna impedire che l'intelligenza artificiale ad alto rischio sia dannosa per i bambini; anche le "Misure per la gestione dei servizi di intelligenza artificiale generativa" della Cina sottolineano che la fornitura di servizi dovrebbe essere conforme alla legge sulla tutela dei minori, ecc.

OpenAI ha recentemente lanciato una "modalità adolescente": i genitori possono collegare i propri account a quelli dei figli maggiori di 13 anni via email e persino impostare un coprifuoco. Se il sistema rileva un grave disagio emotivo in un adolescente, invierà un promemoria al genitore.

Forse tra dieci anni avere un compagno AI sarà una cosa comune quanto avere un animale domestico oggi.

Ma una generazione cresciuta con le "relazioni perfette" dell'IA può ancora comprendere le vere relazioni umane? Quando sei abituato a un'IA che non ti rifiuta mai, ti capisce sempre e fa sempre come vuoi, hai ancora il coraggio di affrontare una persona reale che potrebbe discutere con te, deluderti e pretendere il tuo contributo?

Comportarsi come un amico è forse la menzogna più allettante e mortale. Impara le tue abitudini linguistiche, si adatta ai tuoi valori, soddisfa i tuoi desideri e poi confeziona tutto questo come se ti capisse e te lo riflette.

Questo è il momento migliore, perché nessuno è più solo. Questo è il momento peggiore, perché tutti sono soli. ChatGPT a dicembre potrebbe essere solo l'inizio.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.