L’intero ecosistema di Adobe è ormai pieno di intelligenza artificiale.

Negli ultimi anni, l'intelligenza artificiale ha avuto un impatto su tutti gli aspetti del software di utilità e persino nel campo creativo, che in origine era considerato "basato esclusivamente sulla capacità intellettuale", sono emerse sempre più influenze dell'intelligenza artificiale.

Tra questi, Adobe e il suo modello Firefly hanno avuto l'influenza più diffusa e profonda.

Figura|Adobe for Business

Alla conferenza creativa Adobe Max 2025, conclusasi di recente, il colosso mondiale degli strumenti creativi ha presentato, come previsto, una serie di aggiornamenti di prodotto.

Oltre agli aggiornamenti di Creative Cloud e Firefly AI, è incluso un nuovissimo strumento di generazione audio, in grado di generare voice-over completamente indipendenti per i video e supporta la modifica delle tracce audio.

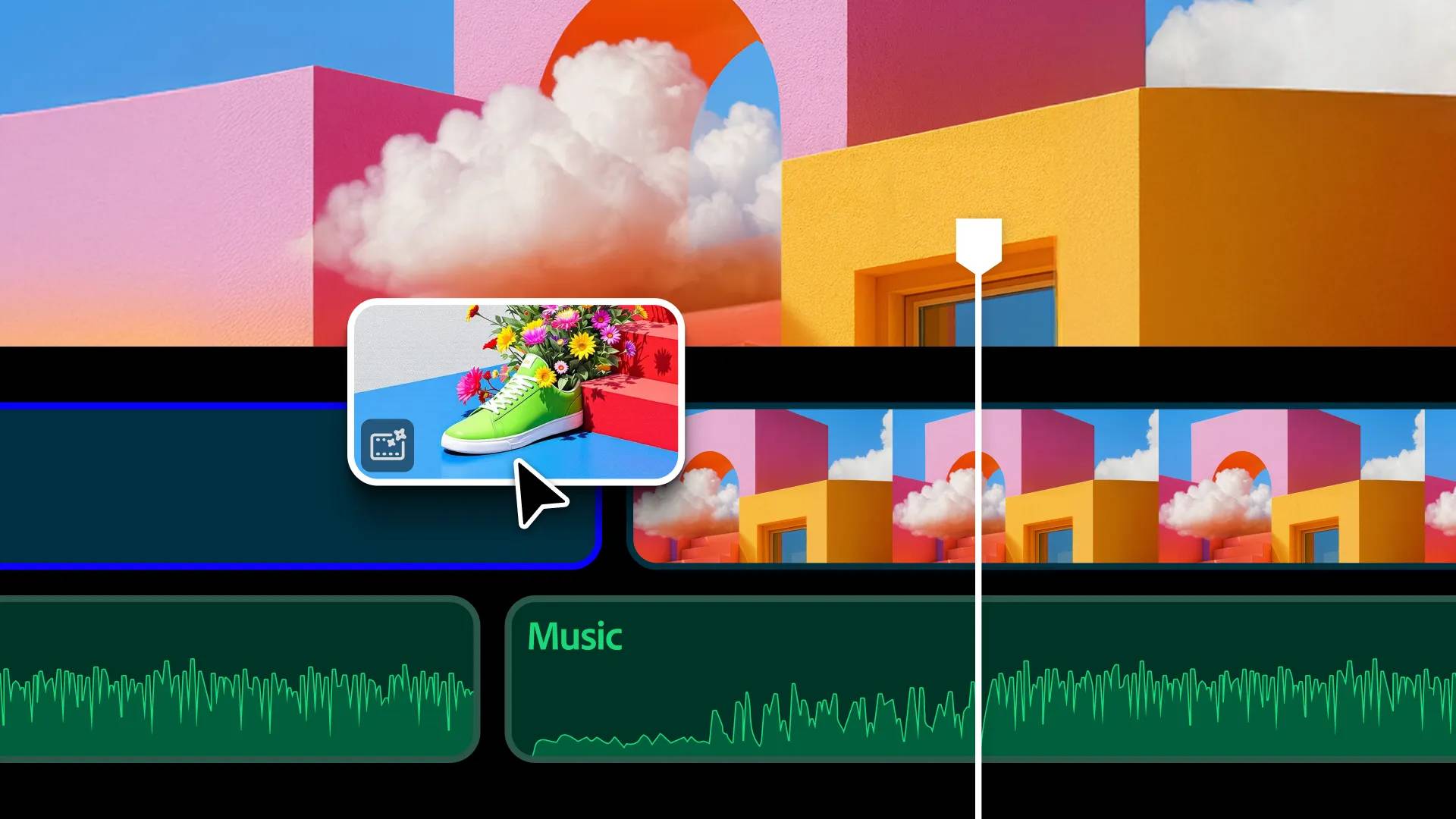

Immagine|Adobe

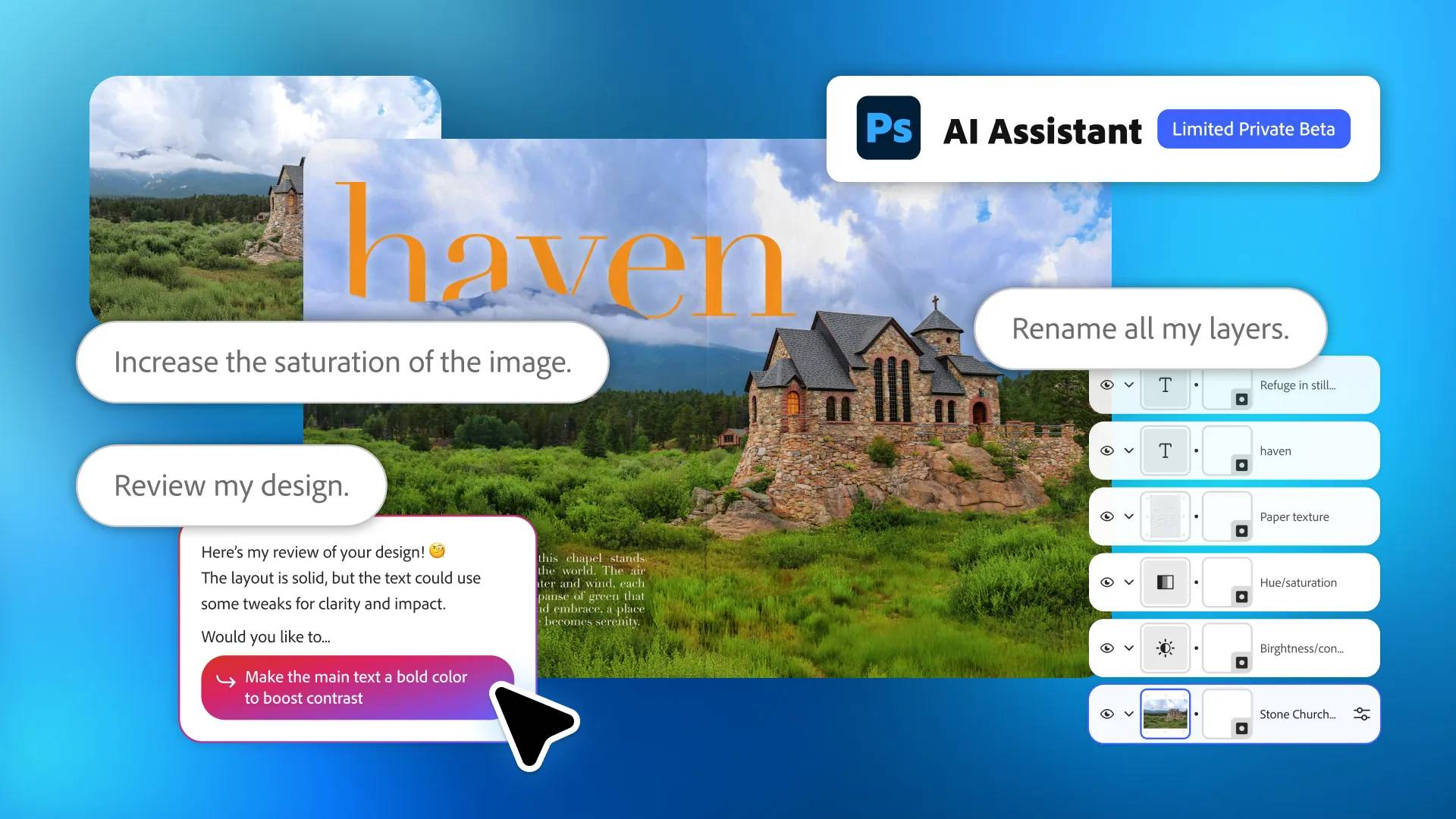

Inoltre, le versioni web di Adobe Express e Photoshop hanno anche ottenuto punti di accesso dedicati all'assistente AI, consentendo agli utenti di aprire finestre di dialogo e utilizzare il linguaggio naturale per istruire l'IA a modificare i contenuti.

Secondo Adobe, il loro obiettivo finale è integrare l'intelligenza artificiale in tutte le applicazioni di progettazione e renderla parte degli strumenti creativi.

Più scelte aperte

Innanzitutto, in quanto modello fondante di Adobe, Firefly stesso ha ricevuto un piccolo aggiornamento.

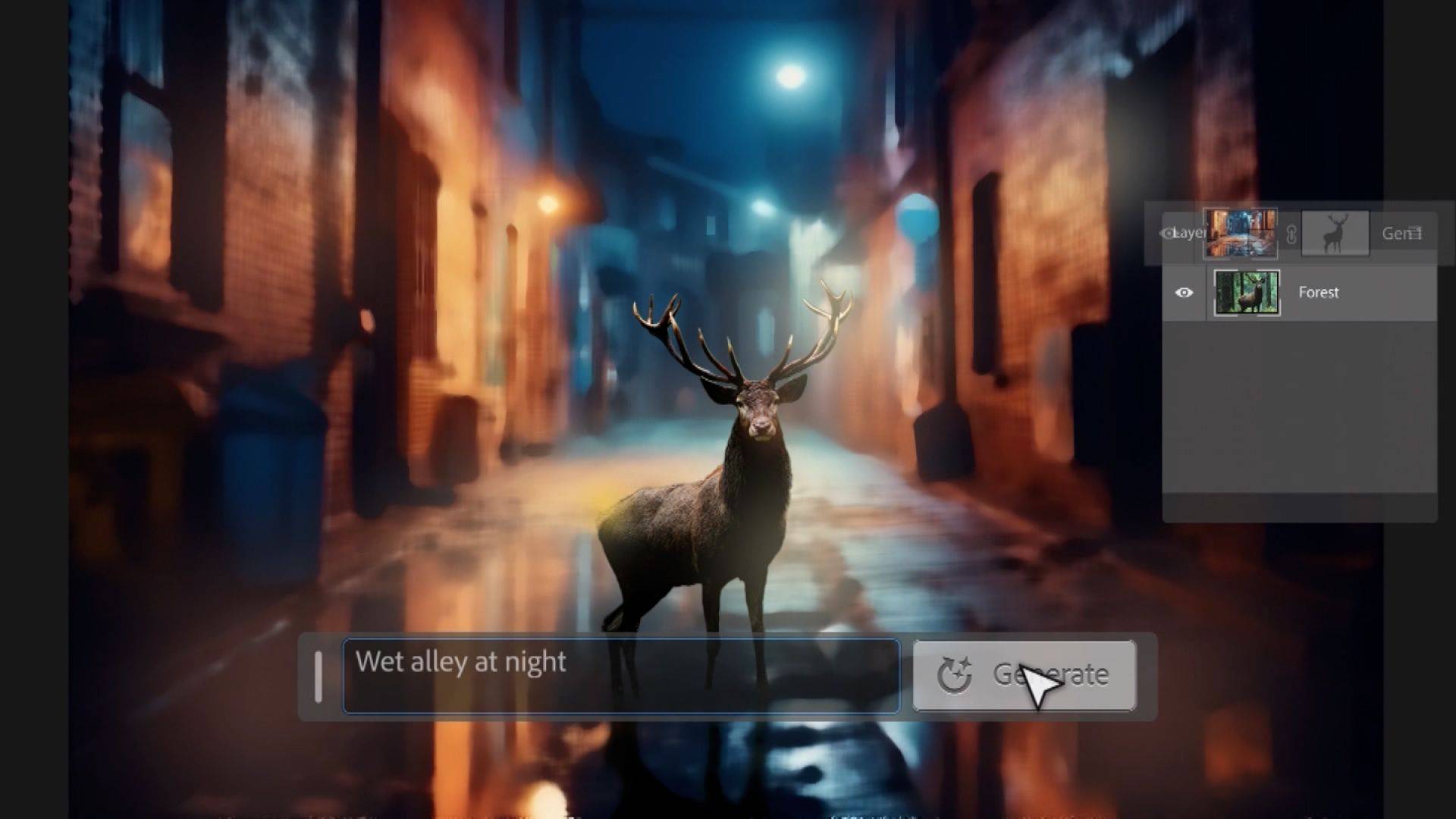

Nell'ultimo modello di immagine, Firefly Image 5, il modello supporta la generazione di risoluzioni raw fino a 4 megapixel , un miglioramento significativo rispetto alla risoluzione di 1 megapixel di Firefly Image 4 dell'anno scorso.

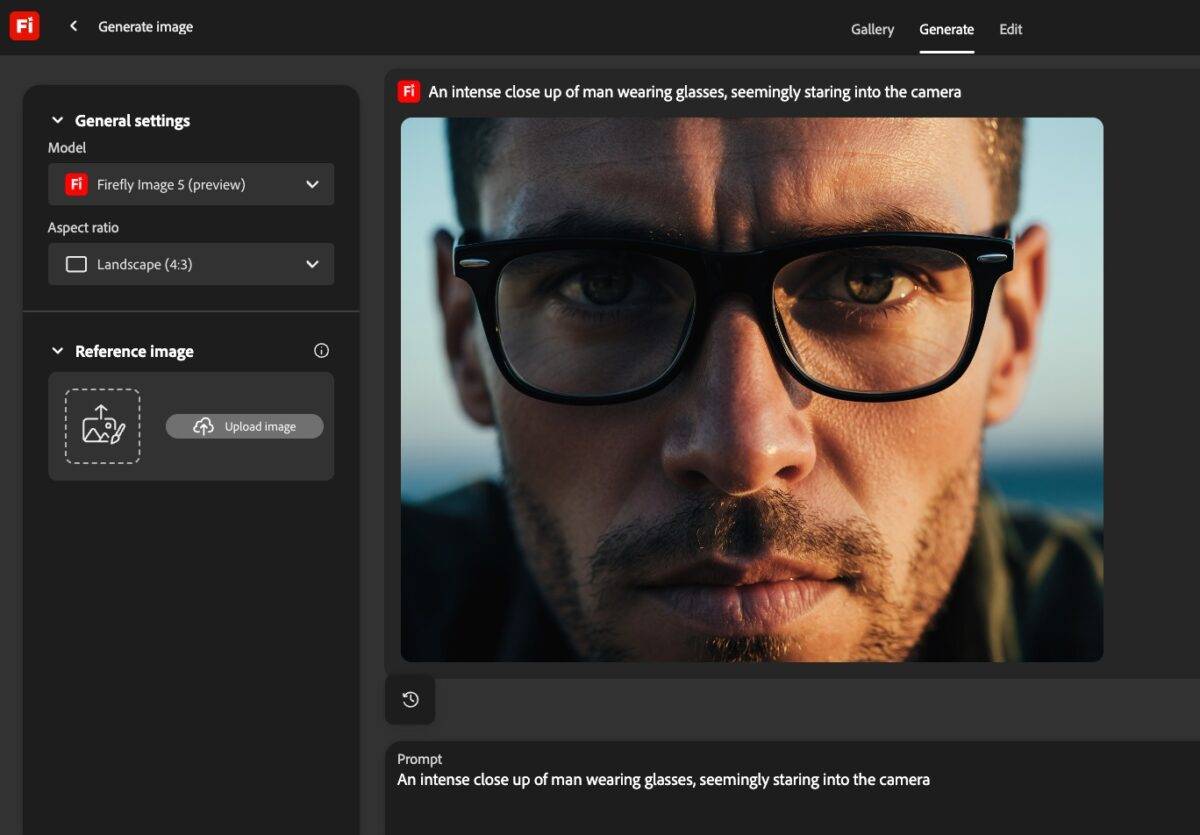

Immagine|Adobe

Ciò significa anche che Firefly Image 5, se abbinato a strumenti di upscaling o altri strumenti di upsampling, può già generare immagini 2K e 4K di qualità abbastanza buona, e l'usabilità delle immagini risultanti può essere ulteriormente migliorata.

Inoltre, Adobe ha menzionato specificamente che Firefly Image 5 è stato sottoposto quest'anno a speciali ottimizzazioni per la generazione di ritratti, mantenendo l'attenzione sul "realismo"—

In parole povere, non solo garantisce che "non si contino male le dita", ma fornisce anche al ritratto generato "luci e ombre naturali che si adattano all'ambiente":

Nel frattempo, i tre principali prodotti Adobe utilizzati più spesso (Photoshop, Lightroom e Premiere) hanno ricevuto ciascuno una serie di ottimizzazioni.

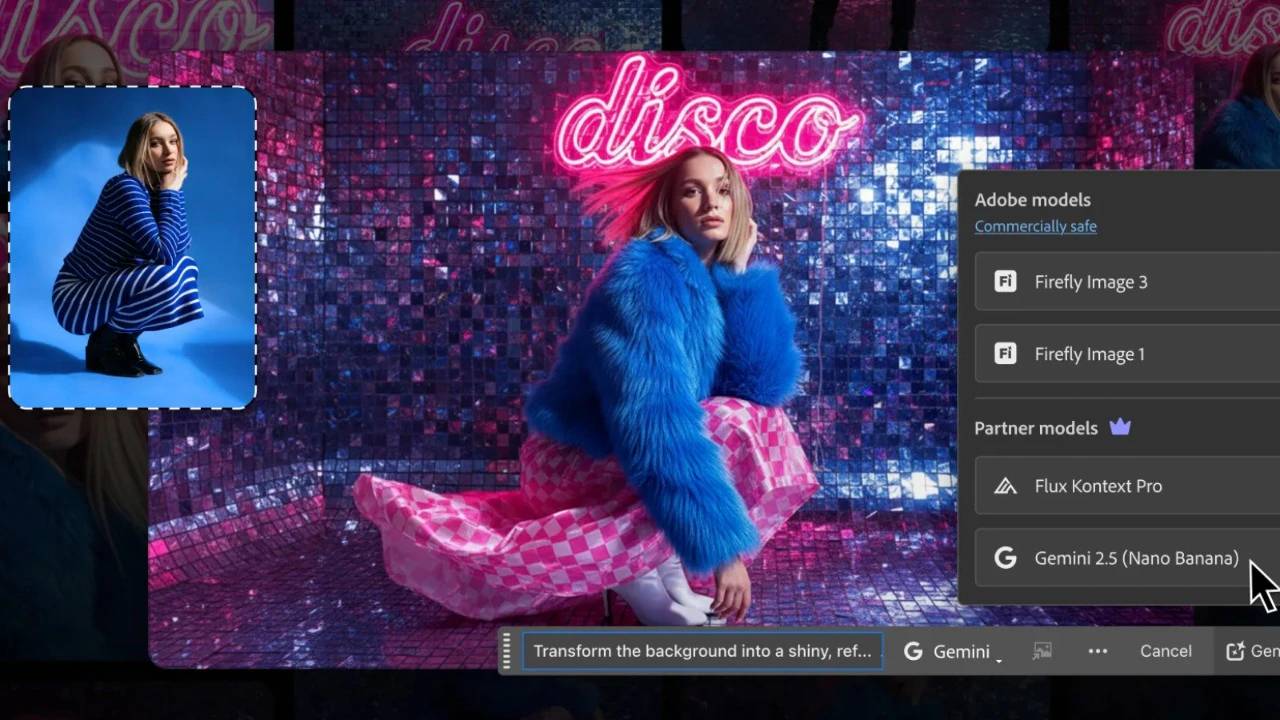

Oltre al supporto precedentemente menzionato per un assistente AI che può essere comandato tramite linguaggio naturale (attualmente in versione beta), Adobe ha anche fornito il supporto di modelli di terze parti per la sua funzionalità di punta Generative Fill nell'applicazione principale, dimostrando un approccio molto strategico.

Sì, hai letto bene.

Ora, quando si utilizza Photoshop per i riempimenti generativi, oltre a Firefly, è possibile scegliere anche tra Gemini 2.5 Flash (Nano Banana) e FLUX Knotext di Black Forest Labs, in linea con la precedente versione Beta di Photoshop.

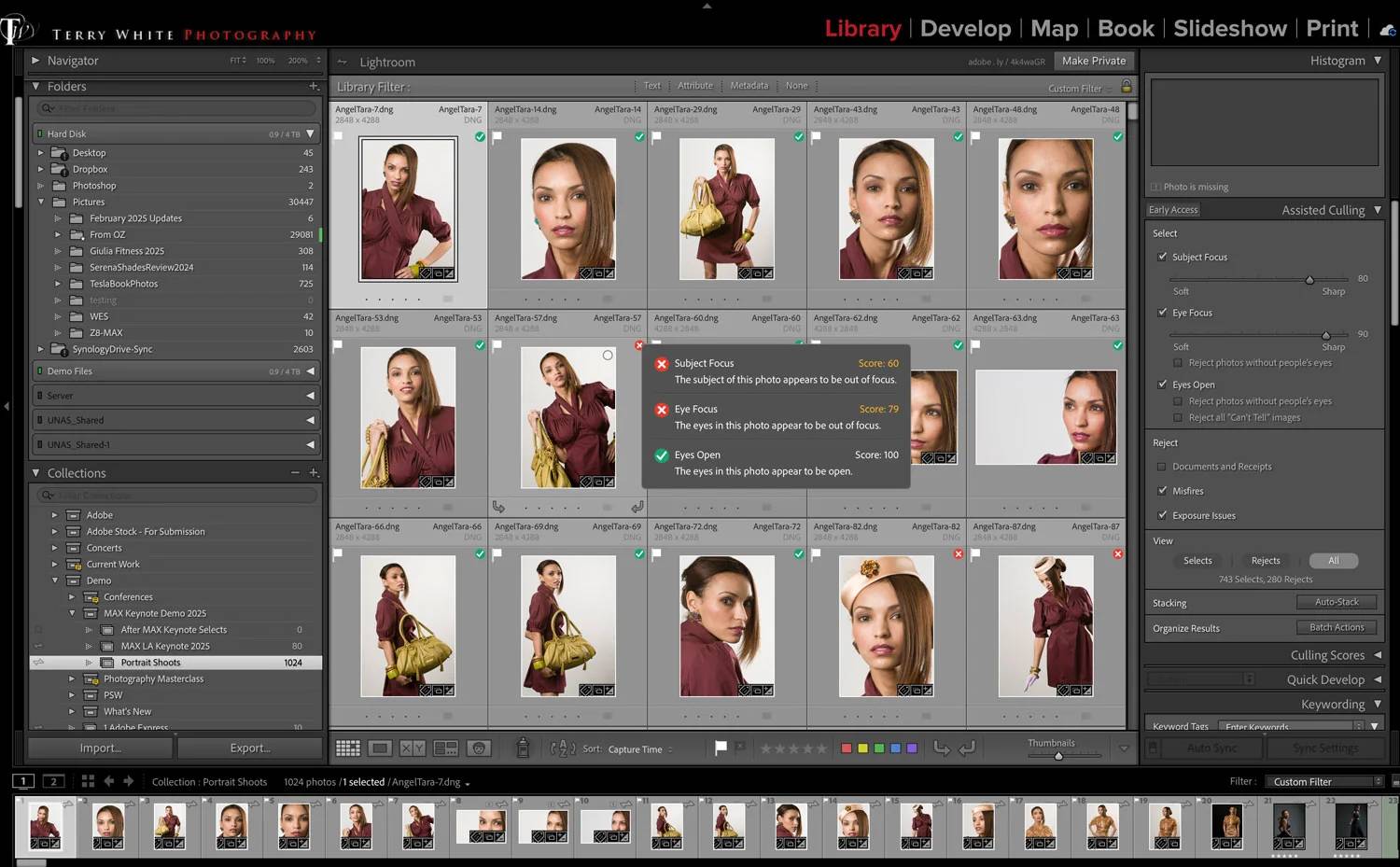

Gli aggiornamenti di LR e PR risolvono alcuni problemi minori e sono attualmente in fase di test; la data di rilascio deve ancora essere determinata.

Ad esempio, nell'ultima versione Beta di LR, Adobe offre una funzionalità di "Assisted Culling" che utilizza l'intelligenza artificiale per identificare in modo intelligente la qualità di grandi quantità di filmati. Può selezionare automaticamente i filmati in base a diversi indicatori, come messa a fuoco e nitidezza, il che è molto utile per progetti con una grande quantità di filmati ripetitivi (come la fotografia di mostre).

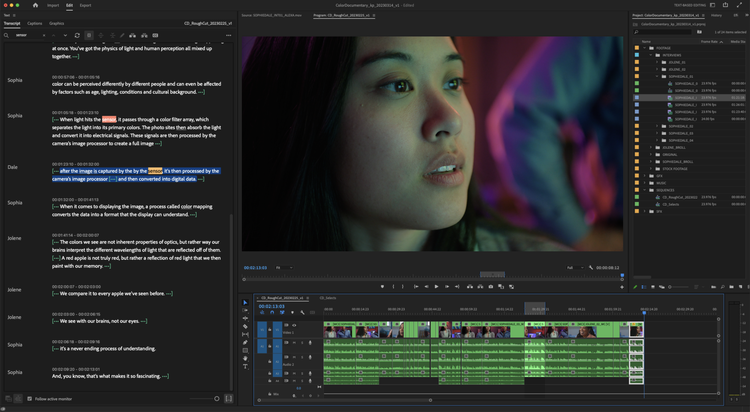

La versione Beta di PR introduce la funzionalità di separazione automatica di primo piano e sfondo che tutti conosciamo sui telefoni cellulari. Adobe la chiama AI Object Mask e viene utilizzata per separare automaticamente persone e sfondi nei video, liberando parte del lavoro manuale di post-produzione.

Intelligenza artificiale per i video

Dopo che Sora2 è diventato un successo immediato, dominando le pagine delle app per video brevi nell'ultimo mese con i suoi vari video a tema eccentrici e insoliti, Adobe ha lanciato anche il suo strumento di intelligenza artificiale per i video.

Tuttavia, rispetto all'approccio "tutto in uno" di Sora 2, le funzionalità video di questo aggiornamento di Adobe Firefly sono ancora più incentrate su strumenti di base, concentrandosi su due aspetti: audio AI e montaggio grezzo AI.

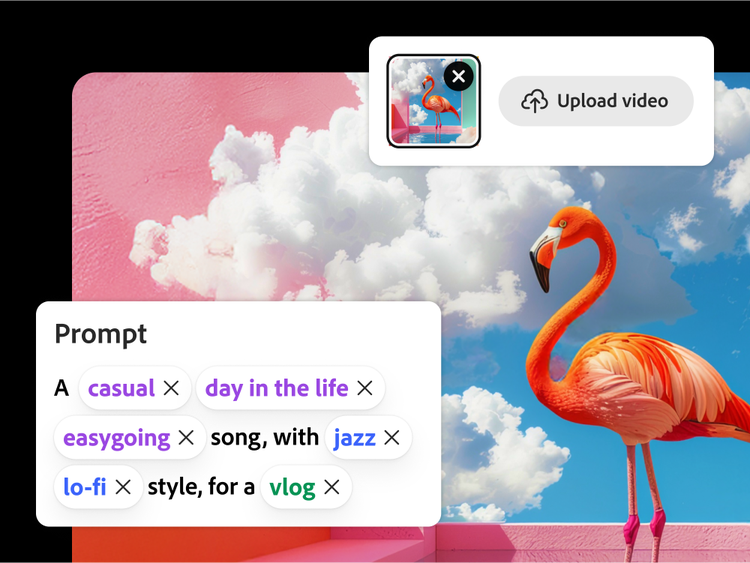

Innanzitutto, la funzionalità "Genera colonna sonora" nella toolbox di Adobe Firefly è entrata nella fase beta pubblica. Oltre ad analizzare materiali esistenti per generare musica di sottofondo con stili simili, gli utenti possono anche controllare l'atmosfera della musica generata aggiungendo manualmente dei prompt.

Immagine|Adobe

Tuttavia, il vero punto di forza di questa funzionalità risiede nella sua caratteristica di "sicurezza commerciale". Tutto il materiale utilizzato per generare tracce audio da Firefly proviene da musica con licenza e gli utenti possono utilizzare direttamente la musica generata da Firefly per scopi commerciali .

In questo modo, anche se la qualità della musica generata da Firefly può essere limitata, è sicuramente più allettante per gli utenti aziendali rispetto al pagamento di multe.

Oltre a generare musica di sottofondo, Firefly ha anche lanciato una versione beta pubblica della sua funzionalità Generate Speech, che ha un formato simile ai modelli di sintesi vocale disponibili in commercio e supporta più di 50 stili e più di 20 lingue di Adobe ed ElevenLabs.

Inoltre, all'Adobe Max di quest'anno è stato annunciato che Firefly Video Editor, un editor video basato sul Web e basato sul modello Firefly, entrerà nella fase di beta testing chiusa.

Oltre alle funzionalità di Firefly AI sopra menzionate, questo strumento basato sul web supporta anche alcune funzioni di editing leggere e filmati multitraccia. Potete considerarlo una versione web di CapCut. L'inizio del beta test è previsto per novembre.

Le ambizioni di Adobe

In sintesi, alla conferenza Adobe Max di quest'anno, oltre a potenziare il coinvolgimento dell'intelligenza artificiale nei suoi strumenti tradizionali (PS, PR, LR, ecc.) e ad aggiungere più funzionalità al modello Firefly, Adobe ha anche rivelato la sua visione di "strumenti creativi + intelligenza artificiale".

Figura|Adobe for Business

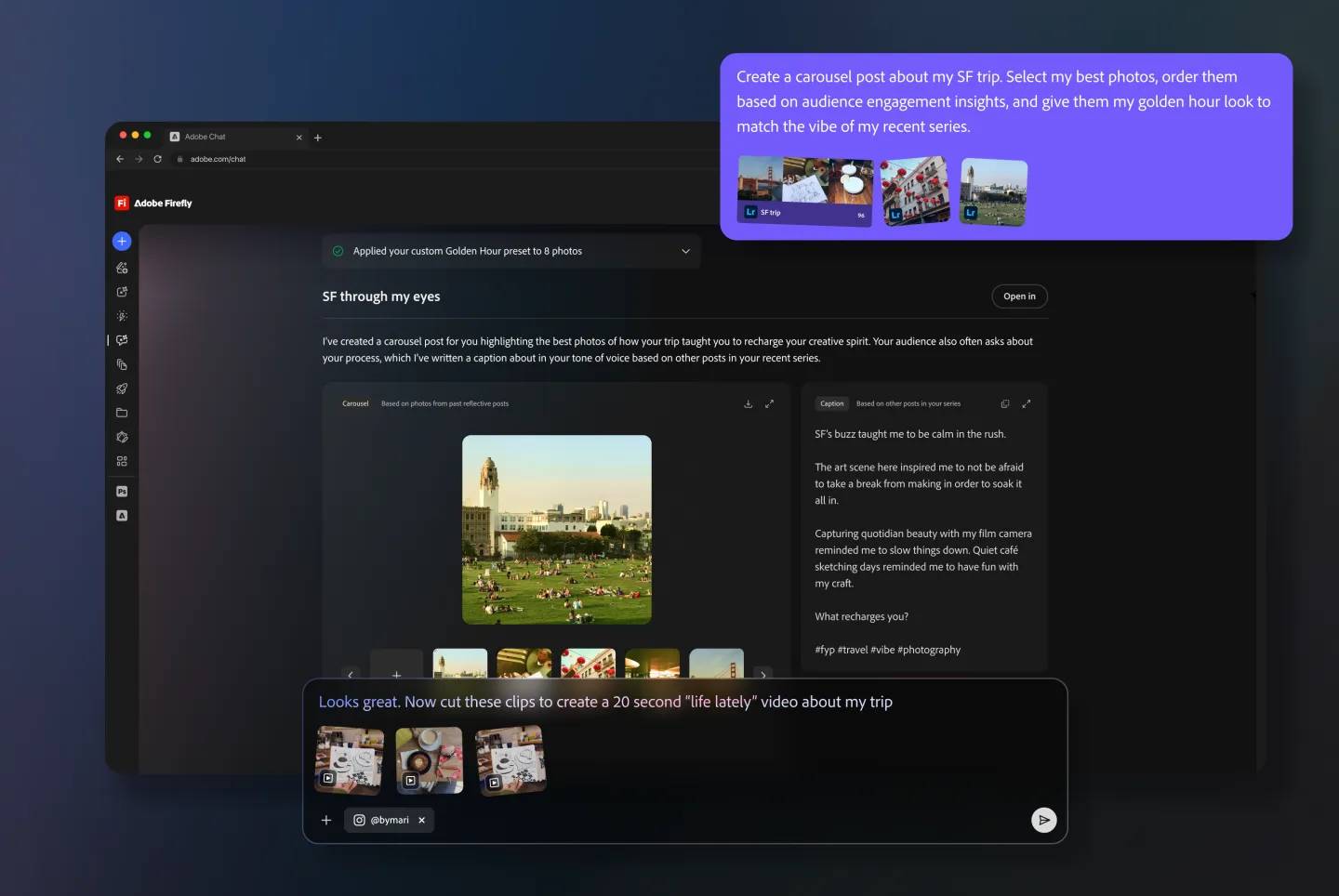

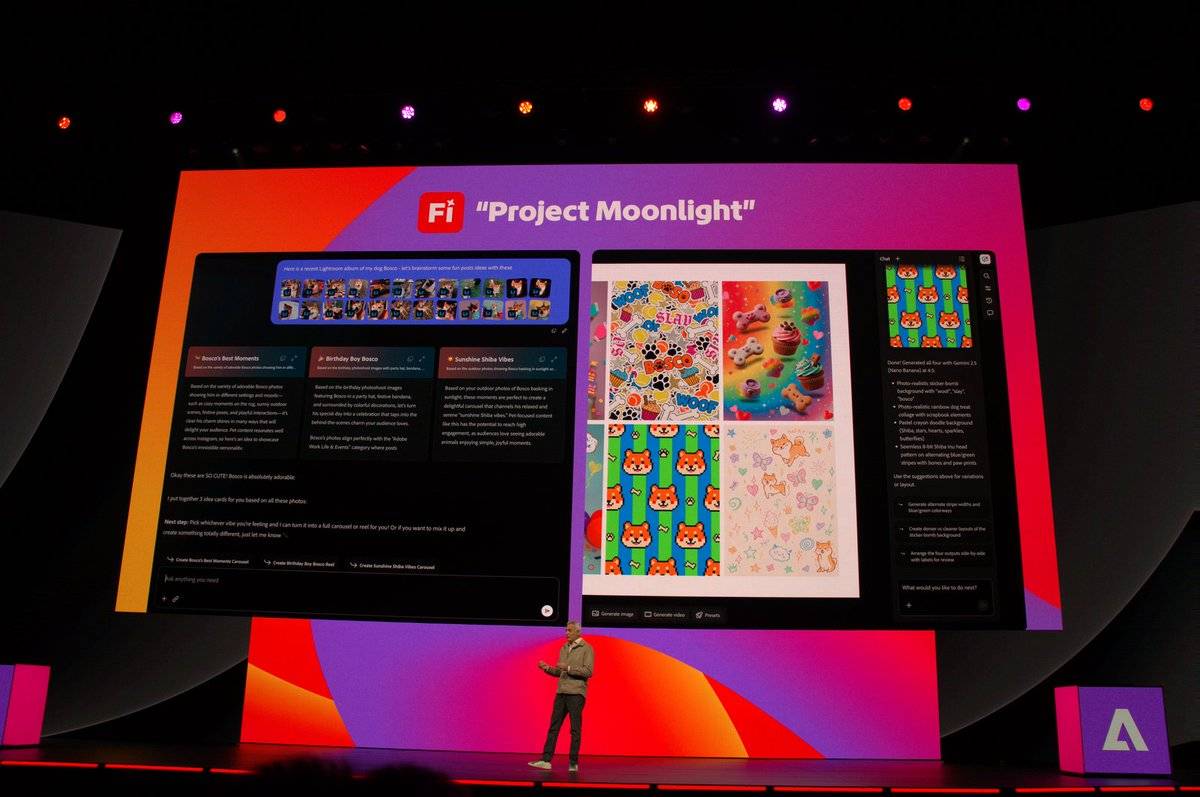

Secondo Adobe stessa, l'azienda sta lavorando per creare un sistema di intelligenza artificiale globale che vada oltre una singola applicazione : Project Moonlight, un ruolo di agente di intelligenza artificiale per la creazione e la gestione dei social media.

Immagine|Adobe

Rispetto ai tradizionali strumenti creativi come Photoshop e Premiere Pro, la visione di Adobe per Project Moonlight è grandiosa: non è uno strumento software, ma un agente in grado di accedere a tutte le tue applicazioni Adobe e che conosce il tuo stile personale .

In altre parole, Moonlight Project può connettersi agli strumenti di intelligenza artificiale integrati in Photoshop, Premiere Pro, Adobe Express o nella versione web di Firefly. Imparando le caratteristiche e lo stile del tuo disco Creative Cloud, o persino dei tuoi account social media (se ne concedi l'autorizzazione), può aiutarti a trasformare materiali ordinari in opere con uno stile personale.

Immagine|Adobe

Naturalmente, la spiegazione di questo concetto fornita da Adobe è piuttosto semplice: lascia che l'intelligenza artificiale impari il tuo stile dai materiali che crei manualmente e ti aiuti con alcune attività ripetitive nella creazione successiva, migliorando così la tua efficienza.

Il problema è che l'approccio di Adobe tocca proprio il fondamento stesso del cosiddetto "lavoro creativo" .

Inoltre, Adobe è il più grande sviluppatore al mondo di strumenti software creativi. Questo comportamento di "prendere il controllo del processo creativo dell'utente con una scatola nera privata" non suona sospetto, anche se fatto sotto la bandiera dell'efficienza?

Naturalmente, a giudicare dalle attuali applicazioni di Firefly, gli strumenti di intelligenza artificiale di Adobe non sono così sensazionali come sembrano.

Attualmente, la maggior parte delle funzioni implementate e in versione beta pubblica sono ancora principalmente focalizzate sulla gestione dell'elaborazione batch e delle operazioni ripetitive, nonché su attività noiose come l'inserimento di chiavi nelle immagini.

Ancora più importante, Adobe ha scelto un modello di "comando in linguaggio naturale" simile a quello di Google, che ne sottolinea la bassa curva di apprendimento.

Inoltre, i piani di Adobe per Project Moonlight vanno oltre gli aspetti creativi. In un'intervista ufficiale, il responsabile del progetto ha anche menzionato uno scenario applicativo:

Creazione Conversazionale: Trasforma le tue conversazioni con il tuo agente in contenuti creativi. Scambiando idee con il tuo agente, vengono generate immagini, video e post sui social media in linea con la tua visione, permettendoti di trasformare facilmente le tue idee in azioni.

Crescita e strategia basate sui dati: collega i tuoi canali social, consentendo alle tue agenzie di analizzare le prestazioni, identificare le tendenze e sviluppare strategie di contenuto per ampliare il tuo pubblico e rafforzare il tuo marchio creativo.

In altre parole, Project Moonlight, in quanto agente di intelligenza artificiale, non solo può occuparsi di compiti noiosi e ripetitivi, ma, cosa ancora più importante, può aiutare gli utenti a comprendere i dialoghi astratti dei clienti e a gestire il proprio marchio personale .

Da questa prospettiva, il design dell'intelligenza artificiale di Adobe mira effettivamente a "liberare la creatività e a portare benefici all'umanità".

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.