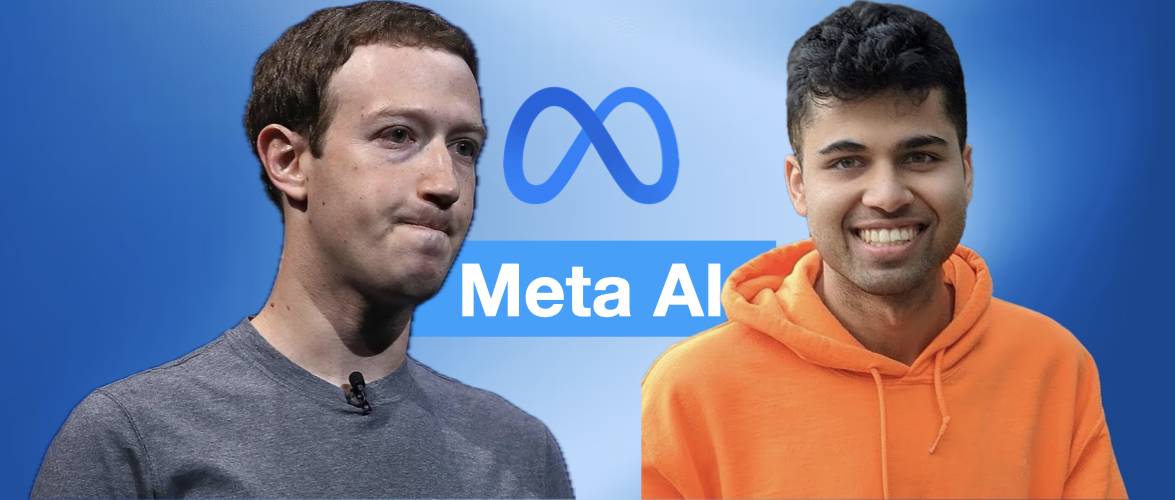

LOL! Zuckerberg ha cercato personalmente di trattenere l’esperto di intelligenza artificiale, ma ha finito per dirgli di andarsene con una zuppa di pollo tossica.

Il laboratorio di superintelligenza di Meta ha appena aperto i battenti, con finanziamenti e potenza di calcolo a disposizione. Il CEO Mark Zuckerberg si è persino fatto avanti personalmente per promuovere l'idea che "tutti hanno una superintelligenza".

Ma proprio in questo momento, il ricercatore scientifico di Meta, Rishabh Agarwal, ha appena twittato per annunciare che se ne sarebbe andato.

Diamo un'occhiata alla sua dichiarazione di dimissioni:

"Questa è la mia ultima settimana presso @AIatMeta. Unirmi al nuovo laboratorio Superintelligence TBD è stata una decisione difficile per me, soprattutto considerando la concentrazione di talenti e potenza di calcolo che vi opera. Ma dopo 7 anni e mezzo trascorsi presso Google Brain, DeepMind e Meta, sento il bisogno di correre un rischio diverso."

Pensate che questo sia solo il solito cliché sulle dimissioni? Ma aspettate, ha aggiunto un altro punto:

"La visione di Mark e Alexandr Wang di unirsi al team della Superintelligenza era incredibilmente allettante. Ma alla fine, ho scelto di seguire il consiglio di Mark: 'In un mondo che cambia così rapidamente, il rischio più grande che si possa correre è non correre alcun rischio'".

È davvero divertente. Non mi aspettavo che la sentita zuppa di pollo tossica di Zuckerberg sarebbe diventata la ragione per cui Rishabh ha presentato le sue dimissioni.

Per vincere la competizione dell'IA, il recente ritmo di reclutamento di Meta è stato estremamente aggressivo.

Zuckerberg ha offerto stipendi a nove cifre a molti ricercatori di alto livello e ha persino reclutato personalmente talenti da aziende come OpenAI e Google tramite e-mail e WhatsApp, con uno stipendio totale offerto che a volte raggiungeva i 100 milioni di dollari.

A metà agosto, Meta è riuscita a sottrarre più di 20 persone da OpenAI, almeno 13 da Google, 3 da Apple, 3 da xAI e 2 da Anthropic, per un totale di oltre 50 nuovi dipendenti.

Tuttavia, di recente si sono diffuse voci secondo cui, dopo aver reclutato in modo aggressivo più di 50 ricercatori e ingegneri di intelligenza artificiale per diversi mesi, la scorsa settimana Meta ha iniziato a congelare le assunzioni nel suo dipartimento di intelligenza artificiale, riducendo in modo significativo le dimensioni del dipartimento e riorganizzando il team di intelligenza artificiale.

Meta AI sarà riorganizzata in quattro team principali: ricerca, formazione (TBD Lab), prodotto e infrastruttura. La maggior parte dei responsabili dei team riferirà direttamente a Wang. Anche il team della Fondazione AGI, precedentemente responsabile del modello su larga scala di Llama, è stato ufficialmente sciolto in questa ristrutturazione.

Forse anche Rishabh è stata colpita dalla crisi della ristrutturazione.

Tuttavia, Rishabh non è stato da meno in Meta. A suo dire, in pochi mesi lui e il suo team hanno ottenuto molti risultati, come ad esempio il progresso nel post-addestramento dei modelli "pensanti".

Includono in particolare:

- Grazie al ridimensionamento RL, abbiamo portato un modello denso di 8 miliardi di parametri a prestazioni vicine a quelle di Deepseek-R1.

- Utilizzare dati sintetici nella formazione intermedia per dare il via migliore alla RL.

- È stato sviluppato un metodo di distillazione migliore in base alle politiche adottate.

Uno sguardo più attento al curriculum di Rishabh dimostra che è un attore di spicco nel campo dell'intelligenza artificiale.

Ha conseguito la laurea triennale in Informatica e Ingegneria presso l'Indian Institute of Technology di Bombay. Ha poi conseguito il dottorato di ricerca presso il Mila, il Quebec Institute for Artificial Intelligence in Canada, dove la sua tesi si è concentrata su esplorazioni innovative nell'apprendimento per rinforzo profondo, sotto la supervisione di Aaron Courville e Marc Bellemare.

Google Scholar mostra che ha partecipato e pubblicato una serie di influenti articoli di ricerca, tra cui Gemini 1.5 e Gemma 2, con rispettivamente più di 2.500 e 1.200 citazioni; anche "Deep Reinforcement Learning at the Edge of the Statistical Precipice" e "Neural Additive Models" del 2021 hanno una grande influenza.

Nel complesso, le sue citazioni accademiche hanno superato le 10.000, con un indice h di 34 e un indice i10 di 41. La sua ricerca copre un'ampia gamma di argomenti, tra cui la comprensione multimodale, i modelli di linguaggio aperti, le reti neurali interpretabili e l'apprendimento per rinforzo offline, coprendo essenzialmente tutti gli argomenti più interessanti.

In termini di esperienza lavorativa, attualmente è professore associato presso la McGill University, posizione che ricopre da settembre 2024. Prima di entrare in Meta, ha lavorato presso Google DeepMind dal 2023 al 2025 come ricercatore scientifico, concentrandosi sull'apprendimento per rinforzo, l'auto-miglioramento e la distillazione di grandi modelli linguistici.

Ha inoltre lavorato per 5 anni presso Google Brain come ricercatore senior, conducendo ricerche sull'apprendimento per rinforzo profondo e vincendo il premio per il miglior articolo al NeurIPS 2021. In precedenza, ha svolto uno stage presso Waymo all'inizio del 2018.

Per Rishabh, le parole contenute nella sua dichiarazione di dimissioni, "prendere un diverso tipo di rischio", potrebbero essere vere.

L'esperienza e l'influenza che ha accumulato in aziende come Google e Meta sono sufficienti a sostenerlo nel perseguire una ricerca più libera o un palcoscenico più grande.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.