Morte di Yang Zhenning: cambiare la percezione cinese di inferiorità / Tim Cook: l’intelligenza artificiale di Apple sta lavorando duramente per entrare in Cina / Il tentativo di GPT-5 di risolvere un “problema matematico vecchio di un secolo” è stato annullato | Hunt Good Weekly

Benvenuti all'ultima edizione di Hunt Good Weekly!

In questo numero vedrete:

8 nuove informazioni

3 strumenti utili

1 caso interessante

3 punti di vista chiari

Caccia alle notizie | Titoli in anteprima

Yang Zhenning è morto all'età di 103 anni

Yang Zhenning è morto all'età di 103 anni

Secondo l'agenzia di stampa Xinhua, il signor Yang Zhenning, fisico di fama mondiale, premio Nobel per la fisica, accademico dell'Accademia cinese delle scienze, professore presso l'Università di Tsinghua e preside onorario dell'Istituto di studi avanzati dell'Università di Tsinghua, è morto di malattia a Pechino il 18 ottobre 2025 all'età di 103 anni.

Le informazioni pubbliche mostrano che Yang Zhenning nacque a Hefei, nella provincia di Anhui, nel 1922. Si trasferì negli Stati Uniti per studiare e insegnare negli anni '40. Insieme al fisico cinese Tsung-Dao Lee, propose congiuntamente la teoria della non conservazione della parità nel 1956 e vinse il Premio Nobel per la fisica nel 1957, diventando uno dei primi vincitori cinesi del Premio Nobel.

La teoria dei campi di gauge di Yang-Mills è una teoria sofisticata che studia le forze che tengono insieme i nuclei atomici.

Yang Zhenning e Mills estesero l'idea che l'interazione elettromagnetica sia determinata dall'invarianza di gauge locale al gruppo di simmetria locale della commutatività, proponendo una teoria con invarianza di isospin locale. Scoprirono che era necessario introdurre tre campi di gauge vettoriali, che formano la rappresentazione aggiunta del gruppo di moto di isospin. Ciò rivelò che l'invarianza di gauge potrebbe essere l'essenza comune dell'interazione elettromagnetica e di altre interazioni, aprendo così un nuovo approccio per unificare varie interazioni utilizzando questo principio di gauge.

Negli ultimi anni della sua vita, Yang Zhenning parlava spesso delle sue esperienze di vita. Una volta disse: "Il mio contributo più importante nella vita è stato quello di contribuire a cambiare lo stato psicologico di inferiorità del popolo cinese. Credo che i miei successi scientifici abbiano contribuito ad aumentare l'autostima del popolo cinese".

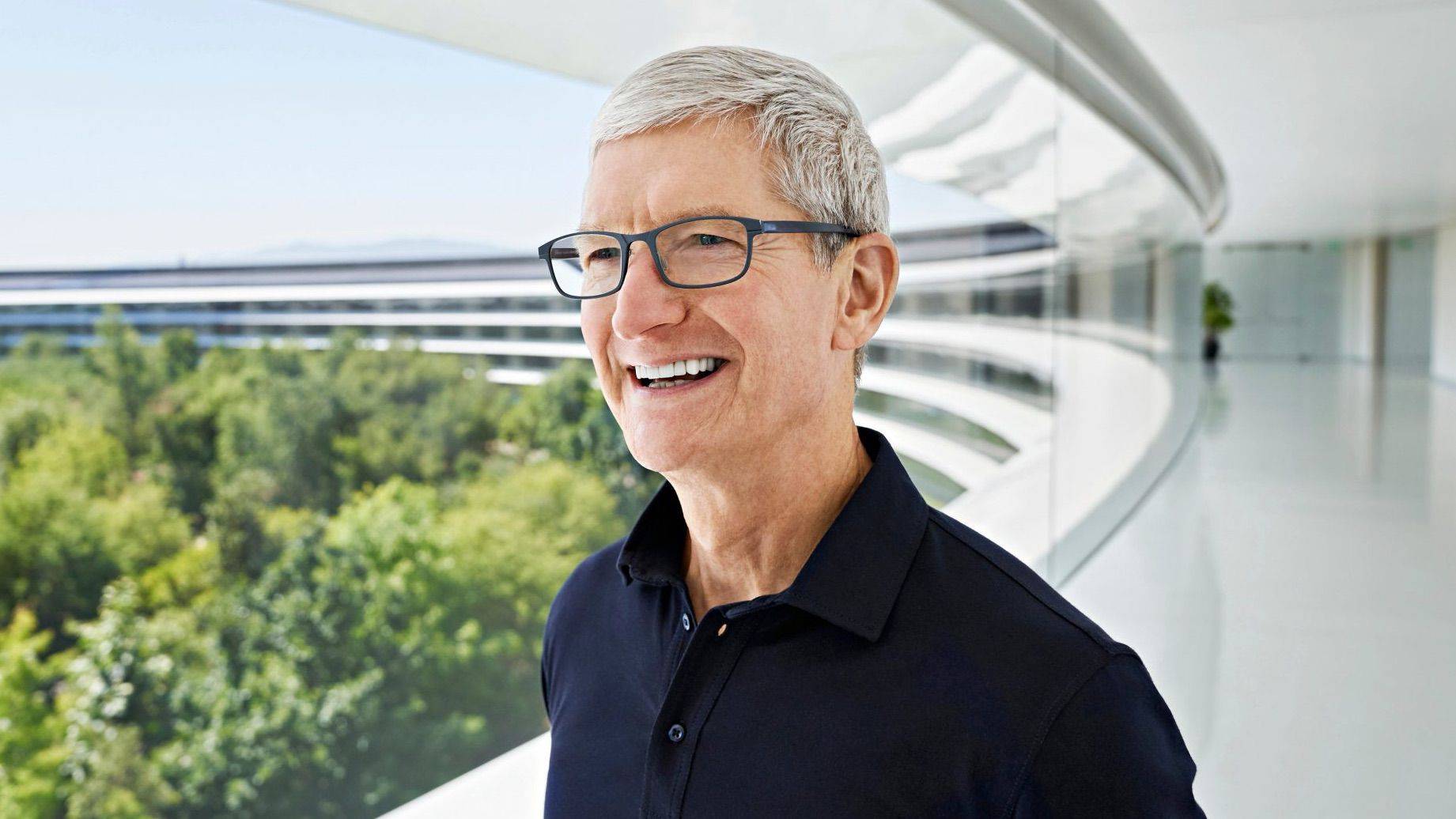

CEO di Apple: Apple Intelligence sta lavorando duramente per entrare in Cina

CEO di Apple: Apple Intelligence sta lavorando duramente per entrare in Cina

Il 18 ottobre, il CEO di Apple Tim Cook è apparso a Shanghai e ha avuto un dialogo con Bai Chong'en, preside della Facoltà di Economia e Management dell'Università di Tsinghua e presidente del comitato esecutivo del Global Wealth Management Forum in occasione della conferenza Global Wealth Management Forum 2025 Shanghai Suhewan.

Secondo Yicai Global, durante una conversazione sul tema "I confini dell'innovazione nell'era tecnologica", Cook ha rivelato che Apple sta promuovendo attivamente l'introduzione di Apple Intelligence nel mercato cinese. Ha dichiarato: "Stiamo promuovendo l'introduzione di Apple Intelligence in Cina, integrando le funzionalità di intelligenza artificiale nel sistema operativo in modo che le persone possano sfruttare la potenza dell'intelligenza artificiale in tutte le app che utilizzano quotidianamente".

Cook ha sottolineato l'importanza della tecnologia AI, sottolineando che sta cambiando la vita delle persone e persino salvandole. Questa settimana, durante una visita al flagship store Apple di Lujiazui a Pudong, Shanghai, ha discusso in particolare con i consumatori cinesi delle funzionalità di monitoraggio della salute dell'Apple Watch, come il rilevamento delle cadute.

Inoltre, il rapporto menzionava che facilitare la diffusione di Apple Intelligence in Cina era uno degli obiettivi principali del viaggio di Cook. Aveva anche l'importante missione di negoziare con gli operatori nazionali per promuovere la tecnologia eSIM nell'iPhone Air.

OpenAI lancia la funzionalità "ChatGPT Login" per creare un ecosistema di abbonamenti AI personali

OpenAI lancia la funzionalità "ChatGPT Login" per creare un ecosistema di abbonamenti AI personali

Secondo fonti vicine alla questione, OpenAI sta promuovendo un servizio più ambizioso: consentire ai visitatori di accedere al suo sito web utilizzando le credenziali ChatGPT, simili a quelle attualmente utilizzate per l'accesso agli account Google o Facebook. Le aziende che adottano questa funzione di accesso possono trasferire ai clienti il costo dell'utilizzo dei modelli OpenAI.

Nello specifico, quando un utente utilizza un account ChatGPT per accedere a un servizio di startup basato sul modello OpenAI, le commissioni che la startup deve pagare a OpenAI verranno dedotte dal limite di capacità dell'account ChatGPT dell'utente.

Gli utenti della versione gratuita possono inviare circa 10 query a GPT-5 ogni cinque ore, parte delle quali vengono utilizzate per coprire le commissioni API della startup. Se gli utenti della versione gratuita raggiungono i limiti di utilizzo durante l'utilizzo di servizi di terze parti, verrà loro richiesto di passare a un account a pagamento.

Questo modello è interessante per gli utenti con un utilizzo limitato che non raggiungono mai i limiti di capacità e può anche aiutare a ridurre i costi per le piccole startup che non hanno i fondi per pagare le elevate fatture API.

Tuttavia, ciò potrebbe danneggiare i ricavi delle startup che applicano tariffe basate sull'utilizzo.

Gli addetti ai lavori sottolineano che queste mosse evidenziano il desiderio di OpenAI di espandere la propria influenza in tutti gli aspetti della vita online dei consumatori, proprio come Apple, Google e Facebook. OpenAI ha dichiarato agli investitori che prevede di generare circa 110 miliardi di dollari di entrate indirette attraverso utenti non paganti entro il 2030.

https://www.theinformation.com/articles/openais-growing-ecosystem-play?rc=qmzset

https://www.theinformation.com/articles/openais-growing-ecosystem-play?rc=qmzset

Il numero di utenti di intelligenza artificiale generativa nel mio paese supera i 500 milioni

Il numero di utenti di intelligenza artificiale generativa nel mio paese supera i 500 milioni

Secondo l'agenzia di stampa Xinhua, il 18 ottobre il China Internet Network Information Center ha pubblicato il "Generative Artificial Intelligence Application Development Report (2025)" in occasione della sesta conferenza sulle risorse di base di Internet in Cina del 2025.

Il rapporto mostra che a partire da giugno 2025 il numero di utenti di intelligenza artificiale generativa nel mio Paese raggiungerà i 515 milioni, con un aumento di 266 milioni rispetto a dicembre 2024, e la portata degli utenti raddoppierà in sei mesi; il tasso di penetrazione sarà del 36,5%.

Il rapporto ritiene che l'IA generativa si stia gradualmente integrando nella vita quotidiana di vari gruppi nel mio Paese, con un focus particolare sui giovani, sulle persone di mezza età e su coloro che hanno un elevato livello di istruzione. Tra tutti gli utenti di IA generativa, i giovani e le persone di mezza età sotto i 40 anni rappresentano il 74,6%, mentre gli utenti con laurea o laurea triennale o superiore rappresentano il 37,5%.

Il rapporto ha evidenziato che i grandi modelli di intelligenza artificiale generativa nazionale sono ampiamente apprezzati dagli utenti e promuovono la trasformazione intelligente e l'aggiornamento in vari scenari applicativi.

L'indagine ha rilevato che oltre il 90% degli utenti preferisce modelli domestici su larga scala. L'intelligenza artificiale generativa è ampiamente utilizzata in vari scenari, tra cui la ricerca intelligente, la creazione di contenuti, gli assistenti d'ufficio e l'hardware intelligente. Viene inoltre attivamente esplorata e implementata in settori come la produzione agricola, la produzione industriale e la ricerca scientifica.

https://www.news.cn/fortune/20251018/22bbffa5b01a47078a558a0ab46e66a4/c.html

https://www.news.cn/fortune/20251018/22bbffa5b01a47078a558a0ab46e66a4/c.html

Wikipedia avverte: l'intelligenza artificiale sta causando un forte calo delle visite umane

Wikipedia avverte: l'intelligenza artificiale sta causando un forte calo delle visite umane

La Wikimedia Foundation, l'organizzazione che ospita Wikipedia, ha recentemente lanciato l'allarme: il traffico umano della più grande enciclopedia online del mondo sta diminuendo pericolosamente, poiché sempre più utenti ottengono informazioni tramite chatbot generativi e frammenti di motori di ricerca anziché visitare direttamente il sito web, minacciandone la sostenibilità a lungo termine.

Marshall Miller, direttore senior dei prodotti della fondazione, ha affermato in un post sul blog che, dopo aver corretto il sistema di rilevamento dei robot, si è scoperto che le visualizzazioni delle pagine umane su Wikipedia negli ultimi mesi erano diminuite di circa l'8% rispetto allo stesso periodo del 2024. Ha sottolineato che ciò riflette l'impatto dell'intelligenza artificiale generativa e dei social media sul modo in cui le persone ottengono informazioni, soprattutto ora che i motori di ricerca iniziano a fornire direttamente risposte, spesso basate sui contenuti di Wikipedia.

Miller ha sottolineato che un calo delle visite avrebbe gravi conseguenze. "Con meno visitatori su Wikipedia, potrebbero esserci meno volontari disposti a contribuire e ad arricchire i contenuti, e meno donatori individuali a sostenere questo lavoro", ha affermato.

Ironicamente, mentre l'intelligenza artificiale ha portato a un calo del traffico di Wikipedia, i suoi dati non sono mai stati così preziosi per l'intelligenza artificiale. Quasi tutti i modelli linguistici su larga scala sono addestrati sui set di dati di Wikipedia e piattaforme come Google estraggono da anni i contenuti di Wikipedia per alimentare le loro funzionalità di riepilogo, che a loro volta dirottano il traffico da Wikipedia stessa.

Questa scoperta rispecchia altre ricerche. A luglio di quest'anno, il Pew Research Center ha scoperto che solo l'1% degli utenti di Google ha cliccato sui link nei riepiloghi generati dall'intelligenza artificiale per visitare la pagina originale. La fondazione ha dichiarato di star rafforzando l'applicazione delle policy, sviluppando framework di attribuzione e sviluppando nuove capacità tecnologiche. Ha inoltre esortato gli utenti a cercare proattivamente citazioni e a cliccare sulle fonti originali durante la ricerca di informazioni, supportando la credibilità delle conoscenze create da persone reali.

https://www.404media.co/wikipedia-says-ai-is-causing-a-dangerous-decline-in-human-visitors/

https://www.404media.co/wikipedia-says-ai-is-causing-a-dangerous-decline-in-human-visitors/

Gemini 3.0 potrebbe uscire a dicembre

Gemini 3.0 potrebbe uscire a dicembre

Secondo Sources.news, Google prevede di lanciare l'ultima versione 3.0 del suo modello di punta di intelligenza artificiale, Gemini, a dicembre. Si prevede che questa versione otterrà significativi miglioramenti delle prestazioni e si collocherà tra i primi posti nelle classifiche del settore.

In quanto prodotto principale della strategia di intelligenza artificiale di Google, l'app Gemini un tempo era in cima alla classifica dell'App Store iOS con il suo popolare modello di generazione di immagini Nano Banana, sostituendo brevemente ChatGPT al primo posto.

Vale la pena notare che il rapporto menziona anche che Google sta valutando internamente la possibilità di incorporare alcune delle funzionalità avanzate di Gemini nella versione gratuita. Inoltre, Google ha formato un piccolo team riservato dedicato all'integrazione di Gemini 3.0 nel sistema operativo Apple per ampliare i suoi scenari applicativi.

https://sources.news/p/google-readies-gemini-3-perplexity

https://sources.news/p/google-readies-gemini-3-perplexity

OpenAI annuncia un chip AI auto-sviluppato

OpenAI annuncia un chip AI auto-sviluppato

Questa settimana, OpenAI e il colosso dei chip Broadcom hanno annunciato un importante accordo di partnership multimiliardario. Le due parti svilupperanno e implementeranno congiuntamente 10 gigawatt di chip di intelligenza artificiale e sistemi di elaborazione personalizzati nei prossimi quattro anni per soddisfare le crescenti esigenze di elaborazione di OpenAI.

In base all'accordo, OpenAI progetterà le proprie unità di elaborazione grafica (GPU), integrando la propria esperienza nello sviluppo di potenti modelli di intelligenza artificiale nei sistemi hardware. Questi chip saranno sviluppati congiuntamente dalle due aziende, con Broadcom responsabile della distribuzione a partire dalla seconda metà del prossimo anno.

Il nuovo sistema utilizzerà Ethernet e altre tecnologie di connettività di Broadcom e sarà implementato nei data center di OpenAI e di terze parti. Secondo quanto riportato, le due parti hanno avviato la collaborazione sui chip personalizzati 18 mesi fa e l'hanno ora estesa a componenti correlati, come rack per server e apparecchiature di rete.

Questo importante accordo porta l'impegno complessivo di OpenAI a 26 gigawatt di potenza di calcolo da parte dei tre principali giganti dei chip: Broadcom, Nvidia e AMD. Il CEO di OpenAI, Sam Altman, e il Presidente delle Infrastrutture, Greg Brockman, hanno dichiarato che l'attuale capacità di calcolo disponibile dell'azienda è tutt'altro che sufficiente. Con la rapida crescita della domanda di prodotti di intelligenza artificiale, sperano di costruire data center su larga scala in tutto il mondo per rimanere al passo con i tempi.

Altman ha recentemente dichiarato ai dipendenti che OpenAI prevede di costruire 250 gigawatt di nuova potenza di calcolo entro il 2033, il che, secondo fonti a conoscenza della questione, costerebbe più di 10 trilioni di dollari secondo gli standard attuali.

https://openai.com/index/openai-and-broadcom-announce-strategic-collaboration/

https://openai.com/index/openai-and-broadcom-announce-strategic-collaboration/

Il nuovo responsabile della ricerca AI di Apple si unisce a Meta

Il nuovo responsabile della ricerca AI di Apple si unisce a Meta

Secondo quanto riportato dal giornalista di Bloomberg Mark Gurman, Ke Yang, il dirigente responsabile del progetto di ricerca AI di Apple, sta per lasciare l'azienda e unirsi a Meta.

Il cambiamento è avvenuto poche settimane dopo aver assunto la guida del team "Risposte, Conoscenza e Informazione" (AKI).

La missione del team è quella di potenziare Siri con funzionalità simili a ChatGPT, consentendogli di ottenere informazioni dal web in tempo reale.

Secondo fonti vicine alla questione, l'addio di Ke Yang è l'ultimo di una serie di abbandoni di alto livello nel dipartimento di intelligenza artificiale di Apple.

Dall'inizio di quest'anno, circa una dozzina di membri chiave hanno lasciato il team del modello base di Apple, alcuni dei quali sono passati a Meta e si sono uniti ai suoi nuovi "Superintelligence Labs".

Inizialmente Apple aveva pianificato di lanciare una nuova versione di Siri a marzo 2025, integrando la funzione di ricerca sviluppata dal team AKI e completando diverse funzionalità precedentemente rimandate, tra cui la chiamata di dati personali per gestire richieste più complesse.

Il progetto è visto come una mossa importante da parte di Apple per recuperare terreno rispetto a concorrenti come OpenAI, Perplexity e Google Gemini.

Con la partenza di Ke Yang, il team AKI sarà assunto dal vicepresidente di Apple Benoit Dupin, attualmente responsabile dell'infrastruttura cloud correlata all'apprendimento automatico.

https://www.bloomberg.com/news/articles/2025-10-15/apple-s-newly-tapped-head-of-chatgpt-like-ai-search-effort-to-leave-for-meta

https://www.bloomberg.com/news/articles/2025-10-15/apple-s-newly-tapped-head-of-chatgpt-like-ai-search-effort-to-leave-for-meta

Caccia agli strumenti | Strumenti avanzati

Manus 1.5 è ufficialmente rilasciato, consentendoti di sviluppare applicazioni web complete con un clic

Il 17 ottobre la piattaforma di agenti AI Manus ha annunciato il lancio della nuova versione Manus 1.5.

I funzionari hanno affermato che questo aggiornamento ha apportato miglioramenti significativi in termini di velocità e prestazioni e ha ulteriormente confermato la versatilità della sua architettura di base.

A differenza dei tradizionali "creatori di siti web basati sull'intelligenza artificiale", il team di Manus sottolinea che non si limita a sviluppare uno strumento; piuttosto, evolve costantemente il framework sottostante e lo dota di moduli funzionali appropriati. Grazie a questo approccio, Manus ha raggiunto capacità di creazione di applicazioni web basate sull'intelligenza artificiale di livello "sota" in un solo mese.

In particolare, le nuove funzionalità di Manus 1.5 sono profondamente integrate con le funzionalità esistenti della piattaforma. Ad esempio, gli utenti possono creare rapidamente un sito web di presentazione dei servizi e, dopo aver raccolto le informazioni sui clienti, avviare attività successive, come la generazione automatica di slideshow personalizzati, tramite il client Manus e le notifiche push via e-mail.

I funzionari hanno affermato che questa funzionalità avanzata è ora disponibile per tutti gli utenti e che l'infrastruttura su cui si basa fa parte della visione più ampia del team: creare una piattaforma in cui chiunque possa sfruttare tutta la potenza del cloud computing e dell'intelligenza artificiale attraverso la conversazione.

https://manus.im/zh-cn/blog/manus-1.5-release

https://manus.im/zh-cn/blog/manus-1.5-release

Nvidia inizia a vendere il supercomputer AI più piccolo del mondo e Jensen Huang lo consegna a Musk

Nvidia inizia a vendere il supercomputer AI più piccolo del mondo e Jensen Huang lo consegna a Musk

Questa settimana, NVIDIA ha annunciato sul suo sito web ufficiale il lancio ufficiale di DGX Spark, un prodotto di classe desktop definito "il più piccolo supercomputer di intelligenza artificiale al mondo". La prima unità è stata consegnata personalmente a Elon Musk dal CEO di NVIDIA, Jensen Huang, presso la base stellare di SpaceX.

È stato riferito che DGX Spark è basato sull'architettura Grace Blackwell e che una singola macchina può fornire prestazioni di intelligenza artificiale pari a 1 Petaflop. È dotato di 128 GB di memoria unificata, può eseguire modelli di inferenza con un massimo di 200 miliardi di parametri in locale e supporta la messa a punto di modelli da 70 miliardi di parametri.

I funzionari hanno sottolineato che questo prodotto è rivolto a sviluppatori, ricercatori e creatori e mira a portare la potenza di calcolo di un supercomputer sul desktop.

Jensen Huang ha dichiarato: "Nel 2016 abbiamo lanciato DGX-1 e lo abbiamo consegnato a OpenAI. Quella macchina ha dato vita a ChatGPT e ha dato il via alla rivoluzione dell'intelligenza artificiale. Ora DGX Spark porterà ancora una volta i supercomputer sui desktop degli sviluppatori, innescando una nuova ondata di innovazioni".

Musk ha risposto anche su X, dicendo: "Questo DGX Spark è circa 100 volte più efficiente dal punto di vista energetico rispetto al DGX-1DGX-1 che Jensen Huang mi ha consegnato nel 2016. Quello è stato il primo computer AI dedicato della storia."

DGX Spark potrà essere ordinato sul sito Web ufficiale di NVIDIA e sui canali dei partner a partire dal 15 ottobre.

Letture correlate: Dopo 9 anni, Huang Renxun ha consegnato di nuovo il progetto a Musk e il supercomputer personale AI, ritardato per più di sei mesi, è finalmente arrivato.

Letture correlate: Dopo 9 anni, Huang Renxun ha consegnato di nuovo il progetto a Musk e il supercomputer personale AI, ritardato per più di sei mesi, è finalmente arrivato.

Windows 11 riceve un importante aggiornamento: Copilot prende il controllo di voce, schermo e barra delle applicazioni

Windows 11 riceve un importante aggiornamento: Copilot prende il controllo di voce, schermo e barra delle applicazioni

Di recente, Microsoft ha pubblicato un articolo sul suo sito Web ufficiale, annunciando il lancio di un aggiornamento su larga scala per Windows 11. L'obiettivo principale dell'aggiornamento è introdurre completamente le funzioni di intelligenza artificiale, rendendo ogni dispositivo un "AIPC".

Le novità più importanti di questo aggiornamento includono:

- Ehi, Copilot: gli utenti possono attivare Copilot direttamente tramite comandi vocali per un utilizzo a mani libere.

- Copilot Vision: legge il contenuto dello schermo e fornisce indicazioni in tempo reale, annotando anche i passaggi da fare con un clic sull'interfaccia.

- Chiedi a Copilot: integra Copilot nella barra delle applicazioni per un accesso con un clic;

- Azioni Copilot: eseguire attività localmente, come organizzare foto ed estrarre informazioni PDF;

- Connettori Copilot: collega OneDrive, Outlook e Google Drive per consentire il recupero dei dati multipiattaforma.

Inoltre, Microsoft ha introdotto Manus AI Agent in Windows, consentendo agli utenti di richiamare direttamente la funzione "Crea un sito web con Manus" in Esplora file per generare pagine web in pochi minuti.

Altri aggiornamenti includono l'integrazione con Filmora per l'editing video, la pianificazione rapida delle riunioni tramite Zoom e la versione beta di Gaming Copilot. Microsoft ha sottolineato che l'interazione vocale non sostituirà tastiera e mouse, ma diventerà un terzo metodo di input.

Sebbene queste nuove funzionalità siano disponibili principalmente nei paesi/regioni che supportano Copilot, l'aggiornamento di Microsoft indica anche una possibile direzione di sviluppo per i sistemi operativi nativi per PC con intelligenza artificiale.

Letture correlate: Grande aggiornamento di Windows 11: puoi lasciare che l'intelligenza artificiale controlli il tuo computer parlando, e Manus sta arrivando

Letture correlate: Grande aggiornamento di Windows 11: puoi lasciare che l'intelligenza artificiale controlli il tuo computer parlando, e Manus sta arrivando

Caccia al divertimento

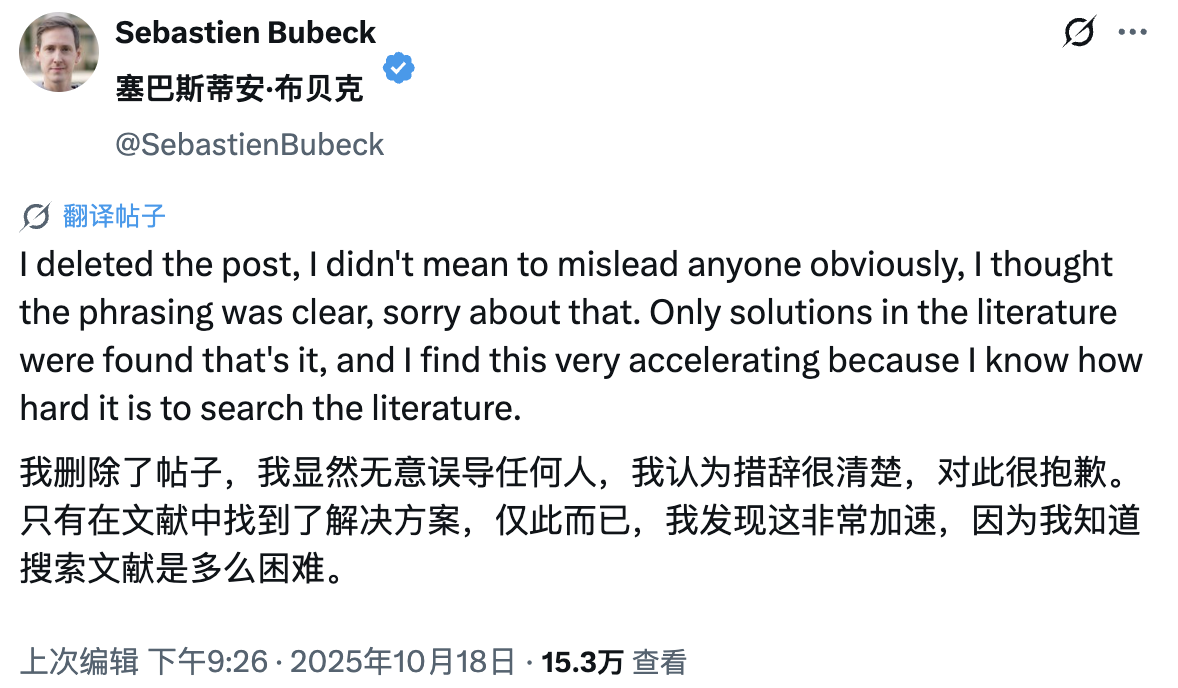

Il tentativo di GPT-5 di risolvere un problema matematico vecchio di un secolo è stato annullato e gli scienziati di OpenAI hanno cancellato il post e si sono scusati.

Di recente, un servizio giornalistico secondo cui GPT-5 avrebbe "risolto 10 problemi matematici vecchi di un secolo in un solo fine settimana" ha suscitato scalpore nella comunità accademica, ma in seguito è stato confermato che era seriamente fuorviante.

L'incidente ha avuto origine dalla rivelazione fatta la scorsa settimana da Sebastian Bubeck, ricercatore scientifico di OpenAI ed ex vicepresidente di Microsoft, secondo cui due ricercatori matematici hanno utilizzato GPT-5 per trovare le risposte a 10 enigmi di Erdös irrisolti in un fine settimana.

Gli Enigmi di Erdős sono un insieme di circa 1.000 problemi matematici posti dal celebre matematico Paul Erdős. In precedenza, solo alcuni di essi erano stati risolti. Mark Selke, uno dei ricercatori di OpenAI, ha successivamente confermato che, interrogando GPT-5 migliaia di volte, avevano trovato soluzioni a 10 di questi problemi e compiuto progressi significativi su altri 11.

Tuttavia, la verità venne presto a galla.

Thomas Blum, il responsabile del sito web dedicato al Problema di Erdös, ha chiarito che si trattava di una "grave rappresentazione errata", affermando che GPT-5 aveva semplicemente trovato letteratura pubblicata di cui personalmente non era a conoscenza. Questi problemi erano in realtà già stati risolti da altri matematici. Lo stato "irrisolto" sul sito web indica semplicemente che il responsabile non ha trovato gli articoli pertinenti, non che rappresentino effettivamente problemi irrisolti in ambito accademico.

Bubek ha successivamente cancellato il post originale e si è scusato, ammettendo di aver semplicemente trovato una soluzione nella letteratura scientifica, non che l'intelligenza artificiale avesse completato autonomamente la dimostrazione matematica. Anche il capo scienziato dell'intelligenza artificiale di Meta, Yang Lekun, è intervenuto nella sezione commenti, prendendoli in giro per essere stati gravemente danneggiati dal suo GPT sopravvalutato.

https://x.com/SebastienBubeck/status/1979539604522127746

https://x.com/SebastienBubeck/status/1979539604522127746

Caccia all'intuizione

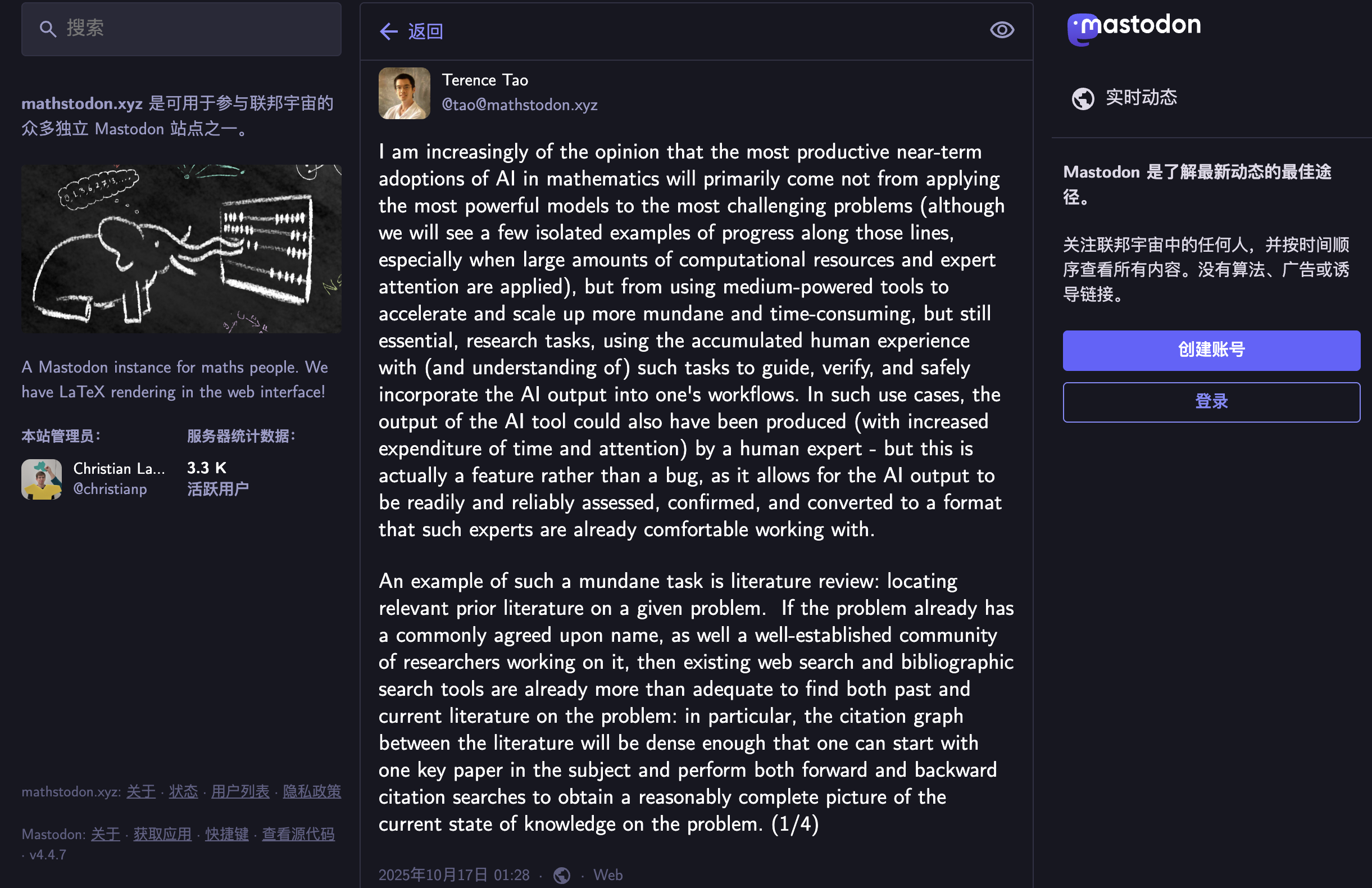

Terence Tao: Il valore fondamentale dell'intelligenza artificiale nella ricerca matematica risiede nel migliorare l'efficienza piuttosto che nell'affrontare problemi difficili

Terence Tao, vincitore della medaglia Fields e matematico sino-americano noto come il "Mozart della matematica", ha recentemente pubblicato un articolo in cui espone le sue opinioni sulle prospettive applicative dell'intelligenza artificiale nella ricerca matematica.

Terence Tao ha sottolineato che l'applicazione più efficace dell'intelligenza artificiale in matematica non consiste nell'utilizzare i modelli più potenti per risolvere i problemi più difficili, bensì nell'utilizzare strumenti di media capacità per accelerare quei compiti di ricerca fondamentali, comuni ma che richiedono molto tempo.

Egli ritiene che in questi compiti gli esperti umani possano usare la loro esperienza per guidare e verificare i risultati dell'IA, e il fatto che i risultati dell'IA possano essere completati manualmente è proprio un vantaggio, perché gli esperti possono valutare in modo più affidabile i risultati dell'output.

Ha usato le revisioni della letteratura come esempio. Gli strumenti di ricerca esistenti sono sufficientemente potenti per quesiti con nomi chiari e comunità di ricerca consolidate. Tuttavia, quando la letteratura pertinente è frammentata e priva di una denominazione unificata, o quando le relazioni tra le citazioni sono difficili da tracciare a causa di riviste impopolari o di una mancanza di comunicazione tra le comunità di ricerca, le ricerche tradizionali diventano estremamente dispendiose in termini di tempo.

Un altro potenziale vantaggio degli strumenti di intelligenza artificiale è che possono incoraggiare la segnalazione di "risultati negativi". Tradizionalmente, i ricercatori non segnalano esplicitamente l'assenza di letteratura pertinente, temendo l'imbarazzo di scoprire in seguito l'omissione. Ciò può portare a una duplicazione degli sforzi o a una valutazione errata dello stato del problema. Tuttavia, quando si utilizza l'intelligenza artificiale per ricerche sistematiche, la segnalazione di risultati sia positivi che negativi diventa più naturale, contribuendo a presentare con maggiore accuratezza il vero stato del problema nella letteratura esistente.

https://mathstodon.xyz/@tao/115385022005130505

https://mathstodon.xyz/@tao/115385022005130505

Il CEO di Figma afferma che l'intelligenza artificiale non sostituirà i posti di lavoro e i dipartimenti continuano a reclutare

Il CEO di Figma afferma che l'intelligenza artificiale non sostituirà i posti di lavoro e i dipartimenti continuano a reclutare

Il 17 ottobre, Dylan Field, CEO dell'azienda di strumenti di progettazione Figma, ha chiarito in un podcast che l'intelligenza artificiale non avrebbe minacciato i posti di lavoro umani, ma avrebbe creato nuove opportunità per il settore.

Field ha affermato che un sondaggio condotto da Figma a settembre su 1.199 designer, product manager, sviluppatori e altri professionisti ha dimostrato che quasi il 60% dei product builder può dedicare più tempo a lavori di alto valore grazie all'intelligenza artificiale e circa il 70% degli intervistati ritiene che la loro efficienza sia migliorata in modo significativo.

Ha sottolineato che il ruolo fondamentale dell'intelligenza artificiale è quello di assistere gli esseri umani piuttosto che sostituirli, e che dovremmo concentrarci su come adattarci allo sviluppo tecnologico ed eliminare il lavoro ripetitivo, anziché preoccuparcene troppo.

Figma, con sede a San Francisco, è stata fondata nel 2012 e quotata in borsa con successo a luglio di quest'anno. Il suo valore di mercato attuale è di quasi 30 miliardi di dollari e conta oltre 1.600 dipendenti.

Field ha rivelato che l'azienda sta continuando ad ampliare le posizioni in diversi dipartimenti. Mentre esplora il potenziale dell'IA per migliorare l'efficienza e ridurre i costi, l'azienda dà priorità al suo potenziale per sbloccare nuove opportunità di crescita. Non è la prima volta che lo afferma; ha ripetutamente sottolineato che l'IA è uno strumento per migliorare il lavoro umano, che i designer devono ancora svolgere un ruolo di primo piano e che la tecnologia offrirà a più persone opportunità creative.

https://www.businessinsider.com/figma-ceo-dylan-field-ai-jobs-hiring-2025-10

https://www.businessinsider.com/figma-ceo-dylan-field-ai-jobs-hiring-2025-10

L'ex scienziato di OpenAI Kapathy afferma che l'intelligenza artificiale è ancora lontana dieci anni e che l'apprendimento per rinforzo presenta difetti fondamentali.

L'ex scienziato di OpenAI Kapathy afferma che l'intelligenza artificiale è ancora lontana dieci anni e che l'apprendimento per rinforzo presenta difetti fondamentali.

Andrei Karpathy, ex responsabile della guida autonoma di Tesla e co-fondatore di OpenAI, ha recentemente esposto in modo sistematico le sue ultime opinioni sullo sviluppo dell'intelligenza artificiale in un'intervista podcast. Ritiene che ci vorranno almeno dieci anni per raggiungere un'intelligenza artificiale generale (AGI) e ha criticato aspramente l'attuale percorso tecnologico dell'IA.

Parlando di apprendimento per rinforzo, lo ha descritto come "terribile" perché presuppone che ogni fase del processo di risoluzione dei problemi sia corretta, quando in realtà è piena di confusione. Ha osservato che gli esseri umani non condurrebbero mai centinaia di prove, come fa l'intelligenza artificiale, per poi valutare l'intero processo basandosi esclusivamente sul risultato finale. Gli attuali valutatori di modelli linguistici di grandi dimensioni sono inoltre facilmente ingannati da esempi contraddittori, il che porta a gravi distorsioni nel processo di addestramento.

Per quanto riguarda la superintelligenza, ritiene che lo sviluppo dell'IA sia un'estensione naturale dell'evoluzione informatica. Piuttosto che l'immaginaria "esplosione di intelligenza", essa proseguirà il tasso di crescita economica di circa il 2% degli ultimi secoli. Paragona l'IA a strumenti storici come compilatori e motori di ricerca, ritenendo che siano tutti parte di un processo ricorsivo di auto-miglioramento.

Nel campo dell'istruzione, Kapathy sta fondando Eureka Labs, un'istituzione dedicata all'istruzione tecnica d'élite, simile all'Accademia della Flotta Stellare. Crede che l'intelligenza artificiale rivoluzionerà l'istruzione, ma sottolinea che le attuali capacità dell'IA non sono ancora sufficienti a fornire una vera esperienza di tutoraggio individuale. Immagina un futuro in cui tutti possano padroneggiare più lingue e un'ampia gamma di discipline, perseguendo il progresso intellettuale proprio come si fa con il fitness.

https://www.dwarkesh.com/p/andrej-karpathy

https://www.dwarkesh.com/p/andrej-karpathy

Tempo di uova di Pasqua

Di @CharaspowerAI

Parole chiave: Un disegno a matita di [personaggio o oggetto] [che sfonda / emerge da / interagisce con] [una superficie di carta o un muro crepato], nello stile di uno schizzo di tatuaggio su carta bianca. Solo penna e matita nere, con [un elemento specifico] in [un colore vivido] come unico dettaglio colorato. Effetto trompe-l'œil con [bordi strappati / carta arricciata / muro crepato], ombreggiatura realistica, stile illustrazione da album da disegno, elevato livello di dettaglio.

Collegamento: https://x.com/CharaspowerAI/status/1978861011273654384

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.

Yang Zhenning è morto all'età di 103 anni

Yang Zhenning è morto all'età di 103 anni CEO di Apple: Apple Intelligence sta lavorando duramente per entrare in Cina

CEO di Apple: Apple Intelligence sta lavorando duramente per entrare in Cina OpenAI lancia la funzionalità "ChatGPT Login" per creare un ecosistema di abbonamenti AI personali

OpenAI lancia la funzionalità "ChatGPT Login" per creare un ecosistema di abbonamenti AI personali Il numero di utenti di intelligenza artificiale generativa nel mio paese supera i 500 milioni

Il numero di utenti di intelligenza artificiale generativa nel mio paese supera i 500 milioni Wikipedia avverte: l'intelligenza artificiale sta causando un forte calo delle visite umane

Wikipedia avverte: l'intelligenza artificiale sta causando un forte calo delle visite umane Gemini 3.0 potrebbe uscire a dicembre

Gemini 3.0 potrebbe uscire a dicembre OpenAI annuncia un chip AI auto-sviluppato

OpenAI annuncia un chip AI auto-sviluppato Nvidia inizia a vendere il supercomputer AI più piccolo del mondo e Jensen Huang lo consegna a Musk

Nvidia inizia a vendere il supercomputer AI più piccolo del mondo e Jensen Huang lo consegna a Musk Windows 11 riceve un importante aggiornamento: Copilot prende il controllo di voce, schermo e barra delle applicazioni

Windows 11 riceve un importante aggiornamento: Copilot prende il controllo di voce, schermo e barra delle applicazioni Il CEO di Figma afferma che l'intelligenza artificiale non sostituirà i posti di lavoro e i dipartimenti continuano a reclutare

Il CEO di Figma afferma che l'intelligenza artificiale non sostituirà i posti di lavoro e i dipartimenti continuano a reclutare L'ex scienziato di OpenAI Kapathy afferma che l'intelligenza artificiale è ancora lontana dieci anni e che l'apprendimento per rinforzo presenta difetti fondamentali.

L'ex scienziato di OpenAI Kapathy afferma che l'intelligenza artificiale è ancora lontana dieci anni e che l'apprendimento per rinforzo presenta difetti fondamentali.