Sta arrivando un’era di telecamere appese ovunque al corpo | Filosofia dura

iFanr si concentra sui "prodotti di domani" e la sua rubrica di filosofia dura cerca di eliminare lo strato esterno di tecnologia e parametri ed esplorare l'origine dell'umanità nella progettazione dei prodotti.

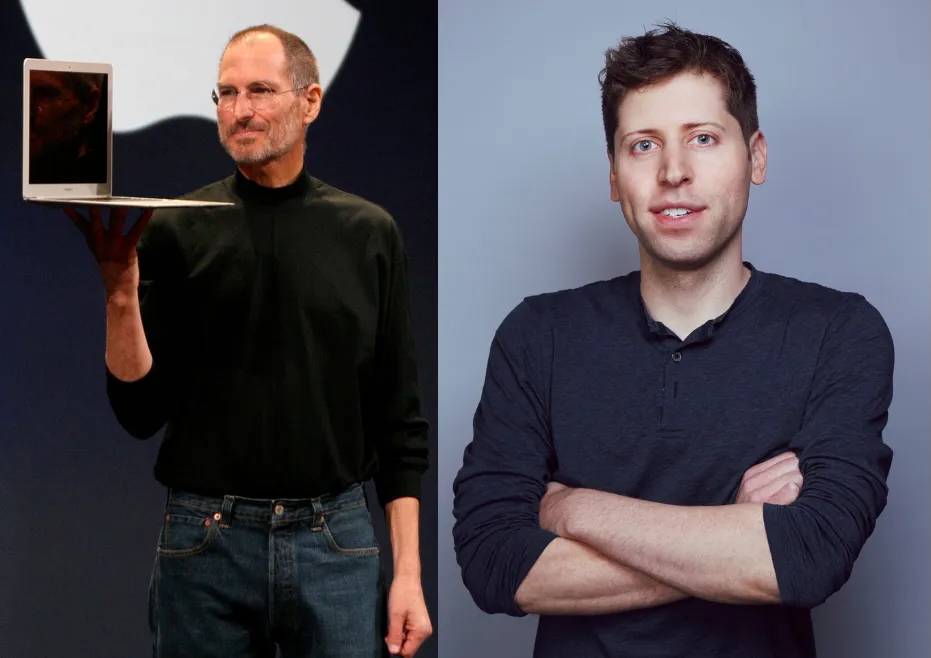

OpenAI sta silenziosamente diventando una grande notizia, una grande notizia che forse solo tre persone al mondo conoscono in questo momento: il CEO di OpenAI Sam Altman, l'ex capo progettista di Apple Jonathan Ive e la vedova di Steve Jobs, Laurene Powell Jobs.

Non molto tempo dopo la cerimonia di apertura di Google I/O 2025, sono arrivate una dopo l'altra altre due notizie sensazionalistiche: innanzitutto, Apple prevede di lanciare un paio di occhiali intelligenti entro il prossimo anno, annullando al contempo il progetto dell'orologio con fotocamera integrata; poi, OpenAI ha annunciato l'acquisizione di io Products, fondata dall'ex progettista di iPhone Jonathan Ive, con l'intenzione di lanciare in futuro prodotti hardware correlati all'intelligenza artificiale; si ritiene che Laurene Powell Jobs abbia apprezzato molto questo nuovo hardware.

Apple, Google e OpenAI, tre giganti della tecnologia, si sono alternati nello svelare o annunciare la direzione strategica dei loro prodotti di intelligenza artificiale, come se fossero in coordinamento, rendendo questa estate piovosa ancora più turbolenta.

Apple: adottare un approccio costante e continuare ad espandere l'ecosistema AR + AI

Secondo il giornalista di Bloomberg Mark Gurman, fonti vicine alla questione hanno rivelato che Apple prevede di lanciare nel 2026 un dispositivo di occhiali intelligenti "dotato di fotocamera, altoparlante e microfono". Gli utenti potranno interagire e impartire comandi a Siri tramite gli occhiali intelligenti per analizzare l'ambiente circostante, effettuare chiamate, controllare la musica, visualizzare mappe di navigazione ed eseguire traduzioni in tempo reale.

Si ritiene che gli occhiali intelligenti di Apple saranno dotati di chip proprietari come Vision Pro, e la versione hardware finale potrebbe essere simile agli occhiali intelligenti precedentemente lanciati da Meta e Ray-Ban, ma con una tecnologia migliore di questi ultimi. Inoltre, questo prodotto è sviluppato dal Vision Products Group di Apple e segue lo stesso percorso di sviluppo della versione migliorata di Vision Pro, più economica e leggera.

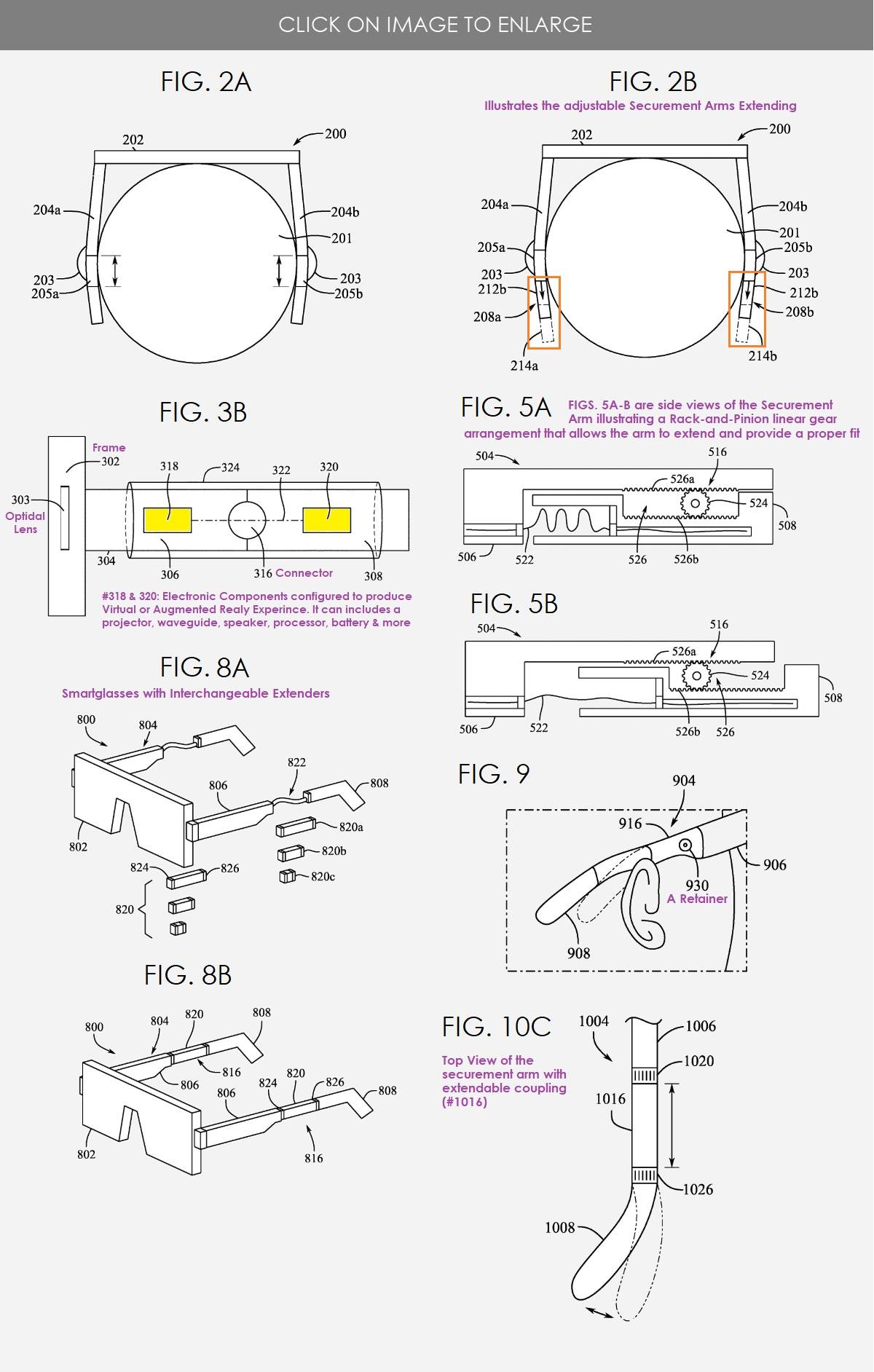

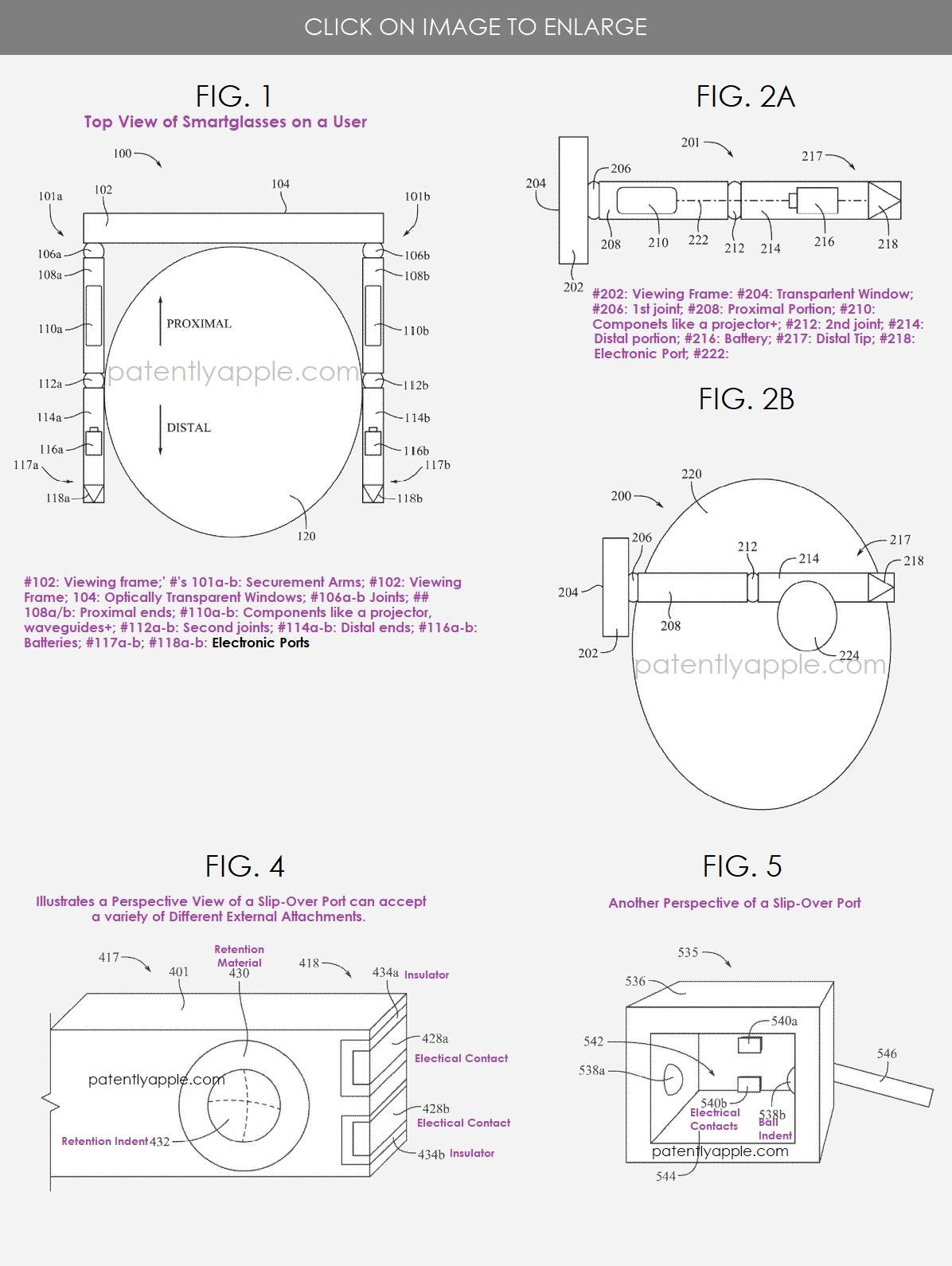

Sulla base delle informazioni trapelate e di alcune sporadiche informazioni sui brevetti a partire dal 2024, possiamo approssimativamente ipotizzare alcune forme degli occhiali intelligenti di Apple.

Ad esempio, secondo i documenti di brevetto, Apple ha progettato un paio di occhiali con una struttura a cerniera a doppia sezione, che si adatta meglio alla testa una volta indossati, migliorando la sicurezza, il comfort e l'effetto altoparlante. Alcuni analisti ritengono addirittura che la dimensione regolabile della parte posteriore degli occhiali possa aiutare gli occhiali Apple a raggiungere la funzione di "grado di regolazione", il che è senza dubbio una buona notizia per gli utenti che già indossano occhiali medicali.

Immagine: patentlyapple.com

In un altro brevetto, Apple ha indicato la distribuzione approssimativa dei componenti sulle aste. Grazie al design a doppia cerniera, la batteria degli occhiali è posizionata sul retro, mentre la metà anteriore dello spazio è principalmente riservata al display. Basandoci semplicemente sulle indicazioni di questo brevetto, il metodo di visualizzazione utilizzato dagli smart glass Apple potrebbe essere la proiezione riflettente o la guida d'onda ottica, o persino una combinazione dei due.

Immagine: patentlyapple.com

È interessante notare che nella seconda parte del brevetto, Apple ha menzionato l'interfaccia di trasmissione aggiunta all'estremità delle gambe degli occhiali, che può essere utilizzata per "collegare vari componenti esterni": a giudicare dal design dell'interfaccia con una struttura di bloccaggio e contatti esposti, gli occhiali intelligenti di Apple potrebbero supportare la comunicazione con un iPhone o un Mac sotto forma di connessione cablata mentre vengono indossati, il che può essere utilizzato in scenari che richiedono latenza, come giochi o video ad alta qualità.

Passando allo sviluppo di occhiali intelligenti, fonti interne hanno anche sottolineato che Apple ha cancellato i prodotti Apple Watch precedentemente pianificati e dotati di fotocamera, mantenendo solo gli AirPods con fotocamera, al fine di investire maggiori risorse negli occhiali intelligenti. Secondo le rivelazioni di Mark Gurman di marzo di quest'anno, Apple aveva pianificato di aggiungere fotocamere sotto lo schermo e nella corona intelligente dei futuri Apple Watch e Apple Watch Ultra, rispettivamente, per funzioni di riconoscimento ambientale basate sull'intelligenza visiva.

Tuttavia, nonostante la possibilità di utilizzare i propri chip, la funzione di realtà aumentata (AR) che Apple aveva precedentemente enfatizzato per Vision Pro potrebbe non essere implementata su questi occhiali intelligenti trapelati. Bloomberg ritiene che Apple avrà ancora bisogno di diversi anni per realizzare l'effetto AR che immagina.

Bloomberg ha anche sottolineato che, prima che l'insider diffondesse la notizia degli occhiali intelligenti, il prezzo delle azioni Apple era sceso di circa il 19% quest'anno, il che dimostra che le prestazioni di Apple nel campo dell'intelligenza artificiale, attualmente al centro dell'attenzione del settore tecnologico, sono piuttosto inosservate. Pertanto, possiamo ipotizzare che alla WWDC della prossima settimana, Apple annuncerà ufficialmente alcune delle informazioni sui prodotti intelligenti di cui si era già parlato. Potrebbe non trattarsi di un prodotto finito utilizzabile per la dimostrazione, ma è molto probabile che ci saranno tempistiche più precise.

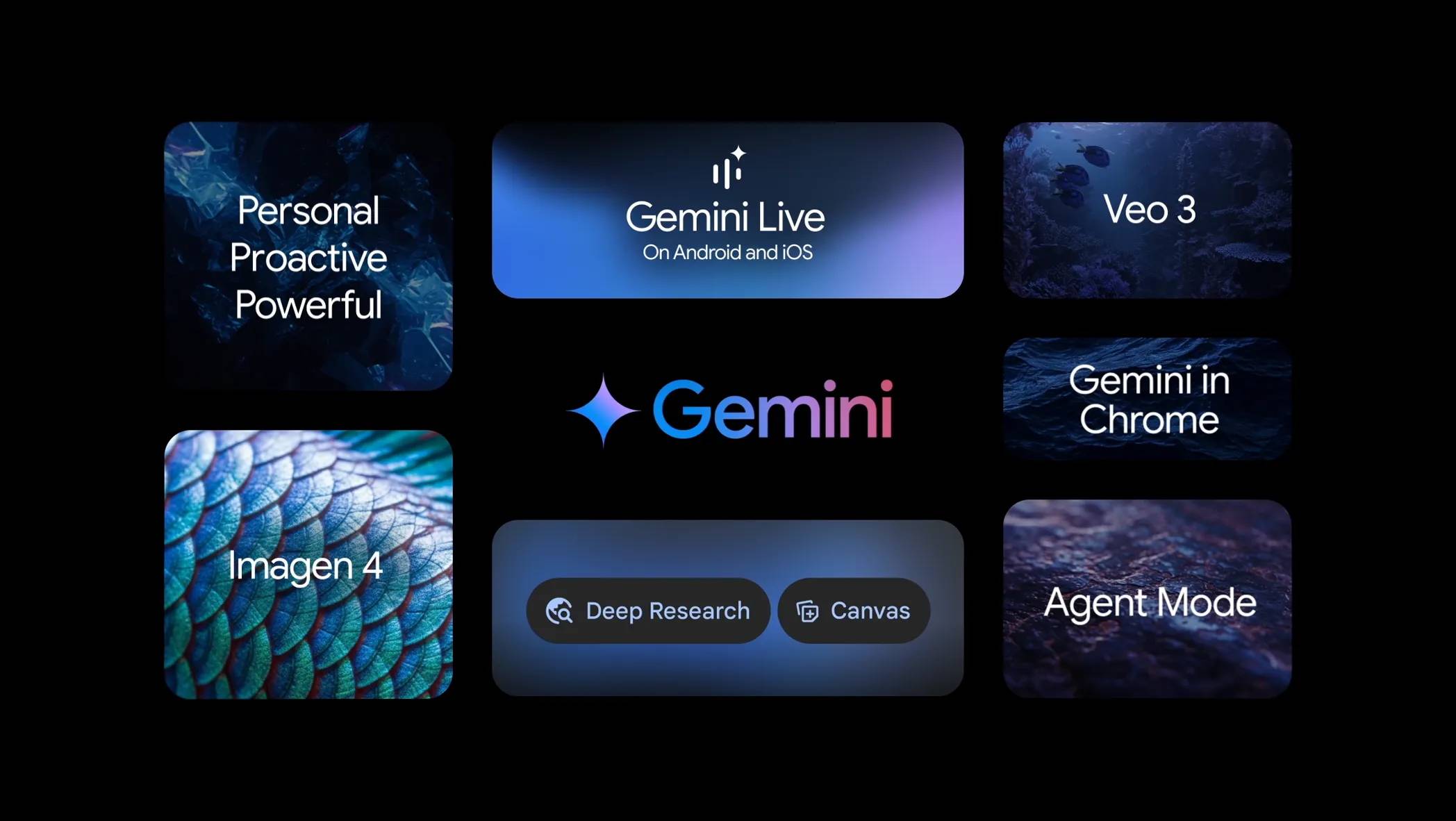

Google: seguendo la strada simbiotica, Gemini interviene pienamente nella linea di prodotti Google

Google, un altro colosso che ha mosso i primi passi nella competizione per l'intelligenza artificiale, ha ottenuto risultati particolarmente positivi dal 2025. Il suo modello Gemini è passato dal tenere a malapena il passo con ChatGPT a connettersi lentamente all'ecosistema di prodotti Google, e ora è diventato l'unico produttore sul mercato in grado di estendere le proprie linee di prodotto e fornire servizi di intelligenza artificiale full-stack. La velocità dei suoi progressi è difficile da ignorare per tutti i concorrenti.

Non è esagerato affermare che le attuali capacità di integrazione software e hardware dei servizi di intelligenza artificiale di Google abbiano di gran lunga superato quelle di Apple. Alla conferenza Google I/O appena conclusa, oltre a presentare l'aggiornamento del modello Gemini, Google ci ha anche presentato un prodotto con ecosistema ibrido basato sulla piattaforma Android XR, in collaborazione con l'azienda nazionale Xreal: Project Aura.

Project Aura ricorda molto i Google Glasses di dieci anni fa. Tuttavia, a differenza dei Google Glasses, il cui prodotto è stato interrotto dopo soli due anni, se le funzionalità presentate alla conferenza I/O potranno essere pienamente implementate nei prodotti di massa, allora l'affermazione di Google secondo cui "Android XR è la piattaforma Android creata nell'era Gemini" non sarà esagerata. È molto probabile che Android XR diventi il punto di riferimento per tutti i futuri prodotti di realtà estesa (Extended Reality, che include la realtà virtuale VR, la realtà aumentata AR e la realtà mista MR), proprio come Android lo è per i telefoni cellulari.

Dalla cerimonia di apertura del Google I/O, sempre più media hanno avuto l'opportunità di sperimentare Project Aura, e le linee generali del prodotto sono gradualmente diventate chiare. Diversamente dalla logica di Apple Vision Pro, gli occhiali di Project Aura sono solo un mezzo di interazione per gli utenti, e le funzionalità di calcolo e networking del modello Gemini Live sono ancora integrate nel telefono cellulare, il che, in una certa misura, lascia ampio spazio a futuri aggiornamenti di modelli e funzionalità.

Inoltre, c'è un'altra buona notizia. Con Android XR, Google porta avanti la tradizione di produrre telefoni Nexus e apre collaborazioni con molti produttori terzi con un atteggiamento molto aperto. Ad esempio, tutti gli occhiali Project Aura attualmente utilizzati per le dimostrazioni tecnologiche sono il risultato della collaborazione tra Google e Xreal. In seguito, Google ha annunciato che avrebbe collaborato con Gentle Monster, un marchio di moda giovanile del gruppo Essilor, e Warby Parker, un altro marchio emergente di occhiali incentrato sul concetto O2O, per lanciare Android XR sul mercato come prodotto di moda.

A giudicare dal dato che Meta Rayban ha venduto più di un milione di copie in un solo anno, nel 2024, la strategia di Google di "attraversare il fiume a tentoni con Meta" è senza dubbio molto promettente.

OpenAI: percorrere la strada dell'esplorazione, cercando di rendere i gioielli AI parte della vita quotidiana

Ciò che è ancora più intrigante è che poco prima che gli addetti ai lavori diffondessero la notizia che Apple avrebbe lanciato gli occhiali intelligenti, Sam Altman, CEO di OpenAI, il gigante dell'intelligenza artificiale dietro ChatGPT, ha appena annunciato di aver acquisito una startup chiamata io Products per 6,5 miliardi di dollari: si tratta dell'azienda che Altman aveva co-fondato con Jonathan Ive, il progettista dell'iPhone che aveva lasciato Apple.

Sul sito web ufficiale di OpenAI, Altman e Ive hanno annunciato in una lettera congiunta che, dopo l'acquisizione di io Products, diversi co-fondatori e ingegneri di io nel team saranno incorporati in OpenAI; Ive e la società di progettazione LoveFrom da lui fondata in precedenza continueranno a operare in modo indipendente, ma "si occuperanno del profondo lavoro di progettazione e creatività di OpenAI e io".

Ma OpenAI finora è stata un'azienda di software puro. Perché Altman ha investito così tante risorse per invitare Ive a unirsi a noi? Secondo la previsione di Ming-Chi Kuo, noto analista di Tianfeng International, lo scopo della cooperazione tra OpenAI e Ive è fornire una "nuova forma di dispositivo hardware di intelligenza artificiale" per il software di intelligenza artificiale. Questo hardware, responsabile del supporto dell'intelligenza artificiale, è diverso dal concetto convenzionale. Non si tratta di un dispositivo come un telefono cellulare o un altoparlante a cui siamo abituati, ma "il design è piccolo e raffinato come un iPod Shuffle".

In termini di configurazione, Guo Mingchi ipotizza che questo hardware OpenAI sarà dotato di una telecamera e un microfono per la percezione ambientale, ma non di una funzione di visualizzazione; inoltre, potrebbe dover essere collegato a dispositivi come telefoni cellulari o PC per funzionare, sfruttando la funzione di visualizzazione e la potenza di calcolo di telefoni cellulari o computer. In termini di utilizzo, Guo Mingchi ipotizza che uno dei modi per utilizzare questo nuovo prodotto con fattore di forma potrebbe essere quello di appenderlo al collo, un modo simile a quello in cui viene indossato il dispositivo di registrazione AI chiamato Pendant, lanciato da Limitless (ex Rewind):

Un modo per indossare il ciondolo Limitless

Si tratta di una forma di prodotto molto interessante. Se ci pensate attentamente, scoprirete che ci sono molti dispositivi intelligenti che "indossiamo" quotidianamente, come orologi, bracciali, cuffie e persino anelli, ma i ciondoli da collo sono un settore in cui pochi produttori sono coinvolti. A giudicare dalla tendenza attuale, l'obiettivo finale di tutti i prodotti di intelligenza artificiale è quello di interagire con il mondo reale. Ora potrebbe trattarsi di un dispositivo indossabile tradizionale come un orologio o degli occhiali, ma in futuro potrebbe essere un ciondolo da cui non si potrà mai staccare.

Concetti simili non sono inediti. Poco più di un anno fa, il mercato dei nuovi "dispositivi indossabili di intelligenza artificiale" ha vissuto un breve periodo di prosperità. In quel periodo, Humane AI Pin, Rabbit R1 e Limitless Pendant hanno ricevuto grande attenzione e risorse. Il mercato ha generalmente riconosciuto il concetto di prodotto, ovvero la creazione di hardware specificamente per l'intelligenza artificiale:

Tuttavia, la realtà che ci troviamo ad affrontare è molto desolante. Attualmente, modelli intelligenti in grado di soddisfare le esigenze di uso quotidiano sono ancora difficili da integrare in dispositivi più piccoli di un telefono cellulare e, indipendentemente dalla forma del prodotto, necessitano comunque di microfoni, altoparlanti, fotocamere e altri componenti hardware per interagire con il mondo reale. Il nuovo dispositivo che OpenAI intende creare questa volta non si discosta dall'essenza della necessità di connettersi a un dispositivo esistente per l'elaborazione. È difficile affermare che si tratti del leggendario "momento iPhone dei prodotti di intelligenza artificiale".

Finora abbiamo innumerevoli finestre attraverso le quali possiamo interagire con l'intelligenza artificiale: assistenti intelligenti per cellulari, occhiali intelligenti, motori di ricerca, altoparlanti intelligenti, dispositivi indossabili, ciondoli AI indipendenti e i "gioielli AI" concepiti da OpenAI: l'intelligenza artificiale che in origine era solo una stringa di codice sul disco rigido sta assumendo un corpo fisico poco a poco e la connessione tra il codice e la realtà si sta facendo sempre più stretta.

Tuttavia, sebbene i prodotti siano disponibili in forme diverse, una cosa rimane costante: i produttori si stanno impegnando a fondo per integrare sempre più sensori nel corpo umano. Anche questa è una domanda su cui dobbiamo iniziare a riflettere in questa "era pre-IA": come dovremmo convivere con l'intelligenza artificiale?

Indipendentemente da quale di queste bizzarre forme di prodotto tu preferisca, la privacy personale in futuro diventerà più preziosa che mai.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.