Una conversazione con il vicepresidente dei prodotti OS di vivo: l’intelligenza artificiale non creerà nuove esigenze; che si tratti di una carrozza trainata da cavalli o di una macchina a vapore che ci porta in luoghi lontani è una questione di forma del prodotto.

Se la prima metà dei sistemi operativi per smartphone si è concentrata sull'inserimento di funzioni in pulsanti e app, OriginOS 6, presentato quest'anno alla vivo Developer Conference, ha confermato ancora una volta la tendenza irreversibile all'integrazione tra intelligenza artificiale e sistema operativo.

Oltre alle parole d'ordine su PPT come multimodalità, capacità di ragionamento ed elaborazione di testi lunghi, l'intelligenza artificiale non si accontenta più di essere solo un "elenco di funzionalità" dei sistemi di telefonia mobile.

vivo ha proposto di creare un agente UI, cercando di far sì che l'intelligenza artificiale comprenda realmente le intenzioni dell'utente e completi l'intera collaborazione tra app con una richiesta naturale.

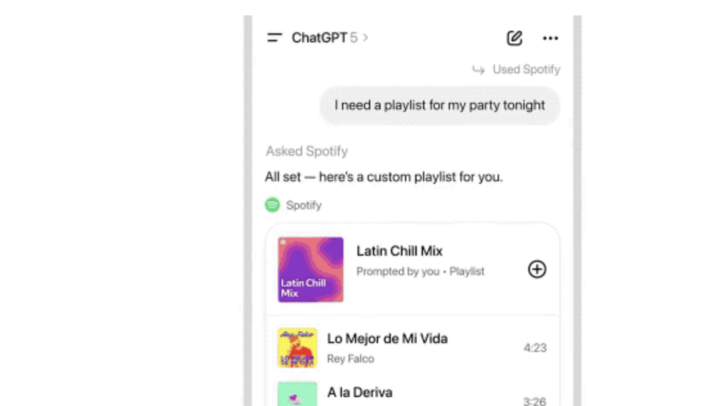

Per coincidenza, qualche giorno fa all'OpenAI DevDay si discuteva della stessa cosa: annunciare ChatGPT come "sistema operativo". In breve, Spotify e Canva vengono avviati automaticamente nelle conversazioni; un'unica dashboard consente interazioni immediate. La conversazione diventa l'applicazione e l'applicazione diventa l'interfaccia.

Quando il sistema operativo impara a comprendere gli esseri umani e quando il modello impara a pianificare le applicazioni, il confine tra IA e sistema operativo inizia a diventare ridondante. Finiranno per coincidere o si ramificheranno in un ecosistema completamente nuovo?

Dopo il discorso alla conferenza degli sviluppatori, iFanr e i media hanno intervistato Zhou Wei, vicepresidente dei prodotti vivo OS e preside dell'AI Global Research Institute, nonché Guan Yanbing, direttore generale dei prodotti vivo AI, e Huang Zixun, direttore dei prodotti AI OS.

Intelligenza artificiale e sistemi operativi: tendenze e divergenze

D: Quest'anno, diversi produttori parlano di "telefoni con intelligenza artificiale", ma i concetti sono diversi: intelligenza artificiale nativa, agenti intelligenti e sistemi operativi con intelligenza artificiale. Cosa ne pensi dell'attuale fase di esplorazione del settore dei telefoni con intelligenza artificiale?

Zhou Wei: In effetti, l'intelligenza artificiale e i telefoni cellulari sono sempre stati tre problemi che devono essere risolti.

Innanzitutto, dobbiamo disporre di capacità di modellazione su larga scala. Inoltre, abbiamo un ulteriore vantaggio rispetto ai leader del settore: dobbiamo essere in grado di sfruttare le capacità on-device. Senza questo, non siamo diversi dall'utilizzo dei servizi cloud nel settore. Inoltre, le capacità cloud o on-device devono essere personalizzate. Senza questo, sono solo capacità di uso generale. Personalizzazione e individualizzazione sono preziose, poiché tutti noi desideriamo che i nostri telefoni servano da assistenti e gestiscano i nostri impegni. Pertanto, scoprirete che sviluppare capacità legate al modello è essenziale. Questo è il primo livello e Vivo ha svolto un ottimo lavoro in questo ambito.

In secondo luogo, per quanto riguarda l'integrazione tra intelligenza artificiale e telefoni cellulari, dal mio punto di vista di "esperto di scienza e ingegneria", mi sto concentrando su due aspetti: 1. Le capacità dei sistemi di telefonia mobile che migliorano l'intelligenza artificiale . L'anno scorso abbiamo sviluppato capacità comuni (capacità di sistema) come "Writing to Ask" e "Image". Queste capacità sono essenziali per lo sviluppo di applicazioni. 2. Oltre a queste capacità, i produttori possono contribuire in molti altri ambiti. Gli utenti di telefoni cellulari utilizzano oltre 100 moduli e dobbiamo prima sviluppare queste capacità noi stessi. Li abbiamo organizzati in un "gruppo di infrastrutture di comunicazione e controllo" (centro notifiche, centro di controllo) e abbiamo un nostro motto. Tuttavia, quando gli utenti utilizzano i loro telefoni, i produttori di telefoni cellulari rappresentano solo il 15% del loro tempo. Il restante 85% proviene da servizi e capacità forniti dagli sviluppatori. Le principali aziende Internet, in particolare, rappresentano l'80% o il 70% di questo 85%, quindi il loro coinvolgimento è ancora molto significativo.

Quindi, la terza domanda è: cosa dovremmo fare con il restante 85% dei servizi di livello superiore? Abbiamo due cose da fare: primo, se sono disposti a collaborare con noi, allora possiamo sederci e discutere la soluzione. Secondo, con l'avvento dell'era dell'intelligenza artificiale, è necessario un nuovo livello di status e influenza? Possiamo rimandare la risposta a questa domanda per un po'.

Consideriamo l'integrazione tra intelligenza artificiale e telefoni cellulari come un processo che si sviluppa su tre livelli: il livello inferiore è costituito da modelli e funzionalità su larga scala, il livello intermedio è costituito dalla creazione di funzionalità di sistema fondamentali e dalle funzionalità di base . Per quanto riguarda le applicazioni di livello superiore, noi, come produttori e terze parti, siamo divisi in due gruppi. Chi è disposto a partecipare, come Alibaba, prenderà l'iniziativa, mentre chi non lo è sarà lasciato al tempo. Questo è il modo in cui affrontiamo e gestiamo le problematiche relative all'integrazione tra intelligenza artificiale, telefoni cellulari e agenti.

D: Qualche giorno fa, OpenAI ha annunciato il suo piano per lo sviluppo di un sistema operativo. Uno dei principali sviluppi è il suo approccio "conversazione come applicazione", che ci consente di accedere direttamente alle funzionalità di app come Figma e Spotify all'interno di ChatGPT. Sappiamo che i telefoni cellulari rappresentano una porta d'accesso cruciale all'era di Internet e molti si chiedono se diventeranno un punto di accesso chiave alle enormi conversazioni sull'intelligenza artificiale del futuro. Come produttore di telefoni cellulari, cosa ne pensi di questa tendenza, Vivo?

Huang Zixun: Come produttori di telefoni cellulari, abbiamo una prospettiva diversa da aziende come ChatGPT. Da un lato, abbiamo assistenti AI come Blue Heart Xiao V, che sono effettivamente applicazioni e funzionalità conversazionali, e dobbiamo continuare a sviluppare questo aspetto.

D'altro canto, quando gli utenti utilizzano i loro telefoni cellulari, ad esempio, apriranno l'applicazione del telefono quando devono effettuare una chiamata e apriranno l'applicazione taxi quando devono prendere un taxi. In questo caso, non vi è alcuna necessità deliberata di utilizzare il dialogo per risolvere il problema. Ad esempio, il framework di intenti dell'intero sistema può soddisfare più rapidamente la richiesta dell'utente all'applicazione, o persino la richiesta all'agente di terze parti. Questo è ciò che riteniamo sia l'approccio più appropriato.

Ad esempio, i servizi attualmente consigliati tramite Atomic Island potrebbero essere interfacce di servizio o portali, ma potrebbero anche gradualmente trasformarsi in agenti di terze parti. È necessario utilizzare il dialogo per facilitare questi agenti? Non necessariamente, poiché gli utenti attualmente si affidano in larga misura all'interazione gestuale basata su GUI quando utilizzano i sistemi operativi. Pertanto, dal punto di vista del sistema operativo, la considerazione chiave è come gli utenti possano accedere ai servizi in modo più rapido e pratico in diversi scenari, indipendentemente dal fatto che il servizio sia un'interfaccia diretta o trasmesso tramite un agente.

Infatti, rafforzeremo anche l'approccio conversazionale in Blue Heart V e combineremo persino l'interazione attiva con l'interfaccia per consentire agli utenti di ottenerlo più velocemente.

Guan Yanbing: Penso che ci siano alcune differenze tra l'ecosistema nazionale e quello estero. ChatGPT supporta COS, Spotify e software di disegno come Figma. Ha una base ecologica all'estero, ed è effettivamente un po' diverso in Cina.

In secondo luogo, non credo che si tratti di una questione binaria, di 0 o 1. Ad esempio, gli assistenti AI come Blue Heart Xiao V, come accennato nella conferenza stampa di questa mattina, eccellono nel soddisfare le esigenze personalizzate degli utenti. Nelle app tradizionali o nell'ecosistema Internet, ad esempio, l'interfaccia di un'app tradizionale ha le dimensioni di un telefono, con spazio per 10 o 15 pulsanti. Tuttavia, c'è sempre un gran numero di utenti che necessitano di più di quei 10 o 15 pulsanti, e queste esigenze non possono essere soddisfatte. In realtà, queste esigenze sono molto long-tail e personalizzate, il che le rende adatte a essere soddisfatte dagli assistenti AI.

Stamattina è stato presentato un esempio dimostrativo del tipo "converti questa immagine in stile Pixar e impostala come sfondo". Questo tipo di richiesta a lungo termine non sarebbe soddisfatta dalle app tradizionali, ma è molto adatta agli assistenti AI perché è molto personale e personalizzabile.

Riteniamo che questo ecosistema possa raggiungere in futuro una fase in cui non si limiterà più all'ecosistema delle app o all'accesso al traffico. Non è una cosa assoluta. Tutto si riduce alle esigenze degli utenti. In questa fase, alcune esigenze degli utenti sono meglio soddisfatte dagli assistenti AI e dai chatbot, che soddisferanno meglio le loro esigenze.

Zhou Wei: Le applicazioni che utilizzano modelli di grandi dimensioni stanno fiorendo. Ci stiamo concentrando sia sullo sviluppo di capacità che sull'esercizio di moderazione in questa situazione. Non possiamo evitare di sviluppare le abitudini degli utenti e di distribuire i servizi. La nostra strategia futura sarà probabilmente quella di sviluppare prima le capacità e poi collaborare con i partner per raggiungere questo obiettivo. Incoraggiamo i fornitori di servizi che hanno dubbi ad aspettare e ad esercitare moderazione.

Sviluppo di modelli end-to-end e capacità

D: Oggigiorno, tutti i produttori stanno sviluppando modelli di dispositivi su larga scala e quasi tutti stanno anche valutando lo sviluppo di assistenti personali. In che modo il concetto di "UI Agent" di vivo si differenzia dagli assistenti AI di altri produttori?

Guan Yanbing: Stamattina abbiamo detto che abbiamo scelto l'intelligenza personalizzata. Non tutti i fornitori offrono l'intelligenza personalizzata. Riteniamo che l'intelligenza personalizzata abbia diverse caratteristiche:

Innanzitutto, è come un amico o un partner . Pertanto, una delle nostre competenze principali è il lato dispositivo, perché solo il lato dispositivo può analizzare costantemente i tuoi dati, comprendere le tue esigenze, percepire lo schermo del telefono e così via. In effetti, non tutti i produttori di telefoni cellulari dispongono di capacità lato dispositivo. Come tutti hanno appena detto, siamo relativamente forti in questo settore.

In secondo luogo, offriamo un'interazione naturale realmente multimodale, che include interazione vocale, percezione di schermo e immagini abilitata da agenti UI e interazione testuale. L'interazione multimodale garantisce un'interazione più naturale, come quella di una persona reale che interagisce con te. Questi sono i nostri due principali fattori di differenziazione e vantaggi rispetto ad altri fornitori. Questi due vantaggi garantiscono che i nostri prodotti siano sempre disponibili sul tuo telefono, offrendoti servizi personalizzati in base alle tue esigenze.

D: Quali condizioni sono necessarie per un agente di intelligenza artificiale ideale? Quali sono già presenti?

Zhou Wei: I telefoni cellulari sono tradizionalmente il principale canale di distribuzione per le app. L'intero settore è molto sensibile ai limiti e all'autorità degli store di software. La distribuzione nell'era degli agenti intelligenti è una questione altrettanto delicata. La cultura aziendale di Vivo valorizza il successo e lo sviluppo condivisi, quindi, come canale di telefonia mobile, speriamo di esercitare moderazione e collaborare nella futura distribuzione di agenti intelligenti.

Cosa si può e cosa non si può fare? Innanzitutto, ci auguriamo che gli agenti intelligenti implementino tutto ciò che le funzioni e i sistemi telefonici nativi consentono. In secondo luogo, l'Agent Store per questi agenti intelligenti, incluso il framework per l'intelligenza personalizzata, è responsabilità dei produttori della piattaforma. Quindi, tutto questo lavoro è già in atto.

Tuttavia, la comunicazione tra agenti e tra agenti è uno sforzo collaborativo che coinvolge l'intero settore, con gli sviluppatori, principalmente i fornitori di servizi Internet, che svolgono un ruolo chiave. Di fronte a questa sfida, speriamo di collaborare a questo sviluppo. Per quanto riguarda la distribuzione di agenti per applicazioni Internet, speriamo di collaborare e collaborare su questo aspetto. Non è che non possiamo farlo, ma piuttosto che si tratta di una questione di vantaggio condiviso per il settore, e vivo deve assumersi le proprie responsabilità.

D: Le cosiddette capacità degli agenti di intelligenza artificiale degli smartphone attuali sono in realtà un po' lontane dalla definizione generale di capacità. Questo perché ogni app potrebbe operare in silos, senza condividere i dati sottostanti con i produttori di telefoni. Alcuni produttori ricorrono a metodi indiretti come le funzionalità di accessibilità per identificare le schermate. Questo rappresenta un ostacolo importante?

Zhou Wei: I tuoi sentimenti oggi sono gli stessi dei nostri. Quando i dispositivi intelligenti, in particolare quelli automatici sui telefoni cellulari, devono svolgere compiti, possiamo solo eseguire le funzioni e le applicazioni del produttore. Ad esempio, non ci sono problemi nel mostrare se è fluido, regolare la luminosità e connettersi al Wi-Fi. Tuttavia, se si desidera utilizzare applicazioni incrociate, l'altra parte sta attualmente discutendo gli standard di autorizzazione di sicurezza con i produttori di terminali.

Come produttori di dispositivi, crediamo che, in primo luogo, dobbiamo promuovere attivamente la definizione di standard di settore. In secondo luogo, la tecnologia AI ha ancora diversi anni di tempo per maturare. Quest'anno abbiamo annunciato con generosità il riconoscimento automatico e il funzionamento basati sull'interfaccia utente mobile. Queste funzionalità si svilupperanno sempre di più ogni anno. Se un giorno il settore di Internet avrà bisogno che i produttori collaborino con gli utenti, saremo naturalmente la scelta ideale.

Credo che ci siano molte aziende nel settore internet che stanno perseguendo generosamente questo approccio e stanno tutte collaborando con noi su questo fronte. Ci sono anche molte persone preoccupate per i limiti che verranno stabiliti in futuro. Per molte di queste aziende, crediamo che il tempo lo dirà.

D: Qual è lo stato attuale della cooperazione di vivo con i principali produttori nazionali per Agent?

Guan Yanbing: vivo sta collaborando con molti grandi produttori con una mentalità relativamente aperta, tra cui AutoNavi, Baidu e Alipay di Ant. Abbiamo già una vasta collaborazione oggi. In futuro, OS6 verrà gradualmente lanciato su molti agenti nel prossimo mese. Lo accettiamo con mentalità aperta. Crediamo che non ci sia una soluzione bianca o nera. Ciò non significa che non si possa continuare a fare affari tradizionali una volta che l'agente è stato chiuso.

D: L'anno scorso, vivo stava ancora discutendo del modello super-large da 175B, ma ora l'attenzione si è spostata sull'intelligenza artificiale edge 3B. Perché?

Zhou Wei: L'anno scorso abbiamo implementato i modelli lato client 13B e 7B. Alla fine, abbiamo scoperto che solo il modello 7B era pronto per la produzione. Tuttavia, il modello 7B non funzionava bene sui telefoni cellulari, poiché occupava molta memoria. Quest'anno, abbiamo scoperto che il modello 3B ha funzionato molto meglio.

Perché abbiamo questa scelta? Perché non abbiamo ancora aperto la scatola. Per capire cosa fa il modello lato client sul telefono, dobbiamo prima identificare cosa sta succedendo sul telefono.

Innanzitutto, riconosce costantemente le varie azioni che le persone eseguono sui loro telefoni. Ad esempio, solo i telefoni Vivo possono farlo. Se cerchi un'icona, scorri per selezionare una riga di testo o selezioni tutto in una pagina, noterai che su Vivo Atomic Island apparirà qualcosa che risponde. Questo è il riconoscimento dell'intento, ed è possibile sul lato dispositivo. E siamo gli unici in grado di farlo, perché disponiamo di un modello integrato che analizza le tue azioni in tempo reale. Ad esempio, questo indirizzo in una nota è destinato alla navigazione o all'aggiunta a un calendario? Il nostro modello integrato identifica l'intento in tempo reale. Ciò significa che il telefono è completamente integrato con un'ampia gamma di attività, tra cui l'identificazione dell'intento e la suddivisione delle attività. Prevediamo di rilasciare questa funzionalità al settore nel 2024. Ci auguriamo che alcune cose richiedano esperienza per acquisire conoscenze e fare le scelte giuste.

Quando abbiamo fatto una scelta chiara quest'anno, non significava che ci concentrassimo esclusivamente sui modelli da 3 miliardi. In effetti, abbiamo lavorato su molti modelli da 1 miliardo. La tua domanda precedente chiedeva se avremmo smesso di lavorare su modelli da 17,5 miliardi, 100 miliardi o 70 miliardi. No, è perché i modelli più grandi di quest'anno sono più potenti di quelli dell'anno scorso, che a loro volta erano più potenti dell'anno precedente. Abbiamo scoperto che le funzionalità basate sul cloud sono relativamente facili da sviluppare; la vera sfida sta nello sviluppo di funzionalità lato dispositivo.

Il modello di quest'anno, con 70 miliardi di parametri (70 miliardi), è più potente dei 175 miliardi di parametri dell'anno scorso. Il nostro modello da 3 miliardi è più potente del precedente modello da 10 miliardi, ed è già più potente del modello con oltre 100 miliardi di parametri nel 2023. È già in grado di soddisfare la scomposizione delle attuali attività end-side e delle attività complesse. Non perché abbiamo rinunciato al cloud, ma perché è diviso in due fasi: il cloud è il cloud e la fine è la fine. Le capacità del cloud sono relativamente facili da implementare.

Ci sono due argomenti sui grandi modelli oggi. Uno è la scomposizione del ragionamento quotidiano e dei compiti complessi; l'altro è l'intelligenza artificiale generale . I media sostengono ora che l'era dell'intelligenza artificiale generale non è ancora arrivata. In realtà, la scomposizione di compiti complessi, l'acquisizione e il perfezionamento della conoscenza possono già soddisfare le nostre esigenze.

In quanto produttori di telefoni cellulari, la nostra esplorazione e richiesta di intelligenza artificiale deve essere più proattiva. Ciò significa analizzare l'intento dell'utente e le attività quotidiane sia nei settori B2B che B3B. Dovremmo sfruttare i modelli lato dispositivo per il middleware, la percezione e l'esecuzione. Tuttavia, sembra che i media raramente affrontino questa categorizzazione quando discutono di modelli di grandi dimensioni. Dopotutto, come produttori di dispositivi, è difficile per noi avviare tali discussioni sui media.

D: Quali sono le principali innovazioni del modello 3B?

Zhou Wei: Il problema principale del 7B era che richiedeva 3,5 GB di memoria. 8 GB è la configurazione standard per i telefoni di fascia media e alta, inclusi i modelli di punta. Un modello di grandi dimensioni occupa 4 GB di lato, lasciando solo 4 GB di memoria. 4 GB è ora la configurazione standard per i telefoni di fascia bassa, il che trasforma istantaneamente i telefoni di fascia alta in telefoni di fascia bassa. Questo è stato il primo problema che abbiamo dovuto risolvere.

Il secondo problema che dobbiamo affrontare è che il modello 7B può eseguire solo una semplice scomposizione dei task e non può eseguire ragionamenti complessi. Ad esempio, se chiedi: "Per favore, aiutami a trovare il volo più economico da Pechino a Shenzhen alle 16:00 di oggi?", potresti dover scaricare tre o quattro servizi di vendita biglietti e confrontare i prezzi.

Scoprirete che analizza anche quale app, il prezzo di quale app e quale compagnia aerea utilizzo. Questo è un problema complesso. Il modello 7B dell'anno scorso non era in grado di farlo. Il modello 3B di quest'anno supera di gran lunga il modello 7B dell'anno scorso. E tutte le classifiche includono anche modelli con modelli 8B, che sono più efficaci dei modelli 7B. Abbiamo valutato quasi tutti i modelli di ragionamento 8B che abbiamo trovato a livello globale, e il nostro modello 3B li supera di gran lunga in termini di ragionamento, sintesi induttiva e capacità di scomporre compiti complessi.

Abbiamo risolto due problemi: in primo luogo, il modello end-side 3B occupa solo 2 GB di memoria, il che non influisce sulle prestazioni dei dispositivi di fascia alta. Abbiamo risolto questo primo problema. In secondo luogo, abbiamo notevolmente migliorato la capacità di ragionamento, consentendone quasi l'installazione sul telefono cellulare come piattaforma intermedia per il controllo degli intenti e la scomposizione dei task. Entrambi i problemi sono stati risolti.

In realtà, ci sono altri problemi. Ad esempio, questa volta ci preoccupiamo molto anche delle funzioni. Quest'anno abbiamo raggiunto i 200 token. L'anno scorso ne abbiamo raggiunti circa 80, e quest'anno abbiamo raggiunto direttamente i 200 token. 200 token sono già un risultato impressionante. Di solito, quando guardiamo uno schermo che pronuncia le parole, pensiamo che sia accettabile se ne ha circa 26. Abbiamo raggiunto direttamente i 200 token, il che dimostra che l'efficienza dell'output di parole sul lato terminale è decollata e non ci sono ostacoli in questo senso.

C'è un'altra funzionalità che potresti non aver notato, ma che in realtà è davvero rivoluzionaria. Prima di DeepSeek, esisteva un modello di grandi dimensioni chiamato "Dark Side of the Moon", la cui caratteristica principale erano i token lunghi, che abbiamo implementato anche questa volta. Si tratta di un'enorme svolta e abbiamo fatto un lavoro eccellente. Tuttavia, essendo così nuovo, potrebbero volerci altri sei mesi prima che gli utenti ne vedano i vantaggi. Quindi la tua domanda ha appena menzionato alcune delle cose su cui abbiamo lavorato quest'anno. Abbiamo implementato i token lunghi sul lato dispositivo. Abbiamo aumentato la memoria da 4 GB a 2 GB e abbiamo raggiunto velocità di output di 200 token. Abbiamo anche migliorato le nostre capacità di inferenza e abbiamo implementato tutto sui telefoni cellulari. Pertanto, il System 6 originale del 2025 ci dà dai tre ai sei mesi per sperimentare sorprese inaspettate in termini di funzionalità.

D: L'open source di DeepSeek ha qualche impatto su di te?

Zhou Wei: Ci ha influenzato. Ci siamo resi conto di questo problema nel 2024, quando stavamo lavorando a un modello in scala da 175 miliardi. Lo stavamo ridimensionando, essenzialmente utilizzando un modello a matrice. Tuttavia, ci siamo resi conto rapidamente che anche un cluster da 10.000 carte non sarebbe stato sufficiente. Dovevamo costruire cluster da 20.000 o più carte, e questo da solo avrebbe richiesto oltre 2 miliardi di attrezzature, e non era ancora sufficiente. A questo ritmo, ritenevo irrealistico ampliare l'intelligenza artificiale in generale.

Come tutti sappiamo, molte startup nel settore della modellazione su larga scala in Cina sono in difficoltà. Questo perché raccogliere decine di miliardi di yuan per costruire un modello da 400 miliardi di parametri potrebbe richiedere una spesa di 5 miliardi di yuan in potenza di calcolo. Di questi 5 miliardi di yuan, un terzo, ovvero circa 1,5 miliardi di yuan, è costituito dall'elettricità. Questo costo è aggravato dalla bolletta elettrica annuale, rendendolo insostenibile.

Quando DeepSeek è uscito, ha immediatamente convinto tutti con le sue capacità di modellazione multimiliardarie. DeepSeek ha ottenuto risultati straordinari, era completamente open source e ci ha permesso di implementarlo completamente. Blue Heart V di Vivo, che include un modello deep-thinking, è essenzialmente una versione completa di DeepSeek. Questo ci ha dato la certezza di poter acquisire immediatamente eccellenti modelli su larga scala.

Quali sono i vantaggi per le aziende come la nostra che sviluppano autonomamente i propri modelli? Ci aiuta con l'apprendimento della distillazione 7B e 3B. Credo che DeepSeek sia un enorme aiuto e un miglioramento per le aziende come la nostra che hanno bisogno sia di addestrare che di ottimizzare i modelli.

D: Perché abbiamo ancora bisogno di 1B? Qual è il suo ruolo nel sistema lato client?

Zhou Wei: Grazie a DeepSeek per aver migliorato significativamente le capacità di ragionamento del settore negli ultimi due anni. L'anno scorso, abbiamo persino sviluppato un modello 13B perché il modello 7B non era in grado di gestire molte attività di ragionamento complesse, quindi speravamo di lanciare un modello 13B. Tuttavia, quest'anno, abbiamo scoperto che il modello 3B ha superato la nostra definizione originale di 13B, consentendo molte previsioni che in precedenza erano limitate a modelli su dispositivo leggermente più grandi. Abbiamo deciso che sarebbe stato sufficiente lavorare sodo sul modello 3B. Oggi ho anche parlato di riepilogo e generazione di testo. Il modello 3B copre già circa il 97%-98% delle funzionalità basate su cloud, rendendo la differenza quasi impercettibile. È più che sufficiente.

Perché usare 1B? Abbiamo scoperto che molti elementi nei telefoni cellulari devono essere configurati in modo permanente. L'applicazione di modelli di grandi dimensioni sul lato terminale dei telefoni cellulari è molto più ampia di quanto immaginassimo. C'è sempre un modello di grandi dimensioni in esecuzione nel telefono.

Qualche tempo fa ho visitato diversi rinomati laboratori di robotica umanoide in Cina. Lavoriamo anche sui robot e, nel campo dell'intelligenza incarnata, abbiamo un modello di grandi dimensioni sempre in funzione. Come ho detto stamattina, il modello 3B consuma 750 mA quando è in funzione, il che è insopportabile. Anche con questo consumo energetico, continua a consumare. Quindi, cosa possiamo fare? Utilizziamo un sistema a impulsi. A volte lo si usa, a volte no. Quando serve, si attiva, ma il più delle volte non è in uso. Nel complesso, consuma solo poche ore al giorno, il che è del tutto abbordabile. È molto più efficiente dal punto di vista energetico rispetto a giocare o scattare foto.

Tuttavia , esistono anche requisiti che richiedono dati online 24 ore su 24, 7 giorni su 7, come i limiti di indirizzo, il comportamento e i parametri di sistema, che sono sempre online. Questo richiede il modello 1B. Questo modello 1B non riguarda capacità di ragionamento complesse, ma piuttosto il monitoraggio in tempo reale e la memoria della macchina locale. Pertanto, siamo piuttosto aggressivi nel modello 1B, ma è strettamente riservato ai telefoni cellulari e raramente "distribuito" o comunicato esternamente.

Esperienza e filosofia

D: Esiste già una tendenza a far pagare le funzioni di intelligenza artificiale basate su cloud dell'X300. Come verranno determinati i limiti della tariffazione per le funzioni di intelligenza artificiale basate su cloud?

Zhou Wei: Abbiamo un principio: Vivo si concentra fortemente sull'integrazione on-device. Il riconoscimento delle immagini, il riconoscimento vocale e, in futuro, l'interpretazione simultanea e il riconoscimento dei dialetti sono tutti on-device, e questa integrazione è sicuramente gratuita. Tuttavia, l'integrazione on-device presenta una sfida: la piattaforma deve disporre di potenza di calcolo e memoria sufficienti, almeno 8 GB o più. Questo presenta immediatamente un altro problema: se gli utenti dispongono solo di dispositivi di fascia bassa da 4 GB e hanno bisogno di utilizzarli, potrebbero ricorrere a funzioni basate sul cloud. Le funzioni basate sul cloud, in un certo senso, comportano costi significativi, quindi potremmo prendere in considerazione la condivisione dei costi. Credo che questa sia una tendenza.

D: I produttori di telefoni cellulari spesso cadono nella trappola di creare una checklist di funzionalità di intelligenza artificiale durante lo sviluppo dell'IA. Gli utenti generalmente lamentano che le funzionalità di intelligenza artificiale siano troppo numerose e complesse. Come fa vivo a determinare se una funzionalità è davvero preziosa?

Huang Zixun: Abbiamo internamente un termine per l'esperienza dell'IA chiamato "incoscienza". Sebbene l'IA possa sembrare potente, la sua penetrazione non è ancora diffusa, il che, in una certa misura, crea notevoli difficoltà per gli utenti nel comprenderne il funzionamento. Pertanto, ci sforziamo di ridurre al minimo la necessità di premere un pulsante per attivare o utilizzare l'IA. Adottiamo invece un design fluido. Ad esempio, quando salvo un file, se inizio a registrare, la messa in pausa o l'interruzione della registrazione attivano automaticamente le funzionalità dell'IA, generando un nome per l'IA. Definiamo questo come "IA incosciente".

Utilizza infatti il modello 3B edge-side di cui tutti hanno parlato. Abbiamo anche apportato numerose ottimizzazioni, tra cui la messa a punto della pianificazione delle prestazioni e del consumo energetico durante il funzionamento. Il nostro design elimina la necessità per gli utenti di interagire con queste funzionalità, consentendo loro di accedervi in modo naturale all'interno dell'interfaccia utente e del flusso di lavoro esistenti, sostituendo i tradizionali processi manuali di chiamata e modifica con funzionalità di intelligenza artificiale.

L'anno scorso, abbiamo proposto di ricostruire l'esperienza di sistema. Non abbiamo deliberatamente modificato la logica di business né abbiamo re-insegnato agli utenti come utilizzare il sistema operativo o i telefoni dotati di intelligenza artificiale. Piuttosto, nel flusso di lavoro originale dell'utente, quando raggiungiamo un certo punto, crediamo che l'intelligenza artificiale preveda che l'utente si troverà di fronte a questo scenario e avrà bisogno di utilizzare tale funzione, e che possiamo ottenere questo risultato in modo naturale. Questo è ciò che abbiamo sempre perseguito nella progettazione del sistema operativo, ovvero un'intelligenza artificiale "inconscia".

Abbiamo anche condotto alcuni test e scoperto che quando un pulsante visualizza una funzione di intelligenza artificiale, la maggior parte degli utenti si chiede: di cosa si tratta esattamente, acquisirà i loro dati o porterà a conseguenze inaspettate? Pertanto, evitiamo di creare nuove funzionalità o scenari durante questo processo. Quando integriamo l'intelligenza artificiale e il sistema operativo, ci impegniamo a tornare alle abitudini degli utenti esistenti, mantenendo il flusso di attività esistente e completandolo nel modo più naturale e fluido possibile. Questo è il principio fondamentale dell'"inconsapevolezza" a cui aderiamo in tutta l'esperienza del sistema operativo.

D: Come bilanciare la stabilità del sistema operativo e la rapida iterazione dell'intelligenza artificiale?

Zhou Wei: Come tutti sanno, nel corso degli anni il nostro team di intelligenza artificiale ha dovuto affrontare sfide gestionali interne, tra cui una notevole pressione durante la distribuzione. Credo che le istruzioni di Shen Wei al team di intelligenza artificiale siano piuttosto accurate: l'intelligenza artificiale non creerà nuove esigenze. Per noi, l'industria della telefonia mobile, dovremmo sfruttare l'intelligenza artificiale per rendere i telefoni cellulari più intuitivi. Se tornassimo a questa aspirazione originaria, il nostro lavoro sarebbe probabilmente più facile da realizzare.

Tornando al team, poiché abbiamo dalle duemila alle tremila persone nel software e più di mille persone nell'intelligenza artificiale, compresi coloro che sono responsabili della cognizione e della pianificazione, spesso pensiamo di essere entrati nell'era dell'intelligenza artificiale e che in quest'epoca epocale dobbiamo creare qualcosa di completamente nuovo e rivoluzionario. Molti dei miei amici intorno a noi ritengono che l'arrivo dell'intelligenza artificiale sarà sicuramente epocale, proprio come la macchina a vapore e la carrozza trainata da cavalli.

Penso che il problema più grande con la stabilità del sistema e la natura dirompente dell'IA sia che dobbiamo tornare a usare una carrozza trainata da cavalli per viaggiare lontano, che è un mezzo di trasporto. Che si utilizzi una macchina a vapore o una carrozza trainata da cavalli, è la forma del prodotto.

Oggigiorno, siamo abbastanza a nostro agio nell'utilizzare la combinazione di intelligenza artificiale e telefoni cellulari. Cosa sta cambiando? Cosa rimane invariato? Ciò che rimane invariato è l'integrazione tra intelligenza artificiale e sistema operativo. C'è un detto: "L'intelligenza artificiale delle funzioni di sistema". Stiamo assistendo a un'impennata di chiamate telefoniche, assistenti telefonici, album fotografici, note e altre funzioni basate sull'intelligenza artificiale. Si tratta di miglioramenti alle funzioni tradizionali. Cosa sta cambiando? Credo che si tratti anche di un cambiamento nelle esigenze originali.

Ad esempio, quando cerchiamo una parola o un'app, perché dobbiamo indovinare l'intento? Questo intento appare solo su Atom Island, AutoNavi Maps o Note. Dovremmo inviarmelo per l'archiviazione o salvarlo su Pinduoduo o Taobao per la ricerca? Scoprirai che le esigenze degli utenti non sono cambiate. Utilizziamo semplicemente l'intelligenza artificiale per determinare l'intento e prevedere il tuo comportamento. Se vuoi davvero abbandonare un'app, potremmo semplicemente aiutarti a sbarazzartene. Utilizziamo semplicemente l'intelligenza artificiale per renderlo più comodo, facile da usare e più intuitivo. Il telefono rimane lo stesso, senza l'aggiunta di nuove funzionalità. Ciò che è cambiato è che le funzionalità esistenti sono state ripensate e rese più fruibili.

Dopo averci pensato in questo modo, ritengo che il nostro comportamento, il nostro modo di pensare, la nostra cognizione e la nostra pianificazione dei prodotti negli ultimi due anni siano stati coerenti. Nel 2023, mi sento coerente e sento che è arrivata una nuova era. Faremo qualcosa di epocale e sovversivo. All'epoca, eravamo estremamente incoerenti, sia nella comunicazione esterna che in quella interna. Siamo stati confusi per più di un anno, ma da quest'anno siamo molto coerenti e sappiamo molto chiaramente cosa stiamo facendo.

D: Qual è la vostra strategia complessiva per l'era dell'intelligenza artificiale? Avete appena detto che l'attenzione strategica si sta spostando verso l'end-side. Come verrà ripartita l'attuale capacità di formazione cloud?

Zhou Wei: Poiché siamo un'azienda focalizzata sui dispositivi intelligenti, non sull'intelligenza artificiale in generale, la nostra strategia rimane focalizzata su ciò che dovremmo fare come azienda. La nostra strategia di intelligenza artificiale è in linea con le esigenze della nostra azienda e continuiamo a concentrarci sull'intelligenza personale. L'anno scorso, un marchio ha ideato una descrizione completa chiamata "Blue Heart Intelligence". Blue Heart Intelligence rappresenta l'intelligenza personale, un concetto ancora vago e generico. Si può immaginare come un "assistente personale VIP" per gli utenti.

Se stai cercando un assistente, potresti averne uno che ti aiuti a gestire i tuoi impegni, ma probabilmente non sarai in grado di svolgere il ruolo di assistente legale, assistente alla dichiarazione dei redditi o assistente al trading azionario. Chi si occupano di queste persone? Studi finanziari e legali lo stanno facendo. Ad esempio, ci sono assistenti specializzati nella redazione di brevetti: si tratta di "assistenti dedicati". Il nostro obiettivo è trasformare il tuo telefono nel tuo assistente personale. Mentre la compagnia telefonica potrebbe gestire aspetti che ti riguardano personalmente, altri servizi "dedicati" richiedono una piattaforma dedicata. Stamattina ho anche accennato al nostro desiderio di colmare il divario tra servizi dedicati e utenti, avvicinando gli assistenti dedicati agli utenti. Stiamo lavorando sulla componente generale dell'assistente. Questa è la nostra strategia globale.

D: Vivo sta sviluppando anche occhiali AR e VR. La MR/AR sarà connessa all'agente di telefonia mobile?

Zhou Wei: A proposito di agenti, in realtà ci sono molti servizi nel settore che esistono da molto tempo. Non sono una novità. Perché improvvisamente vengono chiamati agenti intelligenti dopo l'avvento dei grandi modelli? Perché possono percepire i cambiamenti intorno a noi, comprendere le nostre intenzioni e aiutarci a prendere decisioni, il che consente loro di connettere automaticamente i servizi. È a causa di questo cambiamento che vengono chiamati agenti intelligenti.

Il servizio originale esiste ancora naturalmente, ma è l'aggiunta di questi quattro passaggi che lo ha trasformato in un'entità intelligente. Tuttavia, questa entità intelligente è ormai comune e ampiamente utilizzata in tutto il settore. Perché le compagnie di telefonia mobile devono ancora rispondere a questa domanda? Perché le compagnie di telefonia mobile conoscono a fondo le abitudini personali dei loro utenti. Condividendo queste caratteristiche personalizzate con fornitori di servizi terzi, con l'autorizzazione degli utenti, le loro entità intelligenti diventano immediatamente più potenti.

Quindi i produttori di telefoni cellulari hanno creato valore in questo senso. Stiamo costruendo piattaforme e framework di supporto per il settore. I produttori di telefoni cellulari hanno un'identità aggiuntiva. Forniscono servizi al settore e i telefoni possono anche avere funzioni come chiamate, programmazione e messaggi di testo. Quindi svolgiamo queste due attività contemporaneamente.

D: Quindi prenderemo in considerazione anche l'integrazione tra dispositivi con dispositivi MR?

Zhou Wei: La differenza principale tra i dispositivi MR e i telefoni cellulari è che si utilizza una fotocamera per vedere il mondo fisico reale, riconoscerlo e poi collegarlo al mondo digitale. Questa applicazione è in realtà molto simile agli occhiali AR attualmente in fase di promozione. Esiste una relazione corrispondente tra ciò che si vede e il modo in cui lo si riconosce, sia che si richieda un servizio o che si riceva un'introduzione. Poiché il team del sistema operativo gestisce anche queste attività, le abbiamo unificate.

D: L'hardware per l'intelligenza artificiale è molto popolare quest'anno. I produttori di telefoni cellulari hanno un vantaggio notevole nell'hardware per l'intelligenza artificiale. Vivo ha in programma di sviluppare ulteriormente questo settore in futuro?

Zhou Wei: La nostra azienda ha creato una business unit dedicata ai terminali AI e ha in programma il lancio di nuovi prodotti, ma non sono io a dover annunciare i tempi. Abbiamo prodotti come Vision, occhiali e abbiamo annunciato ufficialmente un robot domestico. Stiamo sicuramente preparando più di quanto abbiamo annunciato ufficialmente.

Oggi tutti hanno visto il nostro sistema operativo Blue River. È compatibile con un'ampia gamma di chipset, inclusi i chip ARM, con una compatibilità di cinque o sei. Abbiamo anche contattato privatamente aziende cinesi del settore energetico, tra cui una che produce occhiali per l'intelligenza artificiale.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.