“Lingguang” mira a ridefinire i confini della creatività con l’intelligenza artificiale, consentendo agli utenti di creare app in 30 secondi e di scrivere immagini e testo in tempo reale.

Esistono molte opzioni per avere un assistente AI sul telefono, ma sono o come un "pappagallo di fascia alta" o come un portatore di informazioni: chissà, quello che voglio è un assistente che sappia effettivamente fare il lavoro, un "partner creativo" che sappia non solo parlare ma anche agire.

Quest'anno, probabilmente avrete notato che l'intelligenza artificiale si sta evolvendo dal semplice "parlare" al "fare". OpenAI ha creato Atlas e il prossimo Gemini 3.0 di Google consentirà all'intelligenza artificiale di controllare direttamente i computer… Tutti stanno lavorando nella stessa direzione: trasformare la parola in azione e il dialogo in comportamento.

Ant Financial ha appena lanciato un nuovo assistente AI completamente modale, Lingguang. Non ci gira intorno: tu parli, lui agisce, trasformando i tuoi pensieri in qualcosa che puoi vedere, usare e con cui interagire proprio davanti ai tuoi occhi.

Che si tratti di rispondere alle domande o di esprimere idee, l'intelligenza artificiale ha bisogno anche di un'estetica dell'informazione.

La landing page di Lingguang è una finestra di chat familiare. Gli utenti possono effettuare richieste utilizzando un linguaggio naturale, come "Dimmi le calorie di questa bevanda" o "Registra la tua assunzione di cibo oggi", il che riduce notevolmente la curva di apprendimento e rende l'app più fluida rispetto alle applicazioni tradizionali.

Sembra ancora una chiacchierata informale, vero? In realtà, ogni conversazione che hai con Lingguang è un'azione per lui. Ecco tre esempi concreti che probabilmente userai.

Di recente, grazie ai Giochi Nazionali, Guangzhou ha anche goduto del trattamento riservato a una popolare città turistica, in particolare alla Canton Tower, che ogni giorno è circondata da turisti. Ho chiesto a Lingguang: "Cosa c'è di così speciale nel design architettonico della Canton Tower?". Non solo mi ha fornito una spiegazione testuale, ma anche un modello architettonico 3D interattivo.

Il design interattivo, che consente la rotazione e lo zoom per visualizzare i dettagli strutturali, mi ha fornito una comprensione chiara e intuitiva della struttura di torsione a doppia faccia della Canton Tower e del design del cilindro esterno a maglia obliqua.

Nella tua conversazione con Lingguang, non solo ti dice "qual è" la risposta, ma ti permette anche di vedere "come" appare la risposta. Testo, immagini e animazioni strutturali sono tutti integrati, rendendo l'intera esperienza di domande e risposte simile a un "testo esplicativo e immagini" generato in tempo reale e incorporato nella conversazione. Che tu sia uno studente di architettura, un appassionato di urbanistica o semplicemente qualcuno che desidera saperne di più su questo punto di riferimento per puro interesse, ti farà davvero risparmiare un sacco di tempo nella ricerca, nello sfogliare le pagine e nel mettere insieme le informazioni.

Poi ho chiesto: "Potresti organizzare un tour gastronomico per me nelle vicinanze?". L'app ha capito subito che "nelle vicinanze" significava Guangzhou e ha generato una mappa interattiva zoomabile, contrassegnando sei o sette piccoli negozi con stili diversi e persino un "percorso nascosto". Ogni locale poteva essere cliccato per vedere i motivi della raccomandazione, le valutazioni, gli orari di apertura e ha persino stimato il percorso a piedi.

Incredibile! È possibile generare contenuti interattivi direttamente su un telefono cellulare, cosa rara persino nell'intero settore.

Se questi due esempi evocano sensazioni di "bellezza e freddezza", allora ciò che stiamo per mostrare è la "bellezza razionale" di Lingguang.

Per un eccellente assistente AI generico, porre domande e rispondere non è chiaramente sufficiente. Deve essere in grado di produrre un output strutturato, il che significa che necessita di una profonda comprensione e riorganizzazione della semantica delle informazioni , non solo per recuperare le informazioni, ma anche per estrarre punti informativi chiave, comprendere in modo intelligente la semantica ed eseguire l'elaborazione gerarchica.

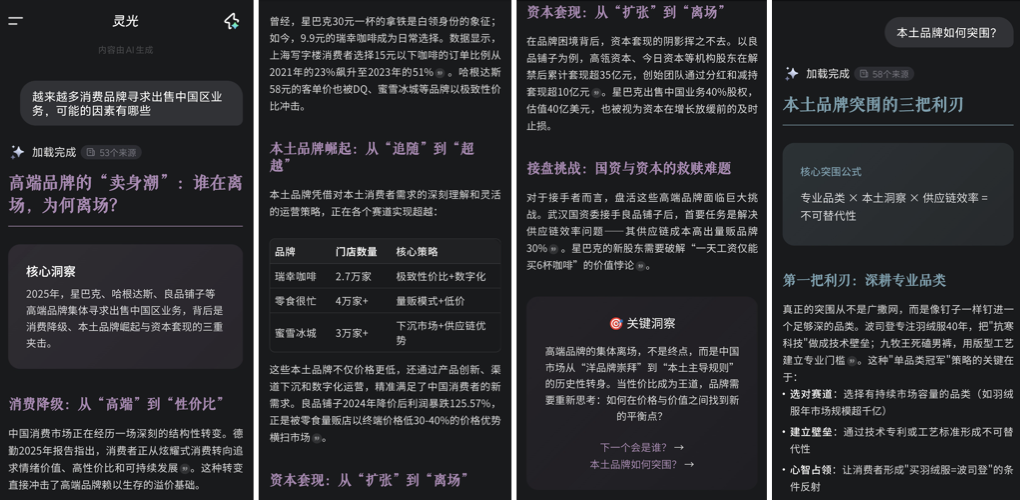

Ad esempio, di fronte a domande che richiedono sia una prospettiva macro che un'analisi micro, come "Perché i marchi di consumo stanno vendendo le loro attività in Cina/Perché il design skeuomorfico dell'interfaccia utente è in declino?", la risposta di Lingguang non si basa su lunghi paragrafi di testo. Piuttosto, analizza innanzitutto i fattori chiave, come i cambiamenti nel mercato dei consumatori, il ciclo di vita del marchio e la pressione degli azionisti, e poi organizza il contenuto di conseguenza, formando una chiara struttura esplicativa causa-effetto, logicamente progressiva.

L'utilizzo di un formato a scheda con titolo e riepilogo, integrati in un testo completo e un'immagine, evita la noia e la natura discontinua dei report PPT/web. Questo output strutturato non solo è logicamente chiaro, ma presenta anche visivamente un'"estetica informativa": pulita, focalizzata e con un ritmo confortevole. Non solo rende più efficiente l'assorbimento delle informazioni, ma simula anche i metodi di organizzazione dei contenuti di scrittori esperti, rendendo l'output dell'IA più simile a un contenuto approfondito e "comprensibile", ben oltre una risposta superficiale e "ricercabile".

Probabilmente vi siete sempre chiesti: com'è possibile? Come può essere strutturalmente chiaro e visivamente accattivante, consentendo al contempo l'interazione in tempo reale?

Quando Lingguang riceve una domanda, attiva un processo di creazione di contenuti incentrato sulla generazione di codice . Che si tratti di testo e immagini, mappe o animazioni 3D, il livello sottostante è costituito dal modello che scrive il codice, gli stili e i componenti corrispondenti in tempo reale, che vengono poi assemblati e presentati dinamicamente . Per raggiungere questo obiettivo, non si tratta di un singolo modello di grandi dimensioni che lavora da solo, ma piuttosto di più agenti intelligenti che collaborano : alcuni gestiscono le immagini, altri il layout, altri ancora recuperano le strutture dati… come blocchi di costruzione.

Integra diversi generi di contenuto e si adatta ai metodi di presentazione più comuni, dando vita a contenuti estremamente naturali. L'effetto finale è anche più adatto per l'inoltro, lo screenshot e la sintesi in "contenuti utilizzabili per WeChat Moments": contiene sia giudizi razionali che opinioni ed emozioni personali .

Crea la tua app in una frase o in 30 secondi.

Se la possibilità di creare diagrammi e pianificare percorsi durante le conversazioni è già abbastanza sorprendente, la capacità successiva è quasi "magica": basta digitare una richiesta sulla tastiera e il sistema può creare direttamente una piccola app per te.

La generazione di applicazioni tramite agenti si trova attualmente in una situazione piuttosto complicata: molte applicazioni si bloccano in un punto di interruzione in cui sono "comprensibili ma non possono essere eseguite". "Flash Application" di Lingguang affronta questo punto critico, poiché il suo dialogo va oltre i passaggi di chiamata e richiesta di strumenti, consentendo la generazione diretta di strumenti.

Sì, non si tratta di generare un pezzo di codice, un prototipo o un suggerimento, ma di generare uno "strumento pronto all'uso" sul momento. Realizzare idee non è più solo una gioia per i programmatori; le app Flash possono offrire a ogni persona comune un punto di partenza per "creare cose" manualmente.

Vediamo come rende così semplice "dare forma alle idee": il mio primo compito è stato: "Voglio uno strumento in grado di suddividere testi lunghi in paragrafi più piccoli".

In soli 30 secondi, appare un piccolo strumento che consente di impostare il numero di paragrafi e di segmentare automaticamente i file. Non è nemmeno necessario aprire una nuova pagina: i risultati generati verranno incorporati direttamente nel flusso di dialogo e potrai utilizzarlo non appena lo apri.

Ecco un altro esempio pratico e leggero: creare un traduttore di menu. Il segreto è tradurre i nomi dei piatti in lingua straniera in cinese, così da capirli, e anche leggere ad alta voce i nomi in lingua straniera, così da poter ordinare facilmente il cibo.

Comprendere il testo, generare il linguaggio, organizzare le interfacce e fornire feedback audio: queste capacità richiedevano in passato più componenti e avrebbero potuto richiedere una spiegazione dettagliata della logica del codice. Ora, tutto può essere racchiuso in una sola riga.

Che lo usiate per ordinare cibo durante un viaggio all'estero o per esercitarvi con l'inglese parlato e familiarizzare con i nomi dei piatti, questo piccolo strumento è pronto all'uso non appena viene generato, realizzando un vero e proprio "crea e usa immediatamente". Dietro di esso si cela un framework applicativo completo: non solo genera pagine front-end, ma sfrutta anche le capacità back-end di un modello di grandi dimensioni. Non solo fornisce il codice, ma offre anche la progettazione gratuita dell'interfaccia utente. Moduli dinamici come la traduzione e la sintesi vocale sono tutti integrati in questo piccolo strumento.

In questo modo, il prodotto risultante non è solo una demo , ma un prodotto reale in grado di interagire con gli utenti in tempo reale, rispondere agli input e avere un ciclo logico completo front-end e back-end.

Invece di perdere tempo a setacciare l'intero app store, è ovviamente più veloce e migliore usare un'app flash per creare in un minuto un piccolo strumento perfettamente adatto alle mie esigenze personali. È flessibile, istantaneo e non presenta barriere d'accesso. Non è una soluzione universale, ma una soluzione temporanea "su misura per questo momento", eppure può ispirare la soddisfazione psicologica della "creazione" nelle persone comuni: anche chi non ha competenze di sviluppo può provare la gioia e l'impulso di condividere "Ho creato una piccola app" con una semplice frase.

Attività interattive con "occhi"

Il video in tempo reale è ormai una "caratteristica standard" per gli assistenti AI e Lingguang ha dato a questa funzione un nome piuttosto creativo: "Open Eyes". È piuttosto appropriato, poiché non si basa sull'input di digitazione, ma piuttosto sull'apertura della telecamera, che è come aprire gli occhi dell'AI per ricevere un altro linguaggio naturale: il linguaggio visivo.

Ad esempio, se punti il telefono verso una tazza di tè al latte, sullo schermo verranno immediatamente visualizzati suggerimenti dietetici, precauzioni per la conservazione e diverse domande di approfondimento per soddisfare la tua curiosità:

Questa funzione è molto comoda per cibo e medicine. Che tu stia scegliendo qualcosa per te o acquistando un nuovo prodotto per i tuoi genitori che non riconoscono, questa funzione è perfetta per te.

La caratteristica unica di OpenEye risiede nella sua tecnologia di riconoscimento in streaming , che trascende il semplice "riconoscimento di un oggetto" e lo trasforma in un portale visivo intelligente in grado di rispondere e dialogare. È in grado di comprendere le vostre potenziali intenzioni in qualsiasi momento, avviare proattivamente azioni di follow-up e trasformare un singolo riconoscimento in una catena coerente di comportamenti.

Rispetto alle vecchie tecnologie di visione basate sull'intelligenza artificiale, che riconoscevano solo loghi o prodotti, questa ha chiaramente fatto un passo avanti: non solo identifica cosa è qualcosa, ma cerca anche di capire perché lo stai guardando e di cosa potresti aver bisogno in seguito.

In altre parole, trasforma la "telecamera" in un altro canale di dialogo, un dialogo che guida l'interazione attraverso la visione , "aprendo davvero gli occhi": impegnandosi nell'interazione con gli "occhi".

Restituisce a tutti il concetto di "creazione".

Il linguaggio è codice e i requisiti sono prototipi. Il dialogo non è mai l'obiettivo finale; il suo vero valore sta nel diventare un innesco per la produttività. L'ispirazione rompe il tradizionale percorso "domanda-risposta-azione", trasformando il linguaggio stesso nel punto di partenza per gli strumenti. Rende il percorso da "ho un'idea" a "l'ho già fatto" più breve e intuitivo.

Le app che in precedenza richiedevano competenze di programmazione, progettazione e logica di prodotto per essere create ora possono essere generate utilizzando una singola riga di linguaggio naturale. Per la prima volta, le persone comuni possono "produrre" direttamente uno strumento funzionale, una scheda di contenuto o un flusso interattivo utilizzando il linguaggio di tutti i giorni, diventando di fatto il proprio product manager. Questo salto dal "saper parlare" al "saper creare" segna il completo superamento della soglia di produttività.

Nella prossima fase del settore dell'intelligenza artificiale, la competizione non si concentrerà più su "chi ha il modello più forte", ma piuttosto su "chi riesce a tradurre le capacità in esperienza utente". All'inizio dell'anno, DeepSeek ha guidato l'ondata di modelli open source in Cina. Con l'avvicinarsi della fine del 2025, Lingguang intravede nuove possibilità per i paradigmi di interazione dell'intelligenza artificiale. L'azienda illustra in modo molto concreto un percorso cruciale: dal modello di base di grandi dimensioni, alle capacità degli strumenti di medio livello, fino ai prodotti applicativi lato utente.

Questa volta, "cosa può fare l'IA" si è finalmente trasformato da linguaggio di laboratorio in verbi di uso quotidiano che gli utenti possono usare . Ha trasformato il "farlo" in "dirlo apertamente", restituendo a tutti il potere della "creazione".

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.