Apple svela finalmente il prossimo “iPhone” | Hard Philosophy

ifanr si concentra sui "prodotti di domani" e la sua rubrica "Hard Philosophy" cerca di eliminare la patina di tecnologia e parametri per esplorare l'elemento umano nella progettazione dei prodotti.

Il mondo della tecnologia è in fermento all'inizio del nuovo anno, con un'ondata di problemi seguita da un'altra.

Innanzitutto, sul palco del Gala del Festival di Primavera, robot intelligenti incarnati e SeeDance si sono alternati a mostrare le loro capacità, incantando il pubblico; Apple ha anche inviato discretamente gli inviti per l'evento di lancio dei suoi prodotti primaverili alla vigilia di Capodanno.

Mentre tutti discutevano ancora dell'iPhone 17e, Bloomberg ha sganciato un'altra bomba: Apple sta accelerando una serie di hardware AI, in particolare i seguenti tre tipi:

- Occhiali intelligenti N50: nome in codice N50, mirano a competere con MetaRay-Ban, ma a un livello superiore. Non hanno schermo, ma si affidano a un altoparlante, un microfono e una doppia fotocamera: una per foto e video, l'altra specifica per la visione artificiale. Il loro lancio è previsto per il 2027.

- Ciondolo indossabile: delle dimensioni di un AirTag, può essere agganciato ai vestiti o appeso a una collana. Dotato di una fotocamera a bassa risoluzione e di un microfono, definiti internamente come "occhi e orecchie" dell'iPhone, che si affidano al telefono per la maggior parte dell'elaborazione;

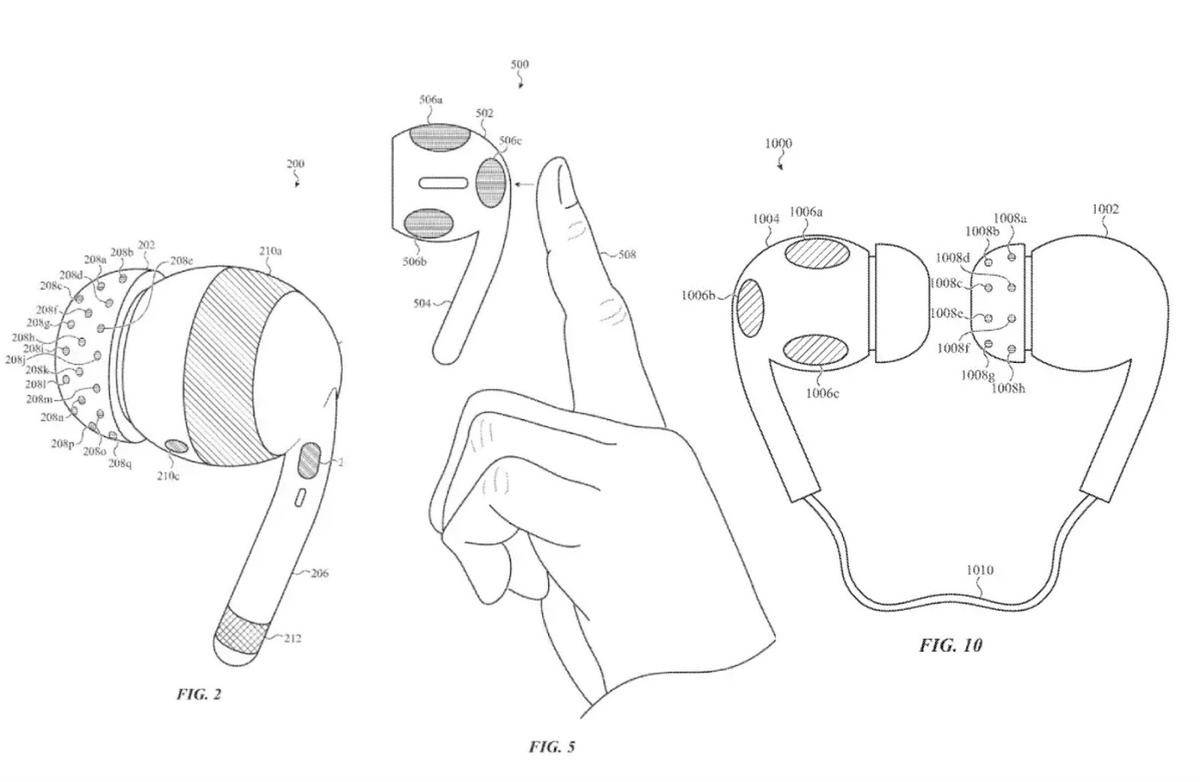

- AirPods con fotocamera: aggiungono una fotocamera agli AirPods esistenti, principalmente per fornire informazioni visive all'intelligenza artificiale, piuttosto che per scattare foto o registrare video. Si tratta della tecnologia più avanzata e potrebbe debuttare già quest'anno.

▲ Immagine concettuale generata da Gemini

Questa potrebbe essere l'ultima scommessa di Tim Cook prima della fine della sua carriera. A differenza dell'approccio radicale "bruciare il vecchio mondo" a cui siamo abituati, questo leader della supply chain ha scelto un percorso evolutivo più in linea con la logica di rendicontazione finanziaria di Apple, al momento del suo ultimo incarico: abbracciare l'hardware AI, ma senza mai tradire l'iPhone, la pietra angolare del suo valore di mercato di mille miliardi di dollari.

In questo gioco di cambiamento generazionale, Cook non ha fatto una scelta: voleva tutto.

Fotocamere, nate per l'intelligenza artificiale

Se siete abbastanza attenti, avrete già colto il punto chiave della breve introduzione: tutti e tre i dispositivi sono dotati di fotocamera.

Dal punto di vista dell'elettronica di consumo tradizionale, la fotocamera dell'iPhone ha sostanzialmente soddisfatto le esigenze fotografiche delle persone. Tuttavia, per l'hardware AI che non ha bisogno di scattare foto, il ruolo della fotocamera ha subito un cambiamento qualitativo: è un punto di ingresso "input" passivo e continuo per la ricezione di informazioni.

Non è richiesta un'elevata qualità dell'immagine; sono sufficienti 2 megapixel o anche meno, e anche le immagini a infrarossi sono accettabili. Dopotutto, l'intelligenza artificiale non ha bisogno di valutare il paesaggio; finché riesce a calcolare il posizionamento spaziale e il riconoscimento degli oggetti attraverso queste immagini a bassa risoluzione, può funzionare normalmente.

▲ Immagine concettuale generata da Gemini

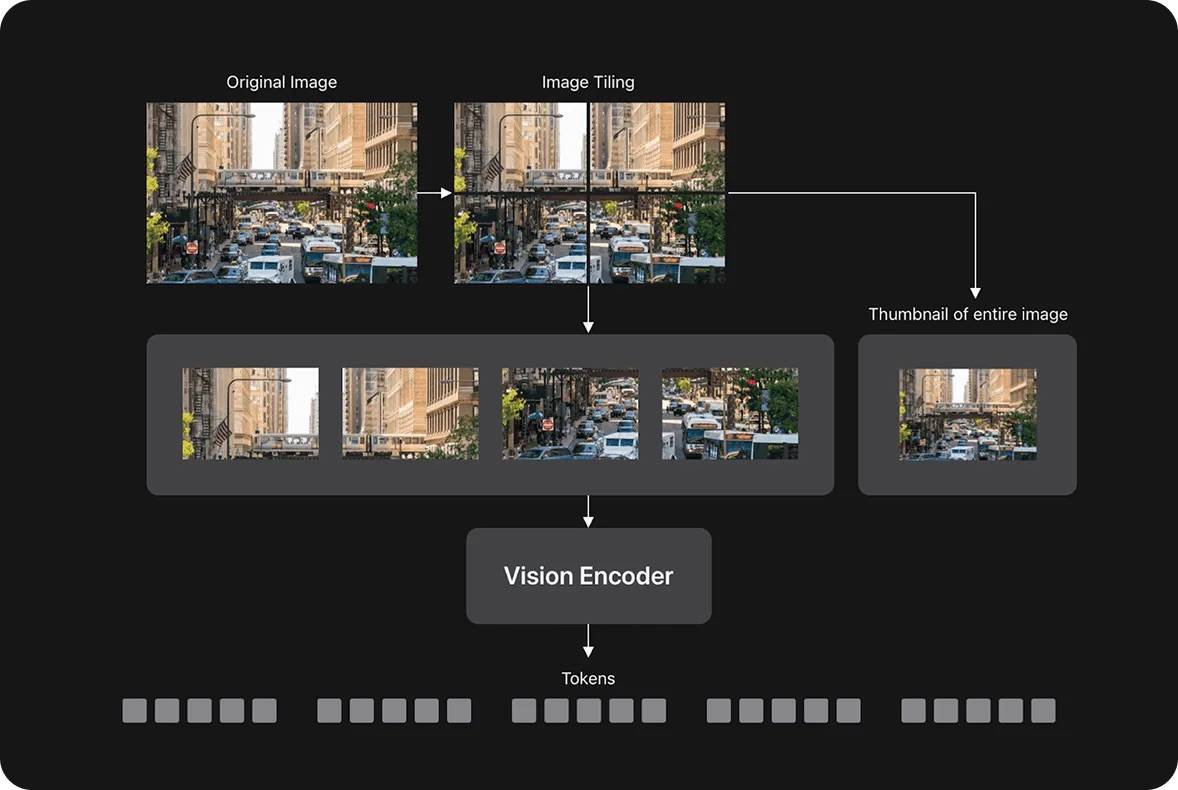

In linea con questo, Apple ha accumulato competenze tecnologiche in questo settore. Nell'estate del 2025, Apple ha reso open source FastVLM, un modello di linguaggio visivo ad alta efficienza che può essere eseguito direttamente su iPhone.

A differenza di altri giganti dell'intelligenza artificiale che "aumentano i punteggi", questo modello è stato ottimizzato per la miniaturizzazione, l'edge computing e la bassa latenza. Riduce il numero di token necessari per l'elaborazione visiva a 1/16 di quello del ViT tradizionale, riducendo notevolmente la latenza. Può formulare giudizi in tempo reale in base al contenuto catturato dalla telecamera e la sua velocità di risposta è molto elevata.

È prevedibile che Apple utilizzerà FastVLM e le tecnologie dei suoi modelli derivati nel suo hardware di intelligenza artificiale incentrato sulla visione.

Tuttavia, la soluzione di Apple per l'elaborazione di flussi di dati visivi è una spietata presa in giro di "pionieri" come Humane AI Pin e Rabbit R1.

La causa del fallimento di Ai Pin può essere riassunta come "arroganza" che ha ignorato le leggi fisiche, gli scenari di utilizzo e l'accettazione da parte degli utenti. Ha stipato un chip Qualcomm Snapdragon, un complesso sistema di raffreddamento, un intero set di fotocamere e un proiettore in un dispositivo delle dimensioni di una scatola di fiammiferi.

Le conseguenze dell'utilizzo di un piccolo motore per trainare un carrello di grandi dimensioni sono evidenti: Ai Pin, pubblicizzato come sostituto dell'iPhone, soffriva di scarsa durata della batteria e surriscaldamento. Infine, con l'interruzione dei servizi e la vendita dell'azienda, il prodotto è diventato un costoso e inutile rifiuto elettronico.

Apple ha imparato dai propri errori e ha scelto un approccio "simbiotico" relativamente pragmatico, che consente all'hardware AI di svolgere le proprie funzioni.

▲ Una volta Apple ha depositato una domanda di brevetto per gli AirPods basati sulle onde cerebrali.

Nell'architettura Apple, questi tre dispositivi hardware non richiedono chip ad alte prestazioni o batterie di grandi dimensioni. Il loro scopo è puro e unico: la raccolta di dati multisensoriali.

Attraverso un dispositivo piccolo, indipendente e leggero, acquisisce costantemente informazioni dal mondo esterno. Dopotutto, gli esseri umani non possono tenere in mano il telefono 24 ore al giorno, quindi per catturare questo flusso continuo di informazioni visive, la fotocamera deve prendere il controllo della "posizione superiore" degli organi sensoriali umani, ovvero le orecchie e il dorso del naso.

A questo proposito, Lightwear, un'azienda nazionale, ha già fornito una versione preliminare. Hanno installato una coppia di telecamere sulle cuffie per catturare costantemente il mondo reale, ma queste informazioni vengono "lette e distrutte" dopo essere state utilizzate dall'intelligenza artificiale, garantendo sia l'usabilità che la privacy. Questa soluzione non ha un sapore un po' fruttato?

▲ Cuffie Lightwear AI

Per maggiori informazioni su queste cuffie futuristiche, consulta il nostro precedente rapporto: https://mp.weixin.qq.com/s/iLZJLj6RqiDIh74sD8H6CA?clicktime=1771374926&enterid=1771374926&scene=126&sessionid=1771374919&subscene=91

Nel nuovo ecosistema hardware AI di Apple, i tre componenti hardware hanno ruoli chiaramente definiti:

Gli occhiali intelligenti di fascia alta, nome in codice N50, adottano la "prospettiva in prima persona (FPV)" e vedono ciò che vedi, riuscendo a catturare e registrare la tua attenzione attuale; gli AirPods con fotocamera sfruttano la caratteristica per cui i movimenti della testa equivalgono ai movimenti degli occhi per scansionare la visione laterale e completare la percezione ambientale; il ciondolo AI è come un "occhio" appeso al petto, responsabile della registrazione grandangolare e della creazione di memoria a lungo termine.

▲ Foto|Guida di Tim

Sono come i tre tentacoli di un iPhone, che estraggono freneticamente informazioni dal mondo fisico.

Allo stesso tempo, Apple può anche implementare la sua strategia coerente per la privacy in flussi di informazioni ad alta densità e con pochi pixel: "read-once".

Tutti i dati catturati dalle telecamere vengono utilizzati esclusivamente dall'IA per comprendere l'ambiente circostante e non vengono archiviati in alcun modo. In questo modo, l'IA viene alimentata riducendo al minimo le preoccupazioni degli utenti in merito alla privacy.

La magia di Apple: input vocale silenzioso

Dal punto di vista dell'input informativo, possiamo comprendere a grandi linee le idee progettuali e il funzionamento dei tre dispositivi hardware di intelligenza artificiale. Tuttavia, se vogliamo che questo sistema hardware di intelligenza artificiale sia facile da usare, c'è un altro problema, più complesso della tecnologia e che può persino essere considerato una questione di vita o di morte: l'interazione.

Il più grande problema dell'hardware di intelligenza artificiale esistente è la pressione sociale. In una metropolitana rumorosa, gridare "Ehi, aiutami a scoprire a quale stazione devo scendere" al PIN dell'IA sul petto è incredibilmente imbarazzante dal punto di vista sociale, indipendentemente da quanto intelligente sia la risposta dell'IA.

Pertanto, posso addirittura trarre una conclusione radicale: finché l'hardware dell'intelligenza artificiale avrà ancora bisogno di sussurrare a se stesso, sarà difficile per lui uscire dalla sua nicchia.

▲ Martire Ai Pin

Apple comprende chiaramente la pressione sociale di questo tipo di dialogo interiore e la sua soluzione è il "silenzio": proprio il mese scorso, Apple ha acquisito in modo rapido e discreto l'azienda israeliana Q.ai per 2 miliardi di dollari, portando la tecnologia sotto la sua ala protettrice. Per maggiori dettagli, consulta il nostro report: https://mp.weixin.qq.com/s/xh1yCU7VDcydqw2yeKGG0A?clicktime=1771374793&enterid=1771374793&scene=126&sessionid=1771374778&subscene=91

I semi di questa acquisizione sono stati piantati un decennio fa.

Forse non conoscete il nome di Aviad Maizels, fondatore di Q.ai, ma Face ID, utilizzato fin dall'iPhone X, ha avuto origine dalla sua precedente azienda, PrimeSense.

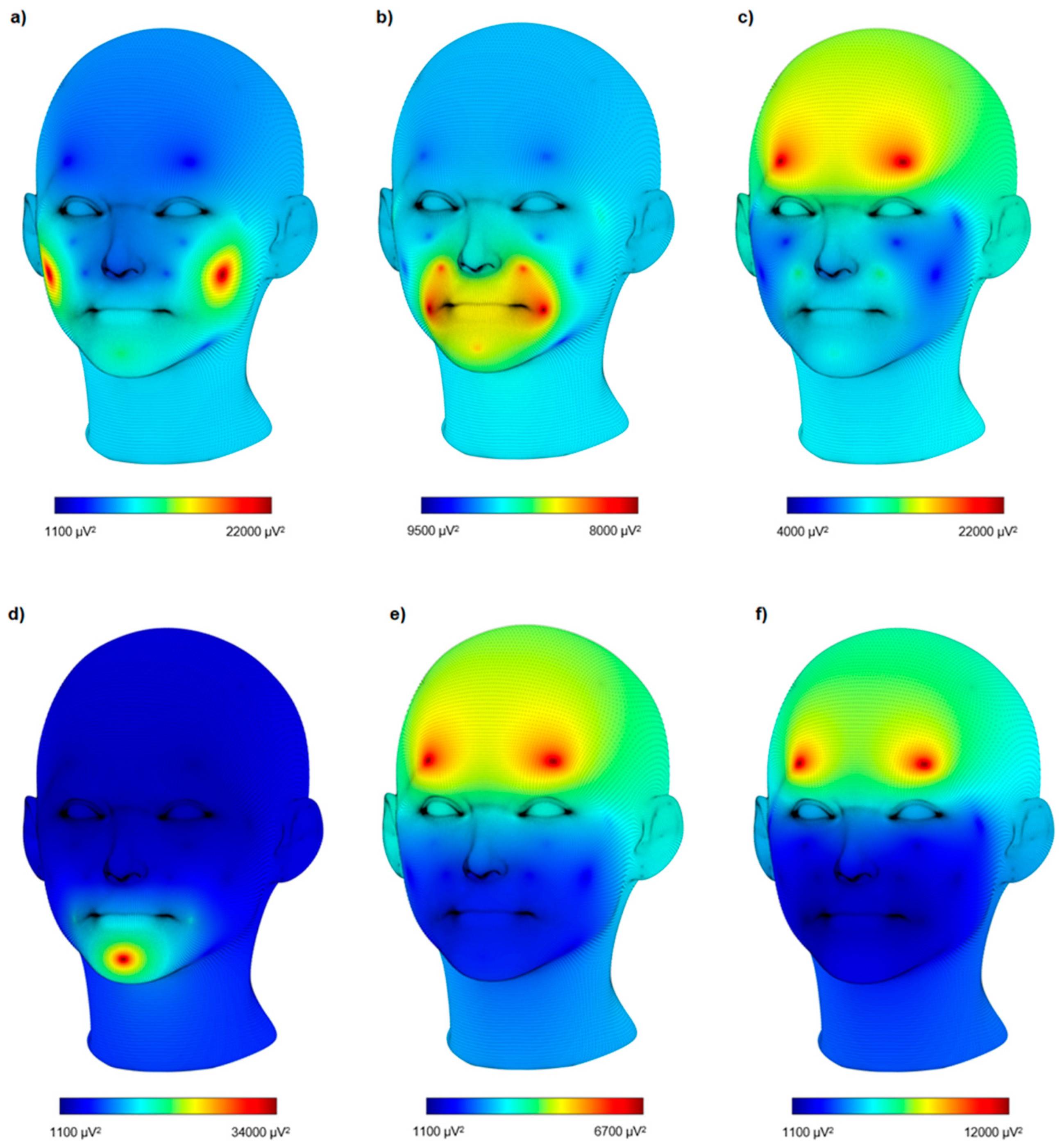

La tecnologia di base di Q.ai è l'elettromiografia (EMG) e l'analisi delle microespressioni. Sembra qualcosa uscito da un romanzo cyberpunk, ma il principio è in realtà molto biologico: quando vogliamo parlare, il cervello invia segnali elettrici neurali agli organi vocali. Anche se finiamo per abbassare la voce o non emettere alcun suono, i muscoli della gola, della mascella e delle guance generano comunque deboli fluttuazioni bioelettriche.

L'algoritmo di Q.ai è in grado di catturare e tradurre queste fluttuazioni silenziose.

▲ Acquisizione del segnale elettromiografia facciale per il riconoscimento delle emozioni

Gli utenti non hanno bisogno di pronunciare i comandi in modo così chiaro come quando chiamano Siri, né di aprire la bocca. Devono solo "leggere" i comandi silenziosamente nella loro gola, e i sensori sulle aste dei loro occhiali li riconosceranno con precisione.

Non c'era alcun suono, nessun movimento. Agli astanti, sembrava che ti fossi semplicemente fermato brevemente per ottenere informazioni.

Proprio come il multi-touch ha permesso all'iPhone di dire addio alla tastiera fisica, l'interazione silenziosa di Q.ai offre ai dispositivi senza schermo capacità di input ad alta larghezza di banda e ad alta privacy.

Se tracciamo un'analogia con il successo dell'iPhone, potremmo parlare della tecnologia "multi-touch" nell'hardware dell'intelligenza artificiale.

Per garantire che tra dieci anni tutti abbiano ancora bisogno di un iPhone

Nel caso antitrust di alto profilo di Google dello scorso anno, c'era una prova: una dura dichiarazione fatta da Eddy Cue, vicepresidente senior dei servizi Internet di Apple:

Tra dieci anni potremmo non aver più bisogno degli iPhone.

▲ Eddy Cue e Tim Cook

Questa affermazione è stata interpretata da numerosi media come un'auto-rivoluzione di Apple, e trasmette indirettamente anche l'ansia di Apple per l'ondata di intelligenza artificiale. Tuttavia, mentre il puzzle degli occhiali N50, dei portachiavi e degli AirPods con intelligenza artificiale emerge gradualmente, il nuovo approccio di Apple sta diventando sempre più chiaro.

Ciò ci consentirà di legare saldamente la nuova categoria di hardware AI all'ecosistema consolidato e maturo dell'iPhone.

Per dirla più chiaramente, possiamo provare a dividere l'approccio di Apple in due fasi: il miglioramento dell'esperienza e lo smontaggio.

Nell'autunno del 2016, Apple ha rimosso il jack per cuffie da 3,5 mm dall'iPhone 7 e, sulla sua scia, sono stati lanciati gli AirPods. Apple ha migliorato significativamente l'esperienza di ascolto attraverso tecnologie come la connettività wireless, il rilevamento in-ear e l'audio spaziale. Sebbene gli EarPods non siano stati immediatamente abbandonati e potessero ancora essere utilizzati normalmente, era necessario acquistare gli AirPods per ottenere l'esperienza migliorata.

L'atto di "ascoltare" è stato separato con successo dai telefoni cellulari e trasformato in una linea di produzione di accessori indipendente dal valore di miliardi di dollari.

Apple Watch sta seguendo la stessa strada: aggiornando e separando le funzioni Salute e Notifiche, richiedendo agli utenti di acquistare accessori aggiuntivi per accedere a un'esperienza iPhone più completa.

Ora Apple sta progettando di fare lo stesso con l'hardware AI.

Secondo la visione di Apple, in futuro il tuo dispositivo potrebbe avere questo aspetto:

- Polso: Apple Watch (monitoraggio della salute + Centro notifiche);

- Orecchie: AirPods (miglioramento dell'udito + assistente vocale);

- Ponte nasale: occhiali N50 (miglioramento visivo + schermo invisibile);

- Ornamento da torace (registratore per tutte le stagioni + attacco di memoria);

- Tascabile: iPhone (nucleo di elaborazione + gateway).

Guardando all'intero pianeta, Apple è probabilmente l'unica azienda con maggiori probabilità di poter inserire cinque dispositivi elettronici contemporaneamente nel tuo corpo.

Ciò rende più facile capire perché il CEO di OpenAI, Sam Altman, durante un pranzo a New York, abbia parlato con franchezza e senza menzionare Google:

Smettetela di concentrarvi su Google: la vera nemesi di OpenAI è Apple.

Naturalmente, anche se questa voce fosse del tutto vera, non indosseremmo tutti questi dispositivi contemporaneamente. Scoprirete che occhiali, cuffie e accessori hanno tutti una fotocamera, e le loro funzioni e ruoli sono sostanzialmente gli stessi.

La definizione di Apple per dispositivi indossabili non è mai quella di renderli troppo evidenti, ma piuttosto di esistere in un modo che sia impercettibile.

Tuttavia, se questo percorso si rivelerà vincente, il più formidabile "fossato dell'ecosistema" di Apple confluirà senza soluzione di continuità nell'era dell'intelligenza artificiale, accompagnato dalla memoria muscolare e dalle abitudini operative di miliardi di utenti. Ciò rappresenta una minaccia fatale per qualsiasi produttore dedicato alla creazione di hardware per l'intelligenza artificiale.

In questa esplosione cambriana dell'hardware AI, Apple sembra lenta a reagire e le sue prestazioni nei modelli su larga scala e nelle implementazioni di AI sono state effettivamente meno che soddisfacenti. Tuttavia, se questo piano strategico dovesse alla fine avere successo, l'audace dichiarazione di Eddy Cue di allora potrebbe richiedere qualche piccolo aggiustamento per essere all'altezza delle ambizioni di Apple:

Tra dieci anni potremmo aver bisogno di qualcosa di più dei soli iPhone.

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.