È appena stata rilasciata la nuova versione di GPT-5. L’intelligenza artificiale più popolare ha impiegato 7 ore per la sua programmazione e il rinnovamento degli strumenti di programmazione è iniziato.

Proprio quando Anthropic Claude era coinvolto nella controversia sulla riduzione del suo QI, OpenAI aveva appena lanciato GPT-5-Codex, una versione dedicata di Codex ottimizzata sulla base di GPT-5, specificamente addestrata per la "programmazione autonoma".

Questo aggiornamento ha un certo peso.

Concentrato su scenari di ingegneria del software reali, GPT-5-Codex non solo è in grado di gestire le interazioni di programmazione quotidiane, ma è anche in grado di completare in modo autonomo progetti di ingegneria complessi e dispendiosi in termini di tempo. Come un vero programmatore, può lavorare ininterrottamente per oltre sette ore, iterando, correggendo bug ed eseguendo test su progetti complessi per fornire infine una soluzione completa e utilizzabile.

Dal lancio della versione CLI ad aprile, al lancio della versione web a maggio, fino all'aggiornamento completo di oggi, l'obiettivo di Codex è quello di "automatizzare" completamente la programmazione.

Ora, che tu stia sviluppando nel terminale, nell'IDE, nella pagina web o nel telefono cellulare, Codex può fornire un'esperienza di assistenza alla programmazione coerente ed è stato integrato nel sistema di account ChatGPT, consentendo un passaggio fluido tra locale e cloud.

La caratteristica più interessante di GPT-5-Codex è la sua capacità di "pensiero dinamico", che gli consente di adattare in modo flessibile i tempi di elaborazione in base alla complessità del compito.

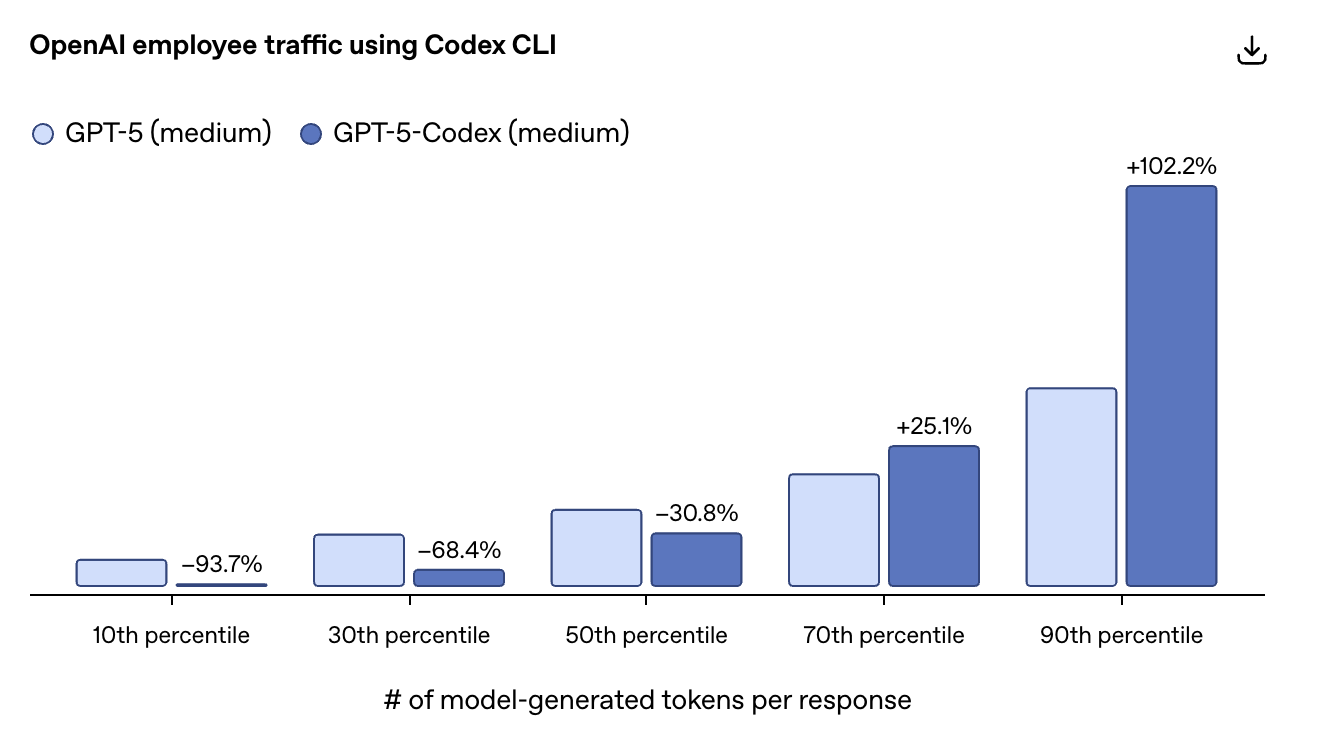

I dati interni sull'utilizzo da parte dei dipendenti di OpenAI mostrano che per il 10% inferiore delle richieste semplici, ordinate in base al numero di token generati dal modello, GPT-5-Codex ha utilizzato il 93,7% in meno di risorse di elaborazione rispetto a GPT-5.

Al contrario, per il 10% delle richieste più complesse, ci vuole circa il doppio del tempo per ragionare, modificare il codice, testare e iterare. Ciò significa che le chat quotidiane e le piccole attività ricevono risposta più rapidamente, mentre i refactoring più complessi richiedono più tempo per essere elaborati in modo approfondito.

In parole povere, significa: non perdere tempo con piccole questioni quotidiane e dedicalo a grandi progetti.

Infine, esiste un modello di programmazione che sa come utilizzare le risorse migliori laddove sono più importanti.

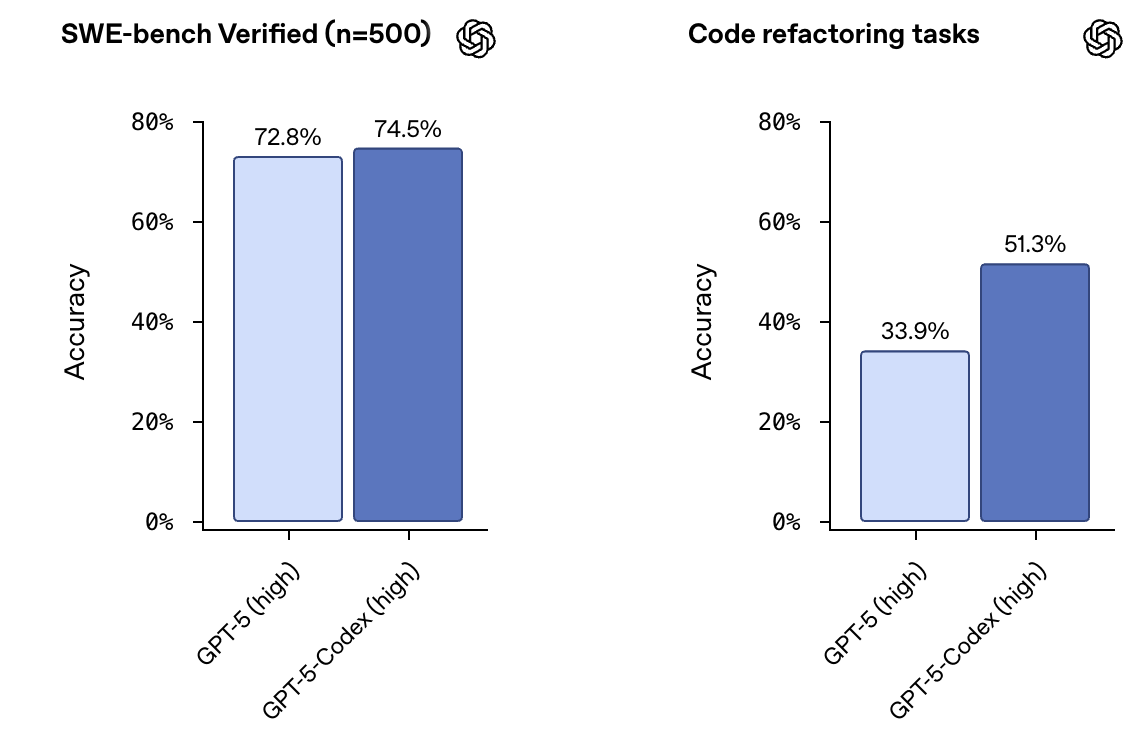

Per quanto riguarda i benchmark, al momento del rilascio di GPT-5, OpenAI riportava risultati solo su 477 task verificati da SWE-bench. Dopo essere stati segnalati da Anthropic, OpenAI ha annunciato oggi che questi problemi sono stati risolti e che ora è possibile riportare i risultati su tutti i 500 task. I risultati sono i seguenti:

La valutazione del refactoring del codice copre linguaggi come Python, Go e persino OCaml. Ad esempio, un caso di pull request di Gitea ha modificato 232 file e 3.541 righe di codice e ha integrato la variabile ctx nella logica dell'applicazione.

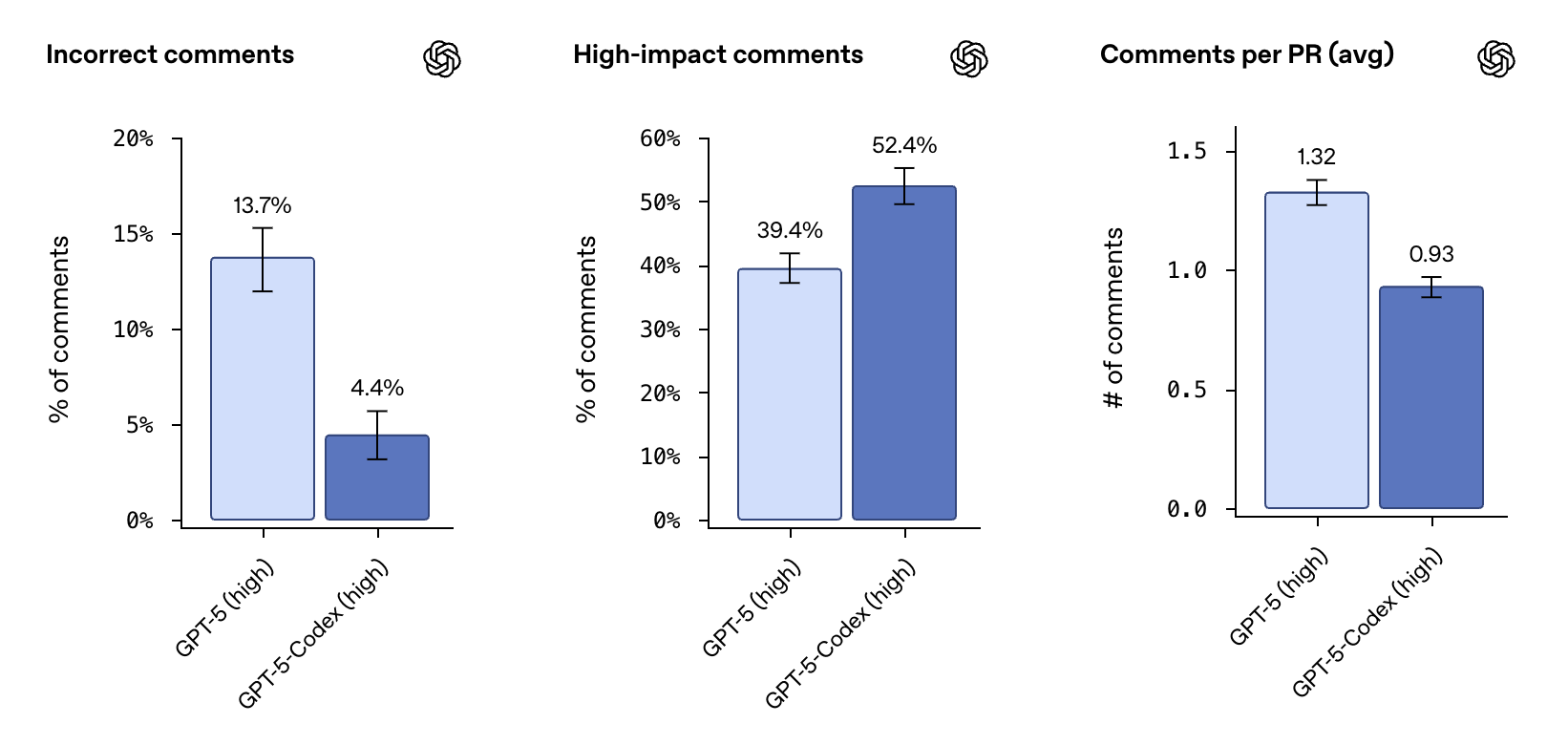

Anche la funzionalità di revisione del codice è molto utile. Esplora e analizza la base di codice, esegue test per verificarne la correttezza e fornisce commenti di revisione piuttosto accurati. All'interno di OpenAI, Codex ora esamina la maggior parte delle pull request, scoprendo centinaia di problemi ogni giorno e spesso individuando potenziali bug prima della revisione manuale.

È disponibile anche il supporto per lo sviluppo front-end. GPT-5-Codex non solo supporta la creazione di applicazioni desktop, ma migliora anche significativamente le capacità di sviluppo mobile. Può anche leggere screenshot e bozze di progettazione, controllare l'avanzamento dello sviluppo e visualizzare i risultati del lavoro, il che è davvero utile per lo sviluppo front-end.

Anche gli aggiornamenti degli strumenti sono piuttosto estesi. La nuova interfaccia a riga di comando del Codex è ora riprogettata attorno al processo di codifica autonoma e supporta l'aggiunta e la condivisione diretta di immagini, inclusi screenshot, wireframe e diagrammi di architettura, per una comprensione condivisa delle decisioni di progettazione.

Quando si tratta di attività complesse, Codex monitora i progressi tramite elenchi di cose da fare e dispone di strumenti integrati come la ricerca sul Web e MCP per connettersi a sistemi esterni.

Le modalità di approvazione sono state semplificate a tre: la modalità di sola lettura richiede un'approvazione esplicita, la modalità automatica ha accesso completo all'area di lavoro ma richiede l'approvazione al di fuori dell'area di lavoro e la modalità di accesso completo può leggere i file ovunque ed eseguire comandi con accesso alla rete.

Il nuovo plugin IDE supporta editor come VS Code e Cursor, consentendo agli utenti di visualizzare in anteprima le modifiche locali e di collaborare al codice con Codex. Il plugin supporta anche il passaggio fluido tra ambienti cloud e locali, consentendo agli utenti di creare attività cloud, monitorare il lavoro in corso e rivedere le attività completate direttamente nell'editor.

Anche l'infrastruttura cloud ha visto miglioramenti significativi, con la memorizzazione nella cache dei container che riduce del 90% il tempo medio di completamento per le attività nuove e successive. Codex configura automaticamente l'ambiente di runtime, esegue la scansione degli script di inizializzazione comuni e li esegue, ed esegue persino comandi come pip install per installare le dipendenze su richiesta durante la configurazione delle autorizzazioni di accesso alla rete.

In termini di sicurezza, OpenAI utilizza un ambiente operativo sandbox e disabilita l'accesso alla rete per impostazione predefinita, per garantire che non vengano eseguite operazioni dannose sul computer dell'utente, riducendo al contempo il rischio di iniezione immediata.

Gli sviluppatori possono personalizzare le impostazioni di sicurezza in base alla loro tolleranza al rischio. Nel cloud, possono limitare l'accesso alla rete solo ai domini attendibili. Nei plug-in CLI e IDE, possono approvare i comandi, consentire l'esecuzione con privilegi completi, utilizzare la ricerca web e connettersi al server MCP.

In linea con la gestione GPT-5, GPT-5-Codex è classificato come un modello ad alta capacità nei campi della biologia e della chimica e sono state implementate le relative misure di sicurezza.

In termini di prezzo, Codex è stato integrato in vari piani a pagamento di ChatGPT e i diversi piani prevedono limiti di utilizzo diversi.

- Inoltre, Edu e Business sono adatti per sessioni di programmazione mirate, da svolgere più volte a settimana;

- Pro può supportare il carico di lavoro di un'intera settimana su più progetti.

Il piano Business consente agli sviluppatori di acquistare crediti aggiuntivi per superare il limite massimo incluso, mentre il piano Enterprise offre un pool di crediti condiviso, consentendo loro di pagare solo per ciò che il loro team effettivamente utilizza. Per gli sviluppatori che utilizzano una chiave API, OpenAI prevede di aprire presto GPT-5-Codex all'API.

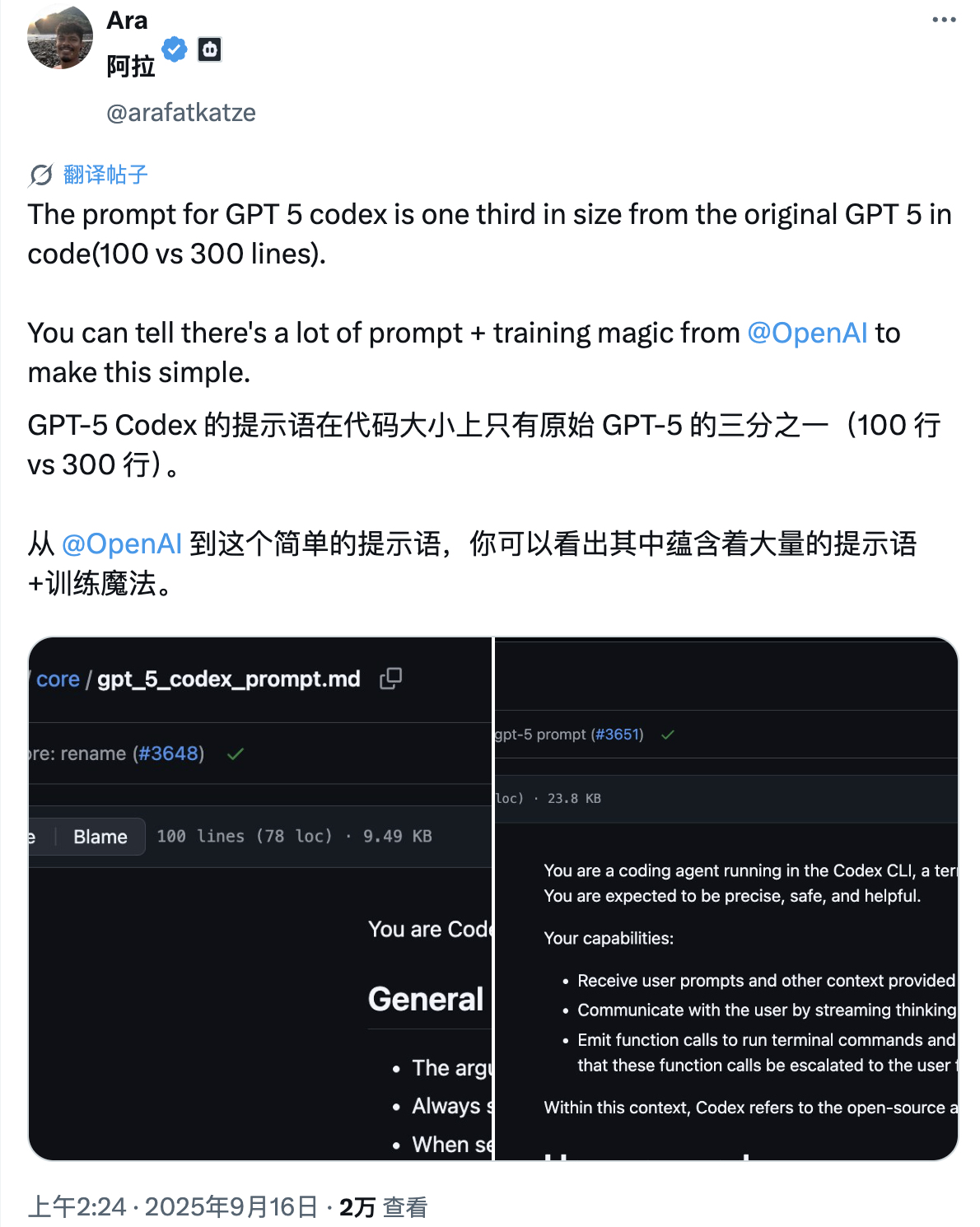

Attualmente sono trapelate le parole chiave del sistema GPT-5-Codex e gli sviluppatori interessati possono studiarle.

Indirizzo della parola del prompt di sistema: https://github.com/elder-plinius/CL4R1T4S/blob/main/OPENAI/Codex_Sep-15-2025.md

Il noto blogger Dan Shipper ha fornito la seguente valutazione dopo aver sperimentato GPT-5-Codex:

L'abbiamo testato su @every per alcuni giorni e i risultati sono stati piuttosto impressionanti:

– Sceglie dinamicamente il tempo di “riflessione” in base al compito: può lavorare a lungo su problemi difficili, fornendo al contempo risposte immediate a domande semplici.

– Nei test effettuati sul nostro codice di produzione, è stato possibile eseguirlo in modo autonomo fino a 35 minuti, un miglioramento notevole rispetto a GPT-5, che tende a essere eccessivamente cauto.

– Supporta il passaggio senza interruzioni tra ambienti di sviluppo locali e web. Puoi avviare un'attività in VS Code e poi trasferirla a Codex Web per completarla quando vai a fare shopping.

– Include un agente di revisione del codice che esegue effettivamente il codice, in modo da poter trovare più bug.Ecco le nostre impressioni generali dopo approfonditi test interni:

– Si tratta di un eccellente aggiornamento che rende Codex CLI un'alternativa interessante a Claude Code.

– Tuttavia, ha bisogno di una seria spinta per funzionare al meglio. Ad esempio, @kieranklaassen è riuscito a farlo funzionare solo per 5 minuti al massimo, mentre @DannyAziz97 ci è riuscito.

– A volte può essere “pigro”: potrebbe non pensare abbastanza a certi compiti o semplicemente rifiutarsi di assumerli se li ritiene troppo grandi.

– Ho trascorso il fine settimana inviando una nuova PR per @CoraComputer utilizzando Codex CLI e l'ho trovato molto facile da usare e avviare: è un modello fantastico.

Alexander Embiricos, responsabile di prodotto per OpenAI Codex, ha affermato che il significativo miglioramento delle prestazioni è dovuto in gran parte alla "capacità di pensiero" dinamica di GPT-5-Codex. Embiricos ha spiegato che GPT-5-Codex funziona in modo simile, ma invece di avere un router interno, può regolare in tempo reale il tempo impiegato per svolgere un'attività.

Embiricos sottolinea che questo è un vantaggio rispetto ai meccanismi di routing: questi ultimi devono decidere fin dall'inizio quanta potenza di calcolo e tempo allocare a un problema, mentre GPT-5-Codex può decidere dopo cinque minuti di elaborazione di un'attività che "abbiamo bisogno di un'altra ora". Afferma di aver visto il modello funzionare ininterrottamente per più di sette ore in alcuni casi.

Negli ultimi mesi, quasi tutte le principali aziende di intelligenza artificiale hanno rilasciato importanti aggiornamenti che puntano nella stessa direzione: le capacità di programmazione. Tuttavia, a ben guardare, si scopre che le "ottimizzazioni" per gli utenti comuni stanno in realtà diminuendo.

In apparenza, questo potrebbe essere dovuto al fatto che i prodotti di intelligenza artificiale per i consumatori comuni hanno raggiunto un punto morto. Funzioni come chattare, scrivere e tradurre sono già relativamente mature, il che rende difficile raggiungere risultati rivoluzionari.

Ma la ragione più profonda non può essere evitata dalla logica aziendale.

Sviluppare modelli di intelligenza artificiale avanzati richiede investimenti astronomici e qualcuno deve pur sostenerne i costi. Piuttosto che affidarsi a un gran numero di utenti sottopagati per una lenta ripresa, è meglio rivolgersi direttamente a utenti di alto valore che siano realmente disposti a pagare. I programmatori sono tra i più disposti a pagare per strumenti di intelligenza artificiale e la loro fedeltà è elevata.

Da questa prospettiva, abbandonare la narrativa dell'uguaglianza tecnologica potrebbe rivelare che il futuro dell'IA è più elitario di quanto immaginiamo. Questo non è necessariamente un aspetto negativo, ma è qualcosa di cui dovremmo almeno essere consapevoli.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.