Il token modello grande è troppo costoso? Apple non offrirà commissioni agli sviluppatori

Il sapore indelebile di Apple Intelligence, che è stato pubblicizzato eccessivamente e poi accantonato da Apple durante la WWDC dell'anno scorso, persiste ancora.

Nelle prime ore del mattino del 10 giugno 2025, si è appena concluso il discorso principale (registrato) della WWDC25, e la parte relativa all'intelligenza artificiale fa ancora sospirare di tanto in tanto: "Questo è tutto".

Molte delle cosiddette nuove funzionalità annunciate quest'anno da Apple nell'ambito dell'intelligenza artificiale, come la traduzione in tempo reale e i comandi rapidi, non sono poi così rivoluzionarie; per quanto riguarda l'intelligenza visiva, non solo la sua funzionalità è indietro di sei o sette anni rispetto a Google Lens, ma anche la sua esperienza interattiva è lontana dal livello dei prodotti AI/Agent integrati di diversi concorrenti di Android nella prima metà del 2025.

Ma dopo aver guardato l'intera puntata, posso affermare che c'è una sola notizia sull'intelligenza di Apple che avrà un impatto di vasta portata, sia per gli utenti comuni che per gli sviluppatori.

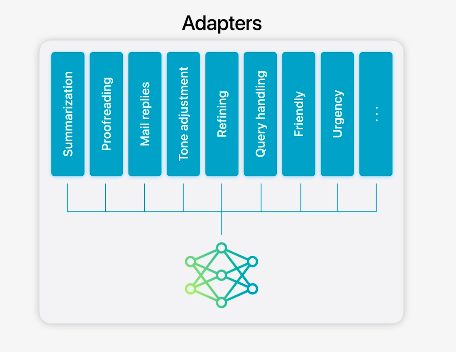

Si tratta del "Foundation Models Framework", un framework di accesso ai modelli di intelligenza artificiale lato end fornito da Apple per gli sviluppatori. Utilizzandolo, gli sviluppatori Apple potranno accedere facilmente al modello linguistico di grandi dimensioni lato end per le loro app senza dover pagare costi di token.

Ciò significa che gli sviluppatori possono fornire agli utenti funzionalità e servizi basati su LLM senza alcun onere ed eseguire un ragionamento puramente end-side senza doversi preoccupare delle commissioni token generate dalla chiamata all'API cloud LLM e, naturalmente, senza dover trasferire i costi agli utenti.

Gli sviluppatori possono mantenere più rispettabilmente il modello di prezzo da loro scelto, con conseguente vantaggio per gli utenti.

Apple intelligente, puro end-to-end

Lo scorso anno, alla WWDC, Apple ha annunciato una serie di prodotti, funzionalità e capacità tecniche di intelligenza artificiale che avrebbe potuto fornire agli sviluppatori con il nome di "Apple Intelligence". Sappiamo già che la maggior parte di questi annunci è stata ritardata, o addirittura completamente "vaporware" (software annunciato ma fortemente ritardato).

Ciò influenza il giudizio del mondo esterno sul successo di Apple nell'intelligenza artificiale.

Ma Apple vanta ancora il maggior numero di spedizioni di smartphone al mondo. Anche se è lenta ad agire su un LLM cloud con parametri elevati, l'azienda ha ancora un'enorme influenza su come le persone utilizzano l'intelligenza artificiale e su come gli sviluppatori applicano la tecnologia AI nei loro progetti: questo è oggettivo e indiscutibile.

Alla WWDC25 di quest'anno, ho visto Apple esercitare questo diritto di parola. Ha detto agli sviluppatori:

Vuoi offrire funzionalità di intelligenza artificiale agli utenti? Nessun problema. Puoi utilizzare il modello end-side fornito da Apple per eseguire il ragionamento LLM completamente in locale sul dispositivo, senza bisogno di una connessione internet, il che tutela la privacy dell'utente e non comporta costi per il cloud.

Il "Basic Model Framework" è un potente strumento che Apple ha messo a disposizione degli sviluppatori.

Il modello base è il cuore dell'intelligenza artificiale di Apple. L'anno scorso, veniva utilizzato solo per i prodotti e le funzioni Apple. Da oggi, Apple ha aperto il modello base agli sviluppatori. Qualsiasi applicazione di terze parti può utilizzare direttamente questi modelli base lato terminale per implementare funzioni basate sull'intelligenza artificiale e offrire agli utenti un'esperienza completamente nuova.

Ad esempio, Kahoot!, un prodotto didattico presentato in loco, può utilizzare il modello lato client per generare una serie di domande personalizzate per gli utenti.

Oppure Alltrails, un prodotto indispensabile per gli amanti dell'escursionismo all'estero, può fornire agli utenti l'assistenza necessaria anche in situazioni in cui non è presente alcuna rete, come nelle zone montuose pericolose.

Quali sono quindi i modelli base?

- L'anno scorso, alla WWDC, Apple ha rilasciato un modello linguistico end-to-end con 3 miliardi di parametri , nonché la sua successiva versione aggiornata.

- Modello ChatGPT personalizzato per client/Apple.

——Almeno queste due categorie sono note (i tipi di modello specifici sono sconosciuti e Apple non ha ancora fornito informazioni più specifiche ai non sviluppatori). Attualmente, il "Basic Model Framework" supporta nativamente Swift (altri linguaggi sono sconosciuti) e gli sviluppatori necessitano solo di poche righe di codice per accedervi, supportando la generazione di contenuti, le chiamate agli strumenti e altre funzionalità LLM.

Ma al giorno d'oggi gli sviluppatori hanno troppa scelta: DeepSeek, Claude, la serie O, Gemini… e i loro vari modelli ufficiali e versioni riqualificate per scenari specifici. Perché dovrebbero competere con il modello base di Apple?

La proposta di valore di Apple è semplice.

In parole povere, l'utilizzo di questi LLM comporta un costo economico diretto. Maggiore è il numero di utenti e il livello di attività/adesione, maggiore è il costo per chiamare l'API cloud e generare token.

Di fronte a questo tipo di costi, le startup più promettenti possono raccogliere fondi attraverso il capitale di rischio e le grandi aziende possono utilizzare le riserve di liquidità per sovvenzionarle. Di conseguenza, gli utenti di oggi sono da tempo abituati a prodotti LLM gratuiti.

Ma per gli sviluppatori di piccole e medie dimensioni, in particolare quelli indipendenti, questo diventa un problema molto pratico: immagina che un utente abbia appena scaricato la tua app e voglia provare la tua funzione di intelligenza artificiale e veda subito "Ci sono 3 quote di generazione gratuite questo mese"… e se uno dei tuoi concorrenti è una grande azienda, come puoi competere con loro?

Ora Apple si rivolge a voi con il "Basic Model Framework" e vi mette a disposizione gratuitamente il modello end-side, consentendovi di sfruttare la potenza di calcolo locale di iPhone/iPad/Mac per eseguire ragionamenti LLM in modo rapido, efficiente e privato, per soddisfare le esigenze degli utenti.

Non devi più preoccuparti della tua catena di capitali per pagare le commissioni delle API cloud; non devi più "modificare" la tua strategia di prezzo per coprire i costi dei token. Puoi scegliere con fermezza e con competenza il modello di business che preferisci e che mette a tuo agio i tuoi utenti: che tu sia uno sviluppatore piccolo, medio o indipendente, non ti sembra fantastico?

È una situazione vantaggiosa per sviluppatori e utenti: ovviamente, se si aggiunge Apple al mix, la situazione è vantaggiosa per tutti.

"In ritardo ma arrivato", versione AI

Il noto sviluppatore e analista Apple John Gruber ha scritto un post molto interessante sul suo blog qualche giorno fa.

Ha sottolineato che Apple è sempre indietro rispetto ai suoi concorrenti per quanto riguarda alcuni prodotti/tecnologie chiave, cosa che tutti sanno; ma bisogna ammettere che nella storia dell'azienda, Apple non si è lasciata sfuggire nessuna importante rivoluzione tecnologica di livello paradigmatico.

Ad esempio, il browser Safari di Apple e il suo kernel WebKit furono lanciati all'inizio del 2003, otto anni dopo il browser Netscape che un tempo fece scalpore in tutto il mondo e minacciò persino di mandare Microsoft fuori dal mercato, e addirittura tre anni dopo lo scoppio della "bolla .com" – ma meglio tardi che mai, per non parlare del fatto che prima di Safari non esisteva un buon browser sulla piattaforma Mac.

Se si applica questa logica, Apple, costretta a entrare nell'era dell'intelligenza artificiale, ha bisogno di una nuova combinazione di tecnologie di prodotto che possa essere paragonabile a quella di Safari/WebKit odierna.

La buona notizia è che, come accennato all'inizio di questo articolo, le spedizioni e la quota di mercato dell'iPhone sono eccessive. Per quanto il mondo esterno prenda in giro Apple per il suo ritardo nell'era dell'intelligenza artificiale, una realtà non può essere negata:

Per molto tempo ancora, Apple avrà ancora voce in capitolo nel definire il modo in cui gli utenti utilizzano l'intelligenza artificiale (sui prodotti iPhone/iPad/Mac/Vision), anziché lasciare che sia l'intelligenza artificiale a definire l'aspetto dei suoi prodotti.

Come puoi vedere, OpenAI ha acquisito l'azienda dell'ex responsabile del design Apple Jony Ive, nel tentativo di sviluppare un nuovo dispositivo con fattore di forma "completamente nativo per l'intelligenza artificiale"; ma puoi anche vedere che OpenAI e Apple hanno raggiunto un accordo per diventare l'unico "partner intelligente globale" nell'ecosistema Apple, ovvero l'unico fornitore esterno del modello base.

Apple pensa di essere in ritardo rispetto a OpenAI? No. Altrimenti, Apple dovrebbe pagare OpenAI. Al contrario, secondo The Information, OpenAI pagherà ad Apple un "pedaggio" per entrare nell'ecosistema Apple e diventare il modello base predefinito, proprio come il suo predecessore Google, che è diventato il motore di ricerca predefinito per iOS.

Se la quota di abbonamento mensile per gli utenti di ChatGPT è di 20 $, la commissione di Apple potrebbe arrivare fino al 30% e questo ricavo è quasi pari al profitto puro.

Vedete, Apple raccoglie denaro da OpenAI e poi sovvenziona sviluppatori e utenti finali sotto copertura: non è abbastanza sorprendente?

Alla conferenza sui risultati del primo trimestre di Apple del 2009, Cook, che ricopriva per la seconda volta la carica di CEO ad interim di Apple perché Jobs era gravemente malato, pronunciò alcune parole che in seguito sarebbero diventate note come il "Credo di Cook". Una di queste parole era:

Riteniamo di dover possedere e controllare le principali tecnologie alla base dei prodotti che realizziamo e di partecipare solo ai mercati in cui possiamo apportare un contributo significativo.

Insieme all'analisi di John Gruber, ho riassunto questa idea in una frase:

Apple dovrebbe creare un dispositivo, un operatore per gestire prodotti/servizi/LLM basati sull'intelligenza artificiale, e poi utilizzare questo dispositivo/operatore per definire come le persone utilizzano l'intelligenza artificiale, anziché lasciare che sia l'intelligenza artificiale a definire come sviluppare i prodotti.

Dopo la WWDC25, il mondo esterno potrebbe adottare questa nuova prospettiva quando osserva e commenta il lavoro di Apple sull'intelligenza artificiale.

Aggiornamento intelligente e micro di Apple

Infine, diamo un'occhiata ad altri nuovi annunci sull'intelligenza artificiale fatti al WWDC25.

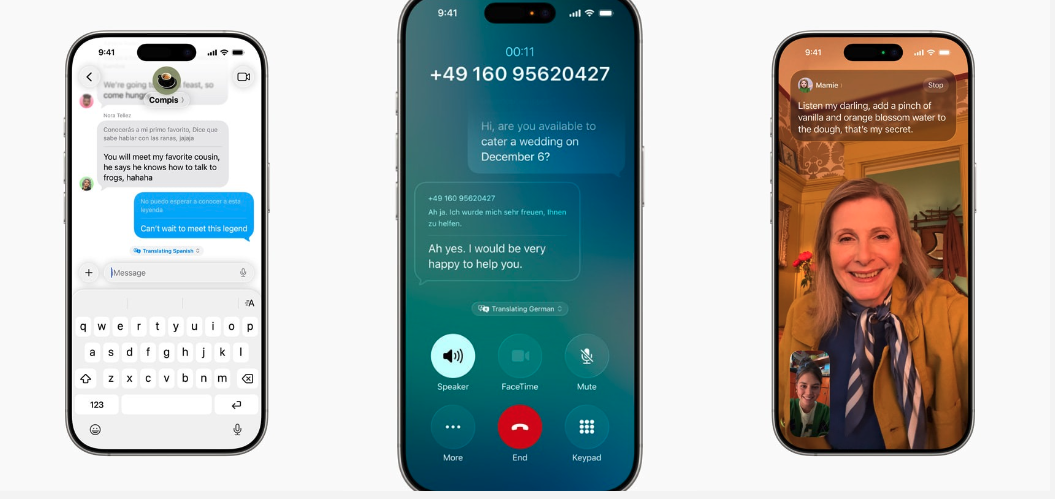

Traduzione in tempo reale

Apple ha finalmente integrato in iOS/iPadOS/macOS una funzione di traduzione in tempo reale che raggiunge il livello di riferimento del settore (due o tre anni fa).

Attualmente, la traduzione in tempo reale supporta tre applicazioni: Messaggi, Telefono e FaceTime. Tutte le traduzioni possono essere completate completamente lato client.

- Quando si invia un messaggio, l'utente può inserirlo nella propria lingua, visualizzare in tempo reale sull'interfaccia utente il testo tradotto in lingua straniera e quindi fare clic manualmente per inviarlo; allo stesso modo, il messaggio inviato dall'altra parte può essere tradotto automaticamente sull'interfaccia utente locale dell'utente.

- Al telefono, il testo originale viene prima letto e poi entrambe le parti possono ascoltare il testo tradotto.

- In FaceTime, una delle due parti può parlare e l'altra può vedere i sottotitoli tradotti.

Genmoji e Image Playground

Genmoji: gli utenti possono ora utilizzare i comandi di prompt LLM per generare avatar Genmoji con più nuovi elementi. Ad esempio: combinare un bradipo e una lampadina.

In Image Playground, gli utenti possono richiamare il modello multimodale di ChatGPT per generare foto di stili diversi o casuali: potete considerarlo come una shell ufficiale di Apple OpenAI 4o.

Intelligenza visiva

Visual Intelligence ha già supportato la ricerca di foto dalla fotocamera e, alla WWDC di quest'anno, ha ricevuto un altro sorprendente aggiornamento: il supporto per la ricerca di screenshot/interazione successiva.

Ad esempio, puoi cercare direttamente gli elementi nello screenshot chiamando qualsiasi app dell'App Store, oppure leggere la data, l'ora e la posizione nello screenshot e aggiungerli a un elemento del calendario o a un promemoria.

(L'intelligenza visiva sta finalmente raggiungendo ciò che Google Image Search e Lens hanno realizzato 6 o 7 anni fa.)

Ma la cosa principale che lascia senza parole è che il metodo di interazione è troppo antiquato: screenshot, invece di essere come i telefoni Android della prima metà del 2025, che possono leggere e rispondere direttamente al contenuto sullo schermo dell'utente senza acquisire screenshot, e hanno persino funzionalità di agente che possono controllare direttamente lo schermo per conto dell'utente.

Naturalmente, da quanto ho capito, Apple potrebbe farlo per due motivi: 1) le sue capacità sono effettivamente inferiori a quelle dei produttori Google/Android; 2) per questioni di privacy, gli utenti sono costretti a effettuare manualmente degli screenshot e a cliccare sul pulsante di riconoscimento visivo intelligente.

Scorciatoie

Le scorciatoie supportano gli smartphone Apple, quindi gli sviluppatori possono apportare modifiche e adattare le proprie app, consentendo agli utenti di generare rapidamente scorciatoie per le app. Non so quante persone usino le scorciatoie, ma dovrebbero essercene decine in tutto il mondo.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.