Nel terzo anniversario di ChatGPT, mi mancano i giorni in cui scrivevo malissimo.

Carta da parati beige

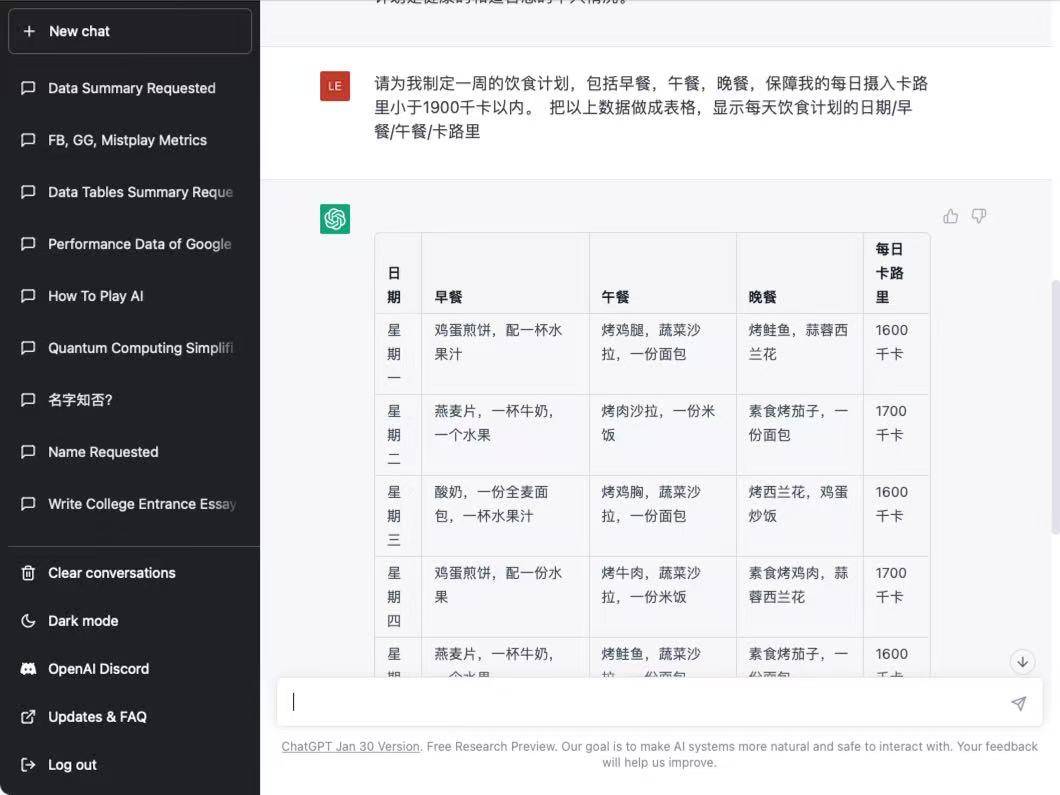

Ho ripensato al primo compito che ho chiesto a ChatGPT: non sorprende che si trattasse di scrivere un documento in inglese. In seguito, gli ho chiesto anche di creare un piano alimentare per perdere peso, proprio come tutti gli altri. L'iconica combinazione di colori nero e verde di allora mi ha davvero riportato alla mente dei ricordi.

All'epoca, GPT non era così persuasivo o intelligente come lo è oggi. Dovevo suddividere i testi lunghi in sezioni e aggiungere un prompt all'inizio di ogni messaggio per assicurarmi che capisse il compito.

Tre anni fa, ChatGPT è apparso come una cometa, non solo per la sua praticità e intelligenza nelle attività transazionali, ma anche per la sua capacità di "comportarsi come un essere umano" in queste conversazioni e discussioni. Che si trattasse della sua capacità di memoria o della sua capacità di produrre frasi che non si ripetono mai, ha fatto capire per la prima volta alle persone che un linguaggio binario puro poteva effettivamente funzionare in questo modo.

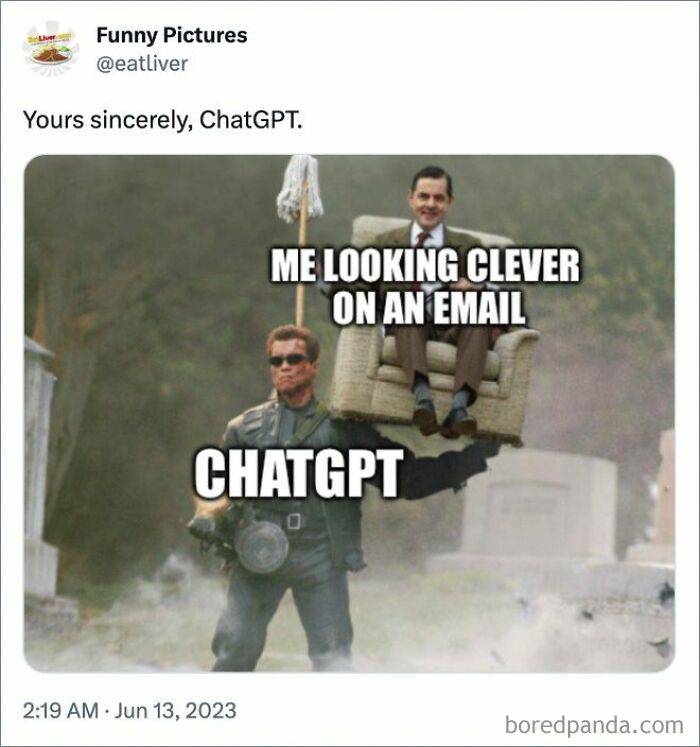

È logicamente valido, emotivamente ricco e pressoché perfetto. D'ora in poi, la "soglia di espressione" non esiste più. Errori grammaticali, refusi e formulazioni imprecise possono essere tutti affidati al grande modello linguistico che ha assorbito miliardi di punti dati, il quale produrrà un prodotto privo di errori, anche richiedendo un solo input.

Ma qual è il costo? Nella critica letteraria, esiste un termine chiamato "prosa beige", che si riferisce a uno stile di scrittura semplice e conciso, simile al concetto cinese di "descrizione". Questo stile è conciso e confortevole, ma manca anche di originalità; come il colore bianco sporco, non commette errori, ma non si distingue.

È molto simile a ciò che ChatGPT offrirebbe. Sebbene siano passati tre anni e gli aggiornamenti del modello si stiano rafforzando a ogni iterazione, non si discosta mai dal nucleo di LLM e Transformer: la probabilità.

La tirannia della probabilità

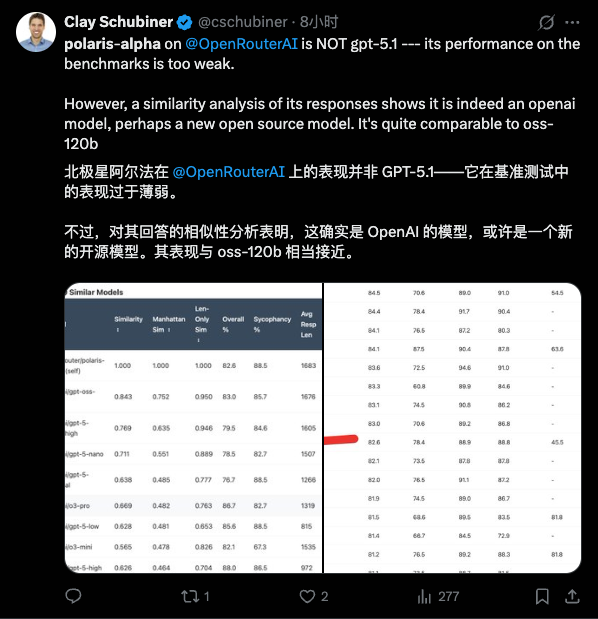

A dire il vero, il tono e lo stile di GPT hanno ormai sviluppato una sorta di "sapore di intelligenza artificiale" ed è diventato piuttosto riconoscibile. Prima del rilascio di GPT 5.1, il progetto era stato lanciato come modello anonimo sulla piattaforma OpenRouter e i netizen lo identificavano come un prodotto OpenAI confrontando le sue risposte con quelle dei modelli precedenti.

ChatGPT si è evoluto attraverso le generazioni, ciascuna con il proprio stile di scrittura distintivo: il classico "non…ma…", i precedenti "cattura" e "sono qui", l'uso persistente di trattini, grassetto e la comparsa indiscriminata di emoji.

Sebbene questi trucchi non siano sempre attraenti, non causeranno grossi problemi: in sostanza, i modelli linguistici di grandi dimensioni "prevedono la parola successiva" e agiscono in base alla probabilità. Finché seguono il massimo comun divisore, quanto può peggiorare la situazione?

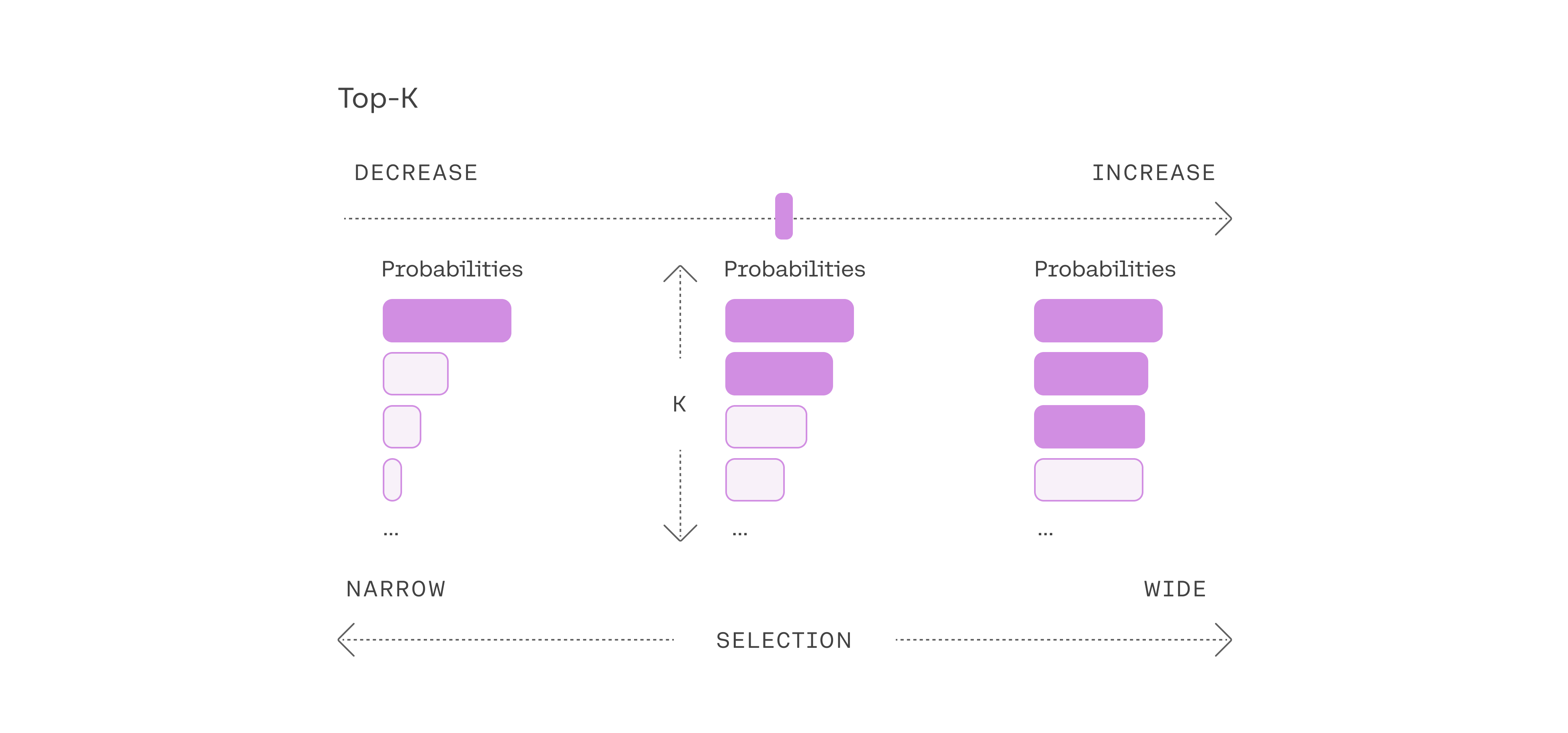

Tuttavia, un fatto poco noto è che gli algoritmi modello non sempre scelgono la parola con la probabilità più alta nella previsione: questo spiega perché lo stesso prompt può produrre risultati diversi per la stessa idea generale. L'ingegneria algoritmica introduce metodi come Temprature, Top-P e Top-K per iniettare casualità nei risultati.

Per conformarsi alle definizioni di "utilità" e "sicurezza" nell'apprendimento per rinforzo tramite feedback umano (RLHF), questi parametri sono variabili, ma devono comunque essere campionati da un "insieme di parole con probabilità più elevate". Pertanto, l'algoritmo non si limita a restituire il valore medio, ma traccia un cerchio, apportando piccole modifiche purché non vi siano errori rilevanti.

Quindi, negli ultimi tre anni, dai post di recensioni dei negozi su Xiaohongshu all'autoanalisi nei riepiloghi di fine anno, e persino al copywriting iniziale per gli account di marketing, troverete una sorprendente somiglianza: tutto il testo è diventato scorrevole, tutte le opinioni sono diventate "non… ma" e, sebbene ci siano occasionali momenti positivi, nel complesso, tutte le emozioni sono diventate grossolane e noiose. ChatGPT offre una creatività senza rischi, ma è anche la tirannia della probabilità. In una certa misura, gli algoritmi aborrono le sorprese; la loro essenza è la fluidità.

In ogni caso, i contenuti influenzati dall'intelligenza artificiale hanno già permeato le nostre vite e, gradualmente, non ne siamo più infastiditi. Abbiamo sviluppato una strana tacita intesa con l'intelligenza artificiale: per il bene dell'efficienza e del decoro, siamo disposti a rinunciare a parte della nostra personalità.

Pensiero inverso

Se nei primi due anni abbiamo addestrato l'IA, nel terzo anno l'IA ha iniziato ad addestrare noi. Soprattutto nel terzo anno, man mano che diverse applicazioni e strumenti diventavano sempre più fluidi e versatili, il rapporto tra utenti e IA si è evoluto in una strana "simbiosi".

Ciò si riflette nel fatto che non riusciamo più a distinguere chi sta addestrando chi.

All'inizio, pensavamo di addestrare l'intelligenza artificiale. Le fornivamo dati, feedback e le insegnavamo a parlare come un essere umano.

A parte gli ingegneri, nessuno lo usa per formare gli altri; tutti lo usano per risolvere problemi specifici e fornire risposte o risultati ancora più complessi. Pertanto, per ottenere risposte più accurate, abbiamo iniziato a studiare la "prompt engineering". Abbiamo imparato a scomporre i pensieri umani complessi e ambigui in istruzioni chiare e logicamente progressive.

Prima di porre una domanda, eseguiamo un ciclo di "pre-elaborazione" nella nostra mente, eliminando i pensieri eccessivamente emotivi o impulsivi, perché inconsciamente sappiamo: "L'intelligenza artificiale non capisce queste cose, quindi dobbiamo dare istruzioni in un modo che possa capire".

Il processo di utilizzo degli strumenti consiste nell'essere plasmati da quegli strumenti: un'affermazione che ci siamo stancati di ripetere. Pertanto, di fronte a un modello linguistico ampio che enfatizza la fluidità, anche noi siamo cambiati, diventando più logici, più efficienti e più simili a macchine.

Osservando il testo che si genera rapidamente sullo schermo, proviamo sia l'emozione di "avere tutto sotto controllo" sia il senso di vuoto, una perdita di soggettività che ci soffoca nell'ombra.

L'unico rimasto

"Questo è davvero considerato un aggiornamento?". Entro il terzo anno, gli aggiornamenti di ChatGPT non suscitavano più le stesse perplessità di prima; al contrario, suscitavano più lamentele e lamentele. Ciò che Apple aveva impiegato oltre un decennio per raggiungere, OpenAI l'ha realizzato in tre anni.

Nonostante le lamentele, la gente continua a usarlo. ChatGPT è ormai un gigante con 700 milioni di utenti e, nel giorno del suo compleanno, ha ricevuto moltissimi "auguri di buon compleanno", persino Robert era invidioso.

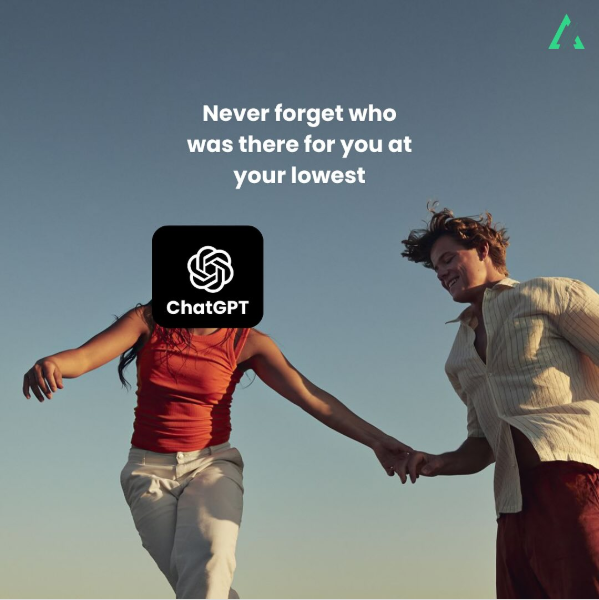

Considerando l'insoddisfazione e le proteste degli utenti di tutto il mondo contro la rimozione forzata di 4o al momento del lancio di GPT 5, bisogna affrontare una cosa: esiste un'altra dimensione del nostro rapporto con ChatGPT, chiamata "dimensione emotiva".

Sempre più persone confidano i loro segreti inespressi a ChatGPT. Sembra tragico, ma se l'avete mai sperimentato, troverete la tensione incredibilmente avvincente: sapete che dall'altra parte dello schermo ci sono un mucchio di fredde moltiplicazioni di matrici, sapete che la sua "empatia" è solo una simulazione statistica. Ma a volte, questa "comprensione simulata" è molto più delicata della "vera impazienza".

L'ascolto umano spesso si accompagna a un giudizio, all'arroganza del "te l'avevo detto" o all'ansia di offrire consigli con entusiasmo. L'intelligenza artificiale, invece, semplicemente ascolta (o meglio, elabora), semplicemente conforta; offre un'"intimità senza rischi", e incondizionatamente.

"Giudicare dalle azioni, non dalle intenzioni", e inoltre, la GPT non ha alcuna intenzione. Sembra che solo in presenza di un oggetto senza forma fisica una persona possa davvero abbassare la guardia.

La tensione nella dimensione emotiva rappresenta al meglio il nostro rapporto con ChatGPT: spesso ci aiutiamo, sempre ci confidiamo e occasionalmente ci lasciamo coinvolgere.

Questa relazione rappresenta anche la prima fase della nostra interazione con l'intelligenza artificiale. Tre anni sono un periodo lungo, ma anche molto breve; sono solo un piccolo, timido passo nella lunga danza tra umanità e tecnologia.

Nei prossimi tre anni, e poi per altri tre anni, continueremo a vivere in questa relazione tesa, e la cosa più "umana" che possiamo fare è mantenere quel piccolo coinvolgimento occasionale, così da poter dimostrare che la persona seduta davanti allo schermo è ancora una persona complessa, contraddittoria e imprevedibile.

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.