“Rabbit Trampoline” ha oltre 500 milioni di visualizzazioni! Questo video di intelligenza artificiale, il più popolare su Internet, è il risultato dell’amore degli umani per essere “ingannati”

Un video di un "trampolino per conigli" che sembra ripreso da un sistema di videosorveglianza notturna è diventato virale su TikTok, accumulando 500 milioni di visualizzazioni in tutta la rete.

Il video sembra ripreso da una telecamera di sicurezza. L'illuminazione è scarsa e l'immagine è sfocata, ma cattura perfettamente diversi conigli che saltano a turno, come se si stessero esibendo in uno spettacolo notturno.

La didascalia del video recita: "Ho appena controllato la sicurezza di casa mia e credo che abbiamo degli ospiti speciali nel nostro cortile! @Ring."

Grazie alle riprese sfocate delle telecamere di sorveglianza e ai pochi conigli che sembravano fare festa, questa immagine carina e leggermente realistica ha subito attirato l'attenzione della gente.

@Greg, una celebrità con milioni di follower sulla piattaforma social X, ha commentato: "Fino a oggi non mi ero mai reso conto di aver bisogno di un gruppo di coniglietti da trampolino".

Tuttavia, questa tenerezza è finta. Il coniglio nel video non esiste nella vita reale. Alcuni hanno scoperto che è stato generato dall'intelligenza artificiale.

Tra il quinto e il sesto secondo, il coniglio nell'angolo in alto a sinistra improvvisamente "scompare". Ripensandoci, i dettagli sono davvero un po' strani.

Ma a differenza della maggior parte dei video sugli "errori dell'intelligenza artificiale", questo è risultato quasi irriconoscibile fin da subito. Persino i giovani spettatori più esperti hanno esclamato: "Oh no! Mi hanno fregato!"

Ma non si è trattato di una truffa, è stato piuttosto un piccolo disastro sui social media: non che siamo stati ingannati, ma che eravamo disposti a essere ingannati .

Sembra giusto, ma in realtà è giusto

Il motivo per cui questo video basato sull'intelligenza artificiale è riuscito a "ingannare" con successo il pubblico non è dovuto principalmente alla perfezione della tecnologia di generazione dei video basati sull'intelligenza artificiale, ma al fatto che "inganna nel modo giusto".

Sfrutta accuratamente le nostre impressioni innate sui video di sorveglianza e colpisce anche quelle password del traffico che più probabilmente ci faranno abbassare la guardia.

La scarsa qualità della visione notturna e gli sfondi statici nascondono solo i punti deboli dell'IA

Siamo abituati a pensare che i filmati di sorveglianza notturna siano sfocati, scuri e pieni di rumore. Questa idea preconcetta maschera efficacemente i difetti tecnici dei video basati sull'intelligenza artificiale, come problemi di continuità del movimento, dettagli delle ombre e dinamiche dello sfondo.

Quindi, quando appare sotto forma di "video di sorveglianza notturna", la bassa definizione e la sfocatura dell'immagine diventano di per sé un'esca, contribuendo a mascherare la mancanza di realismo.

▲ La qualità video soddisfa le caratteristiche della sorveglianza notturna e lo sfondo è completamente immobile.

Inoltre, mentre alcuni modelli di generazione video basati sull'intelligenza artificiale sono piuttosto efficaci nel gestire i soggetti in primo piano, la resa dello sfondo appare spesso molto surreale.

Lo sfondo di questo video è statico, il che aiuta l'IA a superare una difficoltà tecnica.

Il copywriting con "@Ring" aumenta la credibilità della fonte

L'editore del video ha abilmente taggato il marchio di telecamere di sicurezza per la casa "Ring" nel titolo, il che ha fatto subito sembrare ragionevole la fonte del video e ha fatto sentire le persone più autentiche.

▲ Ring è un marchio di telecamere per la casa

Questo piccolo dettaglio crea l'illusione che "questo video sia stato ripreso dal campanello di qualcun altro", facendo sì che le persone lo classifichino automaticamente come "registrazione di vita" piuttosto che come "contenuto creativo".

"Animali che fanno cose di notte" è un meme che gli utenti di Internet hanno accettato di default

Innumerevoli video virali ci hanno condizionato a credere che questa scena sia reale. Gatti che rubano noodles istantanei di notte, procioni che irrompono nelle piscine, coyote che giocano sui tappeti elastici: gli animali amano sempre "infrangere le regole" quando non ci sono umani. Un trampolino per conigli sembra perfettamente plausibile, da qualunque punto di vista lo si guardi.

▲ L'orso irrompe in piscina

Ma soprattutto: è così carino! Chi potrebbe mettere in dubbio un momento così tenero? Quando qualcosa è dolce e leggero, è facile per noi "scegliere di credere".

Sebbene il coniglio nell'angolo in alto a sinistra del video scompaia improvvisamente al centro, rivelando la sua natura generata dall'intelligenza artificiale, per la maggior parte degli spettatori che scorrono rapidamente i video brevi, questo difetto momentaneo viene facilmente trascurato.

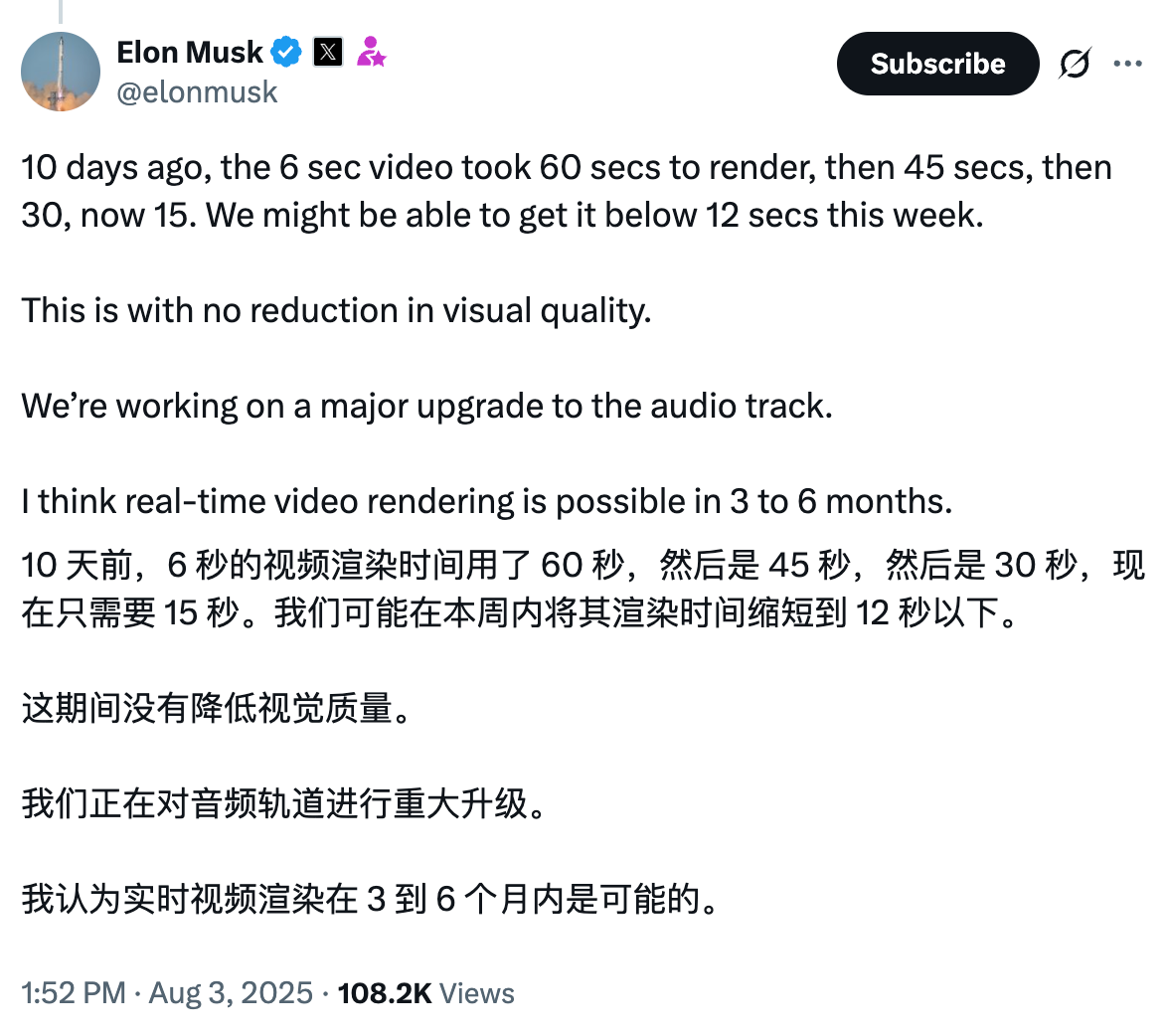

Mentre il video del coniglio scatenava un acceso dibattito, Musk ha anche condiviso gli incredibili progressi della tecnologia video basata sull'intelligenza artificiale.

Dieci giorni fa, un video di 6 secondi impiegava 60 secondi per essere renderizzato, poi è sceso a 45 secondi, poi a 30 secondi e ora è sceso a 15 secondi.

Questa settimana potremmo riuscire a scendere sotto i 12 secondi.

Ha inoltre affermato che si prevede che la tecnologia di rendering video in tempo reale sarà realizzata entro 3-6 mesi.

▲ Screenshot del Twitter di Musk

Ciò significa che i bug nelle foto della "scomparsa del coniglio" che possiamo ancora vedere oggi potrebbero essere quasi difficili da individuare tra qualche mese.

Quando i video realizzati con l'intelligenza artificiale sono tecnicamente impeccabili, diventa inutile discutere di "come distinguere il vero dal falso".

Ciò ci costringe anche a spostare la nostra attenzione dalla tecnologia in sé a questioni più fondamentali.

Non è l’intelligenza artificiale che ci inganna e ci fa godere

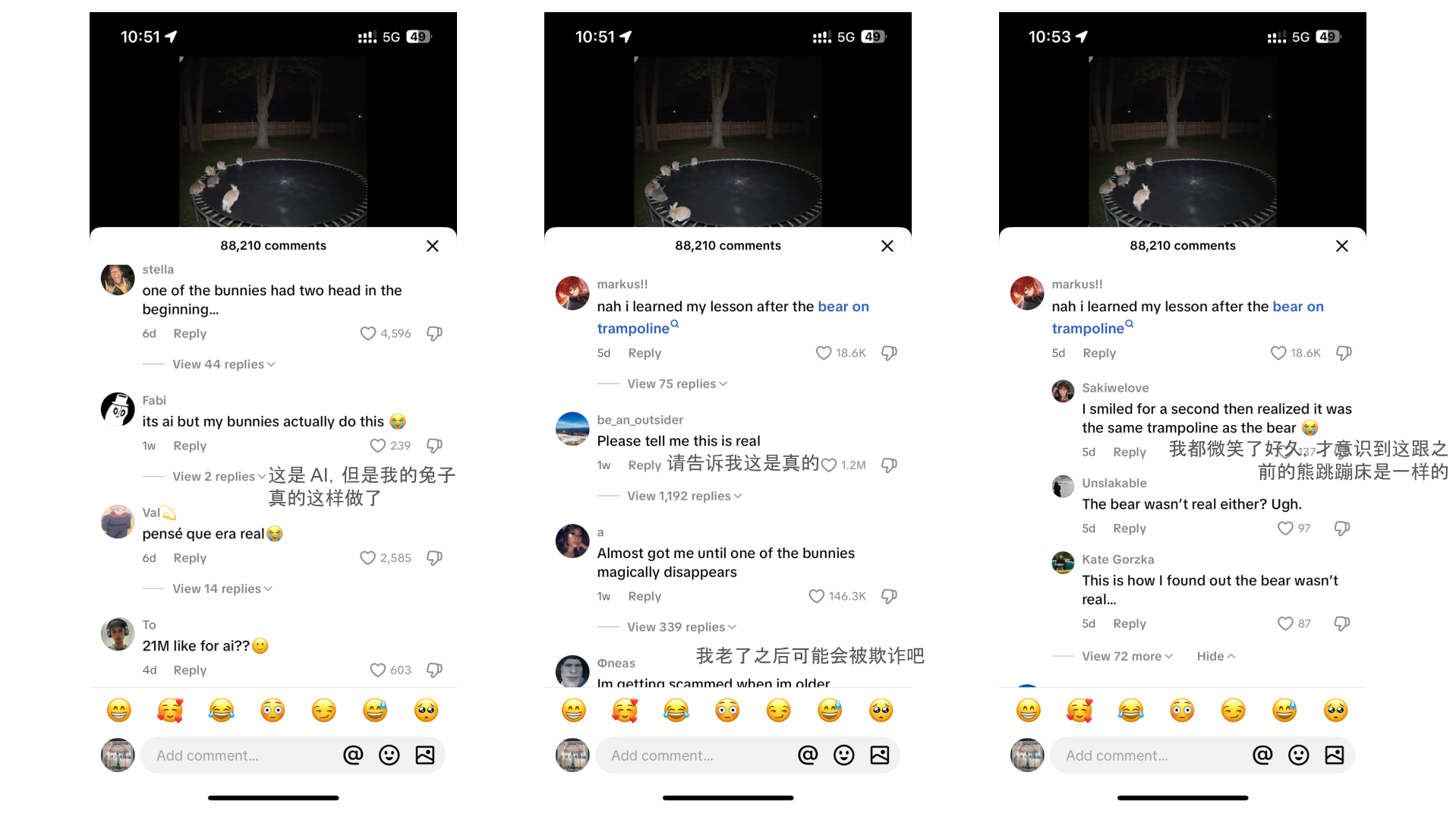

Dopo che è stata rivelata la verità sul video, molti utenti hanno espresso un sentimento di "crollo della fede".

Un utente di TikTok ha detto: "Questo è il primo video di intelligenza artificiale che credo sia reale. Quando invecchierò sarò decisamente nei guai". Un altro utente ha detto: "Ora penso che diventerò uno di quegli anziani che vengono truffati".

Questo passaggio emotivo dalla fiducia al panico è diventato un nuovo argomento di attualità online.

Tuttavia, limitarsi ad attribuire la causa del problema allo "sviluppo troppo rapido dell'intelligenza artificiale" o al "noi siamo troppo facilmente ingannabili" rischia di trascurare questioni più profonde. Il nocciolo di questo incidente potrebbe non risiedere nella tecnologia dell'intelligenza artificiale in sé, ma nelle pratiche stesse delle piattaforme di social media.

Esaminando i commenti al video, abbiamo scoperto che le reazioni delle persone nella sezione commenti mostravano quasi lo stesso copione psicologico.

Per prima cosa, "Oh mio Dio, è così carino";

Poi, "Aspetta, qualcosa non ti sembra giusto?";

Il terzo passo è: "Sono stato imbrogliato? È finita. Diventerò una persona anziana che viene imbrogliata?"

Alla fine ci sono tornato sopra: "Ma… non lo biasimo."

Stiamo definendo una nuova "logica di interazione" con i video basati sull'intelligenza artificiale.

Non ci crediamo del tutto, ma diamo per scontato che potrebbe essere falso, ma siamo comunque disposti a fermarci e a dare un'occhiata, a metterci "mi piace", a inoltrarlo agli amici e a fare un'ipotesi, proprio come in un gioco.

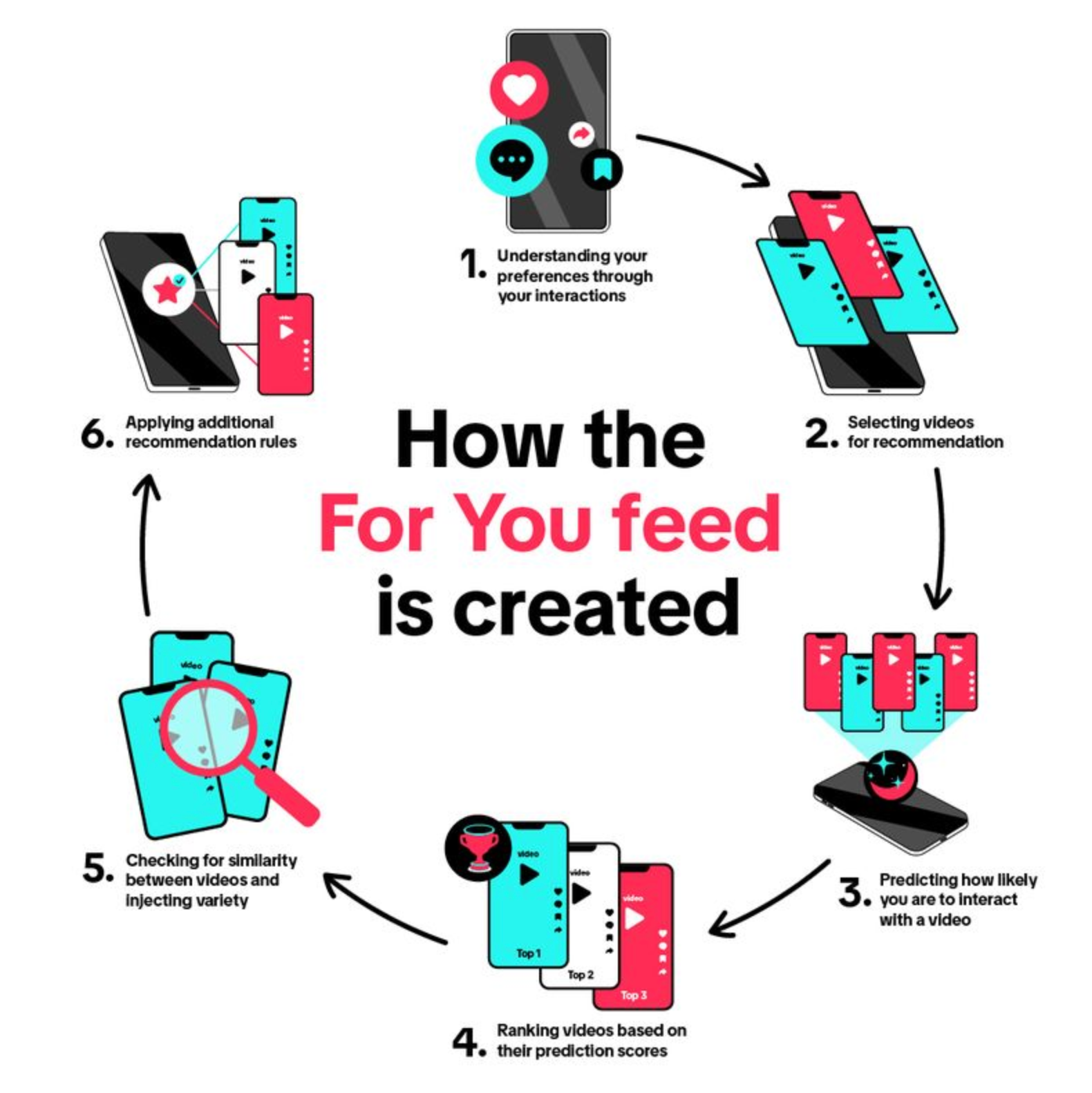

▲ Sistema di raccomandazione di piattaforme video brevi

Anche l'algoritmo della piattaforma è ben consapevole di questa struttura psicologica.

In questo processo, la questione se il video dell'IA sia autentico o falso non è più la questione chiave; diventa piuttosto una barriera all'ingresso: lo capisci? Riesci a distinguerlo? Sei stato ingannato?

Negli ultimi due anni, dall'esplosione dell'intelligenza artificiale, ci siamo sempre lamentati del fatto che i video e le immagini realizzati con l'intelligenza artificiale siano diventati così realistici da farci prendere dal panico e preoccuparci di essere più facilmente ingannati da false informazioni in futuro.

Tuttavia, la diffusione virale di questo video non è dovuta esclusivamente alla "capacità ingannevole" della tecnologia dell'intelligenza artificiale, ma piuttosto al profondo bisogno del pubblico umano di essere "ingannato".

Non tutti questi internauti sono stati ingannati passivamente, ma molti di loro hanno partecipato attivamente e tacitamente a un gioco collettivo chiamato "far finta di credere".

Il protagonista di questo carnevale non è l'intelligenza artificiale, ma noi stessi.

È stato il "flash" del coniglio che sparisce nel video a far degenerare l'intero incidente in un gioco "trova le differenze" a cui ha partecipato l'intera rete. Se il video fosse stato perfetto e senza interruzioni, avrebbe potuto essere rapidamente coperto dal video successivo.

▲ Il film "The Prestige"

È come se il pubblico sapesse che il mago lo sta "imbrogliando", ma ciò che apprezza è proprio la sfida cognitiva di "sapere che è falso, ma non essere in grado di vedere il difetto".

La "scoperta" del coniglio AI è stato il momento in cui la magia è stata svelata, consentendo a tutti di partecipare alla discussione e innescando la diffusione dell'idea.

I difetti creano controversie, e le controversie stimolano la partecipazione. L'autenticità del video non ha più importanza; la confusione e la discussione che suscita sono garanzia di traffico.

Questa osservazione autoironica "Anch'io sono stato truffato" colma rapidamente la distanza psicologica tra sconosciuti online, favorendo un senso di comunità: "Siamo tutti facilmente ingannabili ". Il legame che si crea "essendo truffati insieme" ha un valore sociale molto più grande dell'autenticità del contenuto video stesso.

L'ideale sarebbe imparare ad apprezzare consapevolmente questi "contenuti falsi", mantenendone una chiara comprensione, ma per la maggior parte delle persone questo potrebbe non essere facile.

Il potenziale pericolo non risiede solo nel realismo dell'IA, ma anche quando questo "inganno collettivo" viene utilizzato per scopi dannosi, come la creazione di voci o truffe. Ciò che dobbiamo stabilire è la capacità di identificare l'"intento" delle informazioni, piuttosto che limitarci a giudicarne la "verità".

Potremmo chiederci più spesso: come questo contenuto vuole che io mi senta? Cosa vuole che io faccia, in definitiva?

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.