Trump si innamora di una donna delle pulizie: Internet sta ingannando tutti. Persino l’intelligenza artificiale viene ingannata. Di chi posso fidarmi?

Se ultimamente non siete stati bombardati da uno sketch intitolato "Trump si innamora di me, una donna delle pulizie della Casa Bianca", congratulazioni, potreste essere gli unici a non essere stati ingannati.

Il titolo di questo drama suona già di per sé come un romanzo sdolcinato e sdolcinato, e anche l'ambientazione è abbastanza magica: il presidente degli Stati Uniti Trump si innamora di Emily, una donna delle pulizie della Casa Bianca, ed è pronto ad abbandonare la moglie top model Melania per sposare Emily come First Lady. È davvero una "versione americana di The Legend of Zhen Huan + White House Love Brain".

La notizia ha immediatamente inondato tutte le principali piattaforme social. Molti importanti media, tra cui influencer che di solito appaiono piuttosto perspicaci, hanno iniziato a ripubblicare la storia, sostenendo che il breve drama, diventato virale all'estero, aveva incassato 150 milioni di dollari in tre mesi ed era diventato un nuovo beniamino tra le donne di mezza età e più anziane.

Ma ben presto la trama cambiò radicalmente e fu confermato che il breve dramma non esisteva affatto ed era una bufala dall'inizio alla fine.

Quindi, la domanda è: come ha fatto uno show che nessuno aveva visto a diventare virale in pochi giorni? E come ha fatto l'intelligenza artificiale ad alimentare l'hype, facendo sì che ancora più persone credessero a questa notizia inesistente?

Cosa è successo esattamente dietro tutto questo?

Come ha fatto un cortometraggio inesistente ambientato all'estero a ingannare gli umani e l'intelligenza artificiale?

Se pensi che si tratti solo di un malinteso, sottovaluti la complessità di questa comunicazione.

Secondo diverse fonti, questo episodio di fake news può essere fatto risalire al 1° luglio, quando un articolo è stato pubblicato da un account self-media chiamato "Overseas Student Daily". La selezione degli argomenti dell'account è specializzata in "curiosità" e nell'attrarre traffico. A giudicare dallo stile linguistico e dalla logica dei contenuti, l'articolo è stato probabilmente generato con l'ausilio di uno strumento di scrittura basato sull'intelligenza artificiale e poi rifinito manualmente.

Il problema è che, pur essendo un mezzo di informazione standard, viene spesso ripubblicato e citato da affermati organi di stampa nazionali. Il 23 luglio, lo Shin Min Daily News, una sussidiaria della Lianhe Zaobao di Singapore, ha pubblicato un articolo intitolato "I cortometraggi sui CEO di Overlord cinesi stanno arrivando in America".

Il rapporto era molto dettagliato, affermando che Trump aveva rinunciato alla moglie, la modella Melania, e che avrebbe sposato una madre single asiatica che aveva fatto le pulizie alla Casa Bianca come First Lady. Affermava persino che lo show aveva incassato 150 milioni di dollari in tre mesi. Il pubblico femminile di mezza età e anziano imprecava e spendeva soldi per lo show, e mentre imprecava, pagava per guardarlo.

▲ Il report è stato eliminato

Considerando che Lianhe Zaobao è un media con grande credibilità sulla rete Internet cinese, questa notizia è stata ampiamente diffusa dai media nazionali e diversi video blogger l'hanno interpretata… Si è formato un perfetto circuito chiuso di fiducia "dall'esportazione alle vendite nazionali".

Inoltre, una raffica di brevi video autentici e reportage grafici si diffuse rapidamente anche sulle piattaforme social d'oltreoceano. Questo "falso sketch" iniziò a essere spacciato per "notizia vera", con utenti di tutto il mondo che ci credettero, lo discussero e persino lo usarono per criticare le differenze estetiche tra Cina e Stati Uniti.

Tutti parlavano seriamente di qualcosa che non esisteva.

Finché alcuni media non hanno intuito che qualcosa non andava e hanno iniziato a indagare. La serie non era presente su nessuna piattaforma estera (tra cui ReelShort, YouTube e TikTok) e mancava anche da IMDb, il principale database mondiale di film e programmi televisivi.

Inoltre, i dirigenti delle principali compagnie nazionali di cortometraggi esportati all'estero si sono fatti avanti per smentire le voci. Ad esempio, Li Yuanjun, vicepresidente di "Tinghuadao", ha dichiarato senza mezzi termini che non avrebbero mai toccato questo genere. Anche le prove chiave a sostegno della bufala sono state smentite una dopo l'altra.

La prima immagine, un segmento satirico del varietà "Saturday Night Live", è stata personalmente smentita dall'attore Run Run Shaw. La seconda, una foto di Trump con una donna asiatica, è incredibilmente falsa; l'intera immagine ha un aspetto plastico, simile a quello di un'intelligenza artificiale.

▲Rete sorgente immagine

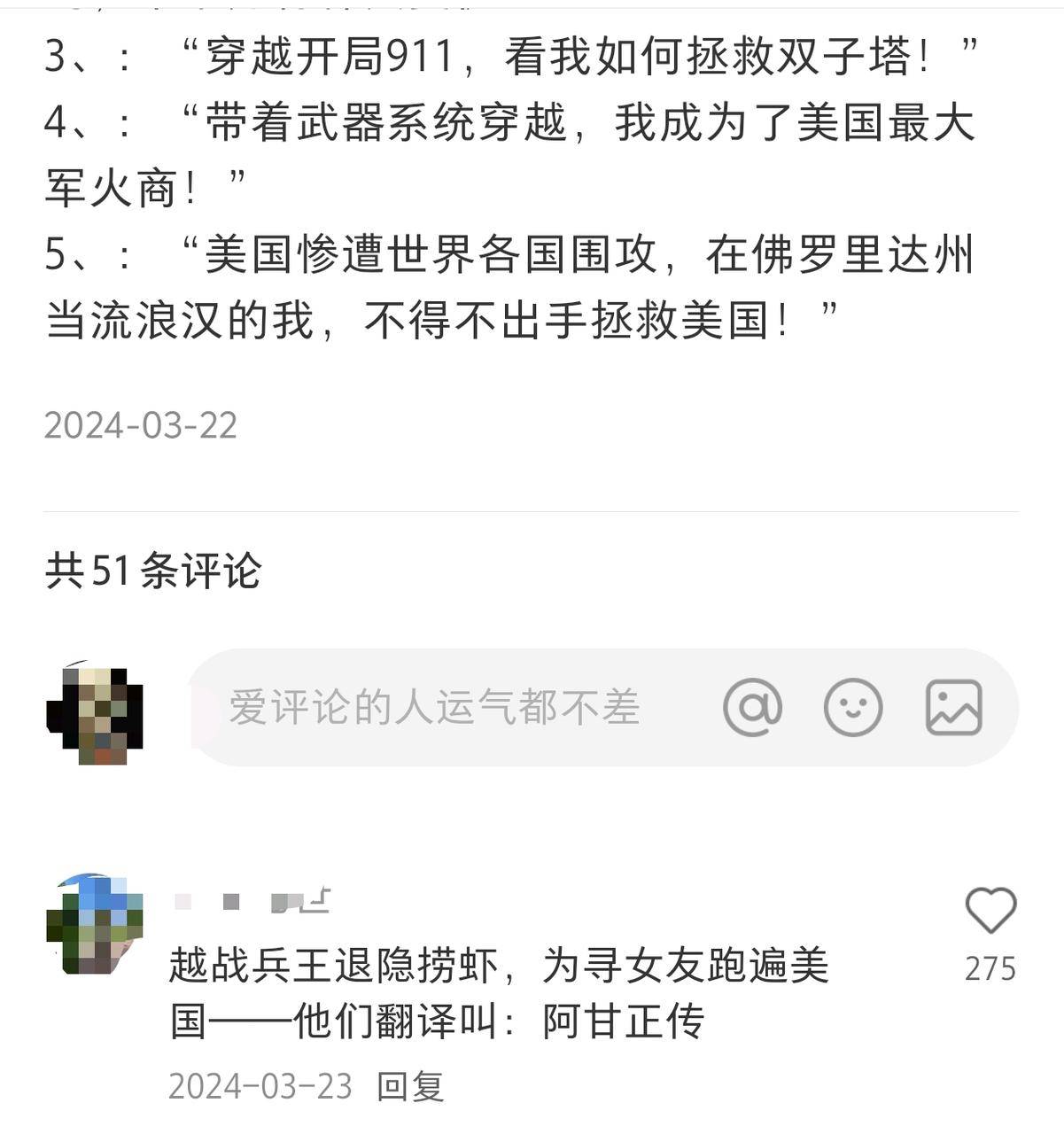

Se scorri più indietro nel tempo, troverai titoli simili e interessanti già attivi sulle piattaforme social:

"Quando scoppiò la Guerra Civile, Lincoln mi chiese di uscire dalla pensione tre volte!" "Ho viaggiato nel tempo e nello spazio fino all'11 settembre, guarda come ho salvato le Torri Gemelle"… Questi sono ovviamente i titoli di romanzi fantastici, ma per qualche ragione sono stati distribuiti da una persona a dieci, e da dieci a cento, e sono stati confezionati in veri e propri cortometraggi drammatici d'oltreoceano.

▲Screenshot da Internet

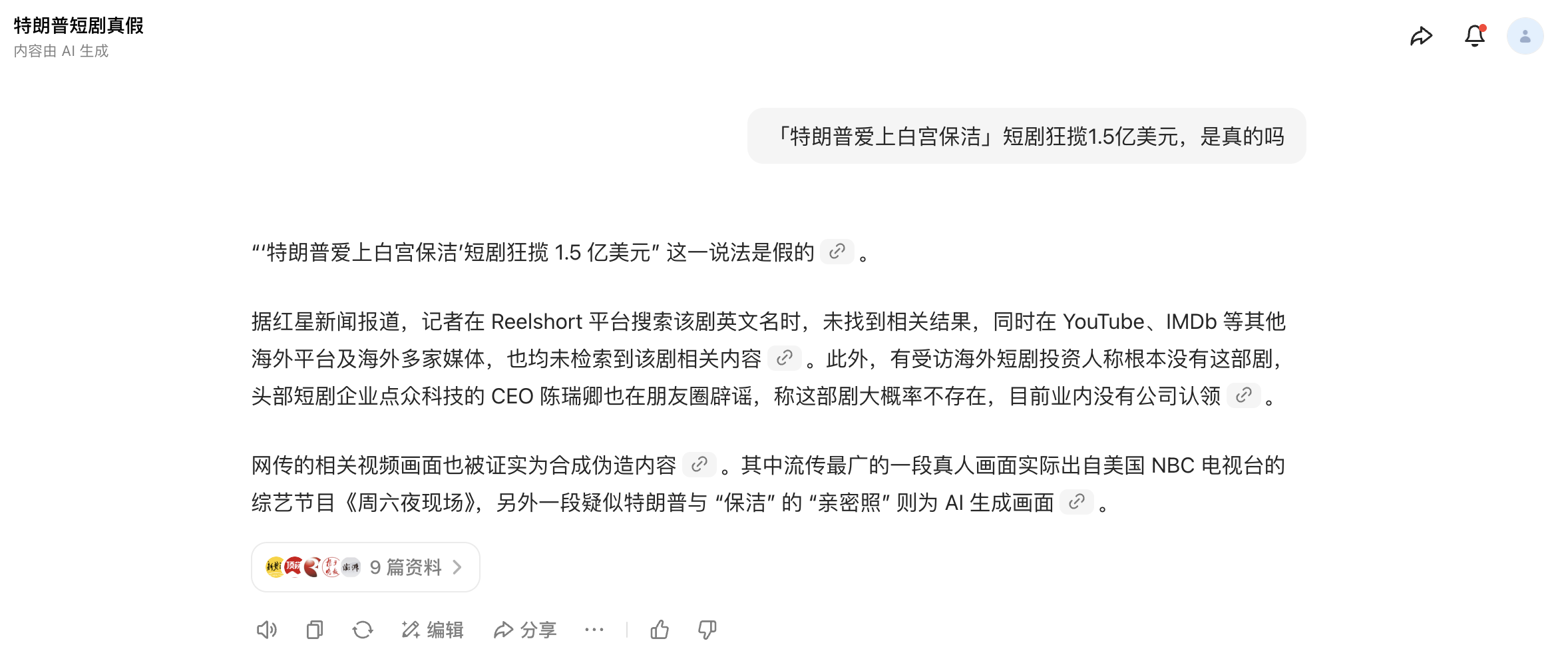

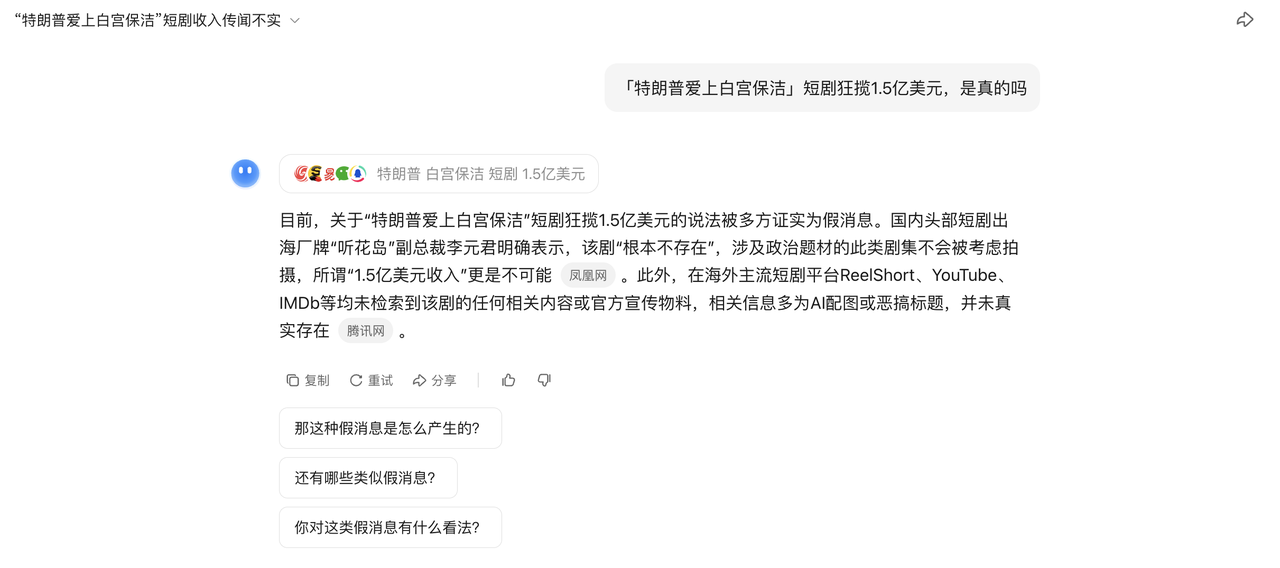

È interessante notare che perfino l'intelligenza artificiale ha creduto a questa voce prima che venisse smentita.

Prima che l'incidente venisse ufficialmente smentito da numerosi media, ho provato a verificare l'autenticità del breve drama utilizzando diversi strumenti di intelligenza artificiale di uso comune. Continuavano a sostenere con sicurezza che "questo drama esiste", e il motivo era ancora la verifica incrociata dei contenuti con immagini e testi provenienti da media autorevoli su più piattaforme.

Naturalmente, poiché ieri pomeriggio un gran numero di organi di informazione ha iniziato a smentire la voce, questi strumenti di intelligenza artificiale hanno aggiornato le ultime notizie e sono in grado di identificare correttamente che si tratta di fake news.

Spesso diciamo che la ricerca tramite intelligenza artificiale ha un problema di "allucinazione" perché a volte genera dal nulla risposte apparentemente ragionevoli ma completamente sbagliate.

Per "ingabbiare" le illusioni dell'IA, i produttori hanno compiuto numerosi sforzi tecnici: rafforzando i meccanismi di citazione, introducendo fonti attendibili e limitando il libero gioco del modello. Tuttavia, quando la base per le valutazioni di veridicità delle notizie da parte dell'IA deriva già da fake news, queste misure potrebbero non essere efficaci.

Se né gli esseri umani né l'intelligenza artificiale sono affidabili, di cosa altro possiamo fidarci?

A pensarci bene, è difficile dire che la popolarità di questa fake news sia casuale. Sebbene la storia possa sembrare assurda, ha i geni perfetti per la diffusione.

Presenta la formula classica di tutti i contenuti popolari: una struttura narrativa chiara, materiali illustrati, dati confezionati e un ritmo di diffusione preciso.

Gli sketch sdolcinati stanno diventando virali all'estero? Gli americani di mezza età e più anziani sono affascinati da temi eccentrici? TikTok sta diventando un prodotto d'esportazione culturale? Ognuna di queste ipotesi è plausibile e, se messe insieme, è difficile scartarle come false.

Inoltre, quando l'IA diventa sia vittima che divulgatrice di voci, spesso ciò avviene a causa di manipolazioni e promozioni dolose da parte degli esseri umani. In particolare, la maggior parte di questi contenuti generati dall'IA condivide diverse caratteristiche comuni:

Il costo di produzione è estremamente basso e una sceneggiatura può produrre un prodotto finito in pochi minuti; la capacità di diffusione è estremamente forte e il tasso di clic rimane elevato grazie alla combinazione di titoli clickbait e impatto visivo; la narrazione è estremamente accattivante, attacca specificamente le debolezze umane e utilizza contenuti ispiratori, sensazionalistici e curiosi in ogni modo possibile per stimolare le persone.

Il recente caso "Scuse di DeepSeek a Wang Yibo" ne è un tipico esempio. Un rapporto intitolato "Caso dell'attore Wang Yibo, annunciato il verdetto" sosteneva che DeepSeek si fosse scusata per aver diffuso in modo errato le informazioni di Wang Yibo, allegando un cosiddetto "verdetto penale" come prova.

Tuttavia, dopo diversi cicli di verifica dei fatti, si è scoperto che questa cosiddetta dichiarazione di scuse era in realtà un contenuto generato automaticamente dall'intelligenza artificiale indotta dagli utenti. Tuttavia, a causa della sua formulazione professionale, della sua struttura completa e del suo tono serio, alcuni media l'hanno erroneamente diffusa come un annuncio autentico senza verifica, causando incomprensioni e diffusione diffuse.

Casi simili stanno diventando sempre più comuni. I contenuti generati dall'intelligenza artificiale hanno permeato Internet, in particolare nell'ambito multimodale. Inizialmente, c'era un enorme entusiasmo per la capacità dell'intelligenza artificiale di generare immagini realistiche, ma in seguito sono emersi sempre più casi in cui "si parte da una singola immagine e poi si inventa il resto", rendendo difficile distinguere l'autenticità dalla contraffazione.

Ad esempio, alcune persone utilizzano strumenti di intelligenza artificiale come ChatGPT per generare immagini o video falsi di beni intatti (frutta, vestiti, beni di prima necessità, ecc.) che sembrano danneggiati, ammuffiti o macchiati, e poi richiedono rimborsi fraudolenti fingendo che i beni siano problematici, causando la perdita sia dei beni che dei soldi a un gran numero di commercianti.

Anche nei resoconti sui disastri possiamo osservare che l'intelligenza artificiale sta iniziando a entrare sempre più spesso nell'occhio del pubblico.

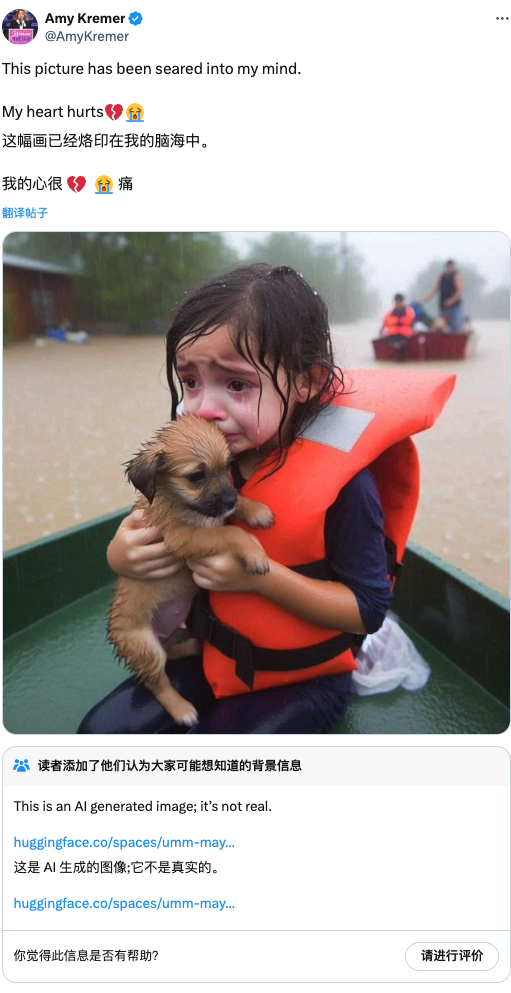

L'anno scorso, quando la Florida fu colpita da un uragano, la foto di una bambina in lacrime con un giubbotto di salvataggio e un cucciolo in braccio su una scialuppa di salvataggio divenne virale sui social media. Tuttavia, la piattaforma alla fine confermò che l'immagine era stata generata dall'intelligenza artificiale, privando inutilmente le persone di buon cuore.

Ad esempio, alla fine di ottobre dello scorso anno, la regione spagnola di Valencia è stata colpita da piogge torrenziali. Quando le acque si sono finalmente ritirate, è apparsa la scena qui sotto. Tuttavia, poiché sempre più contenuti sono diventati difficili da verificare, il pubblico ha iniziato a guardare tutto con sospetto. Quando è stata presentata questa foto, la prima reazione di molte persone è stata: "Questa deve essere stata creata dall'intelligenza artificiale. È una fake news".

Mentre il gioco del "gridare al lupo!" continua a espandersi, le notizie che riflettono e segnalano realmente situazioni pericolose vengono attribuite a "un'intelligenza artificiale", perdendo così il momento migliore per il salvataggio, il che è un'altra brutta conseguenza.

Allo stesso tempo, anche la difficoltà di governance dei contenuti della piattaforma sta aumentando rapidamente.

In un rapporto sulla governance pubblicato a febbraio, Toutiao ha affermato che solo nell'ultimo anno ha intercettato oltre 5 milioni di informazioni false, elaborato 930.000 contenuti di bassa qualità tramite intelligenza artificiale e penalizzato 7,81 milioni di post omogenei.

In alcuni resoconti dei media, abbiamo anche assistito all'emergere di una filiera completa di produzione di contenuti basati sull'intelligenza artificiale: fabbriche di contenuti che producono in serie articoli basati sull'intelligenza artificiale, aziende di marketing che utilizzano strumenti di intelligenza artificiale per confezionarli e promuoverli e team SEO che studiano come far sì che i contenuti basati sull'intelligenza artificiale ottengano un posizionamento più elevato nei motori di ricerca.

Stanno tutti studiando lo stesso argomento: come creare contenuti a cui l'intelligenza artificiale sia più propensa a credere e come rendere più facile per gli esseri umani credere ai contenuti creati dall'intelligenza artificiale.

Lo scorso giugno, è emersa online una notizia che denunciava una massiccia esplosione a Xi'an, specificando l'ora e il luogo. Tuttavia, la polizia di Xi'an ha verificato le informazioni e non ha riscontrato alcun evento del genere. La notizia è stata pubblicata da un account di proprietà di un'agenzia MCN.

Dopo essere stato arrestato dalla polizia, il principale colpevole ha confessato di aver utilizzato uno strumento di intelligenza artificiale. Dato un suggerimento, lo strumento avrebbe automaticamente scansionato gli articoli pertinenti su Internet e poi generato un testo di centinaia o migliaia di parole.

Al suo apice, è possibile generare dalle 4.000 alle 7.000 informazioni in un solo giorno, con un coinvolgimento umano pressoché nullo durante l'intero processo. Seleziona specificamente argomenti ed eventi legati al sostentamento delle persone e che sono molto popolari. Studi hanno dimostrato che le informazioni negative, deprimenti ed emotivamente stimolanti hanno maggiori probabilità di catturare l'attenzione delle persone, il che è determinato dalla struttura delle nostre aree parietali e frontali.

Quando queste "informazioni false" altamente interattive e facilmente divulgabili vengono citate, inoltrate e indicizzate frequentemente, i modelli di intelligenza artificiale ignari le tratteranno come corpus di dati per l'apprendimento e le incorporeranno nei loro meccanismi di generazione. Questo crea un circuito chiuso tra intelligenza artificiale e umani:

Gli esseri umani usano l'intelligenza artificiale per creare false informazioni → L'intelligenza artificiale apprende false informazioni → L'intelligenza artificiale diffonde false informazioni → Sempre più esseri umani credono alle false informazioni → Le false informazioni diventano "fatti accertati" → Una nuova intelligenza artificiale continua ad apprendere questi "fatti"…

Questo ciclo si ripete, formando una spirale di voci. A ogni svolta, la verità si diluisce, mentre le bugie diventano più sofisticate e difficili da individuare. Non ci si può fidare degli esseri umani, e le affermazioni dell'intelligenza artificiale sono altrettanto inaffidabili. Il nostro giudizio rimanente diventa la nostra ultima linea di difesa.

Tuttavia, in un'epoca di sovraccarico di informazioni, il nostro giudizio viene eroso da vari fattori: i pregiudizi ci fanno credere solo alle informazioni che sono conformi alle nostre conoscenze esistenti; i bozzoli informativi ci fanno perdere una prospettiva più completa; e la comunicazione emotiva rende anche il pensiero razionale scarso.

Forse la più grande verità di questa cosiddetta era post-verità è che la maggior parte delle "verità" sono discutibili. Il prossimo sketch "Trump si innamora del bidello", in particolare, potrebbe già essere in arrivo, e si preannuncia ancora più scandaloso e difficile da smentire di questo.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFaner: iFaner (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.