Burger King sta dotando i suoi dipendenti di visori dotati di intelligenza artificiale: ogni “grazie” pronunciato verrà valutato dall’intelligenza artificiale.

Arriva l'hardware AI di livello aziendale, da Burger King: questa catena di fast food sta iniziando a sperimentare l'installazione dell'intelligenza artificiale nelle cuffie dei suoi dipendenti.

Si chiama Patty, è basato su OpenAI ed è l'assistente vocale per la piattaforma BK Assistant di Burger King. I dipendenti possono chiedergli in qualsiasi momento: "Quante fette di bacon devo mettere nel mio Maple Bourbon Grilled Whopper?" o "Come si pulisce la macchina del milkshake?". Può rispondere a tutte queste domande. In caso di malfunzionamenti delle apparecchiature o di esaurimento degli ingredienti, il sistema sincronizza automaticamente tutti i canali (macchine per le ordinazioni self-service, drive-thru e tabelloni elettronici dei menu) entro 15 minuti, aggiornando tutto senza alcun intervento umano.

Questo sistema integra molteplici fonti di dati, tra cui il dialogo drive-thru, le attrezzature da cucina e l'inventario, formando una piattaforma completa per la gestione del punto vendita. In un'intervista con The Verge, Thibault Rooks, Chief Digital Officer di Burger King, ha definito Patty uno strumento di "supporto alla gestione".

Finora, si è rivelato un valido strumento per l'efficienza in cucina. Infatti, dati i problemi di lunga data del settore del fast food, ovvero l'elevato turnover e i cicli di formazione brevi, consentire ai nuovi dipendenti di accedere facilmente agli standard operativi e far sì che il sistema gestisca automaticamente le informazioni sulle scorte esaurite risolve davvero questi problemi.

Ma Patty ha un'altra caratteristica: ascolta le conversazioni tra dipendenti e clienti.

Nello specifico, Burger King ha raccolto informazioni da affiliati e clienti su "come misurare la cordialità del servizio", utilizzando questi dati per addestrare l'intelligenza artificiale a riconoscere determinate parole e frasi: "Benvenuti da Burger King", "Prego", "Grazie". Il sistema assegna quindi un punteggio alla "cordialità del servizio" di ogni punto vendita in base a queste informazioni. I manager possono verificare in qualsiasi momento le prestazioni di cortesia del proprio punto vendita tramite l'intelligenza artificiale. Rooks ha aggiunto che stanno migliorando il sistema per catturare meglio "il tono della conversazione".

In altre parole, ora un algoritmo determina se sorridere ai clienti e se il tono della voce è sufficientemente entusiasta.

Patty è già in fase di sperimentazione in 500 ristoranti e prevede di estenderla a tutti i ristoranti degli Stati Uniti entro la fine del 2026. Nel frattempo, McDonald's ha recentemente annullato il suo progetto di ordinazione tramite intelligenza artificiale con IBM, e l'intelligenza artificiale vocale di Taco Bell ha ripetutamente funzionato male agli sportelli del drive-thru, diventando oggetto di battute sui social media da parte dei clienti. Burger King ha scelto una strada diversa: invece di usare l'intelligenza artificiale per interagire con i clienti, la usa per interagire con i dipendenti.

Questa è una scelta intelligente. Se l'IA fallisce nel rapporto con i clienti, diventa un disastro per le pubbliche relazioni; ma quali gravi conseguenze potrebbero esserci se l'IA fallisce nel rapporto con i dipendenti?

Quando la gestione diventa monitoraggio

Burger King non è la prima azienda a intraprendere questa strada, né è la più radicale.

L'esempio più famoso è Amazon. Il suo sistema di magazzino, ADAPT (Associate Development and Performance Tracker), monitora la velocità di scansione di ogni addetto al prelievo con una precisione al secondo. Gli intervalli tra un prelievo e l'altro dello scanner per la scansione dei pacchi vengono registrati: se lo scanner rimane inattivo per più di un certo periodo, il sistema lo registra automaticamente come "tempo improduttivo".

I dipendenti che non rispettano le tariffe richieste riceveranno avvisi generati automaticamente dal sistema. Dopo aver accumulato sei avvisi, il sistema licenzierà automaticamente il dipendente, senza alcun coinvolgimento umano da parte del responsabile . Amazon afferma che i supervisori umani possono ignorare queste decisioni, ma si tratta di un design "correttivo", non di un design "pre-giudiziale".

All'inizio del 2024, l'autorità francese per la protezione dei dati CNIL ha multato Amazon France per 32 milioni di euro per "eccessiva intrusione" nel suo sistema di monitoraggio. La CNIL ha specificamente sottolineato che la pratica di misurare con precisione i tempi di inattività degli scanner di codici a barre dei dipendenti comportava che i dipendenti dovessero giustificare ogni pausa, anche solo di pochi minuti – andare in bagno, bere acqua o fare stretching – diventando tutte "anomalie" che dovevano essere registrate e analizzate dal sistema .

"Ti senti come in prigione", ha dichiarato un'iscritta al sindacato di un punto di consegna di Amazon durante un'udienza del Dipartimento del Lavoro degli Stati Uniti. Ha affermato che Amazon applica regolarmente misure disciplinari basate sui dati raccolti dai suoi strumenti di tracciamento elettronico e che questa sorveglianza crea "paura e ansia, che a loro volta creano un ambiente di lavoro pericoloso".

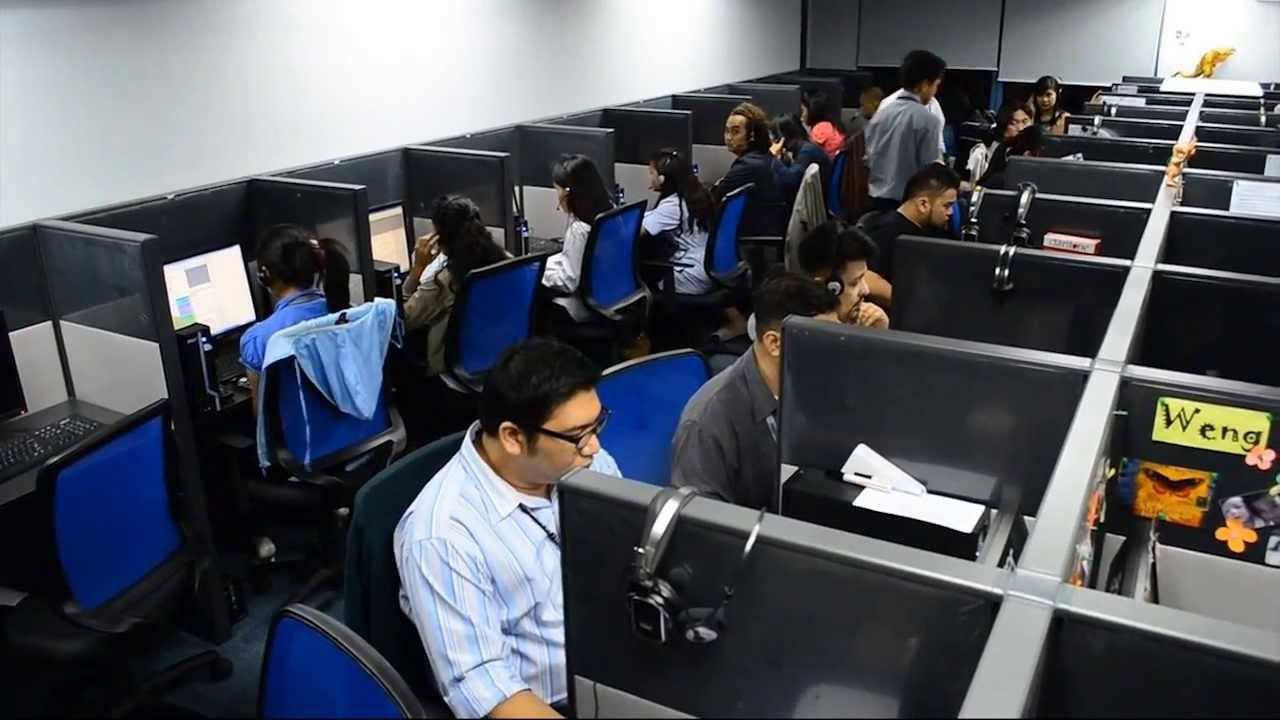

Il settore del servizio clienti adotta un approccio tecnologico diverso, ma la logica è la stessa. Sempre più call center stanno implementando sistemi di rilevamento delle emozioni basati sull'intelligenza artificiale che analizzano il tono di voce, la velocità di eloquio e le pause in tempo reale per determinare lo stato emotivo e l'"empatia" del personale del servizio clienti. I fornitori di tecnologie affermano che questi sistemi possono rilevare la frustrazione 30-60 secondi prima che un cliente riattacchi, con un tasso di accuratezza superiore all'85%.

Ma quello che è successo in realtà durante l'implementazione è che gli agenti hanno imparato rapidamente a "alimentare" l'algoritmo con modelli di script e toni fissi: quando fare una pausa, quali parole chiave usare per esprimere empatia e con quale ritmo dire "Capisco come ti senti". Un dipendente di un call center ha dichiarato in un'indagine del GAO: "La pressione delle vendite e i vari metodi di monitoraggio hanno creato un enorme stress".

I dipendenti non stanno fornendo un servizio migliore; stanno elaborando dati migliori. Secondo Gartner, la percentuale di grandi aziende che monitorano i propri dipendenti è raddoppiata dall'inizio della pandemia. Alcuni software registrano le battute sulla tastiera, acquisiscono regolarmente screenshot, registrano chiamate e riunioni e possono persino accedere alle webcam dei dipendenti. Uno studio di Harvard Business Review che confronta i professionisti americani monitorati e non monitorati ha rilevato che i dipendenti monitorati erano più propensi a fare pause non autorizzate, a trascurare deliberatamente il lavoro, a danneggiare le proprietà aziendali o persino a commettere furti: il monitoraggio non ha ridotto i comportamenti problematici, ma li ha aumentati.

Ogni caso parte dallo stesso punto: il management scopre un problema reale – servizio insufficiente, scarsa efficienza e dipendenti da remoto potenzialmente pigri – e poi sceglie di utilizzare la tecnologia per "risolverlo". Ma la tecnologia può misurare solo parametri proxy: intervalli di scansione, frequenza delle parole chiave, schemi di movimento del mouse e fluttuazioni di tono. C'è un enorme divario tra questi parametri e la qualità effettiva del lavoro.

Trappole di misurazione

Tornando al caso di Burger King, un buon responsabile di punto vendita dovrebbe essere consapevole delle prestazioni di servizio dei propri dipendenti. Questo obiettivo può essere raggiunto attraverso visite in negozio, tutoraggio e feedback quotidiani per apportare modifiche; osservando lo sguardo e il ritmo di un dipendente durante l'ora di punta della pausa pranzo; e chiacchierando con lui dopo il lavoro per capire chi è sotto pressione. Ma questo richiede esperienza, presenza e giudizio, proprio le qualità più rare nel settore delle catene di fast food.

Il settore del fast food soffre da tempo di una stretta sul middle management. L'elevato turnover del personale (oltre il 100% annuo nel settore del fast food statunitense), i cicli di formazione compressi e le limitate opportunità di retribuzione e sviluppo di carriera per i direttori di negozio rendono difficile trattenere personale esperto. Il risultato è una mancanza sistemica di competenze gestionali. Non è che un direttore di negozio in particolare sia incompetente, ma piuttosto che la struttura del settore rende difficile mantenere costantemente un team di middle management di qualità sufficientemente elevata.

Quindi, quando è emersa l'intelligenza artificiale, è stata vista come una scorciatoia per aggirare le competenze gestionali: dato che non ho manager abbastanza bravi, lascio che sia l'algoritmo a tenere d'occhio la situazione. Dato che non posso far sì che ogni direttore di negozio abbia capacità di osservazione ed empatia, lascio che sia il sistema a contare quante volte sono stati usati "per favore" e "grazie".

Il problema è che gli algoritmi prendono di mira le parole, non le persone. "Per favore" e "grazie" possono essere contati, ma la vera qualità del servizio – un membro dello staff che aiuta pazientemente un cliente a cambiare il suo pasto sotto pressione nelle ore di punta, o un nuovo dipendente che gestisce un reclamo in modo autonomo per la prima volta con un atteggiamento sincero nonostante il nervosismo – non può essere catturata dal riconoscimento delle parole chiave.

Inoltre, ciò che è più probabile che accada è che, una volta che i dipendenti sanno che ogni loro parola viene valutata, il loro comportamento venga distorto. La "gentilezza" si trasforma da un atteggiamento spontaneo in una prestazione monitorata. Aggiungerai "per favore" prima di ogni frase non perché vuoi essere sinceramente educato, ma perché sai che il sistema ti sta ascoltando. Dirai "grazie per essere venuto" quando porgi un hamburger non per gratitudine, ma perché non dirlo abbasserà il tuo punteggio.

Esiste un concetto nelle scienze sociali chiamato Legge di Goodhart: quando un indicatore diventa un obiettivo, cessa di essere un buon indicatore. La frequenza di "per favore" e "grazie" avrebbe potuto essere un indicatore approssimativo della cordialità del servizio, ma una volta che diventa un KPI per la valutazione delle prestazioni dei dipendenti, questi ultimi si concentreranno sull'ottimizzazione dell'indicatore stesso, piuttosto che sul miglioramento di ciò che lo sostiene.

La catena logica di questo approccio è chiara: incapacità di gestire le persone → sostituzione del management con la tecnologia → la tecnologia può quantificare solo indicatori superficiali → gli indicatori superficiali diventano KPI → metriche di performance dei dipendenti → la qualità effettiva del servizio diminuisce. Il management, vedendo il "punteggio di cordialità" aumentare sul cruscotto, dà per scontato che il problema sia risolto.

" Si tratta di facilitare la gestione", ha affermato Rooks.

Esistono due modi per integrare l'intelligenza artificiale nella gestione: assistenza e sostituzione. "Assistenza" significa che l'intelligenza artificiale fornisce informazioni e gli esseri umani formulano giudizi. Un manager potrebbe notare un calo nei dati relativi alla cordialità e poi osservarne e comprenderne le ragioni: forse si tratta di una programmazione irragionevole, di un'emergenza familiare per un dipendente o di un reale aumento dei reclami dei clienti in un determinato periodo. I dati sono il punto di partenza, non il punto di arrivo.

"Sostituzione" significa che l'output dell'IA è la conclusione. Se il punteggio di cordialità è basso, il sistema lo segnala automaticamente e il manager utilizza direttamente il punteggio per avviare una conversazione o, più direttamente, lo integra nella valutazione delle prestazioni. Non è richiesta alcuna osservazione, comprensione o giudizio.

ADAPT di Amazon ha raggiunto la fase di "sostituzione": il sistema licenzia direttamente i dipendenti. Patty di Burger King è attualmente ancora in fase di "ausiliaria". Ma il problema è che, quando si fornisce uno strumento di punteggio automatico a un sistema che già non ha capacità di gestione, questo scivola quasi inevitabilmente nella fase di "sostituzione". Questo perché "ausiliaria" richiede che le persone siano in grado di utilizzare informazioni ausiliarie per formulare giudizi, e questa capacità è proprio ciò che mancava in primo luogo.

Non puoi aspettarti di colmare la lacuna nella tua capacità di usare gli strumenti con gli strumenti.

Ecco perché la "gestione assistita dall'intelligenza artificiale" ha ripetutamente fallito in settori come fast food, magazzinaggio e logistica e call center: la ragione stessa per cui questi settori hanno introdotto il monitoraggio tramite intelligenza artificiale è proprio perché non sono in grado di utilizzarlo in modo efficace. Capacità gestionali insufficienti li hanno spinti a introdurre la tecnologia; ma a causa di queste capacità gestionali inadeguate, la tecnologia è stata trattata grossolanamente come se fosse gestione stessa.

In definitiva, il punto di forza più grande dell'IA non è migliorare la gestione. Il suo punto di forza più grande è far sembrare che chi non è disposto ad affrontare le cause profonde stia risolvendo i problemi.

Il cruscotto si illumina, i numeri cambiano e la presentazione PowerPoint recita "Miglioramento della qualità del servizio basato sull'intelligenza artificiale". Nel frattempo, l'impiegato dall'altro capo del visore si esercita freneticamente a dire le parole giuste al momento giusto, nella speranza di convincere un algoritmo di essere abbastanza amichevole.

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.