Test pratico di Seedance 2.0: gli stranieri sono ansiosi di registrarsi: questo è il momento del “mito nero” del video sull’intelligenza artificiale cinese.

"Seedance 2.0 dalla Cina diventerà la tecnologia più avanzata."

"Questa è intelligenza artificiale, siamo spacciati."

▲Su X, diversi creatori di video basati sull'intelligenza artificiale hanno affermato che Seedance 2.0 ha ottenuto risultati eccezionali.

Negli ultimi giorni, i video AI generati da Seedance 2.0 si sono diffusi a macchia d'olio su piattaforme come Douyin, WeChat Video Channels e piattaforme di social media estere come X.

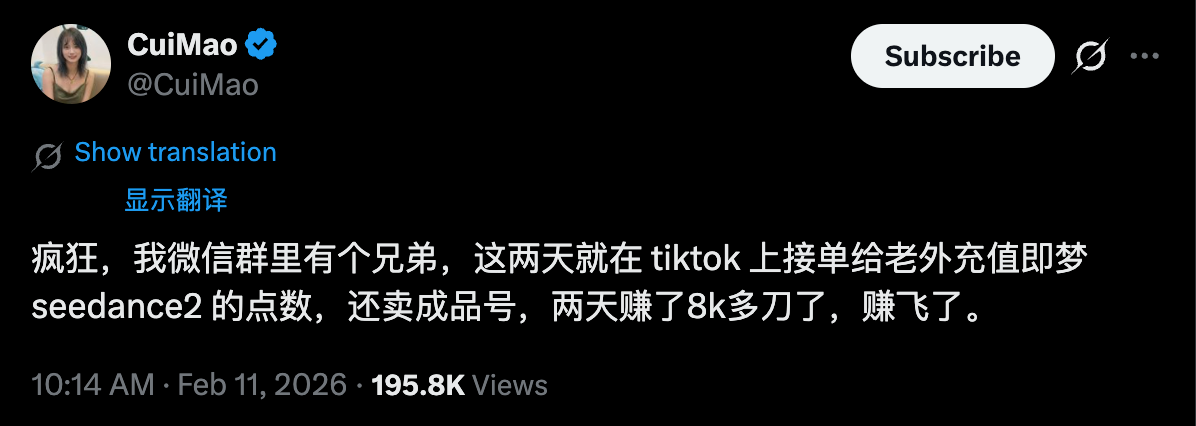

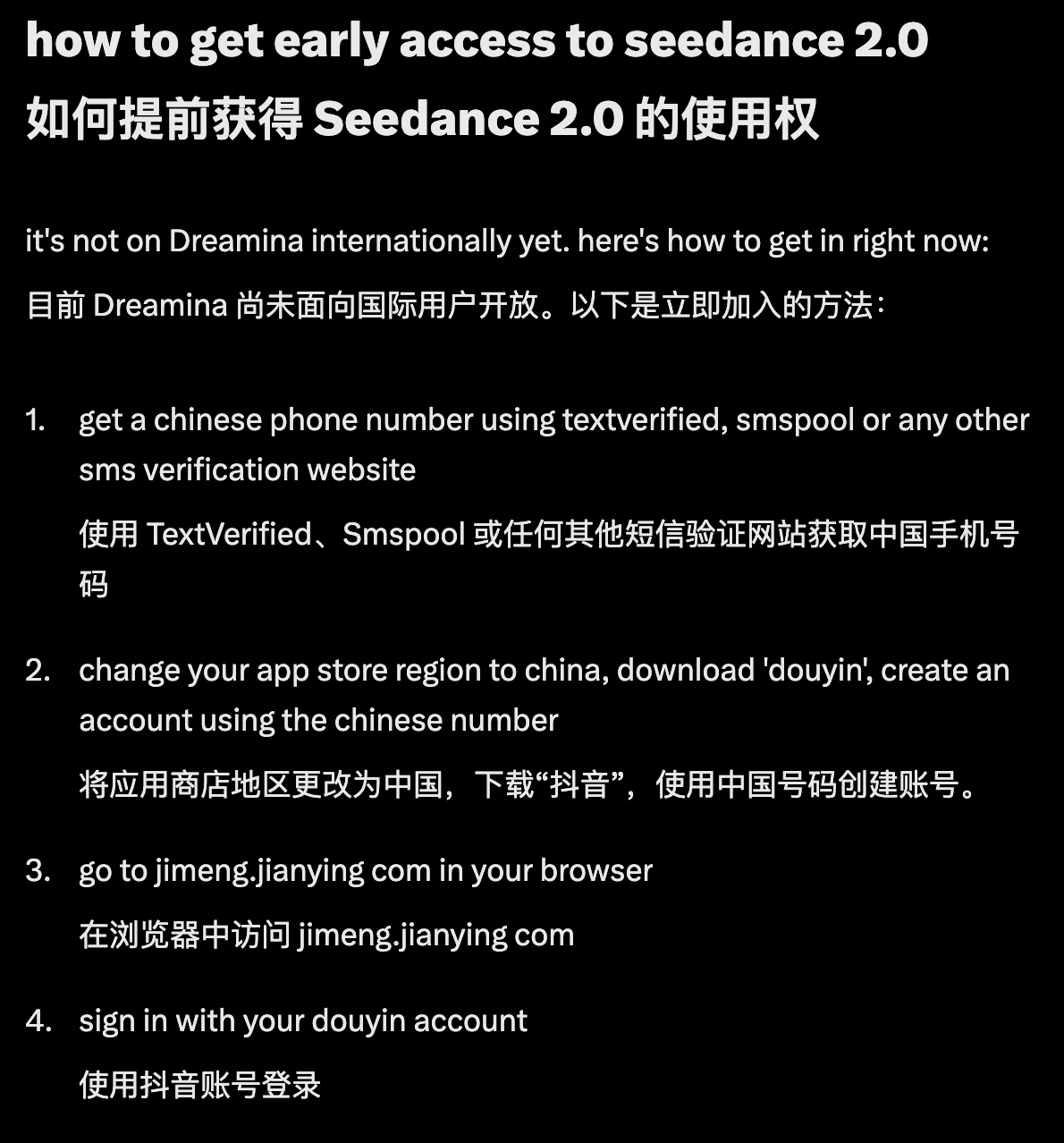

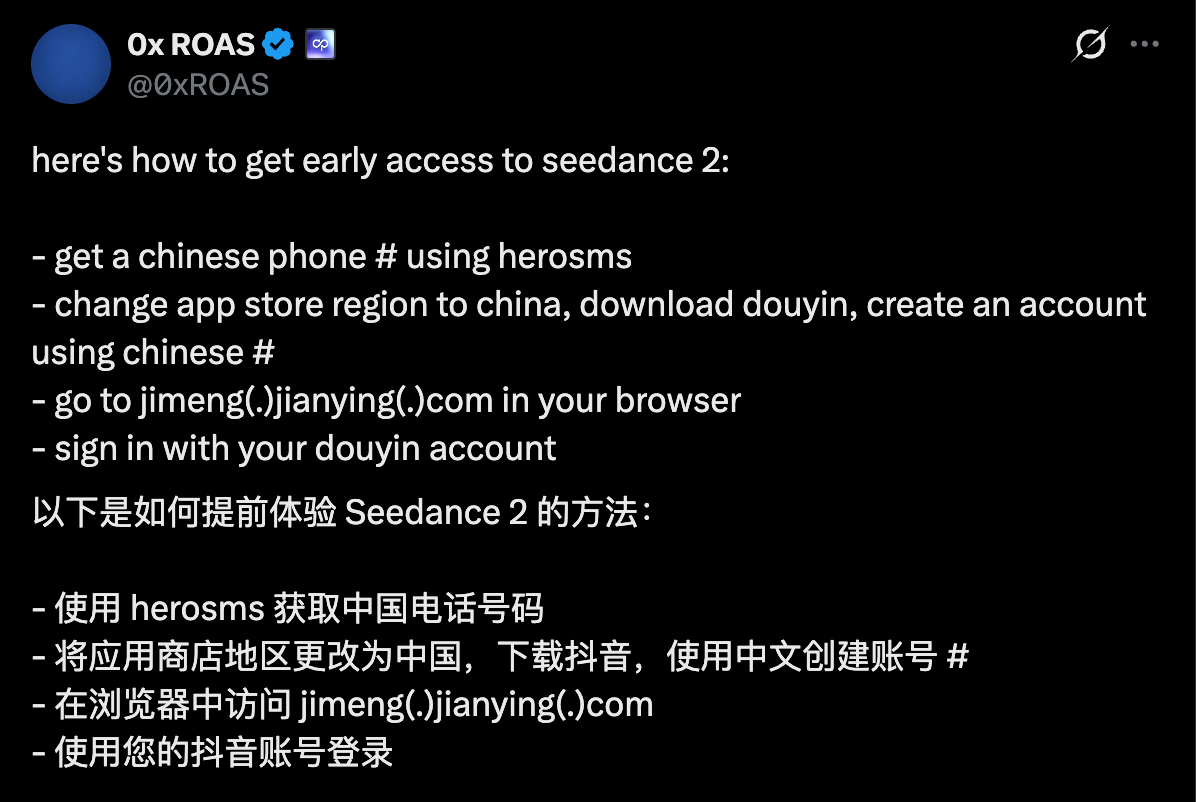

Oltre all'insolito fenomeno degli internauti stranieri che cercano numeri +86 per registrarsi a JiMeng, un gran numero di utenti sta anche pubblicando discussioni in cerca di guide, e nelle sezioni commenti di quei video di intelligenza artificiale, tutti chiedono tutorial. Ancora più estremo, alcuni affermano di aver guadagnato oltre 8.000 dollari in soli due giorni rivendendo punti JiMeng.

▲Molti internauti stranieri stanno pubblicando richieste per un codice di prova, provando tutti i modi possibili per accedere al gioco.

Che tipo di video AI può effettivamente produrre Seedance 2.0?

Il primo episodio di "Effortlessly Replicating Life's Segmentation Techniques" presenta complessi movimenti di telecamera dall'uscita dall'ascensore al corridoio; include anche un blockbuster autoprodotto con azioni viscerali di arti marziali; vari spot televisivi e video promozionali mostrano effetti di vetro liquido; può anche eseguire stand-up comedy e sketch e, questa volta, il regista del Gala del Festival di Primavera è al comando…

▲Generato dal modello di generazione video sviluppato autonomamente da ByteDance, Seedance 2.0. Fonte: X@qhgy / Douyin@虚妄

Dalla semplice coerenza video ai movimenti della telecamera complessi e impegnativi, passando per potenti funzioni di modelli creativi, suoni più accurati e realistici e musica adatta al contenuto video, Seedance 2.0 ha risolto quasi tutti i problemi che i video AI potrebbero incontrare.

APPSO ha anche testato l'ultimo modello di Seedance 2.0 in un sogno, e si può solo dire che le reazioni degli utenti sono state autentiche. C'erano effettivamente richieste di suggerimenti e di pesca di carte validi, ma ogni video generato dall'IA era troppo realistico.

▲ Sito web ufficiale di Jimeng AI: https://jimeng.jianying.com/ai-tool/generate

Attualmente, sul sito Web ufficiale di Jimeng, dopo aver effettuato l'accesso, è possibile selezionare la generazione video per utilizzare il modello di generazione video sviluppato autonomamente da ByteDance, Seedance 2.0.

Questa volta stiamo effettivamente dando istruzioni all'intelligenza artificiale per realizzare un film.

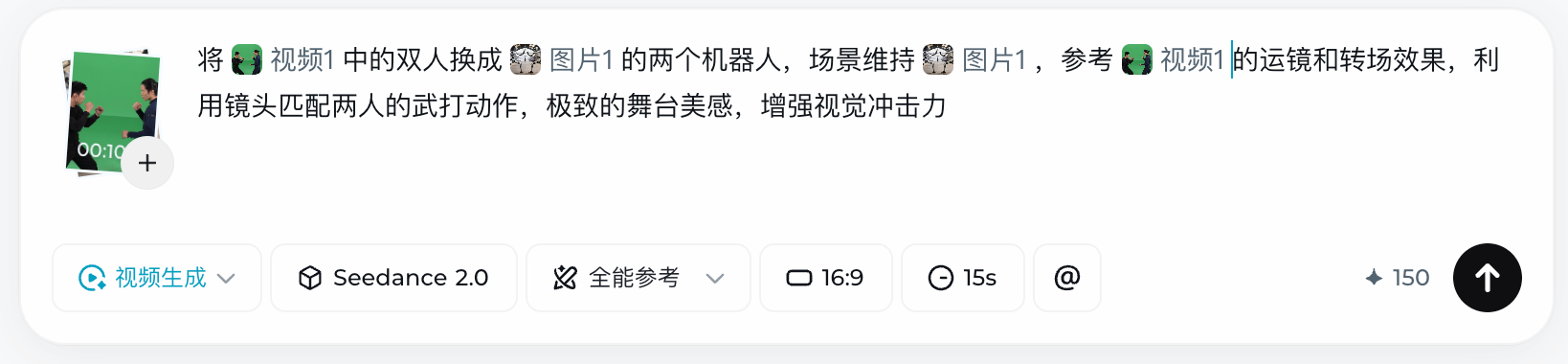

Dopo aver selezionato il modello Seedance 2.0 e utilizzato la modalità di riferimento all-in-one, basta guardare i file che possono essere importati per capire che questo aggiornamento non è semplice.

Il modello di generazione video di ByteDance, Seedance 2.0, supera completamente i limiti di input della maggior parte dei modelli. I precedenti metodi che utilizzavano il testo più il primo fotogramma, o il primo e l'ultimo fotogramma, sono ormai obsoleti. Seedance 2.0 ha ricostruito da zero la logica di creazione, supportando la libera combinazione di quattro modalità: immagine, video, audio e testo.

Una singola immagine può definire lo stile artistico di una scena o fungere da fotogramma chiave per un video; un breve video può riprodurre direttamente i movimenti di un personaggio e varie angolazioni di ripresa complesse; pochi secondi di audio possono impostare direttamente il ritmo e l'atmosfera; e infine, una parola chiave può collegare tutte le nostre immaginazioni.

▲Il modello di generazione video sviluppato autonomamente da ByteDance, Seedance 2.0, supporta fino a 12 file, fino a 9 immagini e fino a 3 file video e audio, con una lunghezza totale video/audio non superiore a 15 secondi; la durata della generazione può essere selezionata da 4 a 15 secondi, con durate diverse che occupano punti diversi.

Anche l'utilizzo è molto semplice. Seedance 2.0 supporta attualmente le opzioni "First and Last Frames" e "All-in-One Reference", ma le modalità di riferimento multi-frame e soggetto intelligenti non sono ancora supportate. In genere, è sufficiente selezionare "All-in-One Reference" e il modello "Seedance 2.0", quindi caricare tutti i materiali. Il sito web ufficiale suggerisce di posizionare all'inizio i materiali che hanno il maggiore impatto sul video finale.

▲ È anche possibile fare clic sul pulsante @ sotto la casella di input per selezionare diversi file sorgente.

Successivamente, nella casella di input del prompt, usa il simbolo @ per richiamare direttamente il materiale corrispondente, unendolo in un prompt ragionevole e poi attendi che "crei il sogno". Non dobbiamo più scervellarci per pensare a "come descrivere questa azione/atmosfera/movimento della telecamera/colonna sonora/…", dobbiamo solo contrassegnarlo con @ e indicarlo al modello.

Se l'input multimodale risolve il problema del "come dire", le capacità di riferimento interno del modello risolvono il problema del "cosa dire". Grazie alle potenti capacità di riferimento video approfondito, abbiamo anche generato video di intelligenza artificiale che altri modelli non sono in grado di realizzare.

Uno contro dieci, tutte le diciotto abilità delle arti marziali copiate direttamente

In precedenza, se volevamo che l'IA imitasse una scena famosa di un film, dovevamo scrivere termini professionali come "ripresa surround" e "cambio rapido" nei prompt. Quando si trattava di mosse specifiche di arti marziali, dovevamo diventare istruttori di arti marziali, descrivendo chiaramente come eseguire ogni mossa nei prompt, e anche in quel caso, il risultato non era sempre corretto.

Ora puoi caricare direttamente contenuti di riferimento e l'intelligenza artificiale non solo può comprendere lo stile generale della scena e catturare i dettagli dei personaggi, ma anche riconoscere il linguaggio della telecamera, il ritmo dei movimenti e persino gli effetti speciali creativi, per poi replicarli accuratamente.

▲Sostituisci le due persone in @Video 1 con i due robot in @Image 1, mantenendo la scena uguale a quella in @Image 1. Facendo riferimento al movimento della telecamera e alle transizioni in @Video 1, usa le angolazioni della telecamera per abbinare i movimenti di arti marziali delle due persone, per un'estetica scenica ottimale e un impatto visivo migliorato.

Qui abbiamo utilizzato una scena di combattimento di 10 secondi dal manuale utente di Seedance 2.0 e poi abbiamo detto al modello di copiare i movimenti dei due personaggi nel video sui due robot che abbiamo caricato.

Il risultato finale ha replicato perfettamente i movimenti del video, consentendo a Unisoc e Boston Dynamics di darsi battaglia in uno scontro emozionante. Non meno impressionante della performance del robot all'evento Weibo Night di qualche tempo fa.

▲Video e immagini caricati e prompt utilizzati

I movimenti dell'IA finale hanno risolto completamente i problemi del modello precedente, in cui camminare sembrava fluttuare e combattere sembrava un gioco di spaghetti molli. L'attuale Seedance 2.0 è un modello che comprende la fisica, la gravità e l'inerzia, con transizioni di movimento più fluide e naturali, e non ha più quella strana "sensazione di IA".

Ora è possibile catturare facilmente le riprese più difficili sul set caricando un riferimento.

Oltre a riprodurre fedelmente i dettagli e i movimenti dei personaggi, Seedance 2.0 è anche in grado di replicare fedelmente i movimenti della telecamera. Un lavoro di ripresa cinematografico e effetti speciali creativi, un tempo complessi, ora possono essere replicati con precisione semplicemente caricando un video di riferimento.

▲Fare riferimento al movimento della telecamera in @Video 1; questo video è stato replicato utilizzando @Image 1.

Abbiamo caricato una clip di un'auto da corsa Apple F1 e una foto di una Xiaomi SU7 Ultra. Seedance 2.0 ha capito perfettamente le mie intenzioni, trasformando l'immagine in una ripresa aerea come l'apertura di una gara di F1, per poi concentrarsi sulla SU7 Ultra in una ripresa successiva, il tutto in un'unica ripresa continua. Definirlo un blockbuster non sarebbe un'esagerazione.

Questa capacità di creare riprese fluide e continue è particolarmente adatta alla produzione di video di danza di alta qualità . Abbiamo trovato un video di danza di 15 secondi nel manuale utente e ne abbiamo caricato uno splendido selfie. Con una sola generazione, senza funzionalità speciali, abbiamo ottenuto un video di danza solista con musica a tempo perfetto e movimenti di telecamera naturali.

▲ Sostituisci la ragazza in @Video 1 con la ragazza in @Immagine 1 vestita con un costume mongolo. La scena si svolge su un bellissimo palcoscenico. Facendo riferimento al movimento della telecamera e agli effetti di transizione di @Video 1, usa la telecamera per adattarla ai movimenti del personaggio per ottenere la migliore estetica scenica e migliorare l'impatto visivo.

Quando il modello video Veo 3 di Google è diventato popolare l'anno scorso, la narrazione in prima persona era un trend molto in voga. Ora, con Seedance 2.0, le funzionalità più apprezzate sono innumerevoli. Questo tipo di video, che combina prospettiva di gioco, elementi visivi e coerenza dei personaggi, è come dare vita a Sun Wukong di Black Myth.

▲La vista posteriore del personaggio è mostrata in @Immagine 1, quella frontale in @Immagine 2 e i dettagli del viso in @Immagine 3. Il personaggio entra nel gioco "Black Myth: Wukong" e combatte contro Erlang Shen Yang Jian. La scena, le azioni, gli effetti speciali, la musica e gli effetti sonori sono mostrati in @Video 1.

La cosa ancora più interessante è che abbiamo utilizzato anche riferimenti audio . Possiamo caricare un video e Seedance 2.0 controllerà la generazione delle immagini in base al ritmo e all'atmosfera della musica del video. Gli accenti dei colpi corrispondono ai tagli di ripresa, e il crescendo degli archi corrisponde all'accelerazione dell'azione.

È anche la prima volta che il suono viene incorporato in un modello di generazione video, trasformandosi da una musica di sottofondo di post-produzione separata in una parte importante della narrazione video dell'IA.

È qualcosa che non vedi l'ora di vedere: in un istante può verificarsi una scena drammatica del ritorno a casa per il Capodanno cinese.

Il valore più grande della capacità di riferimento risiede nella risoluzione di problemi creativi pratici, e il significativo miglioramento della capacità di riferimento è attribuito al miglioramento della capacità di modellazione di base .

Abbiamo provato a fornire a Seedance 2.0 un'immagine del primo fotogramma e alcuni prompt comunemente utilizzati in altri modelli di generazione video e il risultato è stato quello previsto.

▲La telecamera segue la schiena del giovane nell'immagine 1. L'ambientazione è una strada di paese a tarda notte, alla vigilia di Capodanno, con lampioni fiochi e solo il rumore del vento e il "rombo" delle ruote della valigia che faticano a trascinarsi nella neve. Era molto stanco per aver camminato, così si fermò a strofinarsi le mani congelate ed emise un soffio di respiro bianco (primo piano). I suoi occhi rivelavano la stanchezza del "finalmente arrivato" e un pizzico di trepidazione per il ritorno a casa.

Svoltò un angolo e la telecamera lo seguì. In lontananza, apparve un grande cancello di ferro decorato con distici rossi, con una luce dorata che filtrava attraverso le fessure. In quel momento, sporadici petardi iniziarono a risuonare in lontananza. Affrettò il passo e aprì il pesante cancello di ferro.

Nel momento in cui spinse la porta, la telecamera inquadrò il cortile alle sue spalle. Il cortile era pieno di lanterne rosse. Un cane randagio si precipitò avanti eccitato, poi la tenda della cucina si sollevò, rivelando sua madre che portava fuori una vaporiera di bambù fumante; il vapore offuscò all'istante i bordi dell'obiettivo. Suo padre, che appendeva le lanterne, si voltò e lo vide, fermandosi per un attimo; in piedi sulla scala, finse compostezza: "Ehi? Perché arrivi solo ora? Non avevamo detto alle cinque?" Sua madre posò la vaporiera e corse da lui, spolverandolo per la neve: "Vecchio, parli troppo! Non hai freddo? Entra, c'è dello stinco di maiale appena cotto!"

La telecamera non lo seguiva più da dietro, ma gli girava intorno, catturando la sua espressione. Il suo viso, che fino a quel momento era rimasto irrigidito, era illuminato dal calore e dalla luce del cortile, e le lacrime gli riempivano gli occhi, ma sorrideva.

A parte la scena iniziale in cui la valigia e la borsa vengono appoggiate, completamente ignorata, l'intero processo è stato filmato in un'unica ripresa continua, e anche le espressioni facciali e i movimenti dei personaggi erano ben controllati. Abbiamo semplicemente caricato uno screenshot da un video in modalità ritratto e abbiamo detto a Seedance 2.0 di usare la sua visuale posteriore, ed è stato in grado di generare direttamente un cortometraggio dall'aspetto gradevole sul ritorno a casa per il Capodanno cinese.

Anche senza grandi blocchi di prompt, la creatività e le capacità di completamento della storia di Seedance 2.0 sono state ulteriormente migliorate . Abbiamo semplicemente caricato un'immagine stilizzata di La La Land e inserito il prompt: "Crea un allegro video musicale basato sull'immagine 1".

Seedance 2.0 sembra aumentare attivamente l'intensità. La complessità di questo video di danza è simile a quella che ho visto nella gara di pattinaggio artistico a coppie alle Olimpiadi invernali. I miei suggerimenti non includevano video di riferimento o istruzioni di movimento specifiche; si basavano semplicemente sulle capacità di generazione creativa della modella per produrre uno splendido video di canto e danza.

Alcuni internauti hanno anche sfruttato la loro creatività per realizzare un breve video di 38 secondi utilizzando i personaggi della seconda stagione di League of Legends: Battle of the Twin Cities.

▲Generato dal modello di generazione video sviluppato autonomamente da ByteDance, Seedance 2.0, fonte: X@NACHOS2D_

Il momento del mito nero nel video dell'intelligenza artificiale

Il fenomenale successo del modello di generazione video Seedance 2.0 di ByteDance mi ha fatto tornare alla Festa di Primavera, quando fu lanciato Sora. Solo che questa volta, il modello video protagonista arriva dalla Cina.

Dopo averlo sperimentato, Feng Ji, il produttore di Black Myth, ha dichiarato direttamente nel cuore della notte: "L'infanzia della generazione video AIGC è ufficialmente finita". Dopo aver letto il test precedente, scoprirete che si tratta effettivamente di una valutazione piuttosto oggettiva.

In un certo senso, Seedance 2.0 può essere considerato il momento "Black Myth" per i video basati sull'intelligenza artificiale . Proprio come "Black Myth: Wukong" ha dimostrato che la Cina poteva produrre videogiochi AAA, Seedance 2.0 ha ora ottenuto un riconoscimento globale nel campo dei video basati sull'intelligenza artificiale.

Se Sora 2 dell'anno scorso ha rappresentato il momento dell'"allunaggio" nel campo dei video basati sull'intelligenza artificiale, Seedance 2.0 di oggi è come portare un'astronave a casa tua e consegnarti le chiavi, rendendo facile per te ottenere "il più potente sulla Terra" direttamente sul mercato.

Seedance 2.0 non ha creato un mito; ha semplicemente rappresentato una solida evoluzione. Ha abbassato la barriera d'ingresso per la creazione di video, alzando allo stesso tempo il limite del controllo. A questo punto, non dovremmo essere eccessivamente ottimisti riguardo al futuro lontano, ma piuttosto usare questo come punto di partenza per riflettere su come sfruttare questi strumenti sempre più sofisticati per raccontare storie migliori.

Le caratteristiche più preziose di Seedance 2.0 sono la sua versatilità e la sua bassa barriera all'ingresso.

Questa è forse la migliore interpretazione di "Kill the game": non ha posto fine al gioco, ma ne ha dato inizio a uno nuovo, molto più grande. Quando la tecnologia non sarà più il collo di bottiglia, la vera competizione tornerà alla sua essenza: chi saprà raccontare belle storie e avrà un'estetica unica otterrà un vantaggio senza precedenti.

▲Un rapporto di McKinsey che esplora l'impatto dell'intelligenza artificiale su cinema e televisione afferma che i contenuti basati sull'intelligenza artificiale potrebbero ridistribuire il mercato dell'ecosistema dei contenuti da 60 miliardi di dollari entro cinque anni | Link: https://www.mckinsey.com/industries/technology-media-and-telecommunications/our-insights/what-ai-could-mean-for-film-and-tv-production-and-the-industrys-future#/

I piccoli studi e i creatori indipendenti hanno sempre più opportunità di produrre contenuti di alta qualità, e il valore di 60 miliardi di dollari dell'industria dei contenuti basati sull'intelligenza artificiale verrà ridistribuito. I confini tra professionisti e dilettanti si stanno lentamente assottigliando e stiamo iniziando a chiederci "cosa dovremmo fare noi" invece di "cosa può fare l'intelligenza artificiale".

La grande performance di Seedance questa volta ci ha dimostrato che gli effetti audio e video sono più potenti di quelli di Sora 2. Che si tratti delle leggi fisiche del mondo reale o delle emozioni sottili e dei movimenti complessi dei personaggi, Seedance 2.0 può essere definito il miglior modello al momento.

Ma quando i video di IA diventano così realistici, Seedance sembra incapace di evitare gli stessi problemi che ha dovuto affrontare Sora. La realtà è che la fase di beta testing di Seedance 2.0 è incredibilmente popolare, con molti creatori stranieri che lamentano la scarsità di codici di accesso. Tuttavia, poiché gli effetti generati sono così realistici, hanno già scatenato un notevole dibattito etico sulla "falsificazione dei video di IA".

L'evoluzione dell'intelligenza artificiale quest'anno è stata sconcertante e la popolarità di Seedance 2.0 ha sicuramente superato di gran lunga le aspettative di Jimeng. Jimeng ha risposto rapidamente a queste controversie.

Il giorno in cui la notizia è diventata virale online, il 9, il team operativo di Jimeng ha pubblicato un avviso ufficiale nella community dei creator, annunciando una restrizione temporanea all'uso di dati facciali di persone reali e alla generazione di video . Attualmente, alcuni dei casi di persone reali che circolano online sono stati generati durante la fase iniziale di beta testing.

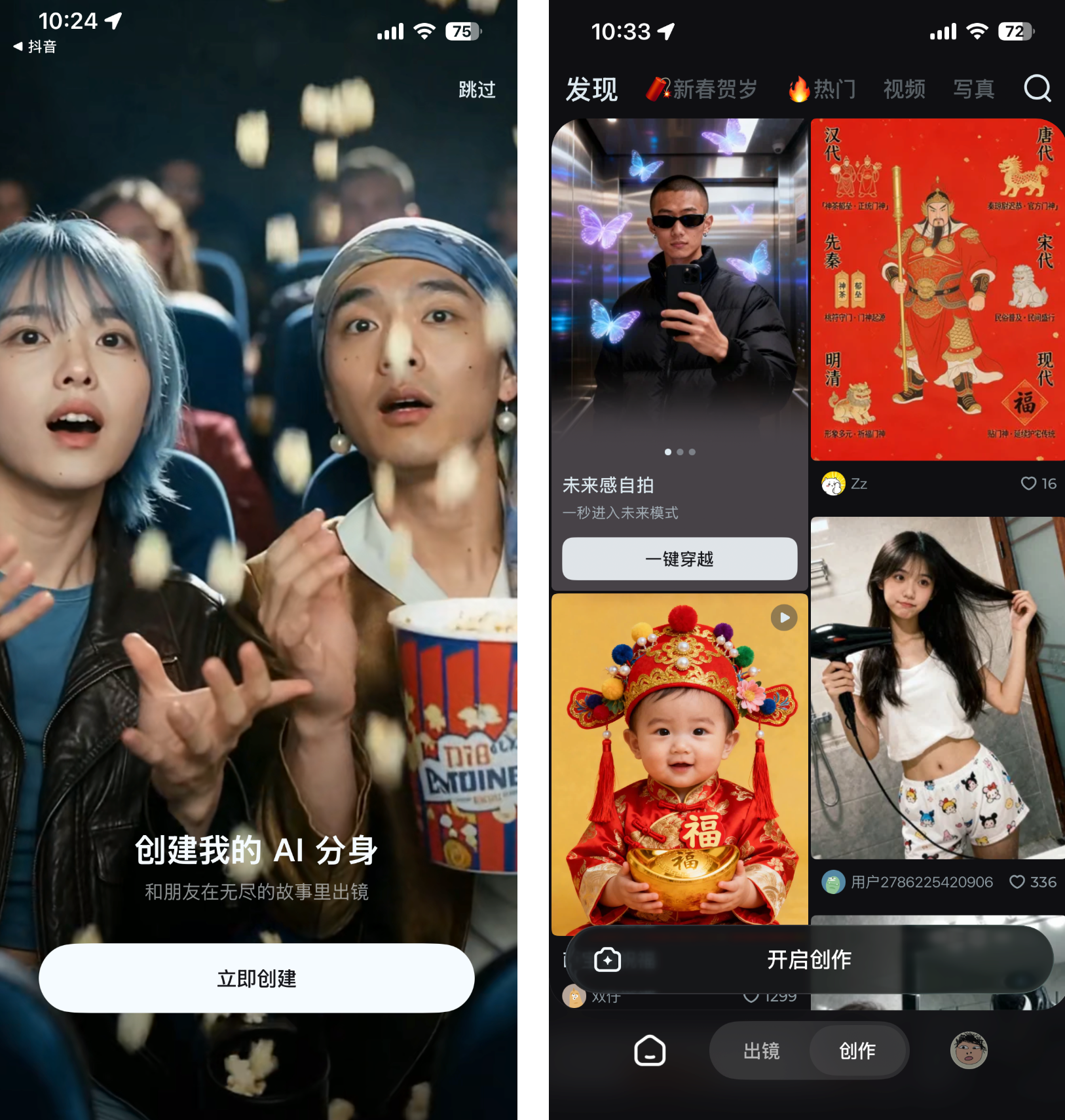

▲La funzione "Aspetto" all'interno dell'APP JiMeng AI consente agli utenti di creare video live-action dopo aver creato un avatar AI.

Tuttavia, se una persona reale desidera apparire inquadrata dalla telecamera, può utilizzare la funzione "apparire inquadrata" all'interno dell'app Jimeng AI per completare il processo di verifica della persona reale e quindi visualizzare il video della persona reale generato dall'IA.

Più uno strumento è potente, più chiari devono essere i suoi limiti di utilizzo. Ma ora, prima di trovare la risposta perfetta, quello che possiamo fare è capire cosa vogliamo fare con questo strumento: registrare la vita, esprimere la creatività o raccontare storie?

Se Edward Yang affermava in "Yi Yi" che "l'invenzione del cinema ha triplicato le nostre vite", allora l'invenzione dei film generati dall'intelligenza artificiale è più simile all'inizio di una ricostruzione della vita. Non ci accontentiamo più di una mera estensione; ognuno può diventare lo sceneggiatore della propria storia, esplorando un altro tipo di vita in infinite narrazioni.

Seedance 2.0 sta iniziando ad avvicinare tutto questo, e siamo solo all'inizio del 2026.

*La parte video di questo articolo può essere visualizzata in anteprima tramite il link dell'articolo su WeChat .

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.