Intervista di 10.000 parole a Fei-Fei Li: l’intelligenza spaziale è la prossima frontiera dell’intelligenza artificiale

Nel mondo dell'intelligenza artificiale, i grandi modelli linguistici hanno già stupito. Ma Fei-Fei Li ha affermato che la vera svolta deve ancora arrivare. Crede che se l'intelligenza artificiale non riesce a comprendere il mondo tridimensionale, non sia completa. Questo è il suo prossimo folle obiettivo.

Due giorni fa, Y Combinator ha aggiornato il suo canale YouTube con un'intervista video a Fei-Fei Li presso l'AI Startup School di San Francisco. In questa conversazione, Fei-Fei Li ha ripercorso la creazione del progetto ImageNet, il rapido sviluppo del deep learning dal riconoscimento degli oggetti agli attuali modelli generativi, e ha evidenziato una delle frontiere più difficili dell'intelligenza artificiale su cui sta attualmente lavorando: l'intelligenza spaziale.

Fei-Fei Li è attualmente fondatrice e CEO di World Labs, un'azienda di intelligenza spaziale dedicata alla costruzione di modelli del mondo su larga scala per percepire, generare e interagire con il mondo 3D. In questa conversazione, ha anche sollevato una serie di domande sull'importanza della modellazione del mondo 3D per l'intelligenza artificiale generale (AGI) e sul perché l'intelligenza spaziale possa essere più difficile da raggiungere rispetto al linguaggio .

Salva la portata per vedere la versione:

Questo è un cambiamento di paradigma nell'apprendimento automatico

La nascita di ImageNet non rappresenta solo il sogno personale di Fei-Fei Li, ma anche un cambio di paradigma nel campo della visione artificiale e del deep learning. Ha raccontato di essere stata ossessionata dal "far vedere le macchine" in quel momento, e di come questa perseveranza e il duro lavoro abbiano creato un momento importante in cui dati, GPU e reti neurali si sono uniti . Ora ha una nuova ossessione e intende continuare a guidare una nuova rivoluzione dell'intelligenza artificiale.

Vogliamo fare dell'intelligenza spaziale il nuovo campo di battaglia dell'IA

Dal riconoscimento degli oggetti alla comprensione delle scene, l'IA ha gradualmente iniziato a comprendere informazioni visive complesse. Una nuova fase di trasformazione ha interessato l'attuale era dell'IA. Ritiene che il mondo non sia puramente generativo e che solo consentendo all'IA di comprendere il mondo tridimensionale potremo davvero procedere verso l'IA. L'acquisizione di dati per modelli linguistici di grandi dimensioni è semplice e i modelli di intelligenza spaziale rappresentano la prossima sfida che dovrà affrontare.

Non posso rivelare troppi dettagli su World Labs.

Alla domanda sugli scenari applicativi previsti dai World Labs e sulle loro differenze rispetto all'attuale architettura degli LLM, Li Feifei ha affermato che l'integrazione di software e hardware, così come la realizzazione del metaverso, richiederanno la loro intelligenza spaziale. A differenza della realizzazione degli LLM, ha affermato che gli esseri umani non hanno una forte percezione del mondo 3D, il che è molto difficile, ma crede nel suo team, composto dalle persone più intelligenti al mondo, e che insieme a loro possono risolvere questo problema nel mondo 2D.

Nel campo dell'intelligenza artificiale, non aver mai paura di fallire

Al termine dell'intervista, Fei-Fei Li ha condiviso la sua esperienza di crescita personale, dall'immigrazione negli Stati Uniti per studio, alla direzione dello Stanford Artificial Intelligence Laboratory, alla vicepresidenza di Google e all'avvio di un'attività in proprio. Ha affermato di aver sempre iniziato da zero e di aver lavorato sodo . Ha inoltre incoraggiato i giovani a seguire i propri interessi e la propria curiosità, ad affrontare coraggiosamente le sfide e a risolvere problemi impossibili.

Video originale: https://youtu.be/_PioN-CpOP0

Di seguito la trascrizione dell'intervista, con lievi modifiche nella traduzione.

Il campo dell’apprendimento automatico ha bisogno di un cambio di paradigma

Moderatore: Sono molto emozionato di avere qui con noi la Dott.ssa Fei-Fei Li, che ha alle spalle una lunghissima carriera nell'intelligenza artificiale. Credo che molti la conoscano. Lei è anche conosciuta come la "madrina dell'intelligenza artificiale" e uno dei primi progetti da lei fondati è stato Imagenet nel 2009, 16 anni fa. Questo progetto è stato citato più di 80.000 volte e ha gettato le basi per un'importante pietra miliare per l'intelligenza artificiale: il problema dei dati. Può parlarci di come è nato questo progetto? Il lavoro svolto all'epoca era davvero rivoluzionario.

Fei-Fei Li: Sì, prima di tutto, grazie Diana, Gary e tutti voi per avermi invitato. Sono molto emozionato di essere qui perché mi sento come tutti gli altri. Ora sono anche un imprenditore, ho appena fondato un'azienda, quindi sono molto emozionato di essere qui.

Sì, hai ragione, in realtà abbiamo concepito questo progetto quasi 18 anni fa, il tempo vola davvero. Ero al mio primo anno come assistente professore alla Princeton University. Il mondo dell'intelligenza artificiale e dell'apprendimento automatico a quel tempo era completamente diverso da quello che è oggi. C'erano pochissimi dati e, almeno nel campo della visione artificiale, gli algoritmi non funzionavano affatto. All'epoca non esisteva un'industria e il pubblico conosceva a malapena il termine "intelligenza artificiale". Ma c'era ancora un gruppo di persone, a partire dai fondatori dell'intelligenza artificiale, come John McCarthy, e poi persone come Jeff Hinton. Penso che tutti noi sogniamo l'intelligenza artificiale e vogliamo davvero che le macchine abbiano la capacità di pensare e lavorare. E il mio sogno personale è quello di dare alle macchine capacità visive, perché la vista è la pietra angolare dell'intelligenza, e l'intelligenza visiva non è solo percezione, ma anche comprensione del mondo e capacità di agire nel mondo.

Ero quindi molto ossessionato dal problema di "far vedere le macchine". Nel mio percorso di sviluppo di algoritmi di apprendimento automatico, abbiamo provato le reti neurali, ma senza successo. Ci siamo rivolti ad altri metodi, come le macchine a vettori di supporto (SVM), ma c'era un problema che mi ha sempre tormentato, ovvero il problema della generalizzazione. Se si lavora nell'apprendimento automatico, è necessario comprendere che la generalizzazione è il fondamento matematico fondamentale e l'obiettivo dell'apprendimento automatico. Affinché questi algoritmi si generalizzino, i dati sono cruciali, ma all'epoca non esistevano quasi dati nel campo della visione artificiale. E io sono stato la prima generazione di studenti laureati a iniziare a lavorare con i dati, perché sono stata la prima generazione di studenti laureati ad assistere all'emergere di Internet e dell'Internet delle cose.

Intorno al 2007, io e i miei studenti decidemmo che dovevamo fare una mossa coraggiosa. Scommettevamo che il campo dell'apprendimento automatico avesse bisogno di un cambio di paradigma e che questo cambiamento dovesse essere guidato da metodi basati sui dati. Ma all'epoca non c'erano dati sufficienti. Così pensammo: dato che non c'erano dati, andiamo su Internet e scarichiamo miliardi di immagini, il numero più grande che possiamo trovare su Internet, e poi costruiremo un sistema di classificazione visiva globale per addestrare e valutare gli algoritmi di apprendimento automatico. È per questo motivo che è nato e si è concretamente concretizzato il progetto ImageNet.

I dati e l'open source inaugurano la primavera del deep learning

Presentatore: In effetti, è stato solo con l'emergere di algoritmi promettenti che le innovazioni hanno iniziato a farsi sentire. Solo con l'uscita di AlexNet nel 2012, questo è stato il secondo fattore chiave sulla strada dell'IA: ottenere una potenza di calcolo sufficiente e investire risorse sufficienti. E gli algoritmi hanno rivelato un momento critico, ovvero quando si semina l'IA con i dati: la comunità inizia gradualmente a trovare più soluzioni, il che fornisce slancio allo sviluppo dell'IA, giusto?

Fei-Fei Li: Nel 2009 abbiamo pubblicato solo un piccolo articolo come poster CVPR.

Dal 2009 al 2012, fino all'avvento di AlexNet, credevamo fermamente che i dati avrebbero guidato l'intelligenza artificiale, ma non avevamo quasi nessun segnale chiaro che questo approccio avrebbe funzionato.

Quindi abbiamo fatto un paio di cose: prima di tutto, abbiamo deciso di renderlo open source. Fin dall'inizio abbiamo pensato che dovesse essere open source affinché l'intera comunità di ricerca potesse utilizzarlo e collaborare per risolvere questo problema.

In secondo luogo, abbiamo lanciato una sfida perché volevamo che gli studenti e i ricercatori più brillanti di tutto il mondo si unissero a noi per lavorare su questo problema. È quella che chiamiamo la sfida ImageNet. Ogni anno pubblichiamo un set di dati di prova: i dati ImageNet dell'intera piattaforma vengono utilizzati per la formazione, ma pubblichiamo un set di dati di prova separato e invitiamo tutti a partecipare pubblicamente.

I primi anni sono stati dedicati a stabilire un punto di riferimento. Il tasso di errore nelle prestazioni era di circa il 30%, il che non era un errore pari a zero, né del tutto casuale, ma non eccezionale. Ma già al terzo anno, nel 2012, ho scritto di questa esperienza anche nel mio libro.

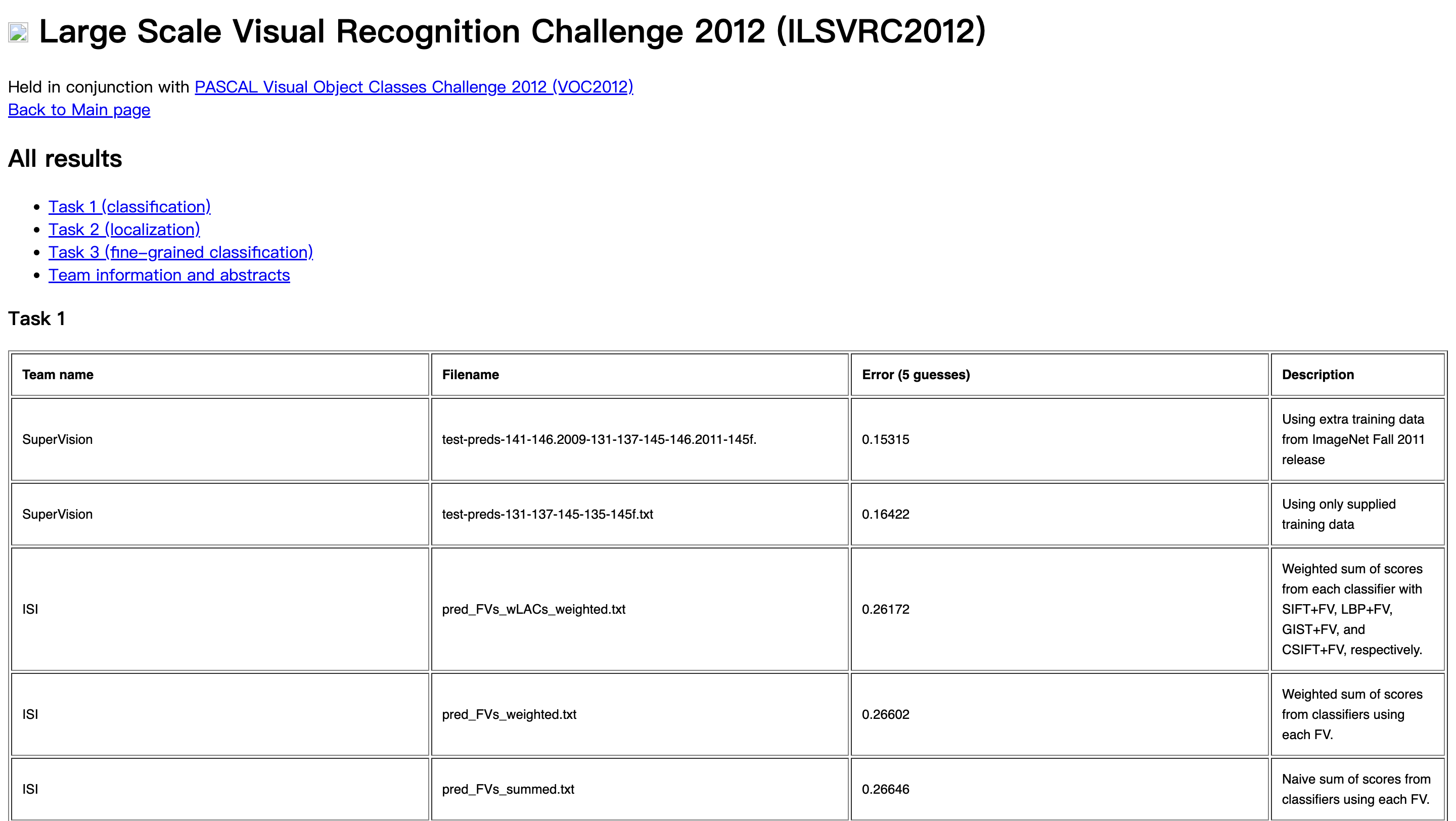

▲ Il primo posto nella sfida ImageNet è SuperVision

Ricordo ancora che era fine estate e stavamo elaborando tutti i risultati della sfida ImageNet sui nostri server. Una sera tardi, ricevetti un messaggio dal mio studente laureato che mi diceva che c'era un risultato che si distingueva davvero e che avremmo dovuto dargli un'occhiata. Lo cercammo e scoprimmo che si trattava di una rete neurale convoluzionale. All'epoca non si trattava di AlexNet, ma di un lavoro del team di Geoffrey Hinton chiamato "SuperVision". Era un gioco di parole molto ingegnoso, che combinava "super" e "apprendimento supervisionato". Esaminammo il lavoro svolto da SuperVision, che in realtà è un vecchio algoritmo. Le reti neurali convoluzionali erano state pubblicate già negli anni '80, ma avevano solo apportato alcune modifiche all'algoritmo, ma quando lo vedemmo per la prima volta, rimanemmo davvero sorpresi che si trattasse di una svolta così grande.

Naturalmente, la cosa successiva che sapete è che abbiamo presentato questo progetto al workshop ImageNet Challenge a Firenze, all'ICCV (International Conference on Computer Vision) di quell'anno, e Alex Krizhevsky e il suo team sono venuti, e con loro anche molte persone. Oggi, tutti chiamano quel momento il "momento AlexNet" dell'ImageNet Challenge.

Vorrei anche aggiungere che non si è trattato solo del successo della rete neurale convoluzionale, ma anche della prima volta in cui Alex e il suo team hanno combinato due GPU per calcoli di deep learning. Questo è stato davvero il primo momento importante per la combinazione di dati, GPU e reti neurali.

La mia carriera non consiste solo nel raccontare scene

Moderatore: Seguendo il trend di sviluppo dell'intelligenza artificiale nella visione artificiale, ImageNet ha effettivamente gettato le basi per risolvere il problema del riconoscimento degli oggetti. Successivamente, l'intelligenza artificiale ha raggiunto un punto in cui è in grado di risolvere il problema della comprensione delle scene. Perché tu e i tuoi studenti, come Andre Karpathy, avete iniziato a essere in grado di descrivere le scene. Puoi parlarci della transizione dal riconoscimento degli oggetti alla comprensione delle scene?

Fei-Fei Li: Sì, ImageNet risolve il problema di come identificare gli oggetti in un'immagine quando la si vede, come ad esempio "questo è un gatto, questa è una sedia", che è un problema fondamentale del riconoscimento visivo. Ma da quando sono entrato nel campo dell'intelligenza artificiale come studente laureato, ho avuto un sogno. Credo che ci vorranno cento anni per realizzarlo: raccontare la storia del mondo. Immaginate che quando gli esseri umani aprono gli occhi, non si vedano semplicemente "persone, sedie, tavoli", ma una sala conferenze, lo schermo, il palco, il pubblico, la telecamera, ecc. Si può descrivere l'intera scena, il che è un'abilità umana, la base dell'intelligenza visiva, ed è fondamentale per la nostra vita quotidiana. Pertanto, ho sempre pensato che questo problema avrebbe occupato la mia vita. Quando mi sono laureato, mi sono detto che se fossi riuscito a creare un algoritmo in grado di raccontare la storia di una scena, avrei avuto successo. Questa era la mia visione della carriera all'epoca.

Tuttavia, quel momento arrivò davvero con l'avvento del deep learning, e poi Andre e Justin Johnson si unirono al mio laboratorio e cominciammo a vedere segnali della collisione tra linguaggio naturale e visione.

Io e Andre abbiamo affrontato il problema della descrizione o narrazione delle immagini. E in breve, intorno al 2015, io e Andre abbiamo pubblicato una serie di articoli, alcuni dei quali pubblicati contemporaneamente a noi, che rappresentavano in realtà alcuni dei primi lavori volti a consentire ai computer di generare didascalie per le immagini. Mi sono quasi chiesto: come farò ad andare avanti con la mia vita? Questo è stato il sogno di una vita. È stato un momento davvero intenso per entrambi.

L'anno scorso, ho tenuto un TED Talk e ho usato un tweet che Andre aveva inviato qualche anno prima, subito dopo aver terminato il suo lavoro sulla didascalia delle immagini. Era praticamente la sua tesi di dottorato. Gli ho detto scherzosamente: "Ehi, Andre, perché non facciamo il contrario? Generiamo un'immagine da una frase ". Ovviamente, sapeva che stavo scherzando e ha risposto con un "Ahah, me ne vado prima io". Il mondo chiaramente non era pronto per una cosa del genere. Ma ora, tornando al presente, sappiamo tutti che l'IA generativa può generare immagini meravigliose da una frase. Quindi la morale della storia è che l'IA ha attraversato un'enorme evoluzione.

Personalmente, mi sento la persona più fortunata del mondo perché tutta la mia carriera è iniziata con la fine dell'inverno dell'IA e l'inizio della sua ascesa, e gran parte del mio lavoro e della mia carriera sono strettamente legati a questo cambiamento, o in qualche modo lo hanno guidato. Quindi, mi sento molto fortunato, grato e orgoglioso, in un certo senso.

Presentatore: Penso che la cosa più assurda sia che, nonostante tu abbia realizzato il tuo sogno di descrivere scene e persino di generarle tramite modelli di diffusione, continui a sognare in grande. Perché l'intera traiettoria della visione artificiale è passata dal riconoscimento degli oggetti alla comprensione delle scene, e ora al concetto di "mondo". E tu hai deciso di passare dal mondo accademico, da una cattedra, all'imprenditoria, diventando fondatore e CEO di World Labs. Puoi parlarci di cos'è il "mondo"? È più impegnativo di scene e oggetti?

Fei-Fei Li: Sì, è davvero pazzesco. Certo, tutti sanno cosa è successo in passato, e per me è davvero difficile riassumere i progressi degli ultimi cinque o sei anni. Viviamo un momento di civiltà, di progresso tecnologico. Come esperto di visione artificiale, abbiamo assistito a una crescita incredibile, dalle immagini alle descrizioni delle immagini, fino alla generazione di immagini utilizzando tecniche di diffusione. Sebbene questi progressi siano entusiasmanti, allo stesso tempo assistiamo anche a un'altra area estremamente interessante, ovvero il campo del linguaggio, in particolare i LLM (grandi modelli linguistici). Ad esempio, nel novembre 2022, l'emergere di ChatGPT ha davvero aperto le porte ai modelli generativi, che possono praticamente superare il test di Turing e così via. Quindi, anche le persone più anziane come me si sentono molto entusiaste e iniziano a pensare con coraggio a quale sia il prossimo obiettivo.

Come esperto di visione artificiale, ho l'abitudine di trarre spesso ispirazione dall'evoluzione e dalla neuroscienza. Spesso, nella mia carriera, mi ritrovo alla ricerca del prossimo problema "stella polare" da risolvere. Mi chiedo: cosa hanno fatto l'evoluzione o lo sviluppo del cervello? Una cosa degna di nota e apprezzabile è che l'evoluzione del linguaggio umano ha richiesto dai 300 ai 500 milioni di anni; anche se fossimo molto generosi, si tratterebbe di meno di un milione di anni. Gli esseri umani sono l'unica specie dotata di un linguaggio complesso. Possiamo parlare del linguaggio animale, ma per quanto riguarda la funzione del linguaggio come strumento di comunicazione, ragionamento e astrazione, solo gli esseri umani possiedono questa capacità. Questo processo evolutivo ha richiesto meno di 500.000 anni.

Ma se pensiamo alla vista, alla capacità di comprendere il mondo tridimensionale, di capire come muoverci in quel mondo tridimensionale, come orientarci, interagire, capire, comunicare con esso, tutto ciò ha richiesto 540 milioni di anni per evolversi.

Circa 540 milioni di anni fa, i primi trilobiti iniziarono a sviluppare la percezione visiva sott'acqua. Da allora, la vista è diventata la chiave per guidare la corsa agli armamenti evolutiva. Prima dell'emergere della vista, le forme di vita animali erano relativamente semplici, quasi prive di cambiamenti complessi per quasi 500 milioni di anni. Ma nei successivi 540 milioni di anni, fu proprio grazie alla capacità di comprendere il mondo che iniziò la corsa agli armamenti evolutiva e l'intelligenza degli animali continuò a migliorare.

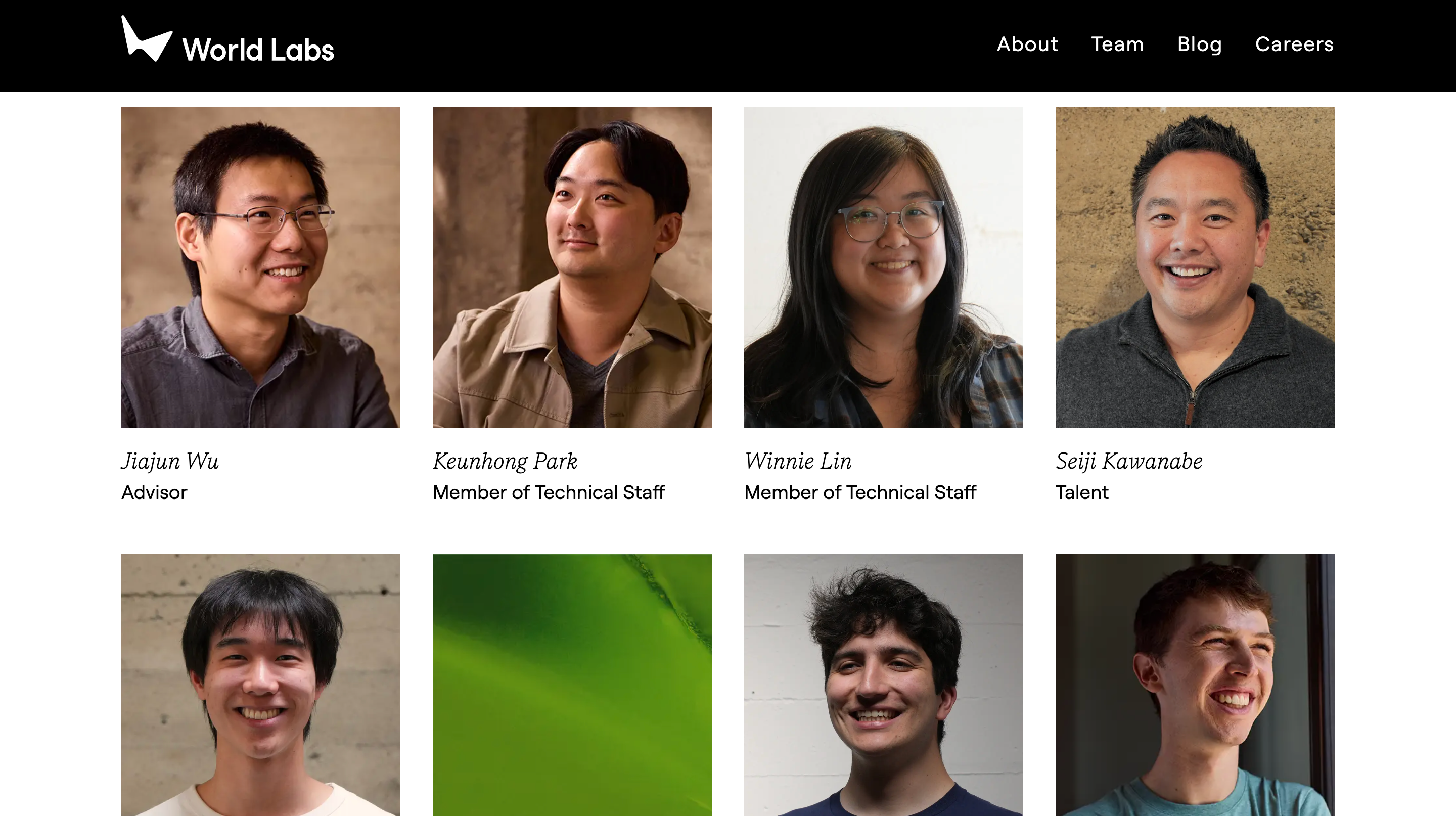

▲ Il team fondatore di iWorld Labs, Fei-Fei Li (primo da destra), Justin Johnson, Christoph Lassner, Ben Mildenhall

Quindi, per me, risolvere il problema dell'intelligenza spaziale, comprendere il mondo 3D, generare il mondo 3D, ragionare sul mondo 3D, fare cose nel mondo 3D, è un problema fondamentale per l'IA. Per me, l'IA è incompleta senza intelligenza spaziale. Voglio risolvere questo problema. E questo implica creare "modelli del mondo" che vadano oltre i pixel piatti, oltre il linguaggio, per catturare davvero la struttura 3D e l'intelligenza spaziale del mondo. Fortunatamente, a prescindere dalla mia età, ho sempre la possibilità di lavorare con i giovani più straordinari. Quindi ora sto avviando questa azienda con tre giovani tecnologi straordinari ma di fama mondiale, Justin Johnson, Ben Mildenhall e Christoph Lassner. Cercheremo di risolvere quello che credo sia il problema più difficile dell'IA in questo momento.

È molto più difficile ottenere dati sull'intelligenza spaziale rispetto a quelli linguistici.

Presentatore: In effetti, sono tutte persone di grande talento. Chris è il fondatore di Pulsar, una tecnologia di rendering differenziabile e ora un backend di rendering basato su sfere per PyTorch3D. E Justin Johnson, in quanto tuo ex studente, ha una forte mentalità da ingegnere di sistema e ha implementato il trasferimento di stile in tempo reale basato su reti neurali. E poi Ben, è l'autore dell'articolo sui NeRF (Neural Radiance Fields). Quindi questo è davvero un team d'élite. C'è bisogno di un team d'élite perché ne abbiamo già parlato: la visione è in realtà più difficile del linguaggio. Forse è un po' controverso dirlo, perché gli LLM sono essenzialmente monodimensionali, giusto? Ma stai parlando di comprendere molte strutture 3D. Perché è così difficile? Perché è più potente dei linguaggi più famosi al momento?

Fei-Fei Li: Sì, puoi capire la difficoltà del nostro problema. Il linguaggio è intrinsecamente unidimensionale e la grammatica emerge in sequenza, motivo per cui la modellazione sequenza-sequenza è così classica. Un altro punto è che il linguaggio è un segnale puramente generativo, cosa che molti non capiscono. Non esiste un linguaggio in natura, non si può toccare il linguaggio, non si può vedere il linguaggio, il linguaggio è completamente generato dalla testa di ognuno. Il linguaggio è un segnale puramente generativo. Certo, quando lo scrivi su carta, è lì, ma la generazione, la costruzione e l'utilità del linguaggio sono intrinsecamente molto generative, e il mondo è molto più complicato di così.

Innanzitutto, il mondo reale è tridimensionale. Se aggiungiamo il tempo, diventa quadridimensionale, ma per ora considereremo solo lo spazio. Il mondo reale è essenzialmente tridimensionale, il che rappresenta di per sé un problema combinatorio più complesso.

In secondo luogo, bisogna comprendere quanto sia difficile percepire il mondo visivo come un processo di proiezione, che si tratti degli occhi, della retina o della fotocamera, che comprime sempre le informazioni tridimensionali in due dimensioni. Matematicamente, questo è un processo irreversibile, ed è per questo che esseri umani e animali dispongono di molteplici sensi per risolvere questo problema.

In terzo luogo, il mondo non è puramente generativo. Certo, possiamo generare un mondo virtuale 3D, ma deve comunque seguire le leggi della fisica, e il mondo reale esiste al di fuori di noi. In realtà, ora si passa fluidamente dalla generazione alla ricostruzione. Il comportamento dell'utente, la praticità e gli scenari applicativi sono completamente diversi. Se ci si concentra sulla generatività in ogni aspetto, si può parlare di giochi, metaversi e altro; se ci si concentra sul mondo reale in ogni aspetto, si parla di robotica e così via. Ma tutto si colloca nel continuum tra modellazione del mondo e intelligenza spaziale.

Naturalmente, la grande sfida attuale è rappresentata dalla presenza di molti dati linguistici su internet, e i dati sull'intelligenza spaziale, sebbene siano tutti presenti nel nostro cervello, non sono facilmente accessibili come quelli linguistici. Questi sono tutti i motivi per cui questo problema è così difficile. Ma, francamente, è proprio questo che mi entusiasma, perché se questo problema fosse facile, significherebbe che qualcun altro lo ha già risolto. E tutta la mia carriera è stata dedicata a risolvere problemi estremamente difficili, quasi illusori. Credo che questo sia proprio il problema illusorio. Grazie per il vostro supporto in questo problema.

I nostri laboratori mondiali hanno le persone più intelligenti del mondo

Presentatore: Sì, anche dai principi più elementari, la corteccia visiva del cervello umano ha molti più neuroni che elaborano i dati visivi rispetto ai neuroni che elaborano il linguaggio. Come si manifesta questa differenza nei modelli? Incluso, le cose su cui stai lavorando saranno anche molto diverse in termini di architettura rispetto a LLM, giusto?

Fei-Fei Li: Questa è un'ottima domanda. In realtà, attualmente ci sono due approcci diversi a questa questione.

Uno è l'approccio degli LLM, in cui molti dei modelli di scrittura e di approfondimento della scrittura che osserviamo negli LLM possono essere quasi direttamente sviluppati attraverso l'apprendimento autosupervisionato fino al raggiungimento di un "lieto fine". È possibile quasi forzare l'autosupervisione fino al raggiungimento dell'obiettivo.

L'altro è costruire un modello del mondo, che potrebbe essere più dettagliato e gerarchico, perché il mondo è strutturato e potremmo aver bisogno di segnali per guidarlo. Si può pensare a questo come a una conoscenza pregressa, o come a un segnale di supervisione nei dati; in ogni caso, è un modo per guidare l'apprendimento.

Penso che queste siano alcune delle domande aperte che dobbiamo risolvere, ma hai ragione. Se pensi alla percezione umana, prima di tutto, non abbiamo ancora risolto completamente tutti i problemi della vista umana, giusto? Come si inserisce il 3D nella visione umana? Non è ancora un problema risolto. Sappiamo che meccanicamente gli occhi devono ottenere informazioni attraverso la triangolazione, ma nonostante ciò, ci manca un modello matematico perfetto e, in realtà, gli esseri umani non sono particolarmente abili nella percezione 3D. Non siamo molto bravi a comprendere e manipolare il mondo tridimensionale, quindi ci sono molte domande in attesa di risposta.

▲ Screenshot di alcuni membri di World Labs

Quindi, ora siamo davvero nella fase dei "World Labs". L'unica cosa su cui posso contare è che credo che abbiamo le persone più intelligenti del mondo per risolvere questo problema nel "Pixel World".

La convergenza tra hardware e software alla fine avverrà

Moderatore: Possiamo dire che il risultato finale di questi modelli di base che World Labs sta sviluppando è un mondo 3D? Quali scenari applicativi state immaginando? Ho visto che avete menzionato diverse possibilità, dalla percezione alla generazione. C'è sempre una tensione tra modelli generativi e modelli discriminativi, quindi qual è il ruolo di questi mondi 3D?

Fei-Fei Li: Sì, forse non posso rivelare molto sui dettagli specifici dei World Labs, ma in termini di intelligenza spaziale, è davvero un luogo che mi entusiasma. Proprio come il linguaggio, gli scenari applicativi sono molto ampi. Fin dall'inizio della creazione, designer, architetti, designer industriali e persino artisti, artisti 3D e sviluppatori di videogiochi possono utilizzarlo. Anche la robotica e l'apprendimento robotico rappresentano un'area applicativa molto importante e gli utilizzi dei modelli di intelligenza spaziale o dei modelli del mondo sono molto ampi. Inoltre, molti settori correlati, come il marketing, l'intrattenimento e persino il metaverso, ne saranno interessati. Sono davvero entusiasta del metaverso. Sebbene non sia ancora pienamente realizzato, so che non è ancora molto maturo, ma è proprio per questo che sono ancora più entusiasta. Credo che l'integrazione di hardware e software prima o poi arriverà, e il potenziale per il futuro è enorme. Anche questa è una direzione applicativa molto interessante.

Presentatore: Sono personalmente molto entusiasta che tu stia risolvendo il problema del metaverso. Ho già sperimentato questa direzione nella mia azienda, quindi sono davvero entusiasta di vedere che lo stai facendo ora.

Li Feifei: Sì, credo che ora ci siano più segnali che il Metaverso si stia gradualmente realizzando. Credo che l'hardware sia effettivamente uno degli ostacoli, ma soprattutto è necessario creare contenuti, e la creazione di contenuti per il Metaverso richiede modelli di mondo.

Partendo da zero, questa è la mia zona di comfort

Moderatore: Cambiamo argomento. Per alcuni spettatori, il tuo passaggio dal mondo accademico a quello di fondatore e CEO potrebbe sembrare un po' improvviso. Ma in realtà, tutta la tua esperienza di vita è davvero straordinaria, e non è la prima volta che passi da 0 a 1. Una volta mi hai raccontato di come sei emigrato negli Stati Uniti, di come all'inizio non parlavi inglese e di come hai gestito un'attività di lavanderia con il tuo team per diversi anni. Puoi parlarci di come queste esperienze ti hanno plasmato oggi?

Fei-Fei Li: Giusto? So che siete qui per sentire la mia storia su come ho aperto un'attività di lavanderia. Ahah.

Avevo 19 anni ed ero completamente disperata. Non avevo modo di mantenere la mia famiglia, i miei genitori volevano che andassi all'università e io volevo studiare fisica a Princeton. Così ho aperto una lavanderia a secco. Per usare i termini della Silicon Valley, facevo il fundraiser, il fondatore e l'amministratore delegato, il cassiere e facevo tutte le faccende domestiche, e alla fine "me ne sono andata" dopo sette anni.

Tornando al punto di Diana, soprattutto per tutti voi, vi guardo ed è davvero emozionante perché siete la metà, o anche un terzo, più giovani di me e siete così talentuosi, buttatevi, non abbiate paura.

Sono stato così per tutta la mia carriera, incluso, ovviamente, il lavoro in lavanderia, e anche come professore ho fatto alcune scelte. Una volta ho scelto di andare in alcuni dipartimenti che non avevano un professore di visione artificiale, per essere il primo, il che andava contro molti consigli. Da giovane professore, tutti ti consiglieranno di andare in un posto dove c'è una comunità e un mentore senior. Certo, spero anche io di avere un mentore senior, ma se non ce l'ho, andrò comunque per la mia strada. Quindi non ho affatto paura di questo. In seguito sono andato a Google e ho imparato molto sul business, su Google Cloud e sul B2B, e poi ho avviato una startup a Stanford, perché entro il 2018 l'intelligenza artificiale non è più solo un problema di settore, è diventata un problema umano.

Gli esseri umani guideranno sempre il progresso tecnologico, ma non possiamo perdere la nostra umanità. Sono molto concentrato su come creare un raggio di luce nel progresso dell'intelligenza artificiale, su come l'intelligenza artificiale possa essere incentrata sull'uomo e su come possa aiutare gli esseri umani. Così, sono tornato a Stanford e ho fondato un istituto di intelligenza artificiale incentrato sull'uomo, che ho gestito come startup per cinque anni. Alcuni potrebbero non essere contenti che l'abbia gestito come startup per così tanto tempo durante l'università, ma ne sono molto orgoglioso. Quindi, in un certo senso, penso che mi piaccia semplicemente essere un imprenditore. Mi piace la sensazione di partire da zero, come se fossi al punto zero, dimenticando cosa ho fatto in passato, cosa pensano gli altri di me, e semplicemente fare quello che faccio. Questa è la mia zona di comfort, e adoro questa sensazione.

Ciò che cerco è l'intrepidezza intellettuale.

Presentatore: È davvero fantastico che tu abbia fatto tutte queste cose straordinarie e che tu abbia fatto da mentore a molti ricercatori leggendari, come Andrej Karpathy, Jim Fan (ora in Nvidia), Jia Deng (che ha collaborato al progetto ImageNet). Sono tutti diventati leader del settore. Quando erano ancora studenti, cosa ti ha fatto capire che avrebbero raggiunto traguardi straordinari in futuro? Che consiglio puoi darci per aiutarci a identificare queste persone che cambieranno il campo dell'intelligenza artificiale?

Fei-Fei Li: Prima di tutto, mi sento molto fortunato e non credo di aver contribuito più di loro ai miei studenti. Mi rendono davvero una persona migliore, un insegnante migliore e un ricercatore migliore. È davvero un onore per me lavorare con così tanti studenti leggendari, come hai detto. Ogni studente è molto diverso. Alcuni sono scienziati puri che si concentrano sulla risoluzione di problemi scientifici; altri sono leader del settore; e altri ancora sono grandi divulgatori della conoscenza dell'intelligenza artificiale. Ma credo che ci sia una cosa che li accomuna tutti, e incoraggio ogni studente qui presente a riflettere su questo aspetto.

Questo è anche il criterio che cerco negli imprenditori, soprattutto quando assumo. Cerco coraggio intellettuale.

Credo che non dipenda solo dalla provenienza o dal problema che si sta cercando di risolvere, ma dal coraggio di affrontare la sfida e impegnarsi a risolverla. Questa impavidità è davvero la qualità fondamentale del successo. L'ho imparato da questi studenti e, come CEO del nostro laboratorio, apprezzo molto questo aspetto anche nel mio processo di selezione.

Presentatore: Anche voi state reclutando molte persone per World Labs, quindi state cercando le stesse posizioni?

Fei-Fei Li: Sì, stiamo effettivamente assumendo su larga scala. Stiamo assumendo talenti ingegneristici, di prodotto, 3D e di modellazione generativa. Se vi sentite coraggiosi e avete la passione di risolvere problemi intelligenti, contattatemi o visitate il nostro sito web.

Domande e risposte del pubblico

Domanda 1: Ciao Feifei, grazie per il tuo intervento. Sono un tuo grande fan! La mia domanda è: hai lavorato sul riconoscimento visivo più di 20 anni fa. Ora vorrei iniziare un dottorato di ricerca: quale percorso di studi dovrei intraprendere per diventare una leggenda come te?

Fei-Fei Li: Voglio darti una risposta ponderata perché posso sempre dirti di fare ciò che ti entusiasma.

In primo luogo, credo che la ricerca sull'intelligenza artificiale sia cambiata perché se si fa un dottorato di ricerca, ci si trova nel mondo accademico. Oggi, il mondo accademico non dispone più della maggior parte delle risorse di intelligenza artificiale, il che è molto diverso dalla mia situazione. La potenza di calcolo e le risorse di dati sono molto limitate nel mondo accademico, mentre l'industria può fare ricerca a un ritmo molto più veloce. Pertanto, come dottorando, consiglierei di cercare direzioni che non siano in conflitto con i problemi che l'industria può risolvere con una maggiore potenza di calcolo, dati più ricchi e i vantaggi del lavoro di squadra. Ci sono ancora alcuni problemi fondamentali che il mondo accademico può continuare a esplorare e, anche con più chip, si possono fare grandi progressi.

Innanzitutto, l'IA interdisciplinare è per me un'area molto stimolante nel mondo accademico, soprattutto in termini di scoperta scientifica. Ci sono tantissime discipline che possono intersecarsi con l'IA. Credo che questo sia un ambito che può essere sviluppato in modo approfondito. D'altra parte, in termini teorici, trovo molto interessante che le capacità dell'IA abbiano completamente superato la teoria. Non sappiamo come farlo, manca l'interpretabilità e non sappiamo come rivelare relazioni causali. Ci sono ancora molte incognite nella nostra comprensione del modello e ci sono ancora molte direzioni per promuovere ulteriormente lo sviluppo di questo campo in futuro. Nel campo della visione artificiale, ci sono ancora alcuni problemi irrisolti. Inoltre, anche gli small data sono un campo molto interessante e ricco di possibilità.

Domanda 2: Grazie, Professor Fei-Fei Li, e congratulazioni ancora per aver ricevuto la laurea honoris causa dall'Università di Yale. Sono stato onorato di assistere di persona a questo momento un mese fa. La mia domanda è: dal suo punto di vista, l'IA ha più probabilità di emergere come un modello unificato e unico o come un sistema "modello-agente"?

Fei-Fei Li: Sono state proposte due definizioni per la domanda che hai posto. Una definizione è più teorica, e definisce l'AGI come un'intelligenza misurata da una sorta di test del QI, e l'altra parte della domanda è più pragmatica, e si concentra sui compiti che un agente intelligente può svolgere. Francamente, sono un po' confuso sulla definizione di AGI.

Questo perché, alla Conferenza di Dartmouth del 1956, i fondatori dell'intelligenza artificiale, tra cui John McCarthy e Marvin Minsky, volevano risolvere il problema delle macchine in grado di "pensare", che in realtà era stato proposto da Alan Turing prima di loro. Pertanto, questa proposta non è un problema di intelligenza artificiale in senso stretto, ma una proposta più ampia sull'intelligenza. Pertanto, non sono sicuro di come distinguere questo problema fondante dell'intelligenza artificiale dal nuovo termine "AGI".

Per me, AGI e IA sono la stessa cosa, ma capisco che il settore tenda a considerare l'AGI come qualcosa di più ampio dell'IA. Faccio fatica a comprenderlo perché non so esattamente cosa sia l'AGI e in che modo differisca dall'IA. Se affermiamo che i sistemi "simili all'AGI" di oggi hanno prestazioni migliori in determinati compiti rispetto ai sistemi di IA ristretti degli anni '70, '80 e '90, penso che sia giusto, e che sia semplicemente una naturale evoluzione del settore. Ma fondamentalmente, credo che l'essenza dell'intelligenza artificiale sia creare macchine in grado di pensare e fare cose come gli esseri umani, o addirittura più intelligenti degli esseri umani. Quindi, non so come definire l'AGI e, poiché non sono in grado di definirla, non posso dire se si tratti di un sistema unico.

Se lo guardiamo dalla prospettiva del cervello, è un tutto e possiamo definirlo un singolo sistema, ma le sue funzioni sono diverse e nel cervello c'è persino l'area di Broca responsabile del linguaggio, la corteccia visiva per la visione, la corteccia motoria per il movimento, ecc. Pertanto, non so davvero come rispondere a questa domanda.

Domanda 3: Ciao, mi chiamo Yasna. Prima di tutto, vorrei ringraziarti. È davvero stimolante vedere una donna assumere un ruolo di leadership in questo campo. Come ricercatrice, educatrice e imprenditrice, vorrei chiederti: nell'attuale campo in rapida evoluzione dell'intelligenza artificiale, che tipo di persone pensi dovrebbero conseguire una laurea magistrale?

Fei-Fei Li: Ottima domanda, me l'hanno fatta anche i genitori. La scuola di specializzazione è un periodo di quattro o cinque anni di intensa curiosità.

Sei guidato dalla curiosità, e questa curiosità è così forte che non c'è posto migliore per coltivarla che qui. Questo è diverso da una startup perché in una startup non puoi essere guidato solo dalla curiosità. Devi stare attento che una startup non sia guidata solo dalla curiosità, altrimenti gli investitori non saranno contenti. È più focalizzata sul raggiungimento degli obiettivi aziendali e, sebbene ci sia un elemento di curiosità, non è completamente guidata dalla curiosità. E per gli studenti laureati, la curiosità di risolvere i problemi o la capacità di porre domande è molto importante, e penso che coloro che intraprendono la laurea magistrale con questa forte curiosità apprezzeranno molto quei quattro o cinque anni, e anche se il mondo esterno si evolve rapidamente, ti sentirai comunque soddisfatto perché hai seguito la tua curiosità.

Domanda 4: Innanzitutto, vorrei ringraziarla per aver dedicato del tempo a condividere le sue opinioni con noi. Ha affermato che l'open source ha svolto un ruolo importante nello sviluppo dell'intelligenza artificiale per immagini. Ora, con il rilascio e lo sviluppo di modelli linguistici di grandi dimensioni, vediamo diverse organizzazioni adottare strategie diverse in termini di open source. Alcune organizzazioni sono completamente closed source, altre completamente open source per l'intero framework di ricerca, e altre ancora adottano un approccio di compromesso, pesi dei modelli open source o licenze restrittive, ecc. Quindi, vorrei chiederle: cosa ne pensa di questi diversi approcci open source? Qual è, secondo lei, l'approccio giusto? Come azienda di intelligenza artificiale, come dovrebbe funzionare l'open source?

Fei-Fei Li: Credo che quando ci sono diverse modalità di open source nell'ecosistema, l'intero ambiente sia sano. Non sono categorico sulla scelta tra open source e closed source. Dipende dalla strategia aziendale. Ad esempio, Meta (ex Facebook) ha le idee molto chiare sul perché abbia scelto l'open source. Il loro attuale modello di business non è quello di realizzare profitti attraverso modelli di vendita, ma di sviluppare l'ecosistema utilizzando questi modelli e attrarre più persone a utilizzare la loro piattaforma. Quindi l'open source ha molto senso per loro. E per altre aziende che traggono profitti da queste tecnologie, si può considerare una combinazione di open source e closed source, operando a più livelli. Quindi sono aperto a questi approcci.

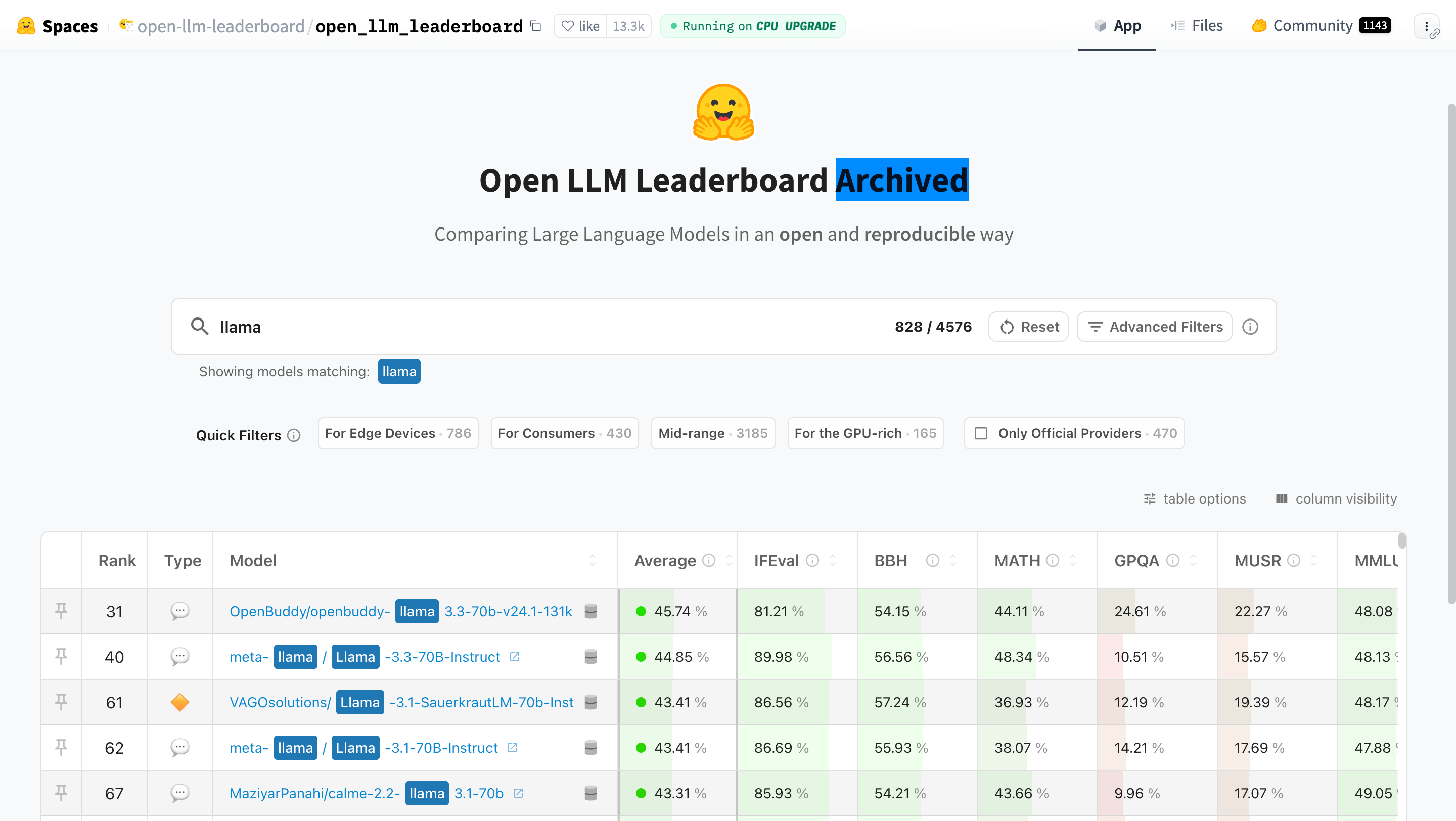

▲ Il modello open source llama di Meta è nella classifica dei modelli di linguaggio open source di Hugging Face

A un livello più alto, credo che l'open source debba essere protetto, sia nel settore pubblico, come quello accademico, che in quello privato. Se ci sono iniziative open source, è molto importante. È fondamentale per l'ecosistema delle startup, ed è molto importante anche per il settore pubblico. Credo che queste iniziative debbano essere protette e non ignorate.

Domanda 5: Salve, mi chiamo Carl, vengo dall'Estonia e ho una domanda sui dati. Hai menzionato il cambiamento nell'apprendimento automatico rispetto agli approcci basati sui dati, in particolare i progressi compiuti su ImageNet. Ora stai studiando modelli del mondo e hai detto che ci mancano dati spaziali, che non esistono su Internet, ma solo nel nostro cervello. Come risolvi questo problema? Qual è la tua direzione di ricerca? Stai raccogliendo dati dal mondo reale o generando dati sintetici? Credi nei dati sintetici? O credi di più nella conoscenza pregressa tradizionale? Grazie.

Fei-Fei Li: Dovresti venire con me a World Labs e te lo dirò. Come azienda, non posso rivelare molto, ma credo sia importante riconoscere che adottiamo un approccio ibrido. È fondamentale disporre di molti dati, ma è altrettanto importante disporre di dati di alta qualità. In fin dei conti, se non si presta attenzione alla qualità dei dati, il risultato finale è spazzatura in entrata e spazzatura in uscita.

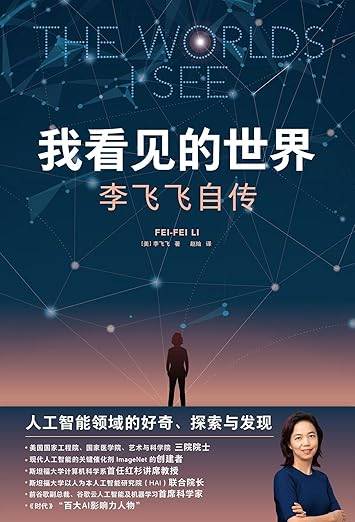

Domanda 6: Salve, Dott.ssa Fei-Fei Li, mi chiamo Annie, grazie mille per aver parlato con noi. Nel suo libro, "The World", ho visto che ha parlato delle sfide dell'essere una ragazza e una donna immigrata nei settori STEM. Vorrei sapere se si è mai sentita una minoranza sul posto di lavoro. In caso affermativo, come ha superato questo dilemma o come ha convinto gli altri?

Fei-Fei Li: Grazie per la domanda. Sarò cauto e riflessivo nel rispondere perché ognuno di noi ha un background diverso e ognuno di noi ha un'esperienza unica. Sai, non ha quasi importanza. Tutti abbiamo momenti in cui ci sentiamo in minoranza o gli unici nella stanza. Quindi, ovviamente, ho provato queste sensazioni.

A volte si tratta di chi sono, a volte di come penso, a volte è solo il colore dei vestiti che indosso, c'è sempre un motivo. Ma voglio incoraggiarvi in questo senso. Forse è perché sono arrivata in questo Paese da giovane e ho vissuto delle esperienze. Ho accettato di essere una donna immigrata. Ho quasi sviluppato la capacità di non prenderla troppo sul serio. Sono qui, proprio come ognuno di voi. Sono qui per imparare, per fare, per creare.

Voglio davvero dire a ognuno di voi: che stiate per iniziare qualcosa, o che siate già in procinto di farlo, avrete momenti di debolezza o confusione. Io lo sento ogni giorno, soprattutto nella vita imprenditoriale. A volte penso: "Oh mio dio, non so cosa sto facendo". Non preoccupatevi, concentratevi solo sul farlo. Proprio come nella discesa graduale, procedete passo dopo passo verso la soluzione ottimale.

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.