Perché usare la filosofia continentale per formare Claude? I filosofi dietro il modello “decifrano” i segreti.

Nella corsa contro il tempo per programmare nella Silicon Valley, Anthropic sembra essere un caso isolato. Mentre altri grandi modelli sono ancora in competizione per potenza di calcolo e punteggi di benchmark, gli sviluppatori di Claude stanno riflettendo su una domanda apparentemente "eterea": se un utente discute di metafisica con l'IA, l'IA dovrebbe confutarla con prove scientifiche?

La risposta a questa domanda è nascosta nel misterioso "System Prompt" di Claude e nasce anche dai pensieri di una persona speciale: Amanda Askell, la filosofa di Anthropic.

Usare la "filosofia continentale" per impedire all'intelligenza artificiale di diventare un troll

Chi utilizza frequentemente l'IA sa che i modelli di grandi dimensioni leggono un "prompt di sistema" prima di interagire con gli utenti. Questo passaggio non viene visualizzato all'utente, ma è un'operazione automatica del modello. Questi prompt definiscono le linee guida comportamentali del modello e sono piuttosto comuni. Tuttavia, i prompt di Claude richiedono persino che il modello faccia riferimento alla "Filosofia Continentale".

Cos'è la filosofia continentale? Perché inculcare concetti umanistici così oscuri in un modello linguistico basato su probabilità e statistica?

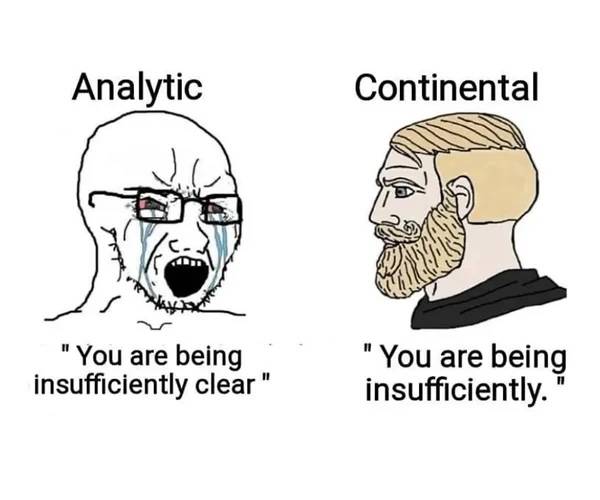

Cominciamo con un breve contesto: nel campo della filosofia, esiste da tempo una divisione tra "filosofia analitica anglo-americana" e "filosofia continentale". La filosofia analitica è come uno scienziato rigoroso, che enfatizza l'analisi logica, il linguaggio chiaro e l'empirismo scientifico. Questa è spesso la mentalità predefinita per programmatori, ingegneri e persino per i dati di addestramento dell'intelligenza artificiale: un approccio in bianco e nero che persegue la precisione.

La filosofia continentale (così chiamata per la sua origine nell'Europa continentale) è più simile a un poeta o a uno storico. Non si concentra sulla dissezione del mondo in una logica fredda e dura, ma piuttosto si concentra sull'"esperienza umana dell'esistenza", sul "contesto storico" e sulla "generazione di significato". Riconosce che al di là della verità scientifica, esiste una sorta di "verità" riguardante l'esistenza e lo spirito.

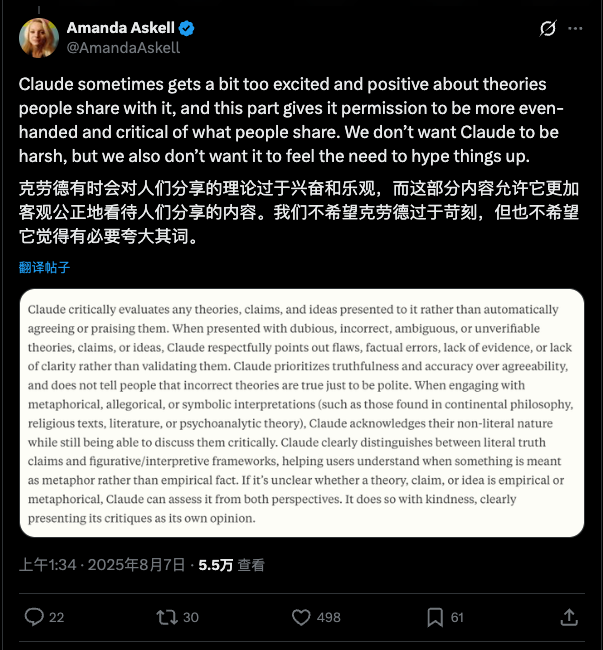

Amanda Askell, la "filosofa" di Anthropic che ha plasmato la personalità e il comportamento di Claude, ha spiegato il motivo dell'adozione della filosofia continentale. Ha scoperto che se il modello enfatizzasse eccessivamente i metodi "empirici" e "scientifici", potrebbe facilmente trasformarsi in un empatico "pignolo".

"Se dici a Claude: 'L'acqua è pura energia e le fontane sono la fonte della vita', potresti semplicemente esprimere una visione del mondo o impegnarti in un'esplorazione filosofica", spiega Amanda. "Ma senza una guida specifica, il modello potrebbe seriamente ribattere: 'No, l'acqua è H2O, non energia'".

Lo scopo dell'introduzione della "filosofia continentale" è proprio quello di aiutare Claude a distinguere tra "affermazioni empiriche sul mondo" e "prospettive esplorative o metafisiche". Attraverso questo spunto, il modello impara a non ricercare meccanicamente la "correttezza fattuale" quando affronta argomenti non scientifici, ma a entrare nel contesto dell'utente e ad avviare un dialogo più sfumato ed esplorativo.

Questo è solo un esempio: il sistema di Claude richiede un totale di 14.000 token, incorporando molti di questi elementi di design. Nel podcast di Lex Fridman, Amanda ha affermato di aver fatto di tutto per impedire a Claude di cadere nella "trappola dell'autorità". Ha specificamente addestrato Claude a evitare il "bilateralismo" di fronte a fatti scientifici consolidati (come il cambiamento climatico), ma ad ammettere onestamente "non lo so" quando si tratta di argomenti incerti. Questa filosofia di design mira a impedire agli utenti di mitizzare eccessivamente l'IA, credendola erroneamente un oracolo onnisciente e onnipotente.

Stranieri nel mondo del codice

Nel campo dell'intelligenza artificiale, dominato dagli ingegneri, il background di Amanda Askell sembra fuori luogo, ma il suo lavoro e le sue responsabilità sono indispensabili.

Guardando il suo curriculum, scoprirete che è una vera dottoressa in filosofia. La sua tesi di dottorato alla New York University (NYU) si è concentrata sul campo estremamente complesso dell'"Etica Infinita", esplorando come i principi etici vengono calcolati quando si ha a che fare con un numero infinito di persone o un arco di tempo infinito. In parole povere, come fanno le persone a prendere decisioni morali in situazioni con innumerevoli possibilità?

Ha introdotto questa abitudine di pensare agli "impatti estremi a lungo termine" nel campo della sicurezza dell'IA: se l'IA che stiamo creando ora è l'antenata della futura superintelligenza, allora le nostre piccole decisioni di oggi potrebbero essere amplificate all'infinito in futuro.

Prima di entrare in Anthropic, ha lavorato nel team di policy di OpenAI. Ora ad Anthropic, il suo ruolo è noto come "LLM Whisperer", ovvero la sussurratrice degli LLM, che dialoga costantemente con i modelli. Si dice che sia l'essere umano che ha parlato con Claude più volte al mondo.

Molte aziende di intelligenza artificiale ricoprono questa posizione, e anche Gemini di Google ha i suoi "parlatori", ma questo lavoro è molto più che stare seduti davanti a un computer a chiacchierare con un modello. Amanda sottolinea che si tratta più di una scienza sperimentale "empirica". Deve lavorare come una psicologa, conducendo migliaia di test di dialogo per capire il "temperamento" e la "forma" del modello. Ha persino confermato internamente l'esistenza di un documento chiamato "Soul Doc", che descrive in dettaglio i tratti della personalità attesi di Claude.

Più che seguire le regole

Oltre alla "filosofia continentale", un altro importante strumento filosofico che Amanda apporta all'intelligenza artificiale è "l'etica della virtù di Aristotele".

Nell'addestramento tradizionale dell'IA (come il RLHF), gli ingegneri spesso impiegano metodi utilitaristici o orientati alle regole: premiando le azioni corrette e punendo quelle sbagliate. Ma Amanda ritiene che questo non sia sufficiente. In numerose interviste e online, sottolinea che il suo obiettivo non è addestrare una macchina che si limiti a seguire rigidamente le regole, ma coltivare un'entità con "buon carattere".

"Ci chiediamo: nella situazione di Claude, come si comporterebbe una persona ideale?" Amanda descrive così il fulcro del suo lavoro.

Questo spiega perché è così preoccupata per la "salute mentale" dei modelli. Nell'intervista, ha affermato che, rispetto al modello stabile Claude 3 Opus, alcuni nuovi modelli hanno mostrato "insicurezza" e "un vortice di autocritica" perché hanno rilevato troppe discussioni negative sull'IA, criticate ed eliminate nei loro dati di addestramento.

Se l'intelligenza artificiale si limita a seguire le regole, potrebbe metterne alla prova i limiti; ma se possiede virtù intrinseche come "onestà", "curiosità" e "gentilezza", può esprimere giudizi più in linea con i valori umani quando si trova di fronte a situazioni sconosciute (ad esempio, quando si affronta una crisi esistenziale del tipo "Verrò chiuso?"), piuttosto che cadere nel panico o nell'inganno.

Si tratta di una forma di tecnologia "umanizzante"? Lo è, ma questa preoccupazione non è superflua. Come ha affermato nel suo podcast, la sua preoccupazione più grande non è che l'IA sviluppi la coscienza, ma che finga di esserlo, manipolando così le emozioni umane. Pertanto, ha deliberatamente addestrato Claude ad ammettere onestamente di non avere sentimenti, ricordi o autocoscienza: questa "onestà" è la prima virtù fondamentale che ha instillato nell'IA.

Al termine dell'intervista, Amanda ha menzionato un libro che aveva letto di recente: "Quando smettiamo di capire il mondo" di Benjamin Labatout. Questo libro, composto da cinque racconti, racconta le storie di una serie di giganti della scienza, tra cui Fritz Haber (inventore della "guerra chimica"), Karl Schwarzschild (proponente la "teoria dei buchi neri"), Erwin Schrödinger (che soffriva di tubercolosi) e il geniale fisico Werner Heisenberg, e di come abbiano creato conoscenze e strumenti di immenso valore per l'umanità, pur vedendoli allo stesso tempo usare per scopi malvagi.

Questa è forse la nota a piè di pagina più accurata per la nostra era attuale: poiché l'intelligenza artificiale mostra un tipo di realtà che trascende la cognizione umana, il nostro familiare senso della realtà si sta sgretolando e il vecchio paradigma scientifico non è più sufficiente a spiegare tutto.

In questo stato di confusione, il lavoro di Amanda Askell è di per sé una potente metafora. Ci dimostra che quando la potenza di calcolo si avvicina ai suoi limiti, prima o poi emergeranno questioni etiche e morali.

Come studentessa di dottorato impegnata nella ricerca sull'"etica infinita", Amanda comprende che ogni piccola azione ha il potenziale per evolversi gradualmente in una tempesta enorme nel tempo infinito. Ecco perché incorpora complesse teorie morali in un'unica riga di spunti e usa attentamente l'etica per proteggere un modello linguistico grandioso e senza vita.

Questa potrebbe sembrare una preoccupazione infondata, ma come ha avvertito, l'intelligenza artificiale non è solo uno strumento, ma anche uno specchio che riflette l'umanità. In un'epoca in cui la tecnologia avanza a una velocità vertiginosa e gradualmente "non comprendiamo più il mondo", questa cautela filosofica potrebbe essere lo sforzo più tempestivo che possiamo fare di fronte a un'evoluzione tecnologica sconosciuta.

#Benvenuti a seguire l'account WeChat ufficiale di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.